NVIDIA Jetson Nano 2GB 系列文章(31):DeepStream 多模型组合检测-1

前面已经介绍过关于DeepStream各种输入源的使用方式,而且Jetson Nano 2GB上开启4路输入(两个摄像头+两个视频文件),都能得到25FPS以上的实时性能,但毕竟“单一检测器(detector)”检测出来的物件是离散型的内容,例如车、人、脚踏车这些各自独立的信息。有没有什么方法能够实现“组合信息”呢?例如“黑色/大众/SUV车”!

DeepStream有一个非常强大的功能,就是多模型组合检测的功能,以一个主(Primary)推理引擎(GIE:GPU Inference Engine)去带着多个次(Secondary)推理引擎,就能实现前面所说的功能。

本实验在Jetson Nano 2GB上,执行4种模型的组合检测功能,能将检测到的车辆再往下区分颜色、厂牌、车种等三个进一步信息,在4路输入视频状态下能得到20+FPS性能,并且我们将显示的信息做中文化处理(如下图)。

在Jetson Nano 2GB上已经安装的DeepStream的范例中,已经预先准备了多个与“车”有关的检测器,可以在/opt/nvidia/deepstream/deepstream/samples/models目录下,看到以下信息:

|

nvidia@nano2g-jp450:/opt/nvidia/deepstream/deepstream/samples/models$ ls -l 总用量 24 drwxrwxrwx 2 root root 4096 7月 13 23:49 Primary_Detector drwxrwxrwx 2 root root 4096 7月 13 22:45 Primary_Detector_Nano drwxrwxrwx 2 root root 4096 2月 8 21:50 Secondary_CarColor drwxrwxrwx 2 root root 4096 2月 8 21:50 Secondary_CarMake drwxrwxrwx 2 root root 4096 2月 8 21:50 Secondary_VehicleTypes drwxrwxrwx 4 root root 4096 2月 8 21:49 Segmentation |

简单说明一下每个目录所代表的的意义:

- Primary_Detector:作为项目的主检测器,这是用Caffe框架以ResNet10网络所训练的4类检测器,能检测“Car”、“Bicycle”、“Person”、“Roadsign”四种物件,这个数据可以在目录下的labels.txt中找到。

- Primary_Detector_Nano:将Primary_Detector里的模型,针对Jetson Nano(含2GB)的计算资源进行优化的版本。

- Secondary_CarColor:车子颜色的次级检测器

- Secondary_CarMake:生产厂商的次级检测器

- Secondary_VehicleTypes:车子种类的次级检测器

组成结构也十分简单,其中主(Primary)检测器只有一个,而且必须有一个,否则DeepStream无法进行推理识别。次(Secondary)检测器可以有好几个,这里的范例就是针对“Car”这个类别,再添加“Color”、“Maker”、“Type”这三类元素,就能获取视频图像中物件的更完整信息。

在Jetson Nano的/opt/nvidia/deepstream/deepstream/samples/config/deepstream-app下面的source4_1080p_dec_infer-resnet_tracker_sgie_tiled_display_int8.txt,就已经把这个组合检测器的配置调试好,现在直接执行以下指令:

|

cd /opt/nvidia/deepstream/deepstream/samples/config/deepstream-app deepstream-app -c source4_1080p_dec_infer-resnet_tracker_sgie_tiled_display_int8.txt |

现在看到启动四个视频窗,但是每个视窗的执行性能只有8FPS,总性能大约32FPS,并不是太理想。

接下来看看怎么优化这个配置文件,

- 首先要执行模型组合功能功能,必须把“tracker”功能打开,不过可以关闭追踪号的显示,因此保留“enable=1”,将下面的“display-tracking-id=”设为“0”

- 由于我们在Jetson Nano 2GB版本上进行实验,需要进行以下的调整。如果您要在AGX Xavier或Xavier NX上上执行的活,请忽略这个步骤。

修改主检测器[primary-gie]的模型:配置文件中预设的是“Primary_Detector”检测器,这里得修改成专为Nano所训练的版本,这里修改以下几个地方:

-

- model-engine-file路径的“Primary_Detector”部分改成“Primary_Detector_Nano”

- config-file的文件改成config_infer_primary_nano.txt

因为Jetson Nano(含2GB)并不支持int8计算精度,因此还需要做以下修改:

-

- 将“_b4_gpu0_int8.engine”改成“_b8_gpu0_fp16.engine”

- 将所有“xx_gpu0_int8.engine”改成“xx_gpu0_fp16.engine”

- 将追踪器从原本的ibnvds_mot_klt.so改成 libnvds_mot_iou.so,用“#”变更注释的位置就可以。

修改完后重新执行,可以看到每个窗口的检测性能提升到10~12FPS,总性能提升到40~48FPS,比原本提升12~50%,不过距离理想中的25FPS还有很大的差距。

执行过程中如果遇到“There may be a timestamping problem, or this computer is too slow.”这样的信息,就把[sink0]下面的“sync=”设定值改为“0”就可以。

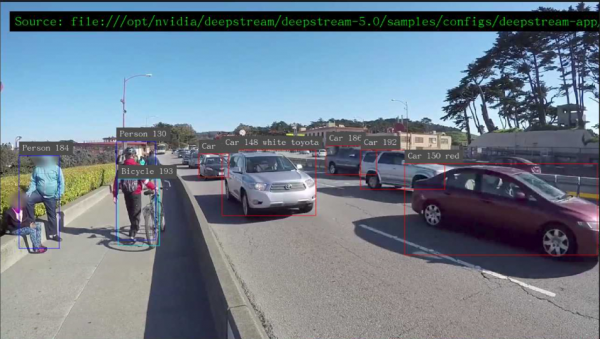

现在看看是否还有什么可调整的空间?参考前一篇文章“DeepStream-04:Jetson Nano摄像头实时性能”所提到的,将[primary-gie]下面的“interval=”设定为“1”,然后再执行应用时,发现每个输入源的识别性能立即提升到20FPS左右(如下图),总性能已经能到80FPS左右,比最初的32FPS提升大约2.5倍,这已经很接近实时识别的性能。

好了,在Jetson Nano 2GB上已经能达到接近实时推理的性能,是相当好的状态。

如果对于显示输出的状态有些不满意的话,我们按照下面的步骤去执行,将“英文”类别名改成“中文”,并且将边框变粗、字体放大,就能更轻松看到推理的效果:

- 所有的显示名称,都在models目录下个别模型目录里的labels.txt,可以将里面的内容全部改成中文。

例如deepstream/samples/models/Secondary_CarMake的“labels.txt”内容改为“广汽;奥迪;宝马;雪佛兰;克莱斯勒;道奇;福特;通用;本田;现代;英菲尼迪;吉普;起亚;雷克萨斯;马自达;奔驰;日产;速霸路;丰田;大众”,其他的就比照办理。

注意:这个顺序不能改变!

- 边框宽度:修改[osd]下面的“board-width”值,推荐2~4比较合适;

- 字体大小:修改[osd]下面的“texe-size”值,推荐15~18比较合适;

- 其他:请自行设定

现在重新执行这个deepstream-app的应用,就能得到本文一开始所显示的效果:

如何?这样的效果与性能就是在Jetson Nano 2GB实现的!【完】

来源:业界供稿

好文章,需要你的鼓励

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

无人机食品配送服务商Flytrex与全球知名披萨连锁品牌Little Caesars宣布合作,推出全新Sky2无人机,最大载重达4公斤,可一次配送两个大披萨及饮料,满足全家用餐需求。Sky2支持最远6.4公里的配送范围,平均从起飞到送达仅需4.5分钟。首个试点门店已在德克萨斯州怀利市上线,并实现与Little Caesars订单系统的直接集成。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

欧洲最大3D打印公寓楼提前数月竣工

法国社会住房项目ViliaSprint?已正式完工,成为欧洲最大的3D打印多户住宅建筑,共12套公寓,建筑面积800平方米。项目由PERI 3D Construction使用COBOD BOD2打印机完成,整体工期较传统建造缩短3个月,实际打印仅用34天(原计划50天),现场操作人员从6人减至3人,建筑废料率从10%降至5%。建筑采用可打印混凝土,集成光伏板及热泵系统,能源自给率约达60%。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里

OpenAI再度重组高管架构,全力押注AI智能体战场

出门在外也能用!OpenAI 将 Codex 接入 ChatGPT 移动端

Google Gemini应用图标迎来细微配色调整

Synetic在2026嵌入式视觉峰会上发布LYNX计算机视觉SDK

生数科技发布世界动作模型Motubrain,为机器人智能带来"无限可能"