JetbotЪЕеНЯЕСа04ЃКCSIЩуЯёЭЗАВзАгыВтЪд

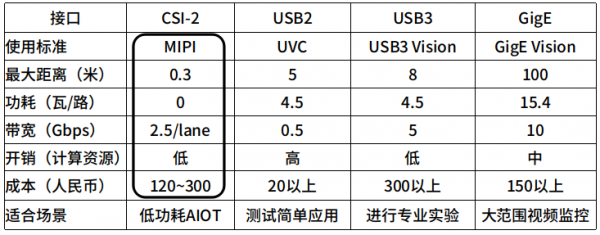

дкзюПЊЪМНщЩмJetbotЕФЪБКђгаЬсЕНЃЌетЬзжЧФмаЁГЕжЛЪЙгУвЛИіCSIЩуЯёЭЗзїЮЊШЋВПЪфШыЕФЩшБИЃЌвђЮЊетжжЩшБИЕФЬхЛ§ЧсЧЩЁЂЙІКФНЯЕЭЃЌВЂЧвNVIDIA JetsonЯЕСагаеыЖдCSIЩуЯёЭЗЬсЙЉвЛзщCamera SubSystemРДЬсИпаЇТЪЃЌЪЧЗЧГЃЪЪКЯгУдкжЧФмГЕЗНАИЩЯЕФЪгЦЕЭМЯёЪфШыгУЭОЃЌЯТБэЪЧИіИїжжЩуЯёЭЗЕФМђЕЅБШНЯБэЃЌетбљОЭФмвЛФПСЫШЛЕиРэНтJetobtЮЊКЮЬєбЁCSIЩуЯёЭЗзїЮЊЪфШыЩшБИЁЃ

ЪзЯШвЊЬсЪОЕФЃЌJetson NanoЃЈКЌ2GBЃЉЫљжЇГжЕФЪЧCSI-2АцБОНгПкЃЌдчЦкгУдкЪїнЎХЩЩЯ50дЊвдЯТЕФCSIНгПкЩуЯёЭЗЪЧВЛФмЪЙгУЕФЃЌжївЊвдIMX219аОЦЌЕФЩуЯёЭЗЮЊжїЃЌМлИёДѓдМдк100дЊвдЩЯЃЌвђДЫЧыЮ№бЁЙКДэЮѓЁЃ

БОЮФВЂВЛЛЈЪБМфШЅЫЕУїCSIЩуЯёЭЗЕФЙЄзїдРэЃЌжївЊХфКЯJetbotЕФАВзАЃЌвдМАжДаазюМђЕЅжИСюШЅШЗШЯФњЪжЩЯЕФЩуЯёЭЗЪЧСМКУПЩгУЕФЃЌЗёдђЕШећЛњЖМзАКУжЎКѓдйНјааВтЪдЃЌШчЙћгіЕНВЛСМЕФЩуЯёЭЗЛЙЕУдйВ№аЖЯТРДЃЌЪЧвЛМўЦФЮЊРЫЗбЪБМфЕФЪТЧщЁЃ

- НЋCSIЩуЯёЭЗзАЕНJetson NanoЃЈКЌ2GBЃЉЩЯ

етжжНгПкВЂВЛжЇГжМДВхМДгУ(PnP, Plug and Play)ЙІФмЃЌВЛФмЯёUSBЩуЯёЭЗПЩвдЫцЪБВхШыJetson NanoЃЈКЌ2GBЃЉЃЌБиаыдкПЊЛњжЎЧАОЭЯШзАКУЁЃШчЙћПЊЛњКѓВтЪдЗЂЯжВЛГЩЙІЃЌОЭЕУЙиЛњКѓдйМьВщЪЧЗёгаЪВУДЕиЗНАВзАВЛе§ШЗЃПЛђепНгДЅВЛСМЕФЮЪЬтЃЌОЭБуРћадЖјбдЪЧВЛШчUSBЩуЯёЭЗФЧУДЫГЪжЁЃ

АВзАCSIЩуЯёЭЗЕФжжНгПкШчЯТЭМзѓЗНЕФПЈзљЃЌвЊАЮШЁПЈЫёНјааАВзАЪБЧЇЭђаЁаФСІЖШЃЌетИіЫмСЯМўБШНЯДрШѕЃЌвЛВЛаЁаФХЊЖЯСЫЃЌВЛНіЮоЗЈдйАВзАCSIЩуЯёЭЗЃЌвВбЯжигАЯьJetson NanoЃЈКЌ2GBЃЉЕФжЪБЃЃЌашвЊЗЧГЃаЁаФДІРэЃЁ

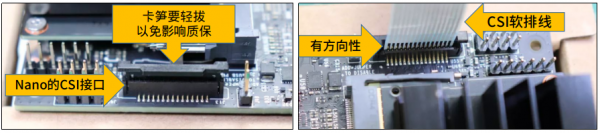

ПЈзљЩЯЭИЙ§вЛИљзЈЪєЕФШэХХЯпЃЈШчЯТЭМгвЃЉгыCSIЩуЯёЭЗНјааСЌНгЃЌетИіШэХХЯпЪЧгаЗНЯђадЕФЃЌШчЩЯЭМгвЫљЯдЪОЃЌШэХХЯпгаН№ЪєеыНХЕФвЛУцвЊГЏФкЃЈКЫаФФЃПщЃЉЗНЯђЃЌНЋХХЯпЭъећШћНјПЈзљжЎКѓЃЌдйНЋПЈЫёЭљЯТбЙЃЌШЗБЃЭъШЋбЙЕЙЕзЃЌЗёдђЩуЯёЭЗПЩФмвђЮЊХХЯпНгДЅВЛСМЖјЮоЗЈе§ГЃЙЄзїЁЃ

ЧыВЮПМhttps://cloud.tencent.com/developer/article/1421907 “ВЫФёЪжВс(2):ИјJetson NanoАВзАCSIЩуЯёЭЗ”вЛЮФЃЌгаЗЧГЃЯъОЁЕФВНжшгыЖЏЬЌМђЭМФмЭъећБэДяЙ§ГЬЁЃзмЖјбджЎЃЌетИіЩуЯёЭЗЕФАВзАгааЉЯИЮЂжЎДІЃЌашвЊЯИаФДІРэЁЃвЛЕЉАВзАВтЪдКУжЎКѓЃЌвВОЁСПВЛвЊВ№аЖЁЃ

- ВтЪдCSIЩуЯёЭЗЕФдЫаа

гЩгкJetbotЛсЙиБеUbuntuЭМаЮзРУцЃЌвђДЫЙ§ШЅЫљбЇЕНЕїгУnvarguscameraжИСюЃЌШЅЦєЖЏCSIЩуЯёЭЗВЂдкЭМаЮзРУцЩЯЯдЪОЕФЗНЗЈЃЌдкетРяЖМВЛФмЪЪгУЃЌЕЋЪЧv4l2-ctlЙЄОпЛЙЪЧФмзізюЛљБОЕФМьВтЁЃ

ЯТУцЕФВтЪдЖМдкJetbotЩЯЕФJupyterЛЗОГЩЯНјааЃЌвВЫГБуНВНтвЛЯТJupyterЩЯЕїгУЩуЯёЭЗгыЯдЪОФкШнЕФЗНЗЈЃЌЯШЪьЯЄвЛЯТетЗНУцЕФЪЙгУЪЧКмживЊЃЌвђЮЊКѓУцЫљгаЪЕбщЖМвЊгУЕНCSIЩуЯёЭЗЁЃ

ЯждкДгPCЩЯЕФфЏРРЦїЪфШы ”<IP_OF_JETBOT>:8888” НјШыJetbotЕФJupyterВйзїНчУцЃЌШЛКѓПЊЦєвЛИіУќСюжеЖЫЃЈШчЯТЭМЃЉЃК

ЯждкЯШгУv4l2-ctlЙЄОпМьВщвЛЯТCSIЩуЯёЭЗЕФзДПіЃЌЧыдкжеЖЫЪфШывдЯТжИСюЃК

|

$

$

$ |

# ШчЙћЪЧDockerАцЃЌЧыЯШАВзАv4l-utilsЙЄОп apt install v4l-utils # жДааМьВтжИСю v4l2-ctl --list-devices # ШчЙћМьВтЕН /dev/video0ЃЌМЬајМьВтетИіЩшБИЕФЯИВПВЮЪ§ v4l2-ctl --device=/dev/video0 --all |

ЯИВПВЮЪ§ОЭВЛЛЈЪБМфЫЕУїЃЌжївЊШУДѓМвжЊЕРЕБгаашвЊЕФЪБКђЃЌОЭПЩвдгУv4l2-ctlетИіЙЄОпВщПДЯИНкЁЃ

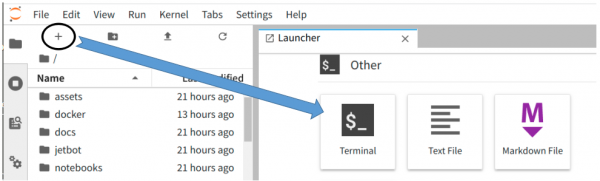

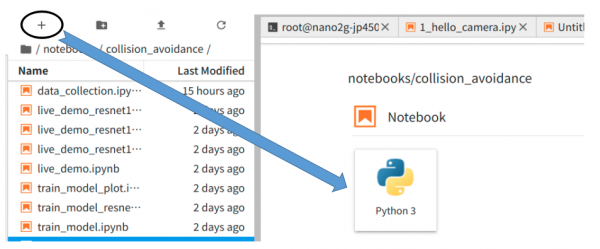

НгЯТШЅПЊЪМгУJupyterЕФДњТыЃЌРДВтЪдCSIЩуЯёЭЗЕФЙЄзїзДПіЁЃЪзЯШДДНЈвЛИіаТЕФ”Notebook”ЃЈШчЯТЭМВНжшЃЉЃЌетЪЧJupyterЕФЙЄзїЧјгђЁЃ

УПДЮаТПЊЕФNotebookЖМЪЧШчЯТЭМЕФзДПіЃЌЛсгавЛИі[ ] гывЛИіЗНПђЃК

ЯждкОЭНЋЯТУцДњТыИДжЦЕНдкNotebookЕФЗНПђФкРяЃЌгЩгкЧАУц“v4l2-ctl”МьВтЕНетИіЩуЯёЭЗЕФПэИпЮЊ(1640, 1232)ЃЌвђДЫдкДњТыжаНЋЩуЯёЭЗгыwidgetsЕФЭМаЮГпДчЖМЩшЮЊетСНИіЪ§зжЃК

|

|

from jetbot import Camera, bgr8_to_jpeg import ipywidgets.widgets as widgets from IPython.display import display import traitlets

camera = Camera.instance(width=1640, height=1232)

image = widgets.Image(format='jpeg', width=1640, height=1232) camera_link = traitlets.dlink((camera, 'value'), (image, 'value'), transform=bgr8_to_jpeg)

display(image) |

ШЛКѓАДвЛЯТ“Ctrl-Enter”зщКЯМќОЭФмжДааЃЌе§ГЃЕФЛАОЭФмдкЯТЗНПДЕНвЛИіЗНПђЯдЪОЩуЯёЭЗЫљВЖзНЕФЖЏЬЌЛУцЃЌетбљОЭЭъГЩCSIЩуЯёЭЗЕФВтЪдЁЃМйШчЗЙОжетИіЯдЪОКУЯёгаЕуаЁбгГйЃЌетЪЧе§ГЃЕФЃЌБЯОЙетРябЁдёЕФЪЧ(1640, 1232)ГпДчЃЌЪдЪдНЋГпДчЖМЫѕаЁЕН1/2жЎКѓЃЌЪЧВЛЪЧОЭСїГЉЕФЖрЃП

ШчЙћвЊЭЃжЙЩуЯёЭЗВЅЗХЃЌОЭгУЩЯУцЕФ“+”КХЬэМгвЛИі“жИСюИё”ЃЌШЛКѓдкРяУцЪфШы

|

|

camera_link.unlink() |

ШЛКѓгУ“Ctrl-Enter”жДааетИіжИСюЃЌетЪБКђЯдЪОЛУцОЭДІгкЖГНсзДЬЌЃЌВЛЛсВЅЗХЯдЪОЦїЫљВЖзНЕФФкШнЁЃ

МйШчЯывЊШУЩуЯёЭЗдйДЮжДааВЅЗХЃЌОЭдкЯТУцдйЬэМгвЛИі“жИСюИё”ЃЌЪфШы

|

|

camera_link.link() |

АДЯТ“Ctrl-Enter”жДааЃЌОЭЛсПДЕНЯдЪОПђРяЕФФкШнгжПЊЪМжДааЖЏЬЌВЅЗХСЫЁЃ

- ДњТыНтЫЕ

гЩгкJupyterВЂВЛжЇГжOpenGLЙІФмЃЌЮоЗЈЯёЭМаЮзРУцФЧбљжБНгВЅЗХЪгЦЕЃЌвђДЫдкетРяашвЊЪЙгУвЛаЉЙЬЖЈЕФММЧЩЃЌНЋЪгЦЕзЊГЩЭМаЮЗНЪНШЅЯдЪОЃЌЩЯУцетЖЮДњТыПЩвдЫЕЪЧJetbotЫљгаЪЕбщЦєЖЏCSIЩуЯёЭЗЕФБъзМФкШнЁЃ

етИіДњТыжагаМИИіЙиМќЕФВПЗжЃК

- jetbotЕФCameraФЃПщЃК

дчЦкJetbotЕФЩуЯёЭЗЪЧЛљгкNVIDIAЕФJetCamЯюФПЃЌЬсЙЉЖдCSIгыUSBСНРрЩуЯёЭЗЕФжЇГжЃЌВЛЙ§зюаТАцБОжаЗТЗ№жЛЖдCSIЩуЯёЭЗЬсЙЉжЇГжЃЌВЂЧвНЋЕзВуЕФДњТыЗХдкjetbot/cameraЯТУцЕФМИжЛ.pyРяУцЁЃ

етЪЙЕУЕїгУЗНЪНБфЕУЗЧГЃМђЕЅЃЌжЛвЊНЋПэгыИпЬсЙЉИјCamera.instance(Пэ,Ип)ОЭПЩвдЃЌВЛашвЊдйжИЖЈЩуЯёЭЗЕФБрКХЁЃ

- ipywidgetsЃК

етИіФЃПщЮЊjupyterЬсЙЉЗЧГЃКУгУЕФ“ЛЅЖЏЪНаЁВПМў”ЃЌЮЊдБОжЛЬсЙЉОВЬЌЯдЪОЕФНЬбЇЛЗОГЃЌзЂШыЗЧГЃЩњЖЏгыЖрбљЛЏЛЅЖЏЕФЙІФмЁЃ

ЪьЯЄЭМаЮЛЏПЊЗЂЙЄОпЕФХѓгбОЭгІИУжЊЕРЃЌКмЖретРрЙЄОпЛсЬсЙЉЯТРЪНбЁЯюЁЂЛЌПще{ећЁЂИДбЁПђЁЂЮФзжПђетРрЕФаЁВПМўЃЌПЩвдзщНЈНЯЮЊИДдгЕФвЧБэХЬЁЃ

дкКѓУцПижЦJetbotГЕТжЕФЪЕбщжаЛсЪЙгУЕНЖржжетРраЁВПМўЃЌетРяжЛЪЧгУЕНБШНЯМђЕЅЕФwidgets.imageЙІФмЃЌЩшЖЈЪфГіЮЊ ”jpeg”ИёЪНЭМЯёЁЃ

- iPython.displayЃК

етЪЧвЛИіpythonЛЅЖЏЪННчУцРяЕФЯдЪОЙІФмЃЌетРяОЭЪЧНЋwidget.imageЪфГіЕФjpegЭМЯёЯдЪОдкJupyterЁЃ

- traitletsЃК

ШчЙћДгећИігЂЮФзжШЅЗвыЃЌетИіПтОЭБЛГЦЮЊ“ХбЭНПт”ЃЌЦфЪЕЪЧТљЦцЙжЕФЖЋЮїЁЃЕЋШчЙћНЋетИізжЧаИюГЩ ”trait”гы”-let”зщКЯЃЌОЭФмНтЪЭГЩ“аЁЬиеї”ЕФКЌвхЃЌР§ШчbookletЪЧаЁВсзгЁЂeagletЪЧаЁРЯгЅЕФвтЫМЁЃ

етИіПтЕФЙІФмЗЧГЃЧПДѓЃЌГ§СЫФмЮЊЮвУЧДІРэ“РраЭМьВщ”жЎЭтЃЌЛЙФмЮЊЖЏЬЌМЦЫуЬсЙЉдЄЩшжЕЁЂаоИФЪєаджЎКѓЗЂГіИќИФЕФЪТМўаХКХЁЂДІРэЪєаджЕжЎМфЕФНЛЛЅгАЯьЃЌЮЊЮвУЧМђЛЏКмЖрИДдгЕФНЛДэЙиЯЕЁЃ

дкЩЯЪіДњТыжа”camera_link=traitlets.dlink((camera, 'value'), (image, 'value'), transform=bgr8_to_jpeg)”ЃЌНЋЩуЯёЭЗЖСШЁЕФЭМЯёгыwidgets.imageЫљДДНЈЕФimageЖдЯѓВњЩњЖЏЬЌЙиСЊЃЌВЂНЋЩуЯёЭЗЭМаЮжДаа“bgr8_to_jpeg”зЊЛЛЃЌДцЗХЕНimageРяЃЌзюКѓдйгЩdisplay(image)ЯдЪОГіРДЁЃ

жСгкcamera_linkЮяМўОЭФмдкКѓУцЭИЙ§.link()гы.unlink()жДааПЊЙиШЫШЮЮёЃЌвдЪЕЯж“днЭЃ”гы“дйЦєЖЏ”ЕФЙІФмЁЃ

етбљЮвУЧЖдJetbotЩуЯёЭЗЕФЕїгУгыЪЙгУЃЌОЭгаИіГѕВНЕФСЫНтЃЌдкКѓУцЪЕбщжаОЭФмИќЧхГўЕФИаЪмЕНетаЉЙІФмЕФЪЙгУЁЃ[Эъ]

РДдДЃКвЕНчЙЉИх

КУЮФеТЃЌашвЊФуЕФЙФРј

LinuxЛљН№ЛсГЩСЂжЧФмЬхAIЛљН№ЛсЭГвЛЙмРэаавЕБъзМ

LinuxЛљН№ЛсаћВМГЩСЂДњРэAIЛљН№ЛсЃЌЮЊAIжЧФмЬхЛљДЁЩшЪЉПЊЗЂЬсЙЉГЇЩЬжаСЂЕФМрЖНЁЃОЁЙмвЕНчГаШЯAIжЧФмЬхДцдкАВШЋЮЪЬтЃЌИпЕТФЩзЩбЏЙЋЫООЏИцаэЖрЦѓвЕЯюФППЩФмвђШБЗІЩЬвЕМлжЕЖјБЛШЁЯћЃЌЕЋЛљН№ЛсШджТСІгкЮЊAIЙЋЫОЬсЙЉжаСЂЦНЬЈЁЃAnthropicЁЂBlockКЭOpenAIЗжБ№ЙБЯзСЫШ§ИіЯюФПЃЌАќРЈФЃаЭЩЯЯТЮФавщЁЂПЊдДAIжЧФмЬхПђМмКЭЛњЦїПЩЖСЮФЕЕБъзМЁЃ

ПьЪжПЦММЬсГіаТЗНЗЈЃКШУAIбЕСЗВЛдйЁАЗГЕЁАЕФжЧЛлдМЪјЛњжЦ

ПьЪжПЦММбаОПЭХЖгЬсГіСЫьиБШНиЖЯЛњжЦЃЌгУгкНтОіЧПЛЏбЇЯАбЕСЗжаAIШнвз"зпЦЋ"ЕФЮЪЬтЁЃИУЗНЗЈЭЈЙ§МрПиAIбЇЯАЧАКѓЫМЮЌЛюдОЖШБфЛЏЃЌдкЙиМќЪБПЬНјааОЋзМИЩдЄЃЌМШБЃжЄбЕСЗЮШЖЈадгжЮЌГжЬНЫїФмСІЁЃдкЪ§бЇЭЦРэШЮЮёжаЃЌДЫЗНЗЈЯджјЬсЩ§СЫФЃаЭадФмВЂИФЩЦСЫбЕСЗЮШЖЈадЃЌЮЊAIбЕСЗСьгђЬсЙЉСЫаТЕФНтОіЫМТЗЁЃ

ЮЂШэаћВМЮДРДЫФФъНЋдкгЁЖШЭЖзЪ175вкУРдЊРЉДѓAIвЕЮё

ЮЂШэМЦЛЎдкЮДРДЫФФъФкЯђгЁЖШЭЖзЪ175вкУРдЊЃЌетЪЧИУЙЋЫОдкбЧжоЕФзюДѓЭЖзЪЁЃЭЖзЪНЋгУгкНЈЩшаТЪ§ОнжааФЁЂAIЛљДЁЩшЪЉКЭММФмХрбЕЯюФПЁЃДЫОйе§жЕШЋЧђПЦММОоЭЗМгЫйдкгЁЖШВМОжЃЌИУЙњХгДѓЕФЛЅСЊЭјКЭжЧФмЪжЛњгУЛЇШКЬхЪЙЦфГЩЮЊЙиМќеНГЁЁЃЭЖзЪЛЙАќРЈдкКЃЕТРАЭНЈЩшаТЪ§ОнжааФЧјгђЃЌВЂгыгЁЖШеўИЎКЯзїНЋAIФмСІећКЯЕНЙЋЙВЪ§зжЦНЬЈжаЁЃ

EditThinkerЃКЕБAIБрМЭМЦЌвВбЇЛсЁАШ§ЫМЖјКѓааЁА - ББКНгыУРЭХСЊКЯбаОПШУЭМЯёБрМНјШыЁАЩюЖШЫМПМЁАЪБДњ

EditThinkerЪЧББОЉКНПеКНЬьДѓбЇгыУРЭХЕШЛњЙЙСЊКЯбаЗЂЕФЭМЯёБрМAIПђМмЃЌШУAIдкБрМЭМЦЌЪБФмЙЛЯёШЫРрвЛбљНјааЗДИДЫМПМКЭгХЛЏЁЃИУЯЕЭГЭЈЙ§"ХњЦР-гХЛЏ-жиЪд"ЕФбЛЗЛњжЦЃЌНЋДЋЭГЕФвЛДЮадБрМзЊБфЮЊЕќДњИФНјЙ§ГЬЃЌдкЫФИіШЈЭўВтЪдЦНЬЈЩЯЯджјЬсЩ§СЫЯжгаБрМФЃаЭЕФБэЯжЃЌЬиБ№ЪЧдкашвЊИДдгЭЦРэЕФБрМШЮЮёжааЇЙћЭЛГіЁЃ

LinuxЛљН№ЛсГЩСЂжЧФмЬхAIЛљН№ЛсЭГвЛЙмРэаавЕБъзМ

ЮЂШэаћВМЮДРДЫФФъНЋдкгЁЖШЭЖзЪ175вкУРдЊРЉДѓAIвЕЮё

Window Maker Live 13.2ЛљгкDebian 13ЮЊ32ЮЛPCДјРДаТЩњ

CoderЭЦГіЛьКЯШЫдБгыжЧФмЬхПЊЗЂЭХЖгжЮРэММЪѕеЛ

баОПШЫдБЗЂЯжащФтЛњЙмРэГЬађРеЫїШэМўЙЅЛїМЄді700%

AIММЪѕПьЫйЕќДњЦШЪЙЦѓвЕУП90ЬьжиЙЙММЪѕеЛ

ХЕЛљбЧгыАЂРЪЦѓвЕКЯзїЭЦГіЖЫЕНЖЫдАЧјЭјТчЗўЮё

МзЙЧЮФКьХЃГЕЖгЃКгУдЦМЦЫуЁЂAIКЭЪ§ОнЧ§ЖЏF1ЮДРД

аТдЦМЦЫуНЋЬєеНДЋЭГдЦОоЭЗAIЛљДЁЩшЪЉжїЕМЕиЮЛ

AnthropicгыАЃЩемДяГЩДѓЙцФЃAIКЯзїавщ

ДгвЛЬѕДјгуЕНвЛБДЬРцжЃЌЦДЖрЖрШчКЮгУЁАЧЇвкЗіГжЁБИФаДЙЉИјЙЪЪТЃП

ДђЭЈЁАзюКѓвЛЙЋРяЁБЕФГжДИШЫЃКвЛМвРЯХЦЗжЯњЩЬЕФAIЭЛЮЇгыГіКЃвАЭћ

JetsonАйЭђПЊЗЂепЙЪЪТ | ЮЊСЫКЂзгЕФНЁПЕГЩГЄЃЌЫћгУNVIDIA JetsonзіСЫвЛИіЯѓЦхЛњЦїШЫ

JetsonАйЭђПЊЗЂепЙЪЪТ | ЭЈЙ§Jetson NANOеЙЯжCVЪЕМљМлжЕ

JetsonПЊЗЂепЦЦАйЭђЃЌПьРДЫЕГіФуЕФПЊЗЂЙЪЪТАЩ

е§ЕБЪБ NVIDIA Jetson NanoШУжЧФмЛњЦїШЫПЊЗЂвзШчЗДеЦ

OrinПЊЗЂЬзМў04-АВзАDeepStream

Jetson OrinПЊЗЂЬзМў03-АВзАПЊЗЂЛЗОГ

TAOЯЕСа12-НЋФЃаЭВПЪ№ЕНJetsonЩшБИ

TAOЯЕСа06-ЪгОѕРрЕФЪ§ОнИёЪН

GTC22 | JetsonПЊЗЂепШеРДСЫ ПьРДЕуЛїдЄдМ

JetbotЯЕСа13-ЭМЯёЛиЙщЗЈЪЕЯжбТЗЙІФм