LinuxONE会让你有哪些心情变化? 原创

2020年,

业务线上化提速,非接触远程服务需求激增,

金融机构数字化转型提速。

不过,转型并不容易:

互联网应用(IT架构如何支撑分布式应用?)

金融机构基于互联网渠道服务客户成为主流,

后端IT基础设施需要转型升级。

但是传统IT架构无法适配分布式应用,

业务的拆分很复杂(业务功能、服务解耦、应用改造)。

推倒重来,还是循序渐进?

对策:当分布式数据库遇上LinuxONE,分布式数据库对更强一致性的追求,能够轻松得到提升。LinuxONE和分布式数据库的组合,就是一对黄金搭档。

LinuxONE在硬件层面,提供了非常强大的底层支撑平台,从而在“相同的简单易用”基础之上,可以带给客户“与众不同的能力和体验”。

稳态IT架构(如何确保核心业务稳定运行?)

不管技术如何变化,

IT基础设施的安全性、可持续性、稳定性依然还是重中之重。

金融核心关键业务,安全稳定是第一要求,7×24不宕机。

承载核心数据的硬件平台,要有极致的可靠性与隔离性。

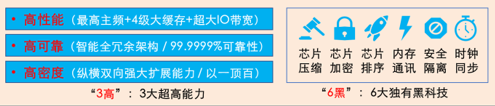

对策:LinuxONE具有“高性能、高可靠和高密度”3种超高能力以及6种黑科技确保核心业务稳定运行。

3高:

在高性能方面,LinuxONE是所有商用服务器里性能最高的,它配置了5.2GHz主频的处理器,以及总量超过11GB的4级CPU大缓存,再加上高达192个的IO插槽,从而为客户提供最强大的计算能力和IO处理的能力。

在高可靠方面,LinuxONE提供了N+1的全冗余体系架构,这里面涵盖了CPU、内存、IO、电源、风扇、控制台等,从而使得LinuxONE单机就可达到6个9的可靠性。

在高密度方面,LinuxONE除了具备强大的纵向扩展能力外,横向扩展能力也是很强的,LinuxONE单机可支持85个逻辑分区、支持8000多个虚机,以及2百多万个容器,对X86而言,可以用“以一顶百”的方式,来实现高密度的集约化部署。

6黑:

LinuxONE所配备的6种黑科技,比如LinuxONE的芯片压缩功能,支持高达260GB/s的超大规模吞吐能力,可以帮助用户节省大量存储空间、节省网络带宽、缩短数据传输时间等。LinuxONE的内存通讯技术,可以帮助联机交易端到端的响应时间减少30%,同时TPS提升超过50%!

在时钟同步方面,LinuxONE可以确保在同一设备内,所有分区和虚机、以及跨多台设备集群的精准同步,可以达到微秒级。这对于分布式数据库来说,有很大的价值,因为分布式数据库对于节点间的时间同步,往往有着非常苛刻的要求。

开源开放(如何引入开源软件实现降本增效?)

虽说购买商业软件让金融机构吃了定心丸,但是每年价格不菲的服务费,当出现问题还得救助外包人员。

而采用开源技术,丰富的生态加上低成本,实现企业级的可靠性和性能,还有IT系统的敏捷高效、精细化管理、可扩展以及可管可控。

对策:LinuxONE本质上是一台开放Linux服务器, 在软件层因为采用基于开放开源的技术堆栈,在使用体验上可以做到同样的简单易用,包括应用的开发、交付、混合多云的管理,以及服务治理管控等等。

另外,客户在Linux方面的已积累的技术力量,同样可以在LinuxONE上得到充分的复用,并不会带来额外的技能要求。

其实LinuxONE的玩法还有很多,而且很多金融机构已经尝试了。

IBM现代化架构结合混合云,为客户创造新的基础架构价值

5大关键优势,实现“云中核心,稳敏合一的混合云平台”

想要了解更多LinuxONE的信息和最佳实践,请点击链接一探究竟!

http://www.zhiding.cn/special/IBM_2021_IT_infrastructure

咨询IBM专家:400 6692 039

来源:至顶网计算频道

好文章,需要你的鼓励

谷歌推出AI购物智能体,帮你“一站式“购物体验升级

谷歌在I/O开发者大会上发布"通用购物车"功能,基于通用商务协议(UCP)整合YouTube、Gmail、Gemini等平台的购物数据,支持Target、Shopify、Wayfair等主流零售商。AI代理可自动检测商品兼容性、推荐优惠信用卡、比价提醒,并在用户授权下自动完成日常采购。该功能旨在打通"加入购物车"到"完成结账"的全流程,实现个性化、无摩擦的购物体验。

浙大、港科大等联合机构告诉你:AI学“看“3D场景,到底该怎样聪明地“选角度“?

这项联合研究提出了COVER方法和CM-EVS数据集,用贪心算法从3D场景中智能筛选全景视角,每场景仅需25帧即可完整覆盖室内场景,并附完整溯源日志。

伦敦大学学院等多机构联合揭示:AI“调音旋钮“让大模型推理训练不再崩溃

HolderPO通过引入可调参数p的霍尔德均值替代固定的算术平均,解决了大模型推理训练中信号放大与稳定性之间的根本矛盾,配合动态退火策略在数学推理和代理任务上均创造了新的最优记录。

Apple Music发布公开信:致力于在AI时代维护音乐公平生态

NHS十年计划的成功关键:数字健康必须达到临床标准

xAI与Anthropic计算资源合作协议,揭示AI算力独立商业化新趋势

利用Ubicept Photon Fusion提升CMOS夜间成像性能

Humanoid与制造业巨头博世达成战略合作,推进人形机器人量产

企业网络基础设施是否已为AI工作负载做好准备?

AI遭Z世代抵制:CIO面临的人才培养危机

Flytrex在达拉斯开设无人机制造工厂,加速扩张外卖配送网络

Brain Corp与加州大学圣地亚哥分校合作推进物理AI基础智能层研究

哈丁视角:工厂竞争的现实法则——执行力才是制胜关键

Doozy Robotics宣布全球扩张,以AI人形机器人构建工厂自动化劳动力

华为AI DC全栈方案发布:以数据觉醒,驱动产业智能跃迁

IBM为小型企业推出13.5万美元袖珍LinuxONE设备

携手IBM LinuxONE,共创企业级AI的绿色技术底座

IBM凭借LinuxONE Rockhopper打造最强云原生用例

IBM将z16与LinuxONE系统缩小为标准机架配置

打造可持续发展的基础设施 IBM新一代LinuxONE服务器黑科技展现“硬核”实力

为何IBM LinuxONE如此重要?

IBM发布下一代LinuxONE服务器 帮助企业减少能耗 实现可持续性目标

IBM推出新一代节能型LinuxONE服务器

实战丨基础架构云化四大新趋势,LinuxONE黑科技帮企业做减法

IBM发布 IBM LinuxONE III Express,开创硬件灵活计价模式