提速!浪潮网络“产品-方案-服务“能力全线升级

AI+的发展,正在重塑我们对未来的想象。算力联接作为AI+应用的基础设施,所面临的传输任务日益复杂,这对云中心及边缘联接能力也提出了更高要求。在浪潮网络2024新品发布暨合作伙伴大会上,浪潮网络重磅发布了从产品、到方案、到服务的全线升级成果,旨在以不断强化的云中心网络、边缘网络、及融合方案能力,推动AI技术与网络联接的融合创新,为AI+应用打造高效智能的动力引擎。

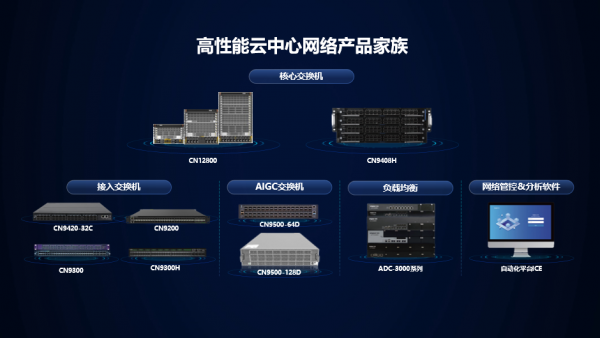

- 高性能云中心网络:针对智算中心对于网络提出的大规模、高带宽、零丢包、自动化等需求,浪潮网络发布了由智能云引擎ICE和单芯片交换机构成的——数据中心网络即交换机方案(DCN as a Switch),具备按需扩展、高可靠、低能耗、低延时、简单易用等特性,并配套推出了单芯片交换机CN9500、CN9420-32C等新品。

同时,深度聚焦大模型训练与推理场景需求,浪潮网络发布了“元脉™全栈AI网络方案”。该方案由智算网络自动化平台、AI计算网、存储网、管理网四部分组成,而32/64/128口400G高性能云中心交换机CN9408H 、CN9500-64D、CN9500-128D、以及自动化管控分析平台ICE等新品也在发布之列。其中,自动化管控分析平台ICE,能够降低AI集群部署时间近50%,同时基于无损以太网技术可节约网络成本25%。

此外,浪潮网络还发布了新一代正交CLOS架构交换机——CN12800系列,采用可编程芯片方案,满足AI+应用场景下的多元化需求。并集成绿色节能技术,可降低板卡功耗50%,进一步丰富了浪潮网络云中心产品技术能力。

- 多模态边缘网络:海量智能终端的发展,推动边端侧的网络形态由“单模态”向“多模态”延申。浪潮网络全方位升级多模态边缘联接能力,在会上发布了S9800系列交换机、多模态边缘网络控制平台DNE、无线、以及接入交换机等多款边缘网络新品,为构建更加灵活、高效的边缘网络环境提供支持。并推出了创新的“多模态安全无损漫游”方案,采用了“预漫游+双链路”的策略,可以有效克服漫游过程中的数据丢失问题,确保设备持续在线。

- 融合方案:凭借深厚的技术积累、持续的研发投入、及不断增加的伙伴生态,浪潮网络已成为涵盖“云-网-边-端”一体化解决方案能力的供应商。在基础设施架构融合上,通过整合计算、存储、网络、云等产品服务,可以为客户打造高效、灵活的IT基础设施;在ISV方案融合方面,通过与ISV伙伴的优势互补,可以提供定制化的行业解决方案,推动行业用户数字化、智能化转型。

- 服务支持:为了提供让客户满意的高品质服务,浪潮网络一直将“服务生态”作为发展重点,并坚持以客户为中心,秉承开放、融合、共享、创新的态度,与合作伙伴共享服务资源、共拓服务领域、共创发展良机。以持续的融合创新,为客户提供敏捷、高效的服务体验。此外,浪潮网络还将大力开展服务赋能工作,建设以提高服务技能和职业素质为核心的培训体系,为合作伙伴培养实干型网络专业人才。

来源:业界供稿

好文章,需要你的鼓励

Glean年收入突破3亿美元,削减AI成本成核心卖点

企业AI搜索公司Glean宣布年度经常性收入(ARR)达3亿美元,较15个月前的1亿美元增长三倍。尽管谷歌、微软、OpenAI等科技巨头纷纷入局企业AI搜索市场,Glean凭借"上下文图谱"技术深度理解企业业务需求,并帮助客户显著降低AI计算成本。该公司提供按用量计费和混合定价两种模式,客户涵盖Databricks、Reddit、Pinterest及三星等企业。Glean上轮融资后估值达72亿美元。

香港中文大学与MiniMax联手破解AI图像描述的“说多错多、说少漏多“困局

香港中文大学与MiniMax提出ClaimDiff-RL框架,将图像描述的AI训练从整体打分升级为逐条核查,有效解决了传统方式导致AI"少说保平安"的问题,同时在多项基准测试上超越Gemini-3-Pro-Preview。

蓝色起源“新格伦“火箭在佛罗里达测试中发生爆炸

杰夫·贝索斯旗下的蓝色起源公司在佛罗里达卡纳维拉尔角进行静态点火测试时,新格伦重型火箭发生爆炸。这是美国历史上最大规模的火箭爆炸之一,也是蓝色起源公司遭遇的最严重失败。所有人员安全,但该事故可能导致新格伦火箭项目长期暂停。此前该火箭已成功完成三次发射,并实现了助推器回收和重复使用。

NTU、HKU等多所顶校联手,让AI同时“多角度看片“——视频理解的并行探针革命

ParaVT是一个由南洋理工等多校联合提出的并行视频工具调用框架,通过让AI同时分析多段视频并引入PARA-GRPO算法解决训练中的格式崩溃与工具跳过问题,在六项长视频理解测试中平均提升约7.9%。

Glean年收入突破3亿美元,削减AI成本成核心卖点

蓝色起源"新格伦"火箭在佛罗里达测试中发生爆炸

智能体AI正在重塑企业架构与Token经济学

堪培拉理工学院如何借助技术革新重塑课堂教学体验

Gemma 4携手Arm:优化端侧AI,加速移动应用体验

制药公司与初创企业如何携手推动AI落地

《星球大战》导演盛赞生成式AI:电影制作的革命性工具

Salesforce借助Informatica布局企业级无头数据管理架构

几乎所有M5 MacBook Air配置现在都降价近200美元

大模型评测风向变了,Testin云测如何构建企业级AI质量标尺?

因民事养老金管理失误,英国政府拒绝向Capita授予5.63亿英镑合同

YouTube提升AI生成视频标签的显示效果