Triton推理服务器06-安装用户端软件

在前面的文章中,已经带着读者创建好Triton的模型仓、安装并执行Triton推理服务器软件,接下来就是要安装Triton用户端软件,对服务器提出推理请求(requests),才能触发服务器执行推理计算的任务。

由于用户端的功能是在向服务器提出推理需求,本身并不参与计算,因此不用考虑设备性能或者是否装载GPU设备,即便是一台最基本的Windows上网本都能使用,只要安装合适的用户端软件就可以。

为了适应更多种使用场景,Triton用户端支持C++/Python/Java/GO等通用性高的在编程语言,底层还支持HTTP/REST与gRPC通讯协议,甚至还支持SSL/TLS加密选项,以及多种在线压缩(on-wire compression)算法,内容是相当丰富并且多元化,完整的内容可以在https://github.com/triton-inference-server/client开源仓里找到,本文只先提供Python用户端的部分。

与服务器的安装方式类似,NVIDIA提供以下4种安装方式:

- 源代码编译:

这种方式需要从https://github.com/triton-inference-server/client下载源代码,执行步骤在https://github.com/triton-inference-server/client#build-using-cmake环节,通常会遇到的麻烦是步骤繁琐,并且出错率较高,因此并不推荐使用这个方法。

- 可执行文件:

Triton开发团队为使用者提供编译好的可执行文件,包括Ubuntu 20.04、Jetpack余Windows平台,可以在https://github.com/triton-inference-server/server/releases/ 上获取,每个版本都会提供对应NGC容器的版本,如下图:

然后到下面的“Assets”选择合适的版本:

以装载Jetpack 5的Orin为例,就下载tritonserver2.26.0-jetpack5.0.2.tgz(1.13GB) 压缩文件到本机上,然后解压缩到指定目录下就可以,例如${HOME}/triton目录,会生成<backends>、<bin>、<clients>、<include>、<lib>、<qa>等6个目录,用户端的可执行文件在<clients/bin>目录下,目前有将近30个终端功能。

现在要使用image_client这个最基础的识别终端软件,对qa/images/mug.jpg(如下图)这张图片进行推理。

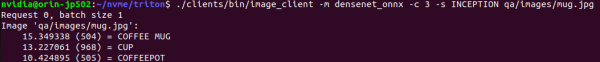

请先确认Triton服务器软件已经启动并且处于等待请求的状态,现在请开启另一个命令终端,输入以下指令提交推理请求:

|

$ $ |

cd ${HOME}/triton ./clients/bin/image_client -m densenet_onnx -c 3 -s INCEPTION qa/images/mug.jpg |

这道指令使用clients/bin/image_client终端,请求服务器使用densenet_onnx推理模型,对qa/images/mug.jpg(图下图)进行识别。这里的参数“-c 3”是要求识别的分类最多可以到3项,指令执行结果如下,表示正确识别图像的3个可能分类:

其他终端软件会在后面文章中说明。

- Docker容器版用户端:

在安装Triton服务器软件一文中已经提过,可以在NGC服务器上可以找到Triton的相关镜像,其中year-xy-py3-sdk里就有提供用户端软件。这里同样在Jetson AGX Orin上用22.09-py3-sdk镜像做示范,请先执行以下指令下载这个镜像并进入这个容器:

|

$ $ |

docker pull nvcr.io/nvidia/tritonserver:22.09-py3-sdk docker run -it --rm --net=host nvcr.io/nvidia/tritonserver:22.09-py3-sdk |

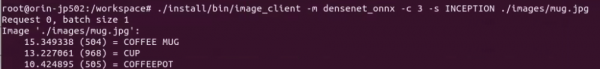

进入容器之后,执行以下指令进行图像推理任务:

|

$ |

./install/bin/image_client -m densenet_onnx -c 3 -s INCEPTION ./images/mug.jpg |

执行结果应该会看到如下截屏的内容,表示在这里对Triton服务器提出的推理请求,得到正确的计算结果。

同样的,在容器内install/bin目录下也有将近30个编译好的终端可执行文件,内容与前一项压缩文件所提供的内容是一致的,在下一篇文章中进行说明。

- Python版用户端:

由于Python是目前在深度学习领域中最重要的编程语言之一,NVIDIA为Triton提供可直接安装的Python库,只要执行以下指令就能轻松安装:

|

$ |

pip3 install tritonclient[all] attrdict -i https://pypi.tuna.tsinghua.edu.cn/simple |

这个过程会安装以下内容:

- http

- grpc [ service_pb2, service_pb2_grpc, model_config_pb2]

- utils [ Linux 发行版将包括 shared_memory 和 cuda_shared_memory]

如果您在前面下载第2部分的压缩文件并且解压缩,在该目录之下的clients/python里就提供30多个Triton的Python用户端脚本;如果没有下载前面的压缩文件,现在可以之下以下指令去复制Triton项目的client开源仓:

|

$ |

git clone https://github.com/triton-inference-server/client |

然后在client开源仓下的src/python/examples里有30多个Triton的Python用户端脚本。

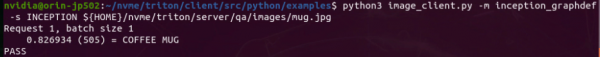

现在进到Python用户端脚本的目录里,执行以下指令:

|

$ |

python3 image_client.py -m inception_graphdef -s INCEPTION ${HOME}/triton/server/qa/images/mug.jpg |

执行后会显示如下的结果:

得到推理的结果为“COFEE MUG”为正确的,表示Triton的Python用户端使用环境是正确的。

以上介绍4种安装Triton用户端软件的方式,本文只使用image_client这个最简单的图像分类用户端工具,另外还有几个比较重要的用户端工具,后面会有针对性的深入讲解与示范。【完】

来源:业界供稿

好文章,需要你的鼓励

Google Health 5.0 正式推出,安卓端新增数据统计小组件

Google Health 5.0作为Fitbit应用的更新版本正式推出。在安卓端,新版本引入了主屏幕快捷访问小组件,取代原有的圆形步数小组件,可显示最多六项健康指标,支持自定义缩放。点击小组件可跳转至完整统计页面,左上角心形图标可快速打开应用,右侧可直达Health Coach功能。此次更新还启用了全新Google Health图标,移除Fitbit品牌标识。安卓版已于5月19日开始推送,5月26日前全面覆盖。

当电脑学会用尺规作图:中国科学院团队让AI真正“画“出几何题

中科院团队发现顶级AI在几何作图上成功率不到6%,推出PAGER系统将精度提升4.1倍,揭示AI能力评估的关键盲点。

奥迪A2 e-tron入门级电动车将为品牌注入新活力

奥迪宣布将推出入门级纯电动车型A2 e-tron,旨在降低豪华电动车的拥有门槛。该车型基于大众最新MEB平台打造,预计提供50kWh、58kWh和79kWh三种电池选项,续航最高可达630公里。目前原型车正在瑞典北部极寒环境及巴伐利亚道路进行测试,重点验证热管理与电池性能。新车预计售价约4万美元,将于今年秋季正式亮相。

浙江大学联手京东研究院:让AI视频训练快6倍的“闪电秘诀“

浙江大学等机构提出Flash-GRPO视频AI训练新方法,通过同时段分组和梯度校正两项创新技术,实现训练速度提升6倍且质量更优。

AI落地深水区的技术账本:软件质量治理如何破解工程化瓶颈

Google Health 5.0 正式推出,安卓端新增数据统计小组件

周中绿色优惠:Juiced Scrambler电动自行车、Lectric XPress2及多款储能产品特惠来袭

NAMUGA机器人视觉业务向"头部"延伸,加速布局高端机器人解决方案

AMD Silo AI与博洛尼亚大学携手开展空间AI合作,聚焦机器人与自动驾驶领域

Remepy混合疗法帕金森治疗方案即将进入三期临床试验

Exa Labs完成2.5亿美元融资,估值达22亿美元

派拉蒙CIO规划AI规模化路径,CTO即将卸任

量子计算面临安全威胁与人才短缺双重挑战

IrisGo:由吴恩达投资的AI桌面智能体,让工作流程自动化成为现实

OpenAI宣称用AI推翻了一个困扰数学界近80年的猜想

Linus Torvalds坦言对AI又爱又恨:工具有用,但挑战真实存在