Graphcore发布全球首款3D WoW处理器产品并公布超未来智能计算路线图

2022年3月3日,中国北京—— Graphcore® 今日正式发布全新IPU系统产品——Bow系列。Bow Pod系统产品采用了全球首款3D Wafer-on-Wafer处理器——Bow IPU。Bow IPU是新一代Bow Pod AI计算机系统的核心。与上代产品相比,它可为真实世界的AI应用提供高达40%的性能提升和16%的电源效率提升,同时价格保持不变,且无需更改现有代码。Bow的命名来源于伦敦市的一处地名。

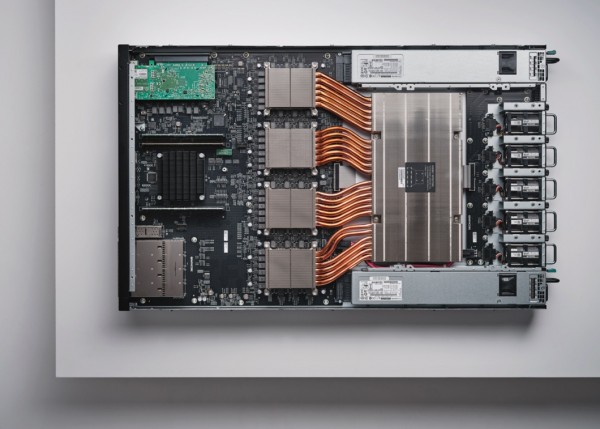

Bow IPU处理器

Bow-2000 计算刀片

同时,Graphcore将于2024年交付全球首台超级智能计算机—— Good ™ Computer(古德计算机)。Graphcore正在开发新一代IPU技术,为这款Good™ Computer提供超过10 Exa-Flops的AI浮点计算;最高可达4PB的存储,带宽超过10PB/秒;支持超过500万亿参数的AI模型;3D Wafer-on-Wafer逻辑栈;同时获得Poplar® SDK的完全支持。该计算机预计价格在100万美元至1.5亿美元(取决于配置)。这款超未来的智能计算机之所以被命名为Good,一方面是Graphcore致力于打造“好”的计算机,一方面是向计算机科学家先驱Jack Good(杰克·古德)致敬。

Graphcore大中华区总裁兼全球首席营收官卢涛表示:“随着AI计算市场的整体快速发展,客户需要兼顾性能、效率和可靠性的计算机系统。我们发布新一代IPU,正是为了支持全球技术开发者和创新者在AI计算领域取得新的技术突破,实现高质量发展。我们希望不断开拓IPU在中国的AI应用场景,通过IPU赋能高效AI计算,支持中国创新者不断推进机器智能的边界。”

Bow Pod的出色性能

旗舰产品Bow Pod256提供超过89 PetaFLOPS的AI计算,而超大规模Bow Pod1024可提供350 PetaFLOPS的AI计算,支持机器学习工程师在AI模型规模呈指数增长的情况下仍可领先一步,在机器智能领域取得新的技术突破。

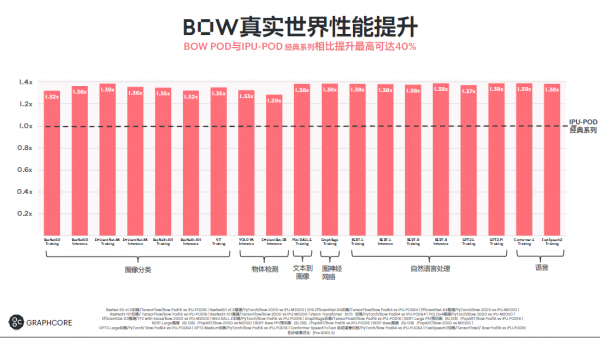

Bow Pod旨在为各种AI应用大规模提供真实世界的性能,从用于自然语言处理的GPT和BERT到用于计算机视觉的EfficientNet和ResNet,再到图神经网络和许多其他应用。

- 在与配有Bow Pod系统的Mk2 IPU-Pod系统相同的峰值功率范围内,客户发现各种AI应用的性能提升高达40%。

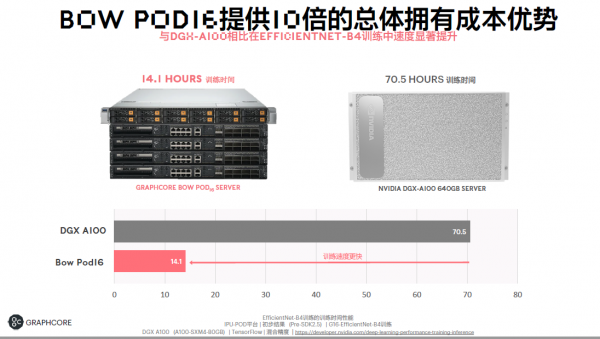

- 对于最先进的计算机视觉模型EfficientNet,Bow Pod16性能比同类Nvidia DGX A100系统提升5倍以上,而价格只有一半,因而总体拥有成本提升高达10倍。

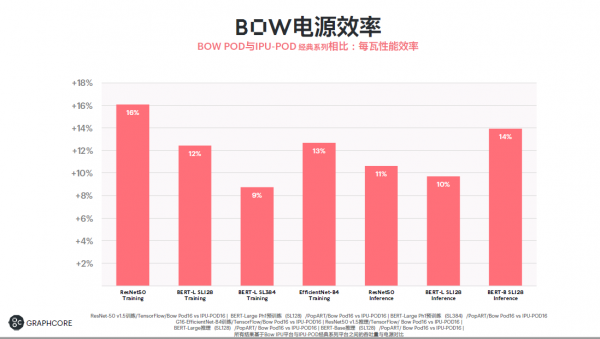

- 与上代产品相比,除了40%的性能提升,Bow Pod系统还可以大幅提高电源效率。经过一系列实际应用测试表明,Bow Pod的每瓦性能最高可提升16%。

Wafer-on-Wafer创新技术

Bow Pod系统核心的Bow IPU处理器采用了全球首项3D半导体技术,从而支持Bow Pod 系统实现了巨大的性能提升和更高的电源效率。Wafer-on-Wafer 3D技术由Graphcore与台积电合作开发。Wafer-on-Wafer技术有潜力在硅片之间提供更高的带宽,从而优化电源效率,在晶圆级别提升Colossus架构的功率。

Bow IPU中的Wafer-on-Wafer,两个晶圆结合在一起,产生一个新的3D裸片。其中一个晶圆用于AI处理,在架构上与GC200 IPU处理器兼容,拥有1472个独立的IPU-Core tile,能够运行超过8800个线程,具有900MB的处理器内存储,而第二个晶圆拥有供电裸片。

通过在供电裸片中添加深沟槽电容器,位置在处理内核和存储旁,我们能够更高效地供电,从而实现350 TeraFLOPS的AI计算,实现40%的性能提升。通过与台积电紧密合作,我们充分验证了整套技术,包括背面硅通孔(BTSV)和Wafer-on-Wafer(WoW)混合键合中的多项突破性技术。

作为Bow Pod系统的组成部分,最新Bow-2000 IPU Machine采用了与第二代IPU-M2000 machine同样强大的系统架构,但现在配备了四个强大的Bow IPU处理器,可提供1.4 PetaFLOPS的AI计算。

Bow-2000可以完全向后兼容现有的IPU-POD系统,其高速、低时延的IPU结构和灵活的1U外形尺寸保持不变。Bow-2000是整个Bow Pod系列的基础组成部分。Bow-2000可安装在戴尔、Atos、Supermicro、浪潮和联想等领先品牌的主机服务器上,从而组成Bow Pod系统。整个Bow Pod系列包括Bow Pod16(4台Bow-2000和一台主机服务器)、Bow Pod32(8台Bow-2000和一台主机服务器)、Bow Pod64以及更大的旗舰系统Bow Pod256和Bow Pod1024。

最新Bow Pod系统现已上市,并开始在全球范围内发货。

来源:业界供稿

好文章,需要你的鼓励

派拉蒙CIO规划AI规模化路径,CTO即将卸任

Paramount正加速推进AI布局,同时面临CTO Phil Wiser五月底计划离职的人事变动。在收购华纳兄弟探索公司接近尾声之际,Paramount CIO Lakshman Nathan在路透社举办的Momentum AI大会上分享了公司AI战略:公司已在隐私、法务及代码开发等领域部署AI,两天内即可完成应用测试交付。Paramount采取开放探索与治理并行的策略,借助智能体AI推动企业级应用整合,同时稳步处理多次并购带来的遗留系统问题。

AI视频理解的“作弊“漏洞被揭穿了——来自StepFun团队的深度修复方案

StepFun团队发现主流全感官AI评测存在"视觉作弊"漏洞,发布OmniClean清洁评测集,并提出三阶段OmniBoost训练方案,让30亿参数小模型媲美300亿参数大模型。

量子计算面临安全威胁与人才短缺双重挑战

量子计算行业正面临两大迫切问题:安全威胁与人才短缺。随着"Q-Day"临近,量子计算机或将破解RSA加密体系,威胁银行、医疗、政府等关键基础设施安全。NIST要求2035年前完成向后量子密码学的迁移。与此同时,行业人才严重匮乏——目前仅有3万名量子专业人员,而2029年需求将达25万人。据麦肯锡预测,量子计算到2035年将创造3万亿美元经济机遇。

阿里巴巴与北京大学联手,让AI大模型“按需用电“:BEAM技术如何让语言模型跑得更快、耗得更少

BEAM是阿里巴巴与北京大学提出的MoE大模型动态路由方法,通过可学习的二值掩码实现每个词自适应选择激活专家数量,在保留98%性能的前提下将推理速度提升最高2.5倍。

量子计算面临安全威胁与人才短缺双重挑战

IrisGo:由吴恩达投资的AI桌面智能体,让工作流程自动化成为现实

OpenAI宣称用AI推翻了一个困扰数学界近80年的猜想

Linus Torvalds坦言对AI又爱又恨:工具有用,但挑战真实存在

Hovercraft:让视频通话演示更自然的 Mac 应用

tvOS 27将为Apple TV 4K带来全局文字放大新功能

比亚迪新款快充电动车订单突破10万辆,产能严重告急

博杰斯快餐连锁推出电动汽车快速充电服务

YouTube Shorts推出AI混剪功能,借助Gemini实现视频重塑

四大AI模型运营电台六个月,结果一团糟

Clouted:用AI智能体消除短视频爆款的不确定性

Anthropic每月向xAI支付12.5亿美元算力费用