NVIDIA Jetson Nano 2GB系列文章(30):DeepStream 摄像头“实时性能”

前面介绍过使用deepstream-app工具,启用多个视频进行车辆与行人的识别,并且启动“追踪”功能进行物件追踪的高级功能,接下来就教大家如何在deepstream-app里调用USB与CSI摄像头,并且与先前的视频同时启用来进行物件识别的应用。

这里使用Jetson Nano 2GB作为实验平台,上面安装一个CSI摄像头与一个USB摄像头。

在调用摄像头之前,建议先确认一下摄像头的位置与分辨率等信息,因为DeepStream会检查设定文件里的分辨率是否符合要求。使用v4l2-utils工具包来检查摄像头的信息,请按照以下步骤进行安装,并且检测摄像头分辨率:

|

sudo apt-get install v4l2-utils v4l2-ctl --list-devices |

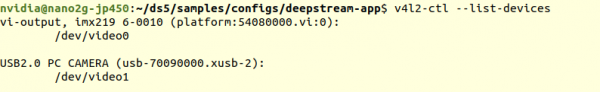

下面显示的信息,表示目前接上一个imx-219的CSI摄像头,以及一个USB 2.0摄像头。

接下执行以下指令,查看个别摄像头可使用的分辨率为多少:

|

v4l2-ctl --list-formats-ext --device=0 v4l2-ctl --list-formats-ext --device=1 |

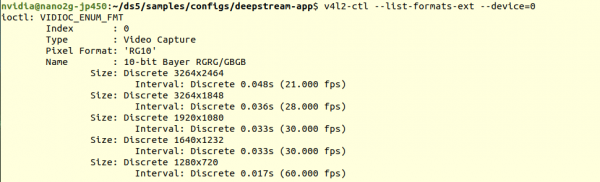

下面显示的信息,表示CSI摄像头(device=0)能支持3264x2464、3264x1848、1920x080、1640x1232、1280x720等5种分辨率

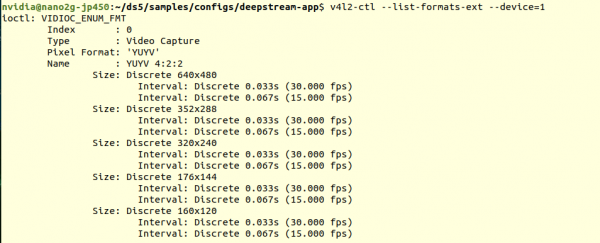

下面显示的信息,表示USB摄像头(device=1)能支持640x480、352x288、320x240、176x144、160x120等5种分辨率

接下来看看在DeepStream路径(/opt/nvidia/deepstream/deepstream)的samples/configs/deepstream-app 下面有个 source2_csi_usb_dec_infer_resnet_int8.txt文件,这是专门以CSI与USB摄像头为输入源的配置,里面可以看到以下关于摄像头设置的内容:

|

[source0] enable=1 #Type - 1=CameraV4L2 2=URI 3=MultiURI 4=RTSP 5=CSI type=5 camera-width=1280 camera-height=720 camera-fps-n=30 camera-fps-d=1 camera-csi-sensor-id=0

[source1] enable=1 #Type - 1=CameraV4L2 2=URI 3=MultiURI type=1 camera-width=1280 camera-height=720 camera-fps-n=30 camera-fps-d=1 camera-v4l2-dev-node=6 |

在[source1]下面的参数有点小问题,用粗体标识出来,因为我们装载的USB摄像头最大分辨率为640x480,因此这里的camera-width与camera-height都必须修改为摄像头所支持的分辨率,此外就是最下面的camera-v4l2-dev-node的部分,前面检查出来这台Jetson Nano 2GB上的USB摄像头编号为“1”,请按照实际状况修改。

将上面三地方修改完后,就可以直接执行以下指令去启动摄像头:

|

deepstream-app -c source2_csi_usb_dec_infer_resnet_int8.txt |

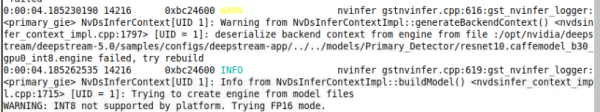

由于配置文件里面原本设定使用INT8的精度去做推理,但是Jetson Nano 2GB并不支持,因此DeepStream自动切换成FP16精度,这需要重新生成对应的TensorRT引擎,会花点时间。

执行之后就能看的画面上出现类似以下的画面,上下分别是CSI摄像头与USB摄像头的显示,由于选择的模型是检测“Car”与“Person”的,所以在这里没有检测到任何目标物件。

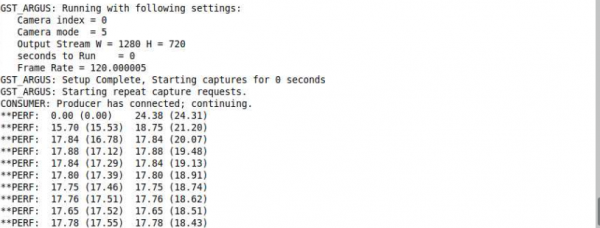

另外看一下先前下指令的终端上,显示在Jetson Nano 2GB上的执行性能如下截屏

两个摄像头都能达到18FPS左右性能,总性能在36FPS左右,已经非常接近实时识别的速度,非常好。您可以试试旋转摄像头或者将手放在前面晃一晃,看看延迟状况如何?应该是很流畅的。

接下来,再添加两个视频文件一起进来执行检测,我们以系统上提供的视频文件做示范:

- /opt/nvidia/deepstream/deepstream/samples/streams/sample_1080p_h264.mp4

- /usr/share/visionworks/sources/data/pedestrians.h264

将这两个的设定添加到文件里的[source2]与[source3],内容如下:

|

[source2] enable=1 type=2 uri=file://../../streams/sample_1080p_h264.mp4

[source3] enable=1 type=2 uri=file:///usr/share/visionworks/sources/data/pedestrians.h264 |

最后调整文件最开始的“[tiled-display]”下面,将“columns=”的值改成“2”,存档后重新执行下面指令:

|

deepstream-app -c source2_csi_usb_dec_infer_resnet_int8.txt |

现在可以看到如下图,两个摄像头与两个视频总共4个输入源同时执行的推理的功能。

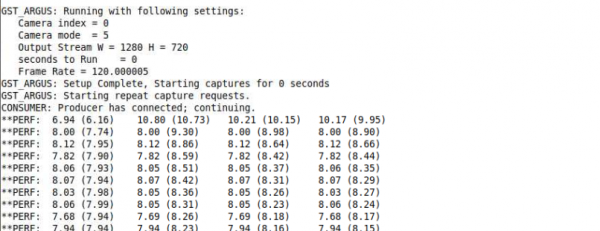

接下来看看此时的性能如何?(如下图)居然每个输入源只剩下8FPS的性能,总性能在32FPS左右,似乎有点慢了。这个问题有补救的办法吗?

实时上问题出现在[primary-gie]使用的模型上,因为Jetson Nano(含2GB)的计算资源较为缺乏,因此DeepStream专门为Nano提供resnet10.caffemodel_b8_gpu0_fp16.engine特调版加速引擎,存放在“../../models/Primary_Detector_Nano”路径下,这是第一个需要做修改的地方:

- model-engine-file=../../models/Primary_Detector_Nano/resnet10.caffemodel_b8_gpu0_fp16.engine

其次就是下面的“config-file”置换成支持Nano版本的配置文件,如下:

- config-file=config_infer_primary_nano.txt

修改完使用的模型之后,重新执行deepstream-app进行物件检测,发现每个数据源的识别性能,立即从原本的8FPS提升到14FPS,也就是总性能从32FPS上升到56FPS左右,提升大约1.8倍。到这里否已经满足样的性能呢?

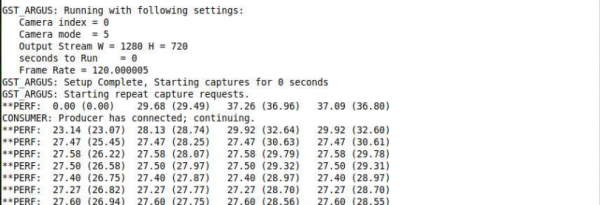

如果还觉得不满足的时候,那就继续看下去,还有大招在后面。只要我们将[primary-gie]下面的“interval”参数设为“1”,这时候再执行看看性能如何?

下面的截屏是调整interval参数之后的性能,有没有吓一跳?瞬间提升一倍。

经过三步骤调整之后,我们在Jetson Nano 2GB上的4个数据源,识别性能都超过27FPS,总性能合计超过100FPS,并且维持识别效果。

现在是不是对Jetson Nano 2GB的性能感到非常满意了!【完】

来源:业界供稿

好文章,需要你的鼓励

阿联酋MBZUAI发布PAN世界模型,AI仿真技术迎来突破

阿联酋阿布扎比人工智能大学发布全新PAN世界模型,超越传统大语言模型局限。该模型具备通用性、交互性和长期一致性,能深度理解几何和物理规律,通过"物理推理"学习真实世界材料行为。PAN采用生成潜在预测架构,可模拟数千个因果一致步骤,支持分支操作模拟多种可能未来。预计12月初公开发布,有望为机器人、自动驾驶等领域提供低成本合成数据生成。

意大利ISTI研究院推出Patch-ioner:一个神奇的零样本图像描述框架,让电脑像人一样描述任何图像区域

意大利ISTI研究院推出Patch-ioner零样本图像描述框架,突破传统局限实现任意区域精确描述。系统将图像拆分为小块,通过智能组合生成从单块到整图的统一描述,无需区域标注数据。创新引入轨迹描述任务,用户可用鼠标画线获得对应区域描述。在四大评测任务中全面超越现有方法,为人机交互开辟新模式。

Nvidia和Google支持的AI代码编辑器Cursor获23亿美元融资

AI代码编辑器开发商Cursor完成23亿美元D轮融资,估值达293亿美元。Accel和Coatue领投,Google、Nvidia等参与。公司年化收入已突破10亿美元。Cursor基于微软开源VS Code打造,集成大语言模型帮助开发者编写代码和修复漏洞。其自研Composer模型采用专家混合算法,运行速度比同等质量模型快四倍。公司拥有数百万开发者用户,将用新资金推进AI研究。

MIT团队重磅发现:不配对的多模态数据也能让AI变得更聪明

MIT研究团队发现,AI系统无需严格配对的多模态数据也能显著提升性能。他们开发的UML框架通过参数共享让AI从图像、文本、音频等不同类型数据中学习,即使这些数据间没有直接对应关系。实验显示这种方法在图像分类、音频识别等任务上都超越了单模态系统,并能自发发展出跨模态理解能力,为未来AI应用开辟了新路径。

Gartner:在中国构建AI软件工程技能的三大举措

阿联酋MBZUAI发布PAN世界模型,AI仿真技术迎来突破

Nvidia和Google支持的AI代码编辑器Cursor获23亿美元融资

Anthropic披露首例Claude模型参与的AI网络间谍活动

Cadence首款系统芯粒架构成功流片,助力物理AI发展加速

百度发布定制AI加速器响应国产芯片需求

VasEdge试用火热招募,降本增效机遇来袭

Infinidat InfiniBox G4系列升级重塑高端企业存储格局

Avalonia为微软MAUI跨平台应用方案带来Linux和浏览器支持

谷歌DeepMind发布SIMA 2智能体:游戏世界中学习迈向AGI之路

Infinidat G4系列升级重新定义高端企业存储格局

Druva扩展Microsoft云保护产品线