浪潮信息英伟达强势霸榜MLPerf训练V1.1,浪潮信息斩获MLPerf年度冠军榜首

美国东部时间12月1日,国际权威AI基准测试MLPerf™公布最新一期训练(Training)榜单V1.1。在全部16个固定任务(Closed Division)测试中,浪潮信息和英伟达包揽15个冠军。

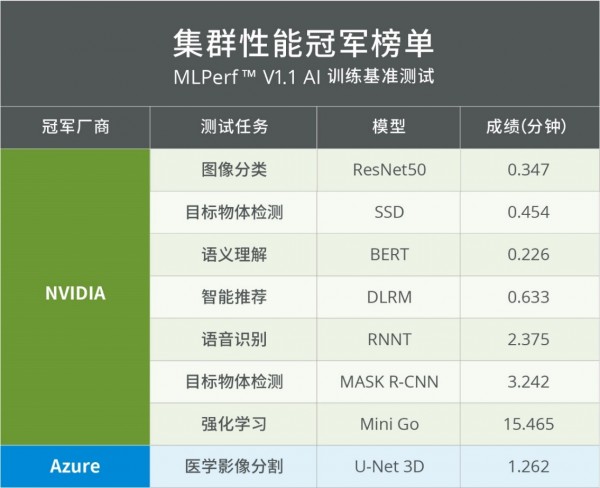

在单机测试的8项任务中,浪潮信息获7项冠军,英伟达获1项冠军;在集群测试的8项任务中,英伟达获7项冠军,微软云获1项冠军。

谷歌、微软云、英伟达、浪潮信息、百度、戴尔等14家公司及科研机构,参与此次MLPerf™基准测试,共提交180项固定任务(Closed)成绩,6项开放任务(Open)成绩。固定任务要求参赛各方使用与参考模型等价的模型和限定的优化器,这对于实际用户评测AI计算系统性能具备很强的参考意义,也一直是MLPerf™中角逐最激烈及主流厂商最关注的领域。

本次MLPerf™基准评测涵盖8类极具代表性的机器学习任务,分别为图像识别(ResNet)、医学影像分割(U-Net3D)、目标物体检测(SSD)、目标物体检测(Mask R-CNN)、语音识别(RNN-T)、自然语言理解(BERT)、智能推荐(DLRM)以及强化学习(MiniGo)。

在单机系统测试的8项任务中,浪潮信息获7项冠军,相较半年前的V1.0竞赛最佳成绩,将医学影像识别、语音识别、智能推荐和自然语言理解任务的AI训练速度分别提升18%、14%、11%和8%。英伟达在单机测试中获得强化学习1项冠军,训练速度相较V1.0提升2%。

在集群系统测试的8项任务中,英伟达获7项冠军,相较于V1.0竞赛最佳成绩将自然语言理解、目标物体检测(MASK R-CNN)、语音识别任务的AI训练速度分别提升22%、18%、14%。微软云夺得1项冠军,以1.26分钟完成医学影像分割任务训练,训练速度相较V1.0提升58%。

MLPerf™每年组织AI推理及AI训练性能测试各2次。目前,MLPerf™ 2021年度4次测试正式收官。作为业内最权威的AI基准测试,本年度共29家国际厂商、研究机构参与其中,在数据中心推理、边缘推理、集群训练和单机训练各类AI场景下,不断突破AI系统性能。其中,浪潮信息共斩获44项冠军,名列MLPerfTM2021年度冠军榜首,英伟达、戴尔、高通分列第二、第三、第四。

关于MLPerf™:MLPerf™是影响力最广的国际AI性能基准评测,由图灵奖得主大卫•帕特森(David Patterson)联合顶尖学术机构发起成立。2020年,非盈利性机器学习开放组织MLCommons基于MLPerf™基准测试成立,成员包括谷歌、Facebook、英伟达、英特尔、浪潮、哈佛大学、斯坦福大学、加州大学伯克利分校等50余家全球AI领军企业及顶尖学术机构,致力于推进机器学习和人工智能标准及衡量指标。

来源:业界供稿

好文章,需要你的鼓励

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

无人机食品配送服务商Flytrex与全球知名披萨连锁品牌Little Caesars宣布合作,推出全新Sky2无人机,最大载重达4公斤,可一次配送两个大披萨及饮料,满足全家用餐需求。Sky2支持最远6.4公里的配送范围,平均从起飞到送达仅需4.5分钟。首个试点门店已在德克萨斯州怀利市上线,并实现与Little Caesars订单系统的直接集成。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

欧洲最大3D打印公寓楼提前数月竣工

法国社会住房项目ViliaSprint?已正式完工,成为欧洲最大的3D打印多户住宅建筑,共12套公寓,建筑面积800平方米。项目由PERI 3D Construction使用COBOD BOD2打印机完成,整体工期较传统建造缩短3个月,实际打印仅用34天(原计划50天),现场操作人员从6人减至3人,建筑废料率从10%降至5%。建筑采用可打印混凝土,集成光伏板及热泵系统,能源自给率约达60%。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里

OpenAI再度重组高管架构,全力押注AI智能体战场

出门在外也能用!OpenAI 将 Codex 接入 ChatGPT 移动端

Google Gemini应用图标迎来细微配色调整

Synetic在2026嵌入式视觉峰会上发布LYNX计算机视觉SDK

生数科技发布世界动作模型Motubrain,为机器人智能带来"无限可能"