多家领先厂商采用全球首批基于NVIDIA Grace CPU的系统设计

华硕、富士康工业互联网、技嘉科技、云达科技、超微、纬颖等公司将提供用于数字孪生、AI、高性能计算、云图形和游戏的全新数据中心系统

加利福尼亚州圣克拉拉 —— COMPUTEX —— 太平洋时间2022年5月23日 —— NVIDIA于今日宣布,多家领先的计算机制造商将发布首批基于 NVIDIA Grace™ CPU超级芯片和Grace Hopper超级芯片的系统,这些系统将用于数字孪生、AI、HPC、云图形和游戏等各类工作负载。

预计从2023年上半年开始,华硕、富士康工业互联网、技嘉科技、云达科技、超微和纬颖将陆续推出几十款服务器。基于Grace的系统将与x86和其他基于Arm的服务器一同为客户提供广泛的选择空间,助力其数据中心实现高性能和高效率。

NVIDIA超大规模和HPC副总裁Ian Buck表示: “现在有一种新型数据中心正在兴起,即通过处理和挖掘海量数据来实现智能的´AI工厂´。NVIDIA正在与合作伙伴联手打造助推这一转变的系统。基于NVIDIA Grace超级芯片的新系统将为全球新市场和行业注入加速计算的力量。”

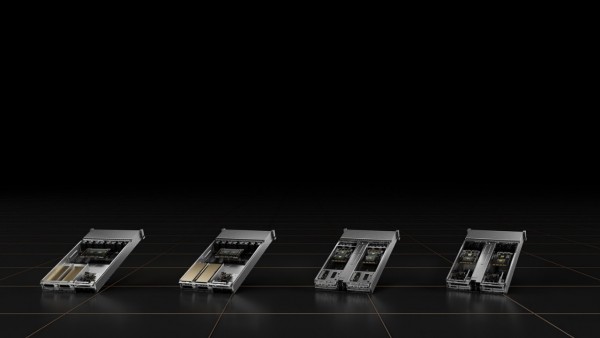

即将推出的服务器基于采用Grace CPU超级芯片和Grace Hopper超级芯片的四类全新系统设计。Grace CPU超级芯片和Grace Hopper超级芯片是NVIDIA在最近两场GTC大会上发布的。2U外形设计为原始设计制造商和原始设备制造商提供了蓝图和服务器底板,助力其将适用于NVIDIA CGX™云游戏、NVIDIA OVX™数字孪生、NVIDIA HGX™ AI和HPC平台的系统快速推向市场。

大幅加速现代化工作负载

上述两种NVIDIA Grace超级芯片技术支持多种系统架构中的各类计算密集型工作负载。

- Grace CPU超级芯片搭载两块通过NVLink®-C2C互连技术连接的CPU芯片,内置多达144个高性能Arm V9核心,并且带有可伸缩矢量扩展和每秒1 TB的内存子系统。这一开创性的设计可实现最高的性能,并且内存带宽和能效两倍于当今领先的服务器处理器,可满足要求最为严苛的HPC、数据分析、数字孪生、云游戏和超大规模计算应用。

- Grace Hopper超级芯片在一个集成模块中,通过NVLink-C2C将NVIDIA Hopper™ GPU与Grace CPU互联,可满足HPC和超大规模AI应用的需求。借助NVLink-C2C互连技术,Grace CPU向Hopper GPU的数据传输速度比传统CPU提升15倍。

广泛的Grace服务器产品组合适用于AI、HPC、数字孪生和云游戏

Grace CPU超级芯片和Grace Hopper超级芯片服务器设计组合包括单路、双路和四路配置的单底板系统,服务器制造商可根据客户需求,为这些系统自定义四种专用于特定工作负载的设计:

- NVIDIA HGX Grace Hopper系统:用于AI训练、推理和HPC,搭载Grace Hopper超级芯片和NVIDIA BlueField®-3 DPU。

- NVIDIA HGX Grace系统:用于HPC和超级计算,采用纯CPU设计,搭载Grace CPU超级芯片和BlueField-3。

- NVIDIA OVX系统:用于数字孪生和协作式工作负载,搭载Grace CPU超级芯片、BlueField-3和NVIDIA GPU。

- NVIDIA CGX系统:用于云图形和游戏,搭载Grace CPU超级芯片、BlueField-3和NVIDIA A16 GPU。

NVIDIA正在扩展NVIDIA认证系统™计划,以涵盖采用NVIDIA Grace CPU超级芯片和Grace Hopper超级芯片的服务器以及X86 CPU。预计首批OEM服务器认证将在合作伙伴系统出货后不久完成。

软件支持

Grace服务器产品组合针对NVIDIA丰富的计算软件堆栈进行了优化,包括NVIDIA HPC、NVIDIA AI、Omniverse™和NVIDIA RTX™。

来源:业界供稿

好文章,需要你的鼓励

生成式引擎优化GEO:在线零售商的新营销手册

随着谷歌搜索和亚马逊主页在电商领域影响力下降,AI助手如ChatGPT、Claude等成为消费者新的购物入口。品牌必须掌握生成式引擎优化(GEO)技术才能保持可见性。传统SEO策略已失效,AI系统更青睐结构化、问答式的高质量内容。研究显示,来自AI助手的流量转化率比其他渠道高9倍。品牌需要基于真实客户问题创建内容,采用结构化问答格式,并建立信任度,才能在这个新的电商秩序中脱颖而出。

人工智能大模型推理速度大提升!阿姆斯特丹大学与Salesforce联手开发“聪明导游“技术

阿姆斯特丹大学与Salesforce合作开发的奖励引导推测解码(RSD)技术,通过让小模型处理简单任务、大模型解决复杂问题的智能分工,在保持推理准确率的同时大幅提升计算效率。该技术在数学推理等任务中表现出色,计算量最多可减少75%,为AI应用的普及和成本降低提供了重要技术支撑。

数据中心电池储能系统如何抵御新兴网络威胁

2025年第一季度网络攻击激增126%,英国新法案要求数据中心强制报告网络安全事件。现代威胁已演变为同时攻击IT和OT系统,而许多数据中心的备用电源系统仍使用90年代的过时技术。电池储能系统(BESS)通过分布式架构、加密通信和自主运行能力提供网络弹性防护。BESS即服务模式将网络安全维护转移给专业提供商,同时通过需求响应和能源套利创造收益。随着全球法规要求将网络安全与能源安全相结合,数据中心需要现代化基础设施来应对日益严峻的威胁环境。

微软首创!让大型语言模型记忆力暴涨64倍的神奇方法

微软研究院开发出LongRoPE2技术,能让大型语言模型的记忆容量扩展64倍至12.8万字,同时保持98.5%的原有性能。该方法通过发现AI位置编码训练不均衡问题,采用智能搜索和混合训练策略,仅用传统方法八十分之一的资源就实现突破。这项技术将使AI能完整处理长文档、进行复杂对话,为文档分析、代码开发、内容创作等领域带来重大改进。

生成式引擎优化GEO:在线零售商的新营销手册

数据中心电池储能系统如何抵御新兴网络威胁

英特尔如何解决数据中心液冷技术的“接头难题”?

Google发布Pixel 10系列及新AI智能助手功能

Google推出Gemini for Home智能家居新战略

Salesforce推出政府专用AI智能体,或将替代部分政府工作人员

CachyOS超越Mint和MX成为DistroWatch排行榜冠军

谷歌发布Pixel 10系列主打AI手机功能

Black Hat USA 2025:企业浏览器之年

微软加速量子安全密码学算法集成进程

Commvault修复四个漏洞以防远程代码执行攻击

Druva推出AI智能体增强DruAI网络安全防护

NVIDIA Blackwell 现已在云端全面可用

为“代理式AI”装上“护栏” NVIDIA打造“三重防线”

黄仁勋现身北京致辞:60年后,计算机正被重新定义

CES 2025 | NVIDIA Isaac GR00T Blueprint 让人形机器人“加速进化”

未来,就在我们手中

CES 2025 | 代理式AI崛起:NVIDIA定义下一代“代理式 AI Blueprint”

深度学习最佳 GPU,知多少?

NVIDIA推出用于多语言生成式人工智能的NeMo Retriever微服务

NVIDIA 初创加速计划 | 2024 NVIDIA 创业企业展示完美收官!

老黄掏出“迷你版AI超算”,每秒67万亿次运算,仅售2070元人民币