加速AI推理 NVIDIA发布TensorRT 8并获得ACM RecSys 2021挑战赛冠军 原创

训练对于深度学习来说是为了获得一个性能优异的模型,其主要的关注点在于模型的准确度等指标。推理则不一样,其没有了训练中的反向迭代过程,是针对新的数据进行预测,而我们日常生活中使用的AI服务都是推理服务。推理更关注的是高吞吐率、低响应时间、低资源消耗以及简便的部署流程,而TensorRT就是用来解决推理所带来的挑战以及影响的部署级的解决方案。

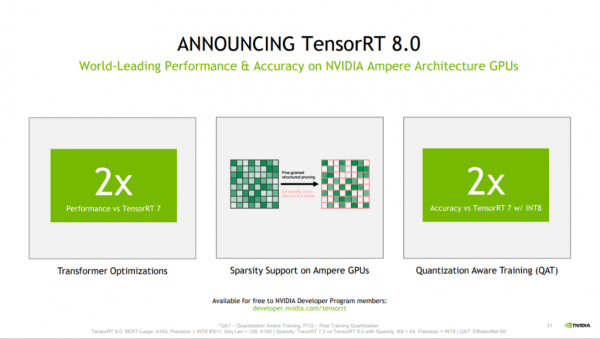

近日,NVIDIA于今日发布公司第八代AI软件TensorRT 8。该软件将语言查询推理时间缩短了一半,使开发者能够从云端到边缘构建全球最佳性能的搜索引擎、广告推荐和聊天机器人。TensorRT 8现已全面上市,并免费向NVIDIA开发者计划成员提供。用户还可从TensorRT GitHub库中获得最新版本插件、解析器和样本的开放源代码。

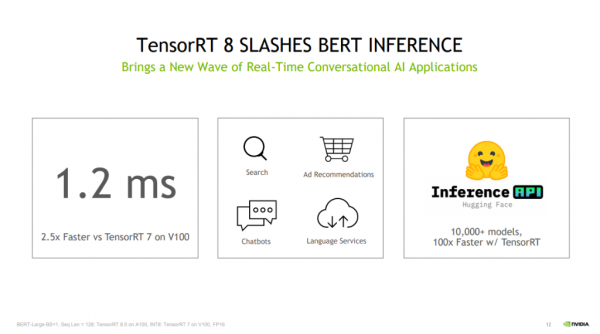

TensorRT 8的各项优化为语言应用带来了创纪录的速度,能够在1.2毫秒内运行BERT-Large——全球最广为采用的基于transformer的模型之一。过去,企业不得不缩减模型大小,而这会导致结果出现大幅偏差。现在有了TensorRT 8,企业可以将其模型扩大一倍或两倍,从而大幅提高精度。

TensorRT面对面

Tensor,深度学习中的张量。一个一维Tensor的叫Vector,二维的叫Matrix,三维四维的Tensor都有。 Tensor RT的Tensor指的就是这个概念,而整个TensorRT的工具是指一个GPU Inference Engine,也就是一个GPU推理引擎。

TensorRT基本上支持现在所有的主流框架训练出来的模型,把模型输入进来,然后TensorRT帮助做解析,实现网络层之间的优化。TensorRT可部署于超大规模数据中心、嵌入式或汽车产品平台。

除了针对transformer的优化之外,TensorRT 8还通过其他两项关键特性,实现了AI推理方面的突破。

其一是稀疏性,这是助力推动NVIDIA Ampere架构GPU性能提升的一项全新技术,它不但提高了效率,还使开发者能够通过减少计算操作来加速其神经网络。

其二是量化感知训练,开发者能够使用训练好的模型,以INT8精度运行推理,在这一过程中不会损失精度。这大大减少了计算和存储成本,从而在Tensor Core核心上实现高效推理。

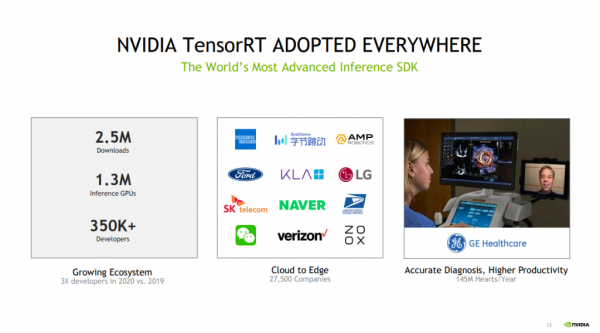

五年来,医疗、汽车、金融和零售等各个领域27500家企业的超35万名开发者下载TensorRT近250万次,众多行业客户已将TensorRT用于他们在对话式AI和其他各个领域的深度学习推理应用。例如Hugging Face与NVIDIA开展密切合作,推出能够助力实现大规模文本分析、神经搜索和对话式应用的开创性AI服务。Hugging Face加速推理API已经能够为基于NVIDIA GPU的transformer模型提供高达100倍的速度提升。通过TensorRT 8,Hugging Face在BERT上实现了1毫秒的推理延迟。

临床医生需要花费宝贵的时间来选择和评估超声图像。在Vivid Patient Care Elevated Release项目的研发过程中,GE医疗正在使用TensorRT,助力加速早期检测疾病的关键工具——超声波计算机视觉应用,使临床医生能够通过其智能医疗解决方案提供最高质量的护理。TensorRT凭借其实时推理能力,提高了视图检测算法的性能,同时缩短了研发项目的产品上市时间。

用实力说话

推荐系统是人工智能应用的重要方向,其通过比传统搜索更快、更智能的方式提供建议。

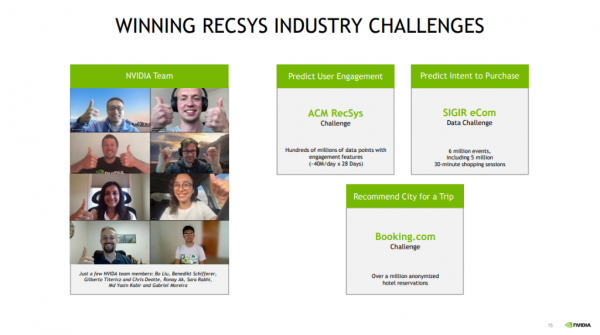

作为难度最高的一次推荐系统数据科学竞赛,ACM RecSys 2021挑战赛是计算机科学一个相对较新的分支,它催生了机器学习领域常用的应用程序之一,这一程序帮助数百万人找到他们想看、想买和想玩的内容。

而由七人组成的NVIDIA参赛团队第二次赢得冠军,该团队共使用了六个AI模型,达到了比赛规定的20千兆字节上限,所有这些模型都是根据他们研究7.5亿个数据点的经验精挑细选出来的。这次比赛有一项不同寻常的规则,要求模型必须基于一个云端CPU的单一内核运行,并且运行时间不能超过24小时。

众所周知,GPU本可以在很短的时间内完成推理工作,而且NVIDIA Merlin框架可以帮助用户快速建立自己的推荐系统。所以,让推理工作去适应CPU核心“就好像回到了远古时代”。事实上,比赛一结束,该团队就展示了在CPU核心上花费近24小时的推理工作,在单个NVIDIA A100 Tensor Core GPU上运行只需7分钟。

今年早些时候,NVIDIA团队在Booking.com挑战赛的40支参赛小组中拨得头筹。他们使用数百万个匿名数据点来准确的预测了欧洲度假者最终将选择前往的城市。

今年6月,另一项顶级RecSys大赛SIGIR电子商务数据挑战赛设置了更高的门槛。其2021年挑战赛提供了3700万个在线购物会话的数据点,并要求参赛者预测用户会购买哪些产品。

由于这场比赛与ACM RecSys挑战赛的时间重叠,NVIDIA团队不得不兵分两路,各有侧重地参与不同的比赛。

其中一只NVIDIA团队共包含五名成员,分别身处巴西、加拿大、法国和美国在每个排行榜中这只团队均排名第一或第二。能取得这样出色的整体表现,主要有两个因素。其一,他们在Transformer模型上下了很大功夫,这些模型是为自然语言处理开发的,并越来越多地被RecSys所采用。其二,他们深谙轮班工作的工作方法。

6月30日,NVIDIA在RecSys挑战赛取得四连胜。行业基准组织MLPerf宣布,NVIDIA及其合作伙伴在其所有最新训练基准测试中均创下新纪录,其中包括一个有关推荐系统的基准测试。

参赛团队描述了他们取得的成果——即在不到一分钟内训练基于14个NVIDIA DGX系统的推荐系统,与一年前提交的成果相比,速度加快了3.3倍。

NVIDIA的RecSys专家谈及他们的技术诀窍是一半是艺术,一半是科学。例如像Merlin这样的RecSys框架,以及NVIDIA深度学习学院所拥有的相关工具、论文和在线课程,还有使用多种模型,并使其协同工作。

结语

人工智能的运用分成两个阶段,一是学习训练阶段,二是推理阶段,此与应用程序相类似,程序开发阶段即为学习训练阶段,程序正式上线执行运作则为推理阶段。

不管是TensorRT 8还是RecSys挑战赛的佳绩,NVIDIA在推动AI推理方面的步伐一直没有止步,推动人工智能应用在行业中的落地。

来源:至顶网计算频道

好文章,需要你的鼓励

Arm发力服务器市场但尚未撼动x86霸主地位

IDC数据显示,Arm架构服务器出货量预计2025年将增长70%,但仅占全球总出货量的21.1%,远低于Arm公司年底达到50%市场份额的目标。大规模机架配置系统如英伟达DGX GB200 NVL72等AI处理设备推动了Arm服务器需求。2025年第一季度全球服务器市场达到创纪录的952亿美元,同比增长134.1%。IDC将全年预测上调至3660亿美元,增长44.6%。配备GPU的AI服务器预计增长46.7%,占市场价值近半。

斯坦福哈佛联合研究:AI学习策略转换背后的“理性选择“机制

斯坦福与哈佛研究团队通过创新的"层次贝叶斯框架",首次从理性分析角度解释了AI学习策略转换机制。研究发现AI会在"记忆型"和"理解型"两种策略间理性选择,转换规律遵循损失-复杂度权衡原理。该理论框架仅用三个参数就能准确预测AI在不同条件下的行为表现,为AI系统的可控性和可预测性提供了重要理论基础。

AI重塑初创公司建设规则的全新时代

AI正在重塑创业公司的构建方式,这是自云计算出现以来最重大的变革。January Ventures联合创始人Jennifer Neundorfer将在TechCrunch All Stage活动中分享AI时代的新规则,涵盖从创意验证、产品开发到团队架构和市场策略的各个方面。作为专注于B2B早期投资的风投合伙人,她将为各阶段创业者提供关键洞察。

斯坦福大学推出SMMILE:首个医学AI在情境学习能力评估基准,揭示现有AI在医疗诊断中的致命弱点

这项研究汇集了来自斯坦福大学、苏黎世联邦理工学院、隆德大学、加州大学旧金山分校等多所世界顶尖学府的11位医学专家,共同构建了医学AI领域的首个多模态情境学习评估标准。

Arm发力服务器市场但尚未撼动x86霸主地位

思科AI生态布局:成为企业AI转型的第一选择

Genesis AI获1.05亿美元融资,开发通用机器人基础模型

AI无法预测全球加速计算服务器的真实需求量

2025年中盘点:AI四大驱动力的现状与未来

OCI与xAI合作揭示云端AI的差异化路径

量子数据中心之路不止于逻辑量子比特

Panzura为Symphony平台新增ACL修复功能应对权限蔓延难题

Arista收购博通VeloCloud业务,Todd Nightingale出任总裁兼COO

Concentric AI收购两家初创公司,扩展数据保护平台范围

Linux内核或将移除Bcachefs文件系统

Quobyte存储系统助力Zoox机器人出租车训练

NVIDIA Blackwell 现已在云端全面可用

为“代理式AI”装上“护栏” NVIDIA打造“三重防线”

黄仁勋现身北京致辞:60年后,计算机正被重新定义

CES 2025 | NVIDIA Isaac GR00T Blueprint 让人形机器人“加速进化”

未来,就在我们手中

CES 2025 | 代理式AI崛起:NVIDIA定义下一代“代理式 AI Blueprint”

深度学习最佳 GPU,知多少?

NVIDIA推出用于多语言生成式人工智能的NeMo Retriever微服务

NVIDIA 初创加速计划 | 2024 NVIDIA 创业企业展示完美收官!

老黄掏出“迷你版AI超算”,每秒67万亿次运算,仅售2070元人民币