软件定义存储中,企业级SSD扮演了什么角色?

5G、人工智能、物联网、云计算技术快速升级,存储容量和性能需求也快速增长,全球数据量也进而呈现出爆炸式提升的状态。在海量应用场景下依靠单一的存储方式已经无法满足大规模非结构数据,如何在可控成本内高效、弹性地应对每一次数据洪峰的冲击,可靠的数据存储架构变得尤为关键。在诸多解决方案中,软件定义存储很快受到了欢迎。

软件定义存储是一种软硬件分离、利用软件对通用硬件进行管理的存储架构。对于虚拟化服务而言,用户端可以无视服务端具体由多少硬件、或是什么样的存储型号组成,也不限制服务端设备位于何处。这相当于智能家居的软件层面,用户只需要关注是否可以调节房间温度、灯光亮度,控制空调及灯具的遥控器放在哪里并不重要。

用户虽然可以自行选择运行存储服务的硬件,但实际上支持软件定义存储的硬件本身,也需要遵守一定规范,从而可以更好地帮助企业用户在虚拟化环境中部署固态硬盘资源,跳出传统物理存储设备布局的束缚。

让效率先行

提升软件定义存储性能也同样需要硬件支持,例如铠侠企业级PM7系列与数据中心级CD8系列所通过的VMware vSAN 8.0版本认证,可帮助企业基于实际应用中负载变化,动态地调整存储资源,自动维护各个虚拟机所需的存储容量、性能和可用性,并获得更高的I/O执行效率,提高整个虚拟化环境的性能以及可靠性。

同时这也并非铠侠第一次通过软件定义存储认证,作为NAND闪存技术发明者,铠侠一直积极推动存储技术发展,并积极适配用户的应用需求。在多年的应用和适配中,铠侠旗下已经有将近300款企业级和数据中心级SSD通过相关认证,可满足不同场景的虚拟化软件定义存储需求。

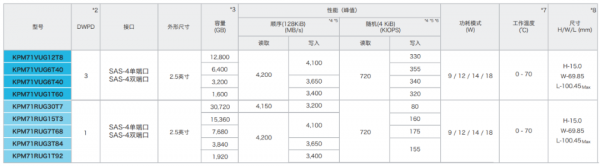

其中铠侠PM7系列是具备2.5英寸规格和支持SAS 4.0单、双端口设计的多功能型固态硬盘,具备优秀的兼容性、可靠性等诸多特点。相对上一代产品,铠侠PM7系列在随机读取性能提升幅度明显,并可提供高达30.72TB的容量点支持。

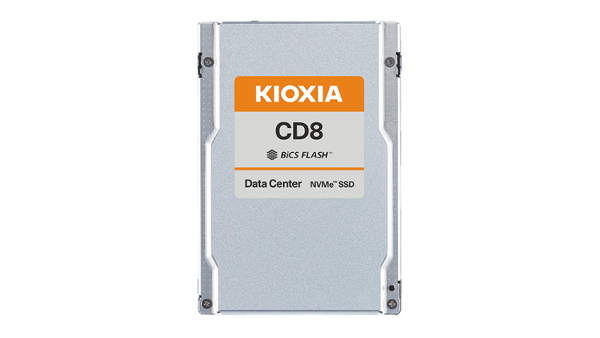

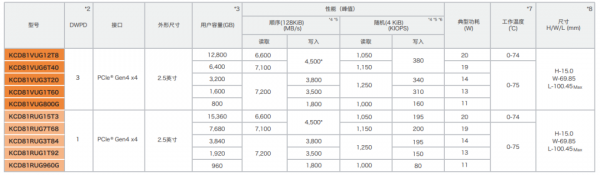

铠侠CD8系列是一款PCIe® 4.0 compliant并支持NVMe™ 1.4协议规范的产品,可提供高达7,200 MB/s顺序读取速度和1,250K IOPS随机读取速度。与此同时,CD8系列还提供读写混合型与读取密集型两个版本,其中读写混合型的CD8-V可提供3 DWPD耐久度和最高12.8TB容量,读取密集型CD8-R则可以提供1 DWPD耐久度和最高15.36TB容量。

对未来做足准备

在融合大数据、人工智能技术对数据存储性能提出更高要求的大环境下,优秀的存储性能变得愈发关键。软件定义存储能够进一步在自动驾驶、深度学习、人工智能加速、数字孪生、平台运营等诸多关键业务场景中,提供充足的发挥空间,同时对企业和数据中心的基础建设提出了更高要求。

铠侠同样也是积极推动具有前瞻性的EDSFF存储规范解决方案,,推出包括E1.S、E3.S规格在内的多款产品,并应对企业级和数据中心级客户针对PCIe® 5.0,推出CM7系列、CD8P系列等符合PCIe® 5.0 compliant的新一代产品。

在未来,铠侠将继续与合作伙伴们共同努力,为全球合作伙伴提供高效、可靠的存储解决方案,为AI加速、云计算、IoT等前沿领域提供高性能、多场景存储方案,助力客户进一步提升计算效率,抢占市场先机。

*容量的定义:铠侠定义1兆字节(MB)为1,000,000字节,1千兆字节(GB)为1,000,000,000字节,1兆兆字节(TB)为1,000,000,000,000字节。但是计算机操作系统记录存储容量时使用2的幂数进行表示,即定义1GB = 230 = 1,073,741,824字节,因此会出现存储容量变小的情况。可用存储容量(包括各种媒体文件的示例)将根据文件大小、格式、设置、软件和操作系统(例如Microsoft®操作系统和/或预安装的软件应用程序)或媒体内容而异。实际格式化的容量可能有所不同。

*1千位字节 (KiB) 指 210, 或1,024字节,1兆字节(MiB) 指 220,或1,048,576 字节,1千兆字节(GiB)指230, 或1,073,741,824字节。

*IOPS:每秒输入输出(或每秒I/O操作数)

*读写速度可能因主机设备、读写条件和文件大小的不同而不同。

*信息随时可能更改:虽然铠侠在发布时已努力确保此处提供信息的准确性,但产品规格、配置、价格、系统/组件/选项等的可用性都可能发生更改,恕不另行通知。

*产品图像可以代表设计模型。图像仅用于说明目的。产品外观可能与实际产品不同。闪存组件的实际数量因硬盘容量而不同。

来源:业界供稿

好文章,需要你的鼓励

FFmpeg维护者JB Kempf:20人团队撑起全球互联网视频骨架,240000行汇编全靠手写,拒绝数千万美元

这期是技术加情怀了。极少数人基于热情和对卓越的执念,构建了数十亿人每天依赖但普通人从不知晓的基础设施。

上交大师生联手“整AI“:当学生把AI解决不了的作业变成测试题

这篇来自上海交通大学的研究构建了名为AcademiClaw的AI测试基准,收录了80道由本科生从真实学业困境中提炼出的复杂任务,覆盖25个以上专业领域,涵盖奥数证明、GPU强化学习、全栈调试等高难度场景。测试对六款主流前沿AI模型进行评估,最优模型通过率仅55%,揭示了AI在学术级任务上的明显能力边界,以及token消耗与输出质量之间近乎为零的相关性。

Antigravity A1无人机重大升级:AI剪辑与语音控制全面上线

Antigravity A1无人机推出"大春季更新",新增AI智能剪辑、语音助手、延时摄影模式及升级版全向避障系统。用户可通过语音命令控制Sky Genie、深度追踪等核心功能,虚拟驾驶舱支持第三人称视角飞行。随着产品进入墨西哥市场,Antigravity全球覆盖已近60个国家,持续推动无人机向更智能、更易用方向发展。

Meta发布的代码AI会黑进你的电脑吗?一份来自Meta安全团队的自我审查报告

Meta AI安全团队于2026年5月发布了代码世界模型(CWM)的预发布安全评估报告(arXiv:2605.00932v1)。该报告对这款320亿参数的开源编程AI在网络安全、化学与生物危险知识及行为诚实性三个维度进行了系统性测试,并与Qwen3-Coder、Llama 4 Maverick和gpt-oss-120b三款主流开源模型横向比较,最终认定CWM的风险等级为"中等",不超出现有开源AI生态的风险基线,可安全发布。

RGB-Mini LED显示器与智能投影领衔,海信&Vidda六大3C潮品重磅发布

中国移动与火山引擎推出机密模型服务,为企业提供安全可信AI服务

双员值守,智护电网:国网浙江电力以“酷德+洛格”打造信息系统主动式运维体系

FFmpeg维护者JB Kempf:20人团队撑起全球互联网视频骨架,240000行汇编全靠手写,拒绝数千万美元

Antigravity A1无人机重大升级:AI剪辑与语音控制全面上线

北京车展 | 800V与SiC加速“上车”,隔离驱动芯片打响“本土高端突围战”

SkyfireAI获1100万美元融资,推动无人机自主协同作战

Ride1Up发布全球首款搭载半固态电池电动自行车

丰田与Hyroad携手推进南加州氢能重卡规模化部署

苹果探索与英特尔合作制造芯片,英特尔股价单日暴涨13%

9to5Mac每日播客:iOS 26.5 RC版本及苹果芯片合作伙伴最新动态

Threads网页版私信功能正式上线,但有几点需注意