ТоФЗаћВМЪеЙКSolar FrontierОЩЙњИЛЙЄГЇ

НќШеЃЌТоФЗаћВМгыГіЙтаЫВњзгЙЋЫОЬЋбєФмЧАЯпЃЈSolar FrontierЃЉДяГЩСЫЙигкЪеЙКЮЛгкЙЌЦщЯиЙњИЛюЎЕФЬЋбєФмЧАЯпЙЄГЇЕФЛљБОавщЁЃ

ОнСЫНтЃЌЫЋЗНМЦЛЎНЈСЂвдЬМЛЏЙшЃЈSiCЃЉЮЊжїЕФЙІТЪАыЕМЬхЩњВњЯпЃЌВЂМЦЛЎдк2024ФъЕзПЊЪМдЫгЊЁЃетНЋГЩЮЊТоФЗдкШеБОгЕгаЕФзюДѓЙцФЃЕФSiCЙІТЪАыЕМЬхЩњВњЛљЕиЁЃ

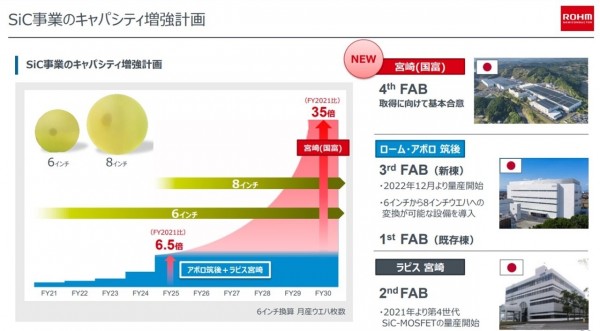

ДЫЭтЃЌЫћУЧМЦЛЎдкЮДРД30ФъФкНЋSiCЙІТЪАыЕМЬхЕФЩњВњФмСІЬс35БЖЃЈШчЭМ1ЃЉЁЃ

ЭМ1 SiCЙІТЪАыЕМЬхЕФЩњВњФмСІЬсИп35БЖЃЛ

ЫћУЧМЦЛЎдкОЩЙњИЛЙЄГЇаТНЈЩњВњЯпЃЌДѓЗљЬсИпЩњВњФмСІЃЈРДдДЃКТоФЗЃЉ

ЯрЙиаХЯЂЯдЪОЃЌДЫДЮЪеЙКЪБМфдЄМЦдк2023Фъ10дТЃЌЪеЙКН№ЖюЮДЙЋПЊЁЃОЩЙњИЛЙЄГЇЕФеМЕиУцЛ§дМЮЊ40ЭђЦНЗНУзЃЌНЈжўзмУцЛ§дМЮЊ23ЭђЦНЗНУзЁЃТоФЗМЦЛЎРћгУИУЙЄГЇЕФЯжгаНЈжўКЭНрОЛЪвЃЌаТНЈвдSiCЮЊжїЕФЙІТЪАыЕМЬхЩњВњЯпЁЃ

ИУЙЋЫОдкШеБОгЕгаИЃИдЯиЕФСНИіSiCЙІТЪАыЕМЬхЙЄГЇЃЌвдМАЙЌЦщЯиЕФвЛИіSiCЙІТЪАыЕМЬхЙЄГЇЃЌОЩЙњИЛЙЄГЇНЋГЩЮЊЕкЫФИіЙЄГЇЁЃдкЯжгаЕФШ§ИіЙЄГЇЕФЛљДЁЩЯЃЌЫћУЧМЦЛЎдк2020ФъДњжаЦкНЋSiCЙІТЪАыЕМЬхЕФЩњВњФмСІЬсИпЕН21ФъЕФ6.5БЖЁЃЭЈЙ§дкОЩЙњИЛЙЄГЇаТНЈЩњВњЯпЃЌЫћУЧМЦЛЎдкЮДРД30ФъФкНЋSiCЙІТЪАыЕМЬхЕФЩњВњФмСІЬсИпЕН21ФъЕФ35БЖЁЃ

ТоФЗМЦЛЎвдSiCЮЊжїЭЦЖЏЙІТЪАыЕМЬхвЕЕФЯњЪлЖюдк2021ФъжС2027ФъЦкМфвдФъОљдМ30%ЕФЫйЖШдіГЄЁЃЮЊДЫЃЌЫћУЧЙЋВМСЫдк2021ФъжС2027ФъЦкМфЭЖзЪ5100вкШедЊгУгкSiCЙІТЪАыЕМЬхЕФМЦЛЎЁЃ

КУЮФеТЃЌашвЊФуЕФЙФРј

УзРЁЄФТРЬсжиЗЕЙЋжкЪгвАЃЌНїЩїЗЂЩљ

ФТРЕйЪБИє18ИідТЪзДЮНгЪмжиДѓУНЬхВЩЗУЃЌНщЩмЦфДДСЂЕФThinking Machines Labе§дкПЊЗЂЕФ"НЛЛЅФЃаЭ"ЁЃИУФЃаЭФмвд200КСУыМфИєДІРэвєЦЕЁЂЮФБОКЭЪгЦЕСїЃЌВЖзНШЫРрНЛСїжаЕФжаЖЯЁЂаое§КЭЭЃЖйЁЃЫ§ЛЙЬИМАOpenAI"еўБфжм"ОРњЃЌЧПЕїаавЕОіВпШЈЙ§гкМЏжаЕФЕЃгЧЃЌВЂЛигІСЫЙЋЫОНќЦкбаОПШЫдБРыжАЮЪЬтЃЌБэЪОетЪЧГѕДДЪЕбщЪвЕФе§ГЃВЈЖЏЁЃ

ЕБAIЛњЦїШЫЁАздаХЕиЁАзВЯђЧНБкЃКSTATE16баОПдКНвЪОЮяРэAIЯЕЭГжаФЧаЉЮоЩљЮоЯЂЕФжТУќДэЮѓ

STATE16баОПдКетЦЊзлЪіЗЂЯжЃЌЮяРэAIЯЕЭГДцдк"ОВФЌЪЇаЇ"ЗчЯеЁЊЁЊAIвдИпЖШздаХжДааЛљгкДэЮѓЪРНчаХЯЂЕФЖЏзїЃЌШДВЛДЅЗЂШЮКЮБЈОЏЃЌВЂЬсГідкAIЪфГігыЮяРэжДаажЎМфНЈСЂЖРСЂЪкШЈВуЕФПђМмЁЃ

ЬиЫЙРвЩЫЦЩОГ§FSDжЄОнЃЌПЈЬиБЫРеМгЫйЕчЖЏЛЏВМОжЃЌИпбЙЯЕЭГММЪѕХрбЕПЬВЛШнЛК

БОЦкЁЖQuick ChargeЁЗВЅПЭКИЧЖрИіШШЕуЛАЬтЃКЬиЫЙРвЩЫЦЪдЭМЩОГ§FSDЦлеЉЯрЙижЄОнвдЙцБмОоЖюХтИЖЃЛПЈЬиБЫРеГжајЭЦНјНЈжўСьгђЕчЦјЛЏВМОжЃЛзЁеЌЬЋбєФм30%ЫАЪеЕжУтМДНЋЕНЦкЁЃДЫЭтЃЌМЮБіTom PachecoОЭИпбЙЯЕЭГгыЕчГиММЪѕХрбЕеЙПЊЬНЬжЃЌЧПЕїЕчЖЏГЕММЪѕШЫВХХрбјЕФНєЦШадЁЃНкФПЭЌЪБЬсабгавтАВзАЬЋбєФмЕФгУЛЇОЁПьааЖЏЃЌПЩЭЈЙ§EnergySageЦНЬЈБШНЯЖрМвАВзАЩЬБЈМлЁЃ

ЕБAIбЇЛсЁАБпИЩБпбЇЁАЃКUIUCгыЮЂШэСЊКЯДђдьЕФЭјвГжЧФмЬхбЕСЗаТЗЖЪН

UIUCгыЮЂШэСЊКЯбаЗЂЕФOpenWebRLПђМмШУ4BаЁФЃаЭНіЦО400ЬѕГѕЪМЪ§ОнЃЌЭЈЙ§дкецЪЕЭјеОЩЯБпзіБпбЇЕФЧПЛЏбЇЯАЗНЪНЃЌдкЭјвГжЧФмЬхЛљзМЩЯГЌдНСЫгУ27ЭђЬѕЪ§ОнбЕСЗЕФОКељЖдЪжЁЃ

ЬиЫЙРвЩЫЦЩОГ§FSDжЄОнЃЌПЈЬиБЫРеМгЫйЕчЖЏЛЏВМОжЃЌИпбЙЯЕЭГММЪѕХрбЕПЬВЛШнЛК

жЧФмЬхЭјТчСїСПЪзГЌецШЫЗУЮЪЃЌ"ЫРЭіЛЅСЊЭј"РэТлв§ЗЂаТељвщ

Mentium Technologies Luna-R1 AIаОЦЌШыбЁET-01аЧзљШЮЮёЃЌЭъГЩЖраЧВПЪ№РяГЬБЎ

ЬРЕРЩњЁСвІЫГгъЃКЬкбЖAIЯТАыГЁЃЌЦДЕФЪЧЁАФЃаЭЁСВњЦЗЁБЯЕЭГФмСІ

AIЧ§ЖЏЭјТчЗИзяЪ§СПьЩ§ЃЌРеЫїШэМўЪмКІепФъді389%ЃКFortinet ЗЂВМ2026ФъШЋЧђЭўаВЬЌЪЦбаОПБЈИц

InboltНЋдкAutomateеЙЛсЗЂВМЪгОѕЧ§ЖЏЛњЦїШЫБрГЬаТЙІФм

БЪМЧБОЕчФдЩюЖШЧхНржИФЯЃКФкЭтМцаоЛРШЛвЛаТ

МгРћИЃФсбЧжнГЧЪаЭЈЙ§ШЋУРЪзИігЩбЁУёЭЖЦБОіЖЈЕФЪ§ОнжааФНћСю

ВёгЭЬцДњЗНАИЃКAIЪ§ОнжааФШчКЮРћгУШМЦјв§ЧцгыеєЦћЮаТжЙЉЕч

AIЖЈвхЦћГЕЪБДњЃЌГЕдивдЬЋЭјПЩППадУцСйШЋаТЬєеН

АВШЋЫуЗЈЕФГжајИќаТе§БфЕУгњЗЂРЇФб

ЙьЕРЪ§ОнжааФБОжЪЩЯЪЧЙІФмЧПЛЏЕФЮРаЧ

NANDЩСДцМлИёвђЙЉгІЙ§ЪЃЖјБЉЕјЃЌЙЄГЇВњСПЯїМѕ

Ш§аЧБэЪОбаЗЂжЇГігАЯьдЫгЊРћШѓ

ЁОSEMIЖДВьЁПгЂЬиЖћЕФЛљЖћаСИёЪБДњТфФЛ

ФъжеХЬЕуЃК2024ФъзюжЫЪжПЩШШЕФ10МвАыЕМЬхГѕДДЙЋЫО

ВњвЕиAIАыЕМЬхШШГБжаЩ§ЮТЃЌSKКЃСІЪПФъЖШгЊвЕРћШѓЛђГЌШ§аЧ

AMDЙЋЫОCIOЬИAIЧ§ЖЏзЊаЭгыITЕФЮДРД

гВПЦММжЧФмЁАЫФжизрЁБ

ЗжЮіиЬЈЛ§ЕчвЕМЈьЩ§ЃЌетДЮФмеОЮШЭђвкУРдЊЪажЕТ№ЃП

ЁЖаОЦЌеНељЁЗзїепПЫРяЫЙЁЄУзРеЃКАыЕМЬхЕФеўжЮЛЏЧїЪЦЃЌКмПЩФмРЉеЙЕНдЦМЦЫуКЭAIФЃаЭЙЉгІСьгђ

ПЦДДигОГиЛњЦїШЫГЇЩЬаЧТѕДДаТЭъГЩаТвЛТжШкзЪЃЌШЗЖЈИпЖЫжїЙЅЗНЯђ