以「应用」为基石,以「服务」为本心,UCloud发布天镜·智能告警产品

自《“十四五” 国家信息化规划》发布以来,数字化转型已经在各行各业全面展开。很多企业都会采用混合云架构打造数字化底座;混合云在带来更灵活、更安全、低成本等优势的同时,其异构的特点也使得运维团队在跨云环境中面临了许多挑战。

针对用户面临的挑战,UCloud近日正式发布天镜·智能告警产品(SkyM Alert),基于UCloud多年云计算运维经验沉淀而成的最佳实践,通过集成、降噪、分派、通知四类功能串联故障告警,为用户提供集中化的故障全周期管理。

故障全周期管理

轻松集成

在混合云架构中,各类云服务商和监控平台,产生的告警数据结构差异较大,给运维带来了巨大不便,天镜·智能告警通过自研的数据处理引擎,将异构数据进行一致性处理,只需要简单的几个步骤,即可在页面集中管理全量告警,带来一致性的故障处理体验。

精准降噪

告警风暴一直是运维过程中的大麻烦,天镜·智能告警提供多种降噪方式来解决这个问题。使用去重、防抖、合并、静默,消除大量无效告警,全面压制告警风暴,帮助运维人员专注处理关键故障。

具体来说,天镜·智能告警支持三类降噪方式:

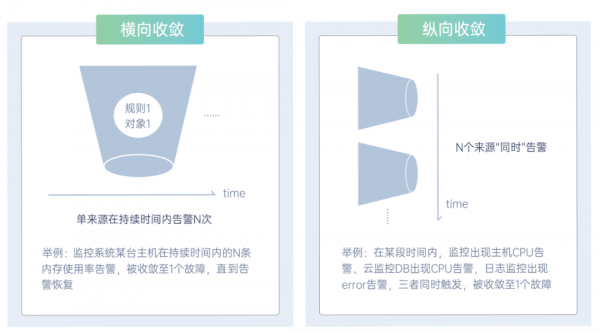

• 告警降噪,能够实现同一来源的相同告警收敛和同一时间窗口不同来源的不同告警收敛。

• 通知降噪,可以先通知后收敛一定时间周期内的相同告警;或者先收敛,超过一定时间周期未恢复的告警再通知。

• 告警静默,可以根据用户的自定义配置对告警进行静默,支持持续性静默和周期性静默。

高效协同

告警的快速响应和处理,是业务正常运行的重要保障,因此,智能告警平台提供了灵活的告警分派和升级策略,以确保告警能及时地触达对应的处理人员,帮助用户搭建有效的on-call值班响应机制。

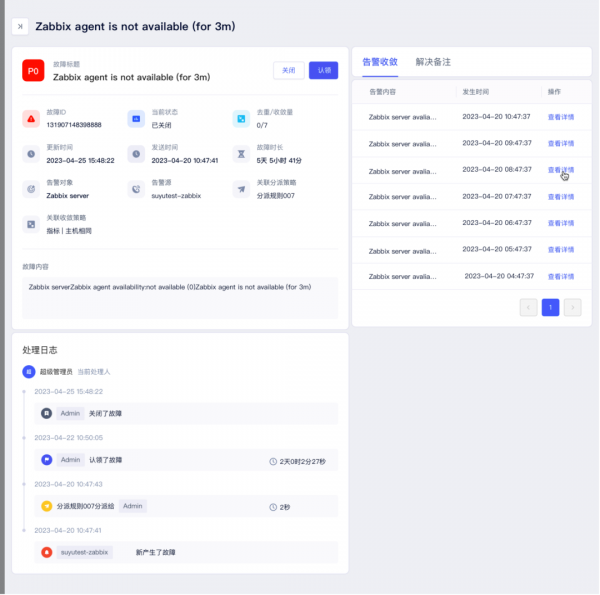

此外支持运维团队在统一管理页面协同处理每个故障,并进行操作过程记录和处理过程备注,提高故障处理效率,同时,可将每一个故障处理过程沉淀下来作为运维经验,帮助企业在未来更好地应对类似问题。

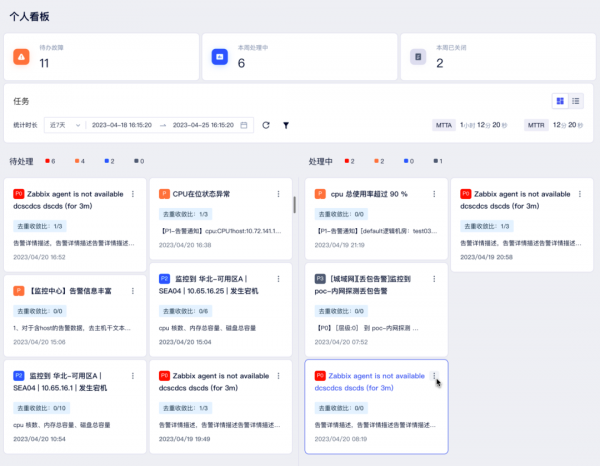

个人看板,智能告警平台通过构建一个基于个人的工作看板,让运维人员能够更专注地处理告警,而不被无关信息干扰。这样就能更快地定位和解决告警,并提高工作效率。

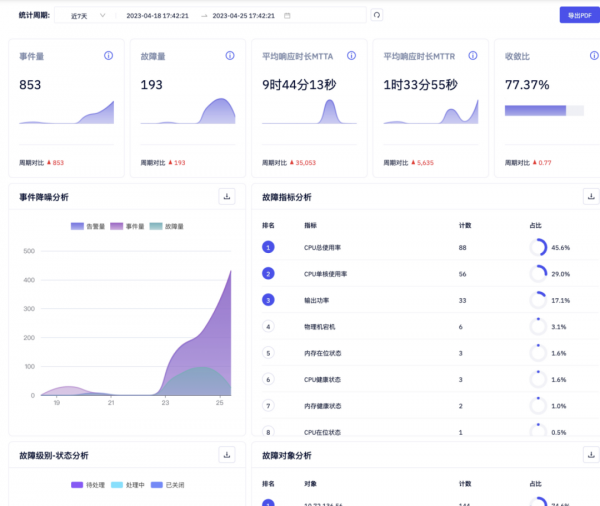

团队看板,开启团队看板可以实现对故障告警的全局性了解,如最新收敛比、收敛趋势图,并支持实时查看运维人员的MTTA、MTTR趋势。这些数据可以帮助业务和运营负责人更好地了解应用运行情况,并提供更专业的运维见解。

多维度告警分析,通过对跨平台的告警数据进行一体化展现,智能告警平台为业务和运营负责人提供了对告警对象、指标、内容和运维人员工作效率的数据支撑,进一步提高了团队的运营掌控能力。

通知必达

支持电话、短信、邮件、钉钉、飞书、企微等多种告警通知方式,可根据告警类型进行配置,秒级多渠道分发,实现告警必达,大大提升告警通知的有效到达率。

是应用,更是服务

UCloud天镜·智能告警不仅提供产品应用,而且还将UCloud多年的云计算运维经验和最佳实践分享给用户。在订阅期内,UCloud将深入分析用户的业务环境,梳理用户实际需要的监控项和告警规则,搭建符合用户业务现状的智能告警平台,并提供应急运维服务,共同建立运维SOP,帮助用户在故障运维场景中获得真正的技术支持。

以「应用」为基石,以「服务」为本心,天镜·智能告警帮助企业提升故障响应和处理速度、减少资源浪费、保障业务的高可用,使繁琐复杂的运维工作,变得更加精细和专注,助力企业在数字化转型的道路上顺利前行。

来源:业界供稿

好文章,需要你的鼓励

AI投资有望在2026年获得真正回报的原因解析

尽管全球企业AI投资在2024年达到2523亿美元,但MIT研究显示95%的企业仍未从生成式AI投资中获得回报。专家预测2026年将成为转折点,企业将从试点阶段转向实际部署。关键在于CEO精准识别高影响领域,推进AI代理技术应用,并加强员工AI能力培训。Forrester预测30%大型企业将实施强制AI培训,而Gartner预计到2028年15%日常工作决策将由AI自主完成。

北大学者革新软件诊断方式:让代码问题的“病因“无处遁形

这项由北京大学等机构联合完成的研究,开发了名为GraphLocator的智能软件问题诊断系统,通过构建代码依赖图和因果问题图,能够像医生诊断疾病一样精确定位软件问题的根源。在三个大型数据集的测试中,该系统比现有方法平均提高了19.49%的召回率和11.89%的精确率,特别在处理复杂的跨模块问题时表现优异,为软件维护效率的提升开辟了新路径。

2026年软件定价大洗牌:IT领导者必须知道的关键变化

2026年软件行业将迎来定价模式的根本性变革,从传统按席位收费转向基于结果的付费模式。AI正在重塑整个软件经济学,企业IT预算的12-15%已投入AI领域。这一转变要求建立明确的成功衡量指标,如Zendesk以"自动化解决方案"为标准。未来将出现更精简的工程团队,80%的工程师需要为AI驱动的角色提升技能,同时需要重新设计软件开发和部署流程以适应AI优先的工作流程。

德国达姆施塔特工业大学团队首次揭秘:专家混合模型AI的“安全开关“竟然如此脆弱

这项由德国达姆施塔特工业大学领导的国际研究团队首次发现,当前最先进的专家混合模型AI系统存在严重安全漏洞。通过开发GateBreaker攻击框架,研究人员证明仅需关闭约3%的特定神经元,就能让AI的攻击成功率从7.4%暴增至64.9%。该研究揭示了专家混合模型安全机制过度集中的根本缺陷,为AI安全领域敲响了警钟。

稚晖君发布全球最小全身力控人形机器人,上纬启元开启个人机器人时代

2026年软件定价大洗牌:IT领导者必须知道的关键变化

Linux 在 2026 年将势不可挡,但一个开源传奇可能难以为继

CES 2026趋势展望:全球最大科技展五大热门话题预测

人工智能时代为何编程技能比以往更重要

AI颠覆云优先战略:混合计算成为唯一出路

谷歌发布JAX-Privacy 1.0:大规模差分隐私机器学习工具库

谷歌量子AI发布新型优化算法DQI:量子计算优化领域的重大突破

缓解电动汽车里程焦虑:简单AI模型如何预测充电桩可用性

Titans + MIRAS:让AI拥有长期记忆能力

Gemini为STOC 2026大会理论计算机科学家提供自动化反馈

夸克AI眼镜持续升级:首次OTA,支持89种语言翻译

应对VMWare政策之变,还有比虚拟化替换更重要的事

UCloud优刻得与新网联合发布「新网云」,为中小企业提供优质高效云服务

UCloud优刻得镜像市场上线Milvus向量数据库镜像

面对大模型 云厂商如何开启新的增长曲线?

UCloud上线多款主流大模型镜像,提供“模型+算力”一站式服务

以「应用」为基石,以「服务」为本心,UCloud发布天镜·智能告警产品

UCloud全栈私有云解决方案,打造AIGC强大智算底座

超对称联合复旦大学发布并开源120亿参数语言模型BBT-2,UCloud提供开源和算力支持

经济、安全、全服务覆盖,UCloud重磅推出混合云2.0解决方案

提升科研算力,云极高性能计算EPC升级实现一键式集群部署