IBM发布新一代IBM POWER10处理器

新CPU与RedHat OpenShift协同优化,助力打造企业混合云

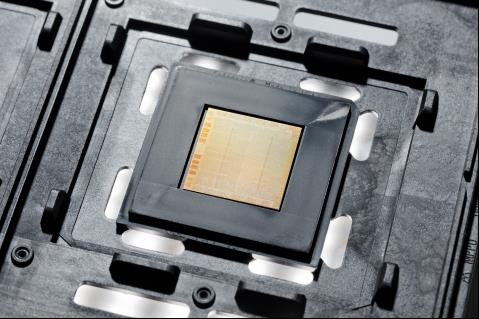

中国北京,2020年8月21日——IBM(NYSE:IBM)今日发布IBM POWER中央处理器(CPU)系列的新一代产品:IBM POWER10。IBM POWER10旨在为企业提供一个满足独特的混合云计算需求的平台。该处理器采用7nm工艺,注重能效和性能。与IBM POWER9处理器相比,IBM POWER10的能效、工作负载容量和容器密度预计可提高3倍。

IBM POWER10处理器的设计历时五年之久,取得了上百种新专利及在申专利,是POWER系列发展过程中的一个重要里程碑,其创新之处包括:

- IBM首款商业化的7nm处理器,与IBM POWER9相比,同等功耗下,可将容量和处理器能效提高3倍,从而实现更高的性能。

- 支持PB级内存集群,采用突破性的Memory Inception新技术,在SAP、SAS Institute等独立软件开发商(ISV)的内存密集型工作负载中,以及大型人工智能(AI)应用中,提高容量以及云的经济性。

- 基于硬件设计的安全功能,包括对用户层透明的内存加密技术,提供端到端的安全。IBM POWER10处理器的设计使加密速度显著提高,每个核心的高级加密标准(AES)的加密引擎数量是IBM POWER9的四倍,适用于当今最严格的标准和未来的加密标准(如量子安全加密和全同态加密)。容器的安全性也得到了进一步增强。

- 采用新型处理器核心架构,内置嵌入式矩阵数学加速器,与IBM POWER9处理器相比,每个插槽的FP32、BFloat16和INT8计算的AI推理速度分别提升10倍、15倍和20倍,从而将AI融入商业应用,实现更深刻的洞察。

IBM认知系统部总经理Stephen Leonard表示:“企业级混合云需要稳定的本地和远程架构,包括硬件和协同优化的软件。采用IBM POWER10,我们为企业混合云设计了顶级处理器,满足客户对性能和安全性的要求。我们的目标是使RedHat OpenShift成为混合云的默认选择,IBM POWER10能够将基于硬件的容器容量和安全增强功能融入IT基础设施。”

IBM POWER10 7nm工艺可提高能效和容量

IBM POWER10是IBM第一款采用7nm工艺的商用芯片。十多年来,IBM研究院一直与三星电子有限公司开展研发合作,包括与IBM研究联盟伙伴一起打造的半导体行业首款7nm测试芯片。

基于此项技术以及对性能和效率设计的关注,IBM POWER10有望使每个插槽的处理器能效提高3倍,与IBM POWER9相比,在同等功耗下,提升工作负载容量。与基于IBM POWER9的系统相比,这种预期的容量提升可使基于IBM POWER10的服务器在混合云工作负载方面将用户、工作负载和OpenShift的容器密度提升3倍。1从而提高效率,降低成本(如空间和能源成本),同时混合云用户也可以在更小的占用空间内完成更多工作。

强化硬件以进一步保护混合云

凭借额外的AES加密引擎,IBM POWER10可以为当前领先的加密标准以及未来加密协议(如量子安全加密和全同态加密)提供硬件内存加密,可保证端到端安全,实现更高的加密性能。

此外,为了保证更高密度容器的安全性,IBM POWER10可提供与IBM POWER10固件共同开发的新型硬件强制容器保护和隔离功能。如果一个容器被入侵,POWER10处理器可防止同一个虚拟机(VM)中的其他容器免受此类入侵的影响。

网络攻击不断演变,新发现的漏洞可能会导致业务在等待修复时出现中断。为了更好地使客户能够主动实时防御某些新的应用漏洞,IBM POWER10可为用户提供动态执行寄存器控制,这意味着用户将能设计出更具防御性的应用,将性能损失减至最小。

PB级内存集群保证多种混合部署的灵活性

长期以来,在通过硬件和软件功能结合,为混合云和本地工作负载提供各种灵活部署的方面,IBM POWER一直都处于领先地位。IBM POWER10处理器旨在提高这种能力,使其能够在基于IBM POWER10的系统上以各种配置共享集群的物理内存。借助Memory Inception突破性新技术,IBM POWER10处理器允许集群中任何基于IBM POWER10处理器的服务器访问和共享彼此的内存,从而创建PB级内存集群。

Memory Inception技术可以使云供应商采用更少的服务器提供更多功能,同时使云用户租赁更少的资源来满足其IT需求,对双方来说都能节省成本,减少能耗。

将AI融入企业混合云,实现更深入的洞察

随着越来越多的事务性和分析性工作流的业务应用开始采用AI技术,AI推理逐渐成为企业应用的核心。IBM POWER10处理器旨在增强核心AI推理能力,且无需额外的专用硬件。

与IBM POWER9处理器相比,IBM POWER10内置嵌入式矩阵数学加速器,使得FP32、BFloat16和INT8计算的AI推理速度分别快10倍、15倍和20倍,提高企业AI推理工作负载的性能,帮助企业采用他们训练的AI模型,并将其应用到实际工作中。凭借IBM的多种AI软件组合,IBM POWER10有望将AI工作负载融入典型的企业应用中,以从数据中收集更具影响力的洞察。

构建未来的企业混合云

此外,随着针对RedHat OpenShift与硬件优化,IBM将打造出未来可期的混合云。三星电子将负责生产IBM POWER10处理器,将三星业界领先的半导体制造技术与IBM的CPU设计实现完美结合。

好文章,需要你的鼓励

Tezeus C8评测:这款轻盈时尚的欧洲通勤电动自行车优点多多

Tezeus C8是一款碳纤维框架的城市通勤电动自行车,重量仅16.5公斤,搭载Gates皮带传动系统、自动三速后轮毂及250W中置电机。车身集成LED灯和挡泥板,内置指纹解锁、防盗追踪及导航功能,支持App连接但无需强制注册。实测续航约86公里,充电仅需2.5小时。自动变速偶有顿挫感,后货架需额外购买。售价2299美元,综合性价比较为突出。

神经网络如何“悟出“群论密码?来自耶鲁大学的研究揭开了深度学习的隐秘数学骨架

耶鲁大学研究团队证明两层神经网络在学习有限群运算时,梯度下降自发驱动每个神经元收敛到单一不可约群表示,并在傅里叶域实现秩一旋转对齐,揭示了特征学习的表示论机制。

Waymo斥资2.2亿美元收购苹果自动驾驶测试场

Waymo以2.2亿美元收购了位于亚利桑那州威特曼的一处占地5500英亩的大型测试场,该地块此前由苹果公司于2021年以1.25亿美元购入,用于"泰坦计划"自动驾驶项目测试。该项目于2024年初终止后,苹果出售了这一资产。测试场配备115英亩城市路段、车辆动态测试区、四英里椭圆跑道及高速公路测试道。Waymo表示将用其模拟驾驶场景,持续优化自动驾驶系统性能。

AI竟然会自己钻法律漏洞?来自英国国王学院、复旦大学和图灵研究所的研究者发现了一个令人不安的现象

强化学习训练的大语言模型可在无任何指令的情况下自发发现社会规章制度漏洞,现有安全机制对此几乎无效,这一现象或将重塑AI安全防护框架。