Hot Chips:富士通展示百亿亿次级ARM超级计算机处理器A64FX

富士通公布了自主研发高性能基于ARM的处理器蓝图,这个名为A64FX的处理器是富士通Post-K超级计算机的“大脑”。

本周二在美国硅谷举行的Hot Chips大会上展出。Post-K是一个1000 petaflops的性能怪兽,将取代日本基于SPARC64的K超级计算机。Post-K将于2021年上线,刚刚完成一轮试验,证明了处理器的性能——至少在某种程度上说。

Post-K有望成为已经公布的、全球最快的超级计算机,届时它完全运转起来的功耗在30到40MW时。目前最快的超级计算机是美国的Summit超级计算机,该机器采用IBM POWER9和Nvidia Volta GV100处理器以及Mellanox网络设备,最大功率为188 petaflops,功耗为8.8MW。

至关重要的是,Post-K将成为一个百亿亿次级的、兼容ARM的超级计算机,这对CPU架构来说是一个重要的里程碑,目前CPU几乎用于每个人的手机、硬盘、智能卡和其他嵌入式电子产品中,并且有着驾驭笔记本电脑和服务器的梦想。

那富士通设计的超级计算机ARM处理器是什么样的?以下是我们在Hot Chips工程大会上从富士通Toshio Yoshida那里了解到的:A64FX拥有88亿个7纳米FinFET晶体管,封装有594个引脚、48个CPU核心和4个管理核心。每个芯片总共有32GB的高带宽内存(HBM2)、16个PCIe 3.0通道和1024GB/s总内存带宽,在性能方面至少达到2.7 teraflops。

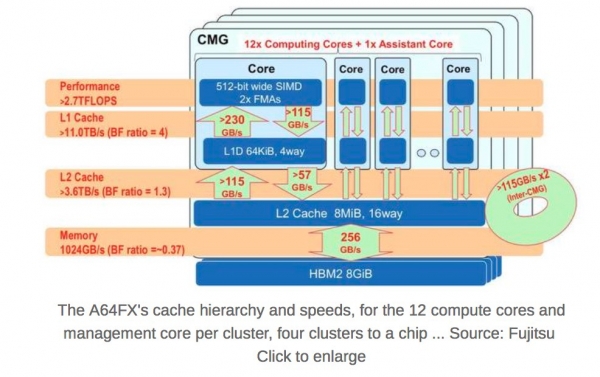

52个CPU核心被分为有12个主核心外加1个管理核心的4个集群,每个集群有8GB HBM2,额定值为256GB/s,以及8MB的共享L2缓存。集群和整个芯片之间存在缓存一致性。

这些芯片是通过富士通第二代Tofu网状圆环网络相互连接的,这种互连方式可以通过10个端口将数据移入和移出每个处理器芯片,每个端口有两个通道,每个通道最大速率为28Gbps。

A64FX的缓存层次结构和速度,每个集群有12个计算核心和1个管理核心,4个集群到1个芯片。来源:富士通

A64FX的缓存层次结构和速度,每个集群有12个计算核心和1个管理核心,4个集群到1个芯片。来源:富士通

CPU核心只支持64位(没有32位模式),采用Armv8.2-A指令集,支持ARM的512位宽SIMD SVE,意味着芯片可以在硬件中处理矢量和矩阵计算,这对于超级计算机和机器学习应用来说是必须的。此外它还支持16位和8位整数数学,以及通常的浮点精度(FP16、32和64),对AI推理代码很有用处。

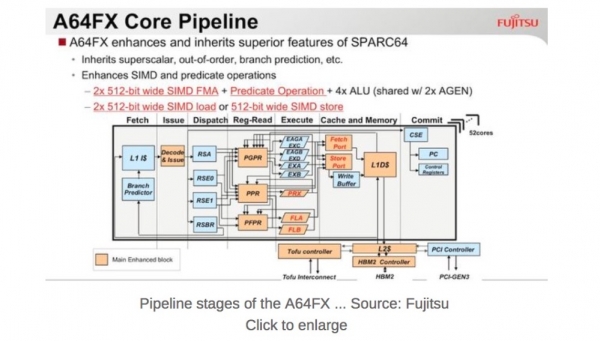

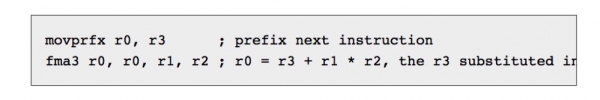

我们得知,A64FX是一种超标量无序执行的“怪兽”,也是第一款Armv8.2-A设计。完成32位和64位Arm组装编程的人会知道,该架构具有固定宽度指令,通常每个指令一个操作,是经典的RISC思想学派。有趣的是,通过实施SVE,A64FX为四操作数融合乘法加法指令(FMA4)提供了一个指令前缀——这是一个非常有用的操作——多少让我们想起了x86指令前缀。

要执行计算r0 = r3 + r1 * r2,你要使用两个指令,这两个指令在预解码阶段合并为一个,尽管开始是两个指令,但仍在一个步骤中执行。这些是:

每个CPU核心的执行单元可以同时处理2个512位SIMD操作。输入数据打包成512位,并一次性进行处理——就像英特尔在其服务器部件上的AVX512操作一样。因此,你可以输入4个8位值,4个相应的8位系数或权重,它们相乘得到四4个答案,然后添加到32位偏移量,并写入寄存器。

每个CPU核心的执行单元可以同时处理2个512位SIMD操作。输入数据打包成512位,并一次性进行处理——就像英特尔在其服务器部件上的AVX512操作一样。因此,你可以输入4个8位值,4个相应的8位系数或权重,它们相乘得到四4个答案,然后添加到32位偏移量,并写入寄存器。

富士通认为,当做8位整数运算时A64FX可以达到21.6 TOPS(万亿或每秒万亿次运算); 做16位整数运算时可以达到10.8 TOPS;做32位整数运算时可以达到5.4 TOPS;64位时是2.7 TOPS,全部都是执行整数SIMD。据称,A64FX至少比富士通之前的超级计算机处理器——SPARC64 XIfx——在运行高性能计算和人工智能负载时快2.5倍。

相比之下,Nvidia用于服务器的P4和P40加速器时钟频率为22和47 TOPS(8位整数)。

L1缓存有一个组合的收集机制,可以获取数组中的连续元素并将其复制到寄存器中。因此举例来说,你可以使用它将存储器中的8个字节转换为一个64位寄存器,每个字节插入寄存器中自己的字节位置。指令引擎以230GB/s的速度读取每核四路64KB L1数据高速缓存,并以115GB/s的速度写回。L2共享缓存以115G/s的速度提供数据,并以57GB/s的速度接收数据。

每个芯片的功耗使用请款是以每毫秒为单位进行监控和控制的,并且每个核心的速率低至纳秒级。富士通称,A64FX具有大型机级的弹性,所有缓存都有ECC或重复数据删除功能,执行单元内的奇偶校验,如果检测到出错,就会重试指令,Tofu互连链路上的错误恢复以及针对芯片的总共128000个错误检查器。

整个shebang字符串行运行Linux,基于Lustre的分布式文件系统和非易失性存储器用于加速文件输入输出。工具链支持C、C ++和Fortran编译器、MPI、OpenMP、调试器以及其他工具和语言。

你会注意到没有第三方加速器:它是纯粹的ARM,这就是富士通的方式,目的是设计一个运行超级计算机类型应用(模拟、科学实验分析、机器学习和其他数字运算)的芯片,具有比通用CPU更高的每瓦性能。

遗憾的是,Yoshida并不想谈论时钟频率和单个芯片的功耗。该机器距离完成还有几年的时间,所有规格和实施细节尚未确定或者透露。“我们将继续开发ARM处理器,”他这样表示。

好文章,需要你的鼓励

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

机器人智能公司Inbolt将于2026年6月在芝加哥Automate展会上发布两项新能力:Inbolt机器人编程功能和扩展版机器人控制模块。新功能可让工程师直接基于CAD模型构建程序,结合视觉模型实时定位实体零件并自动调整运动路径,彻底消除传统调试中耗时数周的手动示教环节。此次更新还将原生支持安川机器人,使平台覆盖品牌扩展至六个。

清华大学等团队如何让AI智能体拥有“记忆力“,从而真正学会自主探索未知世界?

清华大学等机构提出JAMEL框架,通过代码覆盖率信号联合训练AI智能体的潜在记忆模块与探索策略,以极低token消耗实现媲美大型闭源模型的自主探索能力。

笔记本电脑深度清洁指南:内外兼修焕然一新

本文提供了一套完整的笔记本电脑深度清洁方案。硬件方面,介绍了如何用温和洗涤剂清洁机身、用微纤维布擦拭屏幕、用压缩空气清理键盘及清洁充电线的正确方法。软件方面,建议及时更新操作系统与驱动程序,删除冗余文件与临时下载内容,并通过开启Windows Storage Sense功能实现自动清理,同时将剩余文件整理归类,保持系统整洁高效运行。

当AI“管家“学会分工协作:卡内基梅隆大学研究团队如何让电脑操作智能体突破单打独斗的瓶颈

卡内基梅隆大学提出MACU框架,让经理AI统筹多个员工AI并行完成复杂电脑操作任务,通过动态调整任务图,在四个基准上均超越单智能体。

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

笔记本电脑深度清洁指南:内外兼修焕然一新

加利福尼亚州城市通过全美首个由选民投票决定的数据中心禁令

柴油替代方案:AI数据中心如何利用燃气引擎与蒸汽涡轮供电

AI定义汽车时代,车载以太网可靠性面临全新挑战

安全算法的持续更新正变得愈发困难

轨道数据中心本质上是功能强化的卫星

Infineon Live Lab正式发布:全球首个实时云端实体硬件评估平台

Serve Robotics携手NoScrubs,自主配送机器人跨界拓展洗衣服务

Workr Robotics CEO:工业机器人自动化应按小时付费

专访CreateMe CEO:从缝纫到粘合,实体AI如何重塑服装制造

AI浪潮为集成商带来全新连接挑战

一颗192核的Arm服务器CPU

Arm技术媒体分享日:探索AI时代的计算前沿与生态布局

引领AI时代计算新纪元:Arm终端计算子系统重塑智能设备性能边界

Arm亮相COMPUTEX 2024: 预计2025年底超过1000亿台Arm设备可用于AI

Arm推出人工智能优化的Arm终端计算子系统以及新的Arm Kleidi软件,重新定义移动端体验

《日经亚洲》报道Arm明年将推首款产品进军人工智能芯片市场

让智能手机与PC具备领先的AI计算性能 下一代Arm Cortex-X内核信息“浮出水面”

Arm的使命是助力应对AI 无止尽的能源需求

能效和定制化将推动ARM在人工智能领域发挥关键作用

加速边缘AI部署 Arm推出Ethos-U85 NPU和Corstone-320