Hot Chips大会:芯片堆栈成焦点 是IP块的未来 原创

至顶网服务器频道 08月24日 新闻消息: 美国的一项研究工作旨在培训一个从即插即用芯片设计半导体的生态系统。现在已经到了像英特尔和赛灵思等竞争对手都在使用专有封装技术来区分FPGA竞品的时候了。

在接下来的8个月内,美国国防高级研究计划局(DARPA)下的Common Heterogeneous Integration and IP Reuse Strategies (CHIPS)计划旨在定义和测试开放芯片接口。在未来3年内,它希望多个公司将利用这来连接一系列模片以形成复杂的组件。

英特尔已经注册了该计划,预计很快其他厂商也会跟进。在英特尔内部,正在讨论是否要开放部分的内嵌多芯片互连桥(EMIB)。英特尔在Hot Chips上介绍了到目前为止关于EMIB最为详细的信息。

作为缓存一致串行互连(CCIX)的领导者,赛灵思公司的多位高管对DARPA的这个计划很感兴趣,并且公布了第四代FPGA,使用来自TSMC专有的CoWoS 2.5-D封装技术。至于究竟什么方法让主流半导体设计降低成本、提高带宽连接,现在还不清楚。

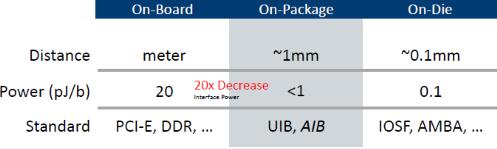

英特尔把EMIB定位为介于主板和模片连接之间(图片来源:英特尔)

近年来问世了使用有机底物的多芯片模块。有些厂商表示,除了相对较低的密度之外,还将推动降低成本。

TSMC率先推出了一种晶圆层的扇出,用于把应用处理器和内存封装在苹果最新的iPhone手机中。这项技术实现的密度要高于MCM,但是还不足以匹敌有线处理器。

高端AMD和Nvidia GPU已经加入了赛灵思的FPGA,使用像CoWoS这样的2.5-D技术在连接处理器和内存堆栈。但是到目前为止,这些对于消费级产品来说都还太贵,微软一位拒绝将该方法用于Xbox的工程师这样表示。

与微软一样,AMD绕过了相对昂贵的2.5D堆栈,Epyc服务器处理器在有机底物上是由四颗模片构成的。更为传统的MCM"是一项知名的技术,且成本更低,在性能上有一些折中,但我们认为这是可以接受的,"Kevin Lepak这样描述这款芯片。

有多方都表示希望DARPA计划可以突破复杂的技术和业务障碍。"我们希望芯片更像是IP,"一位来自赛灵思的高级架构师表示。

在2014年,英特尔率先将其EMIB称之为可以在更低成本基础上提供2.5-D堆栈的方法。部分原因是它采用了一条芯片插入片来桥接任何大小模片的两端。

Altera在被英特尔收购之前尝试了这种方法。后来成为英特尔的一个部分,现在出货高端Stratix FPGA,使用EMIB连接到DRAM堆栈和收发器。

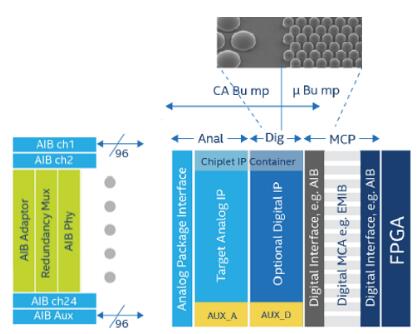

英特尔专门用于EMIB的AIB接口(图片来源:英特尔)

在Hot Chips大会上,英特尔详细介绍了两种EMIB接口。一种称为UIB,是基于三星或者海力士针对DRAM堆栈的Jedec链路。另外一种称为AIB,是英特尔专门针对收发器的接口,通用于模拟、RF和其他设备。

这两个都是相对简单的并行I/O电路,英特尔认为相比为EMIB使用穿行链路来说,这样做的延迟更低,扩展性更好。到目前为止,在三个代工厂设计的、使用该接口的模块都是支持6个节点。

英特尔尚未决定是否公布AIB,如果这么做的话,是否要把它开源。它在物理层的可编程运行速率最高可达到2Gbits/s,在EMIB链路上可实现多达20000个连接。英特尔FGPA部门高级架构师Sergey Shuarayev表示:"带宽是巨大的,我们可以构建庞大的系统,比标线尺寸更大。"他暗示,EMIB设备可能是2.5D堆栈的6倍,密度也在提高。下一代EMIB制程将支持35微米的凸块,是当前实验室10mm链路条件下密度的2.5倍。

Shuarayev称,称EMIB可以用于连接FPGA到CPU、数据转换器以及光学组件。相比2.5D堆栈,成本更低,且产量更高,部分原因是它可以将复杂的模拟块从FPGA中提取出来。

赛灵思这方面,在Hot Chips大会上公布了第四代堆栈VU3xP,最多有3个16nm FPGA和2个DRAM堆栈,将在4月前提供样品。此外这还是首个采用CCIX接口、支持4个一致连接到主机处理器和加速器的芯片。

基于PCIe的CCIX最初运行速度为25 Gbits/s。有大约33家厂商支持该接口,现在是由Cadence和Synopsys提供IP。"有多个处理器正在将这种技术融入其中,"赛灵思公司副总裁Gayrav Singh这样表示。

另外,赛灵思设计了自己到DRAM堆栈的链路,使用硬件的AXI交换机,与一系列内存控制器进行通信。

赛灵思连接15个256位AXI端口,运行450 MHz,8个内存控制器连接到最新的FPGA到一个DRAM堆栈(图片来源:赛灵思)

英特尔和赛灵思的演讲人都指出,是一些挑战带来了他们的模块化芯片设计。

CoWoS制程要求芯片保持在最高95摄氏度以下。DRAM堆栈中每下降一层温度会增加2度,Singh表示。

而Shumarayev表示,英特尔要求供应商为自己的堆栈提供知名的、质量好的模片,而封装坏模片会长期影响多芯片封装。

好文章,需要你的鼓励

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

很多人担心被AI取代,陷入无意义感。按照杨元庆的思路,其实无论是模型的打造者,还是模型的使用者,都不该把AI放在人的对立面。

清华大学字节跳动首创视频换脸新纪元:让照片主角完美融入任何视频场景

这项由清华大学和字节跳动联合开展的研究首次实现了高保真视频换脸技术的重大突破。DreamID-V框架通过创新的身份锚定视频合成器和多模态条件注入机制,成功解决了传统视频换脸技术中身份相似度低、时间不连贯等核心问题,在保持原视频动作表情的同时实现完美的身份替换,为影视制作、创意设计等领域带来革命性变化。

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

谷歌宣布对Gmail进行重大升级,全面集成Gemini AI功能,将其转变为"个人主动式收件箱助手"。新功能包括AI收件箱视图,可按优先级自动分组邮件;"帮我快速了解"功能提供邮件活动摘要;扩展"帮我写邮件"工具至所有用户;支持复杂问题查询如"我的航班何时降落"。部分功能免费提供,高级功能需付费订阅。谷歌强调用户数据安全,邮件内容不会用于训练公共AI模型。

阿尔伯塔大学新突破:让AI学会自我检查错误,准确率远超人工审核

阿尔伯塔大学研究团队开发出名为Gnosis的AI自我检查系统,能让人工智能实时监测自己的内部"思维状态",判断答案可靠性。该系统通过分析AI的隐藏状态和注意力模式,在数学推理任务中达到95%准确率,超越传统方法和大型审核模型,且仅需500万参数。更重要的是,它能在AI回答40%时就预测最终答案质量,支持早期错误检测,为构建更诚实可靠的AI系统开辟了新路径。

CES 2026 | 重大更新:NVIDIA DGX Spark开启“云边端”模式

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

研究发现商业AI模型可完整还原《哈利·波特》原著内容

Razer在2026年CES展会推出全息AI伴侣项目

CES 2026:英伟达新架构亮相,AMD发布新芯片,Razer推出AI奇异产品

通过舞蹈认识LimX Dynamics的人形机器人Oli

谷歌为Gmail搜索引入AI概览功能并推出实验性AI智能收件箱

DuRoBo Krono:搭载AI助手的智能手机尺寸电子阅读器

OpenAI推出ChatGPT Health医疗问答功能

Anthropic寻求3500亿美元估值融资100亿美元

OpenAI收购高管教练AI工具Convogo团队

抛弃传统的市场推广手册,迎接AI时代的新策略