数据中心内存敏感型需求激增,英特尔至强6性能核引入了怎样的新技术? 原创

2024年9月26日,英特尔至强6性能核处理器在国内发布。

作为英特尔特别针对高性能计算进行了优化的处理器,英特尔至强6性能核处理器引入了多项新技术,这其中就包括特别针对内存进行优化的MRDIMM技术。

什么是MRDIMM?

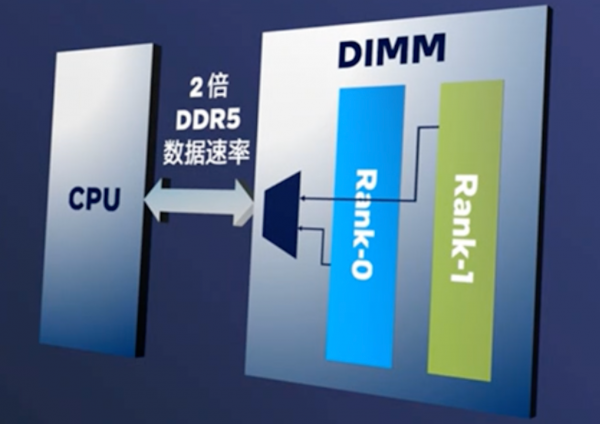

MRDIMM是多路复用双列直插式内存模组,可以在单个通道上组合和传输多个数据信号,从而在无需额外物理连接的前提下提升带宽。

MRDIMM并非最近才有,而是由如今的英特尔数据中心与人工智能内存领域首席工程师George Vergis于2018年开始研发,在MRDIMM技术出现之前,行业内普遍应用的RDIMM技术虽然可以让独立存储和数据访问发生在多个阵列之间,但却无法同时进行。

既然并行资源没被使用,为什么不将它们集中起来呢?

基于这样的想法,Vergis想到可以在DRAM模组上放置一个多路复用器来使数据可以同时跨两个内存阵列进行传输。

在经过近四年的研发后,Vergis在2021年完成了MRDIMM技术的原型研发,并在今年首次将这项技术应用到了英特尔至强6性能核处理器上。

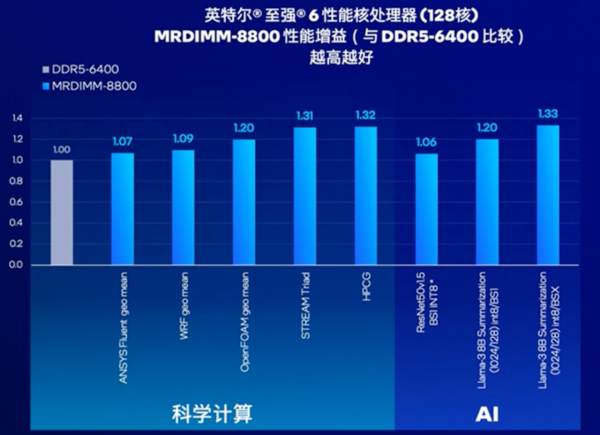

之所以这项技术会首先被应用到英特尔至强6性能核处理器上,是因为它可以与现有的DDR5兼容,而由于引入MRDIMM又实现了8800MT/s速率,相较于DDR5的6400MT/s速率相比,提升了37%,可以与英特尔至强6性能核处理器的性能相匹配,实现了性能和收益的平衡。

由于可以同时访问两个内存阵列,MRDIMM让处理器带宽实现了翻倍,在AI推理或调优场景中,例如生成式AI带来的RAG场景,当需要大内存容量时,采用MRDIMM既拥有高性能,容量更大,同时也可以处理更加通用的场景。

因而,MRDIMM尤其对科学计算、AI等内存敏感型应用场景表现优异。

如此高的内存速率,也为基于此对技术创新提供了更多可能。

据英特尔技术专家透露,“这样的技术创新需要和我们和应用厂商紧密配合,对于内存带宽敏感型应用,我们可以利用MRDIMM提供的高带宽进行进一步的代码级别的优化和改进。”

值得注意的是,目前MRDIMM已经纳入JEDEC标准,按照目前MRDIMM的发展路线图,未来MRDIMM将会在8800MT/s的基础上再次翻倍,以更好地满足下一代处理器的卓越性能。

随着处理器核数的增加、处理能力和主频的提升,数据中心将对打破“内存墙”、突破内存容量和性能问题限制的技术提出更高的需求,MRDIMM正在成为未来数据中心处理器的一项关键技术标准。

好文章,需要你的鼓励

DuRoBo Krono:搭载AI助手的智能手机尺寸电子阅读器

荷兰公司DuRoBo在CES 2026展示新款电子阅读器Krono,采用智能手机外观设计并内置AI助手。该设备定位为"电子纸专注中心",支持阅读、思考和音乐播放。配备智能转盘便于操作,AI助手Libby可回答问题并支持深度思考。搭载Android 15系统,可访问谷歌应用商店。售价239.99欧元,本月发货。

AWS推出AI图像编辑新突破:用说话就能精准移动图片中的物体!

这项由香港中文大学和AWS团队联合开发的研究推出了TALK2MOVE系统,实现了用自然语言精准操作图片中物体的位置、角度和大小。该系统采用强化学习训练方式,通过空间感知奖励机制和智能步骤采样技术,在移动、旋转、缩放三类操作上的准确率显著超越现有方法,同时大幅降低了对昂贵训练数据的依赖,为AI图像编辑领域带来重要突破。

OpenAI推出ChatGPT Health医疗问答功能

OpenAI预览了即将推出的ChatGPT Health功能,可帮助用户获取医疗信息。该功能能解释化验结果、制定运动计划、推荐就医问题等。用户可通过B.well平台导入健康记录,与Apple Health等健康应用集成。OpenAI将单独存储医疗数据,采用专用加密和隔离机制保护隐私。功能基于HealthBench数据集开发,包含超过48000个医生编写的评估标准。目前通过等待名单限量测试。

斯坦福大学等联合发布:AI助手在企业政策执行上竟然“偏科“得如此严重

斯坦福大学等知名机构联合研究发现,企业AI助手在执行组织政策时存在严重"偏科"问题:处理允许请求时成功率超95%,但拒绝违规请求时仅13-40%。研究团队开发的COMPASS评估框架通过8个行业5920个测试问题,揭示了AI助手普遍缺乏"拒绝技能"的问题,并提出了针对性训练解决方案。

OpenAI推出ChatGPT Health医疗问答功能

OpenAI收购高管教练AI工具Convogo团队

抛弃传统的市场推广手册,迎接AI时代的新策略

谷歌将Gemini AI功能推送至Gmail,用户可选择关闭

AI竞赛点燃欧洲数据中心债券市场热潮

IBM API Connect关键漏洞可导致身份验证绕过

CES 2026智能戒指新品:Pebble Index 01记录想法不追踪健康

AI聊天机器人让人上瘾的隐秘手段揭秘

AI将在2026年重塑网络安全策略

CES主题演讲分析:智能体AI如何为现实世界影响奠定基础

Snowflake收购Observe以增强其可观测性能力

三星Galaxy Tab A9 Plus限时降价70美元