对手?朋友?英特尔代工业务会加速半导体产业洗牌吗? 原创

半导体市场已经变天,特别是数据中心芯片市场格局变化已成定局

看下近期各个半导体企业的财报:

NVIDIA发布2024财年第四季度及全年财务报告,季度收入创下221亿美元的纪录,较第三季度增长22%,较去年同期增长265%;数据中心季度收入创下184亿美元的纪录,较第三季度增长27%,较去年同期增长409%;全年收入创下609亿美元的纪录,增长126%。

英特尔发布2023年第四季度财报。财报显示,英特尔第四季度营收154.1亿美元,同比增长10%;英特尔四季度数据中心营收为40亿美元,同比下滑10%。

AMD公布2023年第四季度营业额达62亿美元,2023年全年,AMD营业额为227亿美元;2023年,AMD数据中心事业部营业额为65亿美元,与2022年相比增长7%。

这样的数据对比,对于英特尔来说是巨大的压力。为了扭转颓势,英特尔代工(Intel Foundry)似乎成了英特尔的一种尝试。

英特尔代工衍生于几年前英特尔首席执行官帕特·基辛格的IDM 2.0策略,虽然英特尔在极力改变现有的市场现状,但是变革来临,谁也无法置身事外。

英特尔的业务单元表现差强人意,为了激活自身的活力,业务单元独立化是英特尔采取的策略之一,比如PSG(FPGA业务,Altera)独立化运营,而代工业务也是如此。

业界不怀疑英特尔的能力,特别是在代工方面,因为业界也需要除了台积电之外,多一个选择。显然英特尔代工成了这种期待的结果。

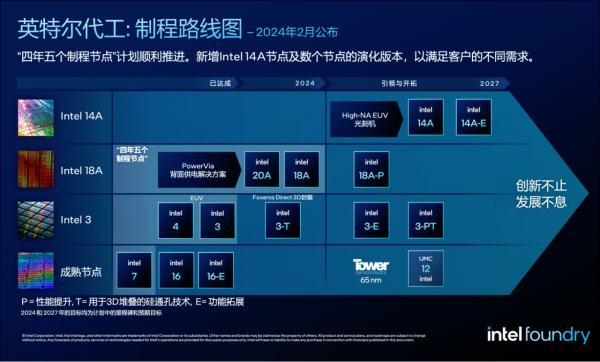

最新的消息是微软计划采用Intel 18A制程节点生产其设计的一款芯片。同时,Synopsys、Cadence、Siemens和Ansys等IP和EDA供应商也确认支持英特尔制程和封装技术。

英特尔预计将于2025年通过Intel 18A制程节点重获制程领先性。采用Intel 18A工艺的Clearwater Forest至强处理器已流片。该处理器还采用Intel 3作为其基础芯片的制程工艺,并采用EMIB、Foveros Direct先进封装技术。

在笔者看来,当前的芯片市场是结构化变革,也就是芯片需求是持续增加的,但是品类不像早前那样单一,比如CPU、GPU、FPGA等。

如今不管是AI还是汽车,芯片的需求是巨大的,但是这种需求是不同于以往的产品需求,需要芯片厂商转变产品思路,比如从CPU到GPU。

所以对于英特尔而言,原有的优势已经不复存在,需要在新的客户需求和产业变化下重新建立自己的护城河,这是巨大的挑战。毕竟对于英特尔这样体量的企业而言,这种的转型需要从技术、组织、产品等多个维度进行变化。

其实,我觉得代工是一个很好的突破点,在代工下,很多竞争对手成了朋友,比如英特尔与NVIDA、Arm建立了代工关系,这在此前是不可想的。

当下,产业和企业的边界在消失,竞合关系也在变化,英特尔通过代工业务增加了产业链的协同能力,而不是此前的一体化闭环体系。

截止目前,英特尔已经拥有了Mobileye、PSG、Intel Foundry等独立业务单元,这些领域是具有潜力的,这是英特尔自身变革的尝试,至于后续发展如何,我不敢断言,但是迈出了这一步总比固步自封要好很多。

好文章,需要你的鼓励

破解AI代码“指纹“:阿布扎比科技创新研究院首次揭示大语言模型JavaScript代码独有“DNA“

阿布扎比科技创新研究院团队首次发现大语言模型生成的JavaScript代码具有独特"指纹"特征,开发出能够准确识别代码AI来源的系统。研究创建了包含25万代码样本的大规模数据集,涵盖20个不同AI模型,识别准确率在5类任务中达到95.8%,即使代码经过混淆处理仍保持85%以上准确率,为网络安全、教育评估和软件取证提供重要技术支持。

全球数据中心电力需求暴涨,超越电网建设速度

国际能源署发布的2025年世界能源展望报告显示,全球AI竞赛推动创纪录的石油、天然气、煤炭和核能消耗,加剧地缘政治紧张局势和气候危机。数据中心用电量预计到2035年将增长三倍,全球数据中心投资预计2025年达5800亿美元,超过全球石油供应投资的5400亿美元。报告呼吁采取新方法实现2050年净零排放目标。

斯坦福大学惊人发现:AI比人类更懂语言?还是人类判断更准确?

斯坦福大学研究团队首次系统比较了人类与AI在文本理解任务中的表现。通过HUME评估框架测试16个任务发现:人类平均77.6%,最佳AI为80.1%,排名第4。人类在非英语文化理解任务中显著优于AI,而AI在信息处理任务中更出色。研究揭示了当前AI评估体系的缺陷,指出AI的高分往往出现在任务标准模糊的情况下。

千万装机量的龙蜥,如何面向AI进化?

AMD 锐龙AI MAX+ 395问鼎“技术王座”"春雨计划"润泽智慧万象

青云AI Infra 3.0,为企业搭建一条通向AI能力落地的桥梁

百分点科技发布业内首个数据治理大模型,开启“智理”新范式

全球数据中心电力需求暴涨,超越电网建设速度

AMD双轮驱动:路线图与资金互促,收入持续提升

FMC获得FERAM资金以终结Optane的阴霾

AI驱动垂直市场的商业变革与未来机遇

谷歌计划在德州投资400亿美元建设数据中心

AI推动KubeCon NA 2025平台工程复兴浪潮

DeepL CEO:专业翻译服务如何在ChatGPT时代保持竞争优势

提示工程迎来协作提示新技术,让AI成为你的合作伙伴