警惕传感器漏洞 汽车图像传感器决胜网络安全赛道

向自动驾驶过渡的趋势,加上公众对无人驾驶汽车安全性的担忧,使网络安全成为汽车原始设备制造商(OEM)的首要关注点。必须保障汽车系统的完整性和对车辆的控制,从而确保驾驶员、乘客和行人的安全。网络安全对于通过网络连接的汽车子系统等必不可少,对用于先进驾驶辅助系统 (ADAS) 和驾驶员监控的图像传感器也同样至关重要。

图像传感器相当于汽车的眼睛,支持 ADAS 功能,例如车道偏离警告、行人检测和紧急制动。它们帮助汽车系统评估周围环境并监控驾驶员的行为。未来,它们还将协助识别和验证汽车用户的身份并监控他们的生命体征,以便在驾驶员丧失行为能力时通过车载计算机来控制汽车。因此,图像传感器必须保持正常使用,尤其是在汽车可能遇到的极端情况下。

网络安全威胁

汽车图像传感器主要受到四种网络安全威胁的影响:伪造、篡改、绕过和窃听(特别是对于车内应用)。

由于汽车半导体行业当前的供应短缺问题,假冒产品呈上升趋势。虽然安装非正版部件可能并非出于恶意,但它会影响系统性能。由于非正版部件使用的是不同的启动过程、协议、固件和软件,最轻微的后果是 ADAS 系统根本无法运行。最糟糕的情况是,系统使用性能严重退化的不合格部件,导致系统的安全功能受到损害。

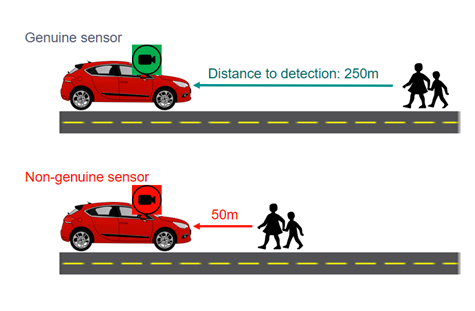

自动紧急制动 (AEB) 系统运行的前提是其图像传感器具有明确的特性(如高动态范围和低光性能)并按照这些规格(如曝光控制和每秒帧数)进行校准。假冒的传感器可能看起来与正品相同,但其性能和特性却大相径庭。例如,假冒伪劣的摄像头可能使用的是相同的传感器,但没有经过测试以保证最终的组件满足性能要求,这可能表现为会在高强度工作下出现故障。也就是说,它在正常条件下可以工作,但在其它条件(例如炎热、阳光充足的白天或寒冷的冬夜)下会出现性能降级或干脆失效。一些复杂的仿冒品可能会模仿真实的传感器支持初始化操作或简单的设备健康检查,但其在动态范围或帧速率方面的性能会大打折扣。由于 AEB 系统是使用正品部件进行的优化,因此假冒替代品的性能下降同样会影响系统的性能,可能还会带来灾难性的后果。比如,本来可以在车前较远的距离就检测到物体或行人,留下几秒钟的反应时间,现在可能只能在几米内检测到,没有足够的时间避免碰撞(图 1)。

图 1:用假冒产品代替正版图像传感器的后果

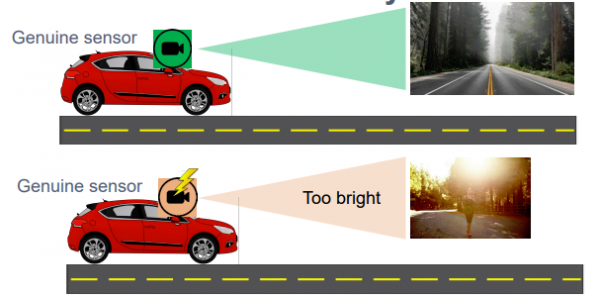

篡改图像传感器配置也会损害其性能。汽车系统通过编程来配置图像传感器,以优化机器视觉算法的图像质量,这些算法已针对特定实现方案进行了认证和测试。但是,如果有人(或某程序)修改了配置,则性能可能会受到影响。可能无法再保证汽车系统能正确感知汽车面临的场景(图 2)。

图 2:篡改图像传感器设置的后果

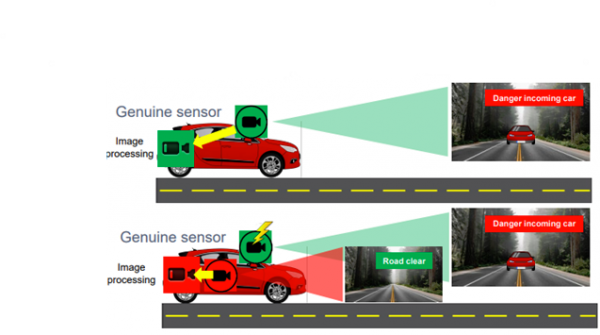

图像传感器不正常工作会让汽车“失明”,无法检测到潜在威胁。图像传感器向图像处理器提供原始视频数据,这些数据可用于提取有关前方障碍物的关键信息,以便汽车能够做出适当的响应。例如,从传感器接收原始视频数据的系统可以发现正在靠近的车辆,并按照最安全的操作来选择是踩刹车还是驾驶汽车远离危险。如果图像传感器不正常工作,系统将不再接收到原始视频数据,并且可能根本无法检测到正在靠近的车辆(图 3)。

图 3:图像传感器不正常工作的后果

确保符合规范

2021 年,联合国欧洲经济委员会 (UNECE) 工作组发布了 UN-R155 网络安全法规,要求 OEM 建立网络安全管理系统 (CSMS)。该法规自 2022 年 7 月起生效,以应对上述日益增长的威胁。汽车供应商必须确保所有相关组件符合 ISO 21434 网络安全标准。虽然仅使用符合 ISO 21434 标准的部件还不足以满足 UNECE 的要求,但这是符合规范的关键要素。

安森美 (onsemi) 自 2018 年开始在部分 ADAS 图像传感器中部署网络安全功能,使其符合网络安全规范。这些传感器有望在 2024 年之前达到网络安全标准。身份验证功能使安森美的图像传感器能够向主机证明它是正品。这一过程通过使用证书链或预共享密钥来实现。为确保视频数据的完整性,必须使用消息身份验证码(或 MAC)来证明传感器和主机之间的视频数据流未被篡改。最后是保护传感器控制和配置数据,防止使用 MAC 篡改特定密钥寄存器。由于防篡改协议因系统而异,因此系统处理器在检测篡改情况时将拥有最终决定权。

总之,网络安全规范对于防止汽车图像传感器成为汽车复杂电子系统中的特洛伊木马至关重要。对 OEM 而言,要想符合规范,需要的不仅仅是图像传感器中的网络安全控制电路。而含网络安全的图像传感器是使 ADAS 和车内监控系统完全符合网络安全规范的基本要求。

来源:业界供稿

好文章,需要你的鼓励

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

机器人智能公司Inbolt将于2026年6月在芝加哥Automate展会上发布两项新能力:Inbolt机器人编程功能和扩展版机器人控制模块。新功能可让工程师直接基于CAD模型构建程序,结合视觉模型实时定位实体零件并自动调整运动路径,彻底消除传统调试中耗时数周的手动示教环节。此次更新还将原生支持安川机器人,使平台覆盖品牌扩展至六个。

浙江大学团队研发:AI机器人能否像人一样“找准角度“拍出同款照片?

浙江大学团队提出目标视角复现任务(TVR),测试AI主动导航至指定视角的能力,最强模型成功率仅12%,人类达93%,并验证了视觉示范学习与多轮强化学习的提升路径。

笔记本电脑深度清洁指南:内外兼修焕然一新

本文提供了一套完整的笔记本电脑深度清洁方案。硬件方面,介绍了如何用温和洗涤剂清洁机身、用微纤维布擦拭屏幕、用压缩空气清理键盘及清洁充电线的正确方法。软件方面,建议及时更新操作系统与驱动程序,删除冗余文件与临时下载内容,并通过开启Windows Storage Sense功能实现自动清理,同时将剩余文件整理归类,保持系统整洁高效运行。

香港城市大学与快手团队联手:让AI“导演“教会视频生成模型真正“思考“

这项研究提出"VLM即教师"框架,让视觉语言模型在视频生成推理时充当实时监考官,通过可微分奖励信号在线优化轻量LoRA模块,平均提升视频推理性能16.7分。

AI驱动网络犯罪数量飙升,勒索软件受害者年增389%:Fortinet 发布2026年全球威胁态势研究报告

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

笔记本电脑深度清洁指南:内外兼修焕然一新

加利福尼亚州城市通过全美首个由选民投票决定的数据中心禁令

柴油替代方案:AI数据中心如何利用燃气引擎与蒸汽涡轮供电

AI定义汽车时代,车载以太网可靠性面临全新挑战

安全算法的持续更新正变得愈发困难

轨道数据中心本质上是功能强化的卫星

Infineon Live Lab正式发布:全球首个实时云端实体硬件评估平台

Serve Robotics携手NoScrubs,自主配送机器人跨界拓展洗衣服务

Workr Robotics CEO:工业机器人自动化应按小时付费

专访CreateMe CEO:从缝纫到粘合,实体AI如何重塑服装制造