英特尔:将在未来几周内发布第三代Optane

英特尔副总裁Kristie Mann近日在Storage Field Day活动中透露,英特尔很快即将发布第三代Optane产品,并且正在开发Optane系列的另一个迭代版本。

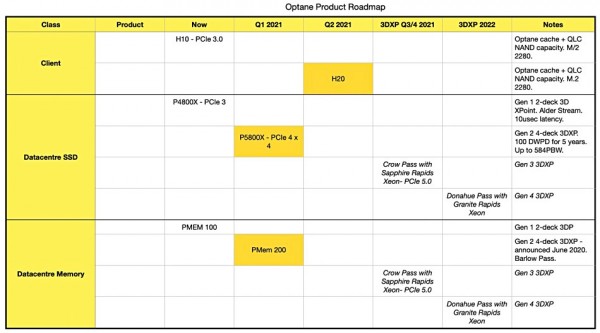

Optane是英特尔对3D XPoint技术的一种实施,该技术最终是英特尔与美光合作开发的。去年,美光退出了3D XPoint芯片和驱动器制造业务,并出售了位于美国犹他州莱希的XPoint代工厂,此前这个代工厂主要是为英特尔提供组件。第一代XPoint之后,第二代于2020年推出,用于SSD版本代号为Alder Stream,用于持久内存的版本代号为Barlow Pass。

Mann在演讲中表示,英特尔“即将公布第三代技术,并致力于开发下一代支持CXL内存分层的产品”,这与英特尔本月早些时候透露的信息是吻合的。Mann的团队上周五还谈到了两个新的Optane用例,但没有给出更多关于第二代和第三代产品或者时间表的信息。

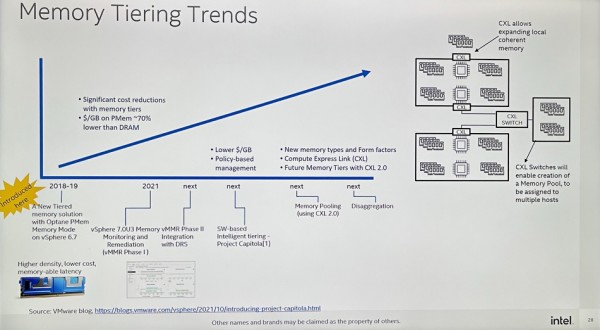

英特尔内存分层技术的时间线

据悉,英特尔正在与VMware展开密切合作,开发使用Optane持久内存的vSphere和相关软件。英特尔方面提及了Capitola项目,并且英特尔也在与其他虚拟机管理程序厂商进行合作。当被问及这些合作伙伴关系时,英特尔云架构顾问Flavio Fomin说,“是的,除了VMware之外还有很多”。在他看来,“分层内存将是新常态”,这意味着DRAM将被视为零层内存,Optane持久内存作为第一层。

估计虚拟机管理程序需要进行调整,利用DRAM和XPoint内存之间的差异,而无需更改应用级的代码,我们猜测有微软Hyper-V、Nutanix AOS和Red Hat KVM可能都在与英特尔合作支持Optane持久内存。

使用实例

第一个新的使用实例,是英特尔内部的示例,涉及搜索通过Kafka和Splunk摄取的数据,并将信息存储在具有650TB Optane SSD和QLC NAND SSD的VAST Data系统中。在使用直连SSD的HP Ezmeral系统上搜索这些数据需要29.5秒,在英特尔配置的系统上需要25.1秒。我们注意到,VAST的软件减少了已经压缩过的Splunk数据量,650TB VAST Box可以存储超过1.6PB的Splunk数据。

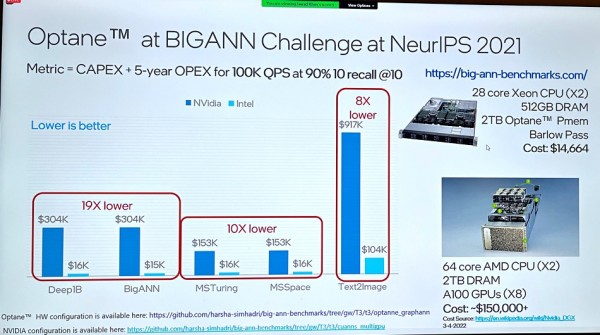

第二个使用实例是大规模的相似度搜索,百度、eBay、亚马逊、YouTube等网站通过这种方法进行搜索推荐,这个过程涉及到要搜索十亿到万亿个项目的数据集,数据存储为特征向量,单独存储为图形。英特尔首席工程师Jawad Khan博士表示,英特尔在NeurlPS 2021 的Billion-Scale Approximate Nearest Neighbor Search Challenge中赢得了一项指标冠军。

英特尔的技术与竞争对手相比较

他对比了配备512GB DRAM和2TB Optane持久内存的双路28核英特尔至强服务器,市价为14,664美元,以及配备Nvidia A100 GPU、双64核AMD主机处理器、2TB DRAM的服务器,总系统成本约150,000美元。

在相同的性能水平下,Optane系统的成本比Nvidia系统低8到19倍。

我们认为,英特尔仍然致力于推动Optane及其3D XPoint技术的发展,大力扩展支持合作伙伴生态系统,推进密度更高的第三代和第四代XPoint技术,这意味着英特尔正在制定或者已经制定了相关的生产计划,已经有了关于第二代持久内存和SSD产品系列的详细计划,以及概览了第四代同类产品。

Optane路线图

本月晚些时候或者四月将会有更多的信息,预计届时Crow Pass XPoint产品将亮相。

来源:业界供稿

好文章,需要你的鼓励

腾讯开源混元MT翻译模型系列

腾讯今日开源混元MT系列语言模型,专门针对翻译任务进行优化。该系列包含四个模型,其中两个旗舰模型均拥有70亿参数。腾讯使用四个不同数据集进行初始训练,并采用强化学习进行优化。在WMT25基准测试中,混元MT在31个语言对中的30个表现优于谷歌翻译,某些情况下得分高出65%,同时也超越了GPT-4.1和Claude 4 Sonnet等模型。

如何让AI像电影配乐师一样创作完整的长篇音频故事——腾讯ARC实验室团队AudioStory突破性进展

腾讯ARC实验室推出AudioStory系统,首次实现AI根据复杂指令创作完整长篇音频故事。该系统结合大语言模型的叙事推理能力与音频生成技术,通过交错式推理生成、解耦桥接机制和渐进式训练,能够将复杂指令分解为连续音频场景并保持整体连贯性。在AudioStory-10K基准测试中表现优异,为AI音频创作开辟新方向。

Unity Stoakes谈科技、科学与设计的融合变革全球健康

今年是Frontiers Health十周年。在pharmaphorum播客的Frontiers Health限定系列中,网络编辑Nicole Raleigh采访了Startup Health总裁兼联合创始人Unity Stoakes。Stoakes在科技、科学和设计交汇领域深耕30多年,致力于变革全球健康。他认为,Frontiers Health通过精心选择的空间促进有意义的网络建设,利用网络效应推进创新力量,让企业家共同构建并带来改变,从而有益地影响全球人类福祉。

Meta与特拉维夫大学联手打造VideoJAM:让AI生成的视频动起来不再是奢望

Meta与特拉维夫大学联合研发的VideoJAM技术,通过让AI同时学习外观和运动信息,显著解决了当前视频生成模型中动作不连贯、违反物理定律的核心问题。该技术仅需添加两个线性层就能大幅提升运动质量,在多项测试中超越包括Sora在内的商业模型,为AI视频生成的实用化应用奠定了重要基础。

百度学术:行业首个一站式AI学术平台,6.9亿文献资源加持

腾讯开源混元MT翻译模型系列

Unity Stoakes谈科技、科学与设计的融合变革全球健康

微软结束OpenAI独家合作,Office将引入Anthropic模型

亚马逊推出Zoox无人出租车服务,在拉斯维加斯提供免费乘车体验

OpenAI与Oracle签署3000亿美元云计算合作协议

Akamai联合IDC研究:生成式AI驱动边缘演进,亚太80% CIO将依赖边缘服务支持AI工作负载

Gartner发布2025中国网络安全技术成熟度曲线

Lucidity将成本控制焦点转向Kubernetes存储

Spotify因万名用户出售数据构建AI工具而愤怒

Anthropic服务大规模宕机,开发者调侃重回"原始编程时代"

AI说谎的原因:它只是在迎合你想听的答案