CES 2024|NVIDIA携GeForce RTX 40 SUPER登场 以AI“巨力主宰游戏与创作“新纪元” 原创

如果说在CES 2024上有哪些技术万众瞩目,那么毫无疑问便是如巨浪一般强势席卷全场的AI PC。

作为AI界的“扛把子”,NVIDIA毫无疑问没有缺席这场“潮头”。无论是炫目的RTX GPU到前沿的软件应用,还是创新的开发工具,这些几乎均与高性能生成式AI功能相关的新产品新技术,正让NVIDIA以一种“披着AI光环”的姿态轰然登场,再次描绘着科技世界的边界。

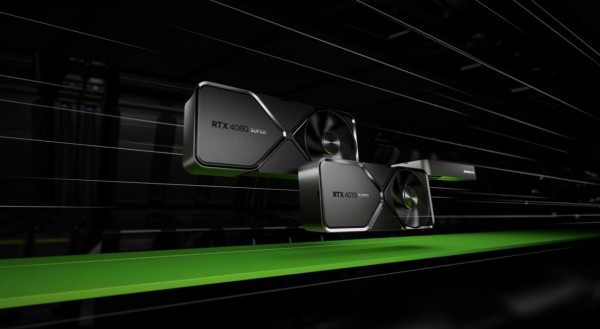

来源:NVIDIA官网

GeForce RTX SUPER GPU有多快?快得让你眼花缭乱!

NVIDIA新推出的 GeForce RTX SUPER GPU,不仅是PC上体验AI的极致选择,它专用的AI Tensor Core更是“性能怪兽”,达到了惊人的836 AI TOPS。这意味着无论是游戏、内容创作还是日常的生产力任务,AI的能力都得到了革命性的提升。

那么,基于RTX GPU构建的丰富软件堆栈,又如何能够进一步推动AI的加速?NVIDIA的TensorRT作为专门针对高性能深度学习推理的软件,其深度学习推理优化器和运行时环境,可以为推理应用程序提供低延迟和高吞吐量。

而对于那些最新的大型语言模型,TensorRT-LLM for Windows这一开源库则将其推理性能提升至一个新的水平。

从实际表现上看,在AI工作负载中,GeForce RTX 4080 SUPER在视频生成速度上比RTX 3080 Ti快了1.5倍,图像生成速度更是快了1.7倍。对于游戏爱好者来说,AI驱动的DLSS技术将游戏的沉浸感提升到了一个新的层次,让玩家仿佛置身于游戏世界之中。

对于那些如Photoshop用户等较为依赖生成性AI应用程序的创意工作者而言,Tensor Core的加速功能还能助力其提高生产力,保持创意工作流程的流畅性。同时,NVIDIA Broadcast能够消除背景噪音,并提供无缝的虚拟背景,真正实现了高效而清晰的通信。

事实上,这些突破性的技术创新,正改变着传统PC的使用方式,更能在AI领域中开辟新的可能性。

解锁AI潜力 GeForce RTX“超级战队”加入“战场”

如果说,要在Windows PC上展现AI的潜力,那么布局游戏毫无疑问是一个明智的选择。这一次,GeForce RTX SUPER GPU更是带着其超强的性能,以三位超级英雄的姿态,加入战场,为游戏玩家带来前所未有的算力体验。

“4K巨兽”——GeForce RTX 4080 SUPER

GeForce RTX 4080 SUPE以4K分辨率提供了全光线追踪的游戏体验,让游戏世界的细节和真实感达到了新的高度。与GeForce RTX 3080 Ti相比,在没有DLSS帧生成的情况下,RTX 4080 SUPER快了1.4倍,这简直是传统光栅化性能的一场革命。

而GeForce RTX 4080 SUPE那强大的836 AI TOPS加上DLSS帧生成,让它的速度比RTX 3080 Ti快了整整两倍。更多的核心和更快的内存,让它在性能上占据了绝对优势。

“精确大师”——GeForce RTX 4070 Ti SUPER

GeForce RTX 4070 Ti SUPER拥有1440p超高帧率游戏的理想选择,同时也完美支持4K。

比起RTX 4070 Ti,它拥有更多的核心和16GB的帧缓冲区,以及一个256位的内存总线,将内存带宽大幅提升至672 GB/秒。

相比之下GeForce RTX 4070 Ti SUPER比RTX 3070 Ti快了1.6倍,使用DLSS 3后更是快了2.5倍。

“完美平衡家”——GeForce RTX 4070 SUPER

比起RTX 4070,GeForce RTX 4070 SUPER多了20%的核心,让其性能超越了RTX 3090,而功耗却只是一小部分。使用DLSS 3后,其领先优势扩大到1.5倍。

官方消息显示,GeForceRTX 4080 SUPER,1月31日开始销售,价格999(美元) ;GeForce RTX 4070 Ti SUPER,1月 24日开始销售,价格799(美元);GeForce RTX 4070 SUPER,1月17日开始销售,价格599(美元)。

好文章,需要你的鼓励

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

机器人智能公司Inbolt将于2026年6月在芝加哥Automate展会上发布两项新能力:Inbolt机器人编程功能和扩展版机器人控制模块。新功能可让工程师直接基于CAD模型构建程序,结合视觉模型实时定位实体零件并自动调整运动路径,彻底消除传统调试中耗时数周的手动示教环节。此次更新还将原生支持安川机器人,使平台覆盖品牌扩展至六个。

当AI“管家“学会分工协作:卡内基梅隆大学研究团队如何让电脑操作智能体突破单打独斗的瓶颈

卡内基梅隆大学提出MACU框架,让经理AI统筹多个员工AI并行完成复杂电脑操作任务,通过动态调整任务图,在四个基准上均超越单智能体。

笔记本电脑深度清洁指南:内外兼修焕然一新

本文提供了一套完整的笔记本电脑深度清洁方案。硬件方面,介绍了如何用温和洗涤剂清洁机身、用微纤维布擦拭屏幕、用压缩空气清理键盘及清洁充电线的正确方法。软件方面,建议及时更新操作系统与驱动程序,删除冗余文件与临时下载内容,并通过开启Windows Storage Sense功能实现自动清理,同时将剩余文件整理归类,保持系统整洁高效运行。

康奈尔大学造出“会看图纸的AI设计师“:一张照片,自动还原可编辑的3D场景

康奈尔大学提出SEIG框架,让视觉语言模型通过分阶段重建几何、材质、构图和灯光,从单张图片自动生成可编辑的Blender 3D场景。

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

笔记本电脑深度清洁指南:内外兼修焕然一新

加利福尼亚州城市通过全美首个由选民投票决定的数据中心禁令

柴油替代方案:AI数据中心如何利用燃气引擎与蒸汽涡轮供电

AI定义汽车时代,车载以太网可靠性面临全新挑战

安全算法的持续更新正变得愈发困难

轨道数据中心本质上是功能强化的卫星

Infineon Live Lab正式发布:全球首个实时云端实体硬件评估平台

Serve Robotics携手NoScrubs,自主配送机器人跨界拓展洗衣服务

Workr Robotics CEO:工业机器人自动化应按小时付费

专访CreateMe CEO:从缝纫到粘合,实体AI如何重塑服装制造

AI浪潮为集成商带来全新连接挑战