对图像传感器的认识误区:传感器类型

作者: 安森美智能感知事业部Geoff Ballew

如今,摄像头已随处可见,工厂、车辆、公共建筑、街道……其数量还在不断增多。大部分摄像头依靠图像传感器将场景中的光线转换为电子图像,因而推升了对图像传感器的需求。但图像传感器种类繁多,功能特性各不相同,设计人员需要熟悉不同传感器的不同功能特性,才能为特定应用选择合适的摄像头。

乘用车摄像头搭载量激增,有些豪华车型甚至配有十几个摄像头。汽车制造商需要添加更多传感器以提升安全性,还需考虑每个摄像头的经济成本和占用空间,这为其带来了挑战。于是,汽车制造商开始寻找解决方案,希望用一个摄像头捕获同时针对人眼视觉和机器视觉优化的图像。人眼视觉与机器视觉所适用的图像质量存在区别,需要权衡取舍,因此实施这一方法同样难度不小。

人眼视觉

人眼视觉系统对像素间亮度强弱差异的感知与机器视觉算法不同。人眼对亮度的感知是非线性的,也就是说,如果所在环境中光子数量增加一倍,眼睛感知到的亮度也只增加了一倍。这需要调整用于人眼视觉的摄像头图像以对应其动态范围,从而将人眼感知的较亮区域和较暗区域的细节充分放大。此外,我们对一般颜色和 LED 光源的闪烁十分敏感(这一问题日益普遍),因此如果摄像头导致颜色失真,即使图像清晰且其他方面的质量很高,也会影响人类的视觉体验。对于后视摄像头等辅助驾驶的被动安全系统,驾驶员也比机器视觉系统有优势,因为如果图像有缺,驾驶员会自动发现,而此时无需依赖摄像头。虽然这不会引发重大安全事故,但摄像头丧失用处也会带来不便,因此,驾驶员不会依赖摄像头图像,而是更多地进行主动判断。

机器视觉

与人眼视觉不同,使用机器视觉的自动化系统会查看图像中每个像素的数字值,因此其对光子数呈线性反应。与用于人眼视觉的图像不同,因此必须调整以输出对应于测量像素值的图像。此外,机器视觉系统必须经过编程或采用特殊的错误检测硬件才能检测出图像缺陷。缺少该硬件的系统可能无法正常工作,且不会告知驾驶员其功能已受损或无法运行。对于像自动紧急制动这样的主动安全系统,如果出现故障,误报将导致系统在无碰撞危险时实施制动,而漏报会使系统在发生危险时完全失灵,从而造成严重的后果。如果驾驶员使用此类辅助系统,则需要显示信息来指示其功能不全,但可能无法发出功能受损的警告。部分系统会提醒驾驶员其功能受损或“不可用”,它们通常依赖特殊的硬件功能来检测传感器中的错误或故障。此类功能须遵循汽车安全完整性等级 (ASIL) 等相关的行业标准,支持 ASIL 的传感器将具有检测和报告故障的功能,可提高安全性。以上就是用于机器视觉的传感器与用于人眼视觉的传感器需要进行不同配置的两个原因。

120 度视场传感器 RYYCy 图像,经过彩色处理

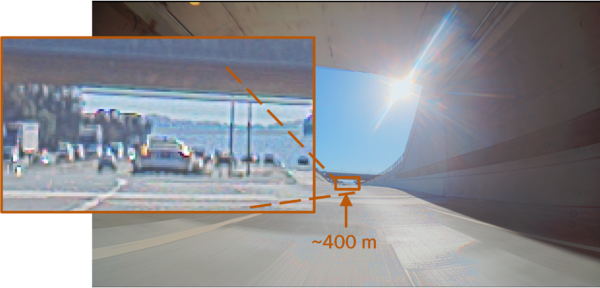

使用单个摄像头实现观察和感知的传感器解决方案

好消息是,部分传感器已具备同时适用于人眼和机器视觉的出色功能,且可进行优化并输出两路同步数据流,助力工程师设计可同时用于人眼和机器视觉功能的摄像头系统。这样一来,汽车制造商只需在车内的特定位置部署一个摄像头,最大限度地减小占用空间并降低系统成本,获得可针对两种工作负载应用优化的图像。

来源:业界供稿

好文章,需要你的鼓励

AI投资有望在2026年获得真正回报的原因解析

尽管全球企业AI投资在2024年达到2523亿美元,但MIT研究显示95%的企业仍未从生成式AI投资中获得回报。专家预测2026年将成为转折点,企业将从试点阶段转向实际部署。关键在于CEO精准识别高影响领域,推进AI代理技术应用,并加强员工AI能力培训。Forrester预测30%大型企业将实施强制AI培训,而Gartner预计到2028年15%日常工作决策将由AI自主完成。

北大学者革新软件诊断方式:让代码问题的“病因“无处遁形

这项由北京大学等机构联合完成的研究,开发了名为GraphLocator的智能软件问题诊断系统,通过构建代码依赖图和因果问题图,能够像医生诊断疾病一样精确定位软件问题的根源。在三个大型数据集的测试中,该系统比现有方法平均提高了19.49%的召回率和11.89%的精确率,特别在处理复杂的跨模块问题时表现优异,为软件维护效率的提升开辟了新路径。

2026年软件定价大洗牌:IT领导者必须知道的关键变化

2026年软件行业将迎来定价模式的根本性变革,从传统按席位收费转向基于结果的付费模式。AI正在重塑整个软件经济学,企业IT预算的12-15%已投入AI领域。这一转变要求建立明确的成功衡量指标,如Zendesk以"自动化解决方案"为标准。未来将出现更精简的工程团队,80%的工程师需要为AI驱动的角色提升技能,同时需要重新设计软件开发和部署流程以适应AI优先的工作流程。

德国达姆施塔特工业大学团队首次揭秘:专家混合模型AI的“安全开关“竟然如此脆弱

这项由德国达姆施塔特工业大学领导的国际研究团队首次发现,当前最先进的专家混合模型AI系统存在严重安全漏洞。通过开发GateBreaker攻击框架,研究人员证明仅需关闭约3%的特定神经元,就能让AI的攻击成功率从7.4%暴增至64.9%。该研究揭示了专家混合模型安全机制过度集中的根本缺陷,为AI安全领域敲响了警钟。

稚晖君发布全球最小全身力控人形机器人,上纬启元开启个人机器人时代

2026年软件定价大洗牌:IT领导者必须知道的关键变化

Linux 在 2026 年将势不可挡,但一个开源传奇可能难以为继

CES 2026趋势展望:全球最大科技展五大热门话题预测

人工智能时代为何编程技能比以往更重要

AI颠覆云优先战略:混合计算成为唯一出路

谷歌发布JAX-Privacy 1.0:大规模差分隐私机器学习工具库

谷歌量子AI发布新型优化算法DQI:量子计算优化领域的重大突破

缓解电动汽车里程焦虑:简单AI模型如何预测充电桩可用性

Titans + MIRAS:让AI拥有长期记忆能力

Gemini为STOC 2026大会理论计算机科学家提供自动化反馈

夸克AI眼镜持续升级:首次OTA,支持89种语言翻译