全新GPU、元宇宙、自动驾驶……NVIDIA GTC 2022带来更多惊喜 原创

每次的GTC大会,NVIDIA总是不会令人失望。这不,在秋季的GTC大会上,NVIDIA带来了眼花缭乱的产品秀。

在笔者看来,除了GPU的更新,NVIDIA在元宇宙和自动驾驶以及边缘机器人方面的布局是很大的亮点。

新一代GeForce RTX GPU

在图形加速方面,GeForce RTX GPU一直是无可争议的王者。而由Ada助力的新一代GeForce RTX 40系列GPU为游戏玩家和创作者带来更多惊喜。

Ada的革新包括一个全新的流式多处理器,一个具有两倍光线-三角形相交吞吐量的全新RT Core,以及一个具有Hopper FP8 Transformer Engine可提供1.4PetaFLOP张量处理性能的全新Tensor Core。

随着3D游戏和图形学不断努力提供对现实世界最精确地展现,环境和物体渲染的几何复杂性也在不断增加。

全新第三代RT Cores可以提供2倍的光线与三角形求交性能,以及两个全新的重要硬件单元。Opacity Micromap引擎将光线追踪的Alpha-Test几何性能提升2倍;而全新的Micro-Mesh引擎可动态生成微网格,以产生额外的几何图形。Micro-Mesh引擎可在提升几何图形丰富度的同时,不以传统复杂几何图形处理的性能和存储成本为代价。

Ada还引入了NVIDIA DLSS技术的最新版本——DLSS 3。该技术通过将新帧和上一帧进行比较来了解场景的变化,从而利用AI生成全新帧。与传统渲染相比,它能将游戏性能提高多达4倍。

DLSS 3已经得到了许多全球领先游戏开发者的支持,超过35款游戏和应用宣布即将支持该技术。

这些创新将令全新GeForce RTX 4090的性能提升至上一代RTX 3090 Ti的4倍。RTX 40系列GPU和DLSS 3为所有NVIDIA Studio的创作者带来了助力。3D艺术家无需代理就可以利用精确的物理学和逼真的材料渲染完整的光线追踪环境,并实时查看效果。

NVIDIA RTX 6000基于全球领先的GPU架构——NVIDIA Ada架构打造而成,具有最先进的NVIDIA RTX技术。

RTX 6000专为神经图形和先进的虚拟世界模拟而设计,其具有Ada架构赋能的AI技术和可编程的着色器技术,是结合NVIDIA Omniverse Enterprise为元宇宙构建内容和工具的理想平台。RTX 6000融合了最新的渲染、AI和着色器技术,具有48GB GPU内存,能助力用户创建精细的内容、开发复杂的模拟并构建创造引人入胜的虚拟世界所需的构件。

H100 GPU全面投产

作为NVIDIA GPU的新一代产品,NVIDIA H100 Tensor Core GPU以及Hopper的新一代Transformer Engine已经全面投产。

H100于2022年4月发布,由800亿个晶体管组成,并采用了众多开创性的技术,包括强大的全新Transformer引擎和NVIDIA NVLink互连技术,以加速最大规模的AI模型,如高级推荐系统和大型语言模型,并推动对话式AI和药物发现等领域的创新。

全球领先的大型语言模型和深度学习框架正在H100上进行优化,包括NVIDIA NeMo Megatron、Microsoft DeepSpeed、Google JAX、PyTorch、TensorFlow和XLA。这些框架与Hopper架构相结合,能够显著提升AI性能,将大型语言模型的训练时间缩短到几天乃至几小时。

除了Hopper的架构和Transformer引擎之外,第二代多实例GPU、机密计算、第四代NVIDIA NVLink和DPX指令等若干关键性创新也让H100 GPU如虎添翼,实现了NVIDIA加速计算数据中心平台的又一次飞跃。

H100使企业能够削减AI的部署成本,相较于上一代,在提供相同AI性能的情况下,可将能效提高3.5倍,总体拥有成本减少至1/3,所使用的服务器节点数也减少至1/5。

搭载H100的系统预计将在未来几周内发货,到今年年底将有超过50款服务器型号面市,2023年上半年还将有数十款型号面市。已在构建系统的合作伙伴包括源讯(Atos)、思科、戴尔科技、富士通、技嘉科技、慧与、联想和超微。

同时,亚马逊云科技、谷歌云服务、微软Azure和Oracle Cloud Infrastructure将从明年开始成为首批在云中部署基于H100的实例。

元宇宙

Omniverse是NVIDIA用于构建和运行元宇宙应用的平台。NVIDIA OVX服务器就是专为扩展元宇宙应用而打造的。

NVIDIA第二代OVX系统将由Ada Lovelace L40数据中心GPU提供支持,该GPU现已全面投产。

除了硬件产品,NVIDIA Omniverse Cloud可以连接在云端、本地或设备上运行的Omniverse应用。个人和团队可借助Omniverse Cloud,在无需任何本地算力的情况下,一键体验3D工作流的设计与协作能力。

Omniverse Cloud服务在Omniverse Cloud Computer上运行。该计算系统由用于图形和物理学模拟的NVIDIA OVX、用于高级AI工作负载的NVIDIA HGX以及NVIDIA图形交付网络(GDN)组成。GDN是一个全球规模的分布式数据中心网络,用于在边缘提供高性能、低延迟的元宇宙图形。

新的Omniverse容器现已可以部署到云端,该容器包括用于合成数据生成的Replicator、用于扩展渲染农场的Farm以及用于构建和训练AI机器人的Isaac Sim。

同时,德勤将带来建立在NVIDIA AI和NVIDIA Omniverse基础上的新服务。基于NVIDIA技术基础上所创建的新混合云解决方案将进一步加强两家公司的合作。包括 NVIDIA DGX系统在内的NVIDIA AI硬件和软件已成为德勤AI计算中心的核心。该中心是首个用于加快德勤为其客户开发创新AI解决方案的中心。

此外,德勤的无限现实(Unlimited Reality)服务使用AI计算中心和NVIDIA Omniverse Enterprise平台实现3D设计协作和虚拟世界模拟。德勤和NVIDIA也正在合作创建现实世界环境和流程的沉浸式或混合副本,以帮助企业优化运营与智能化决策。

边缘机器人

机器人计算机“是一种最新的计算机类型”,能够将一切可移动的机器转移到虚拟世界。

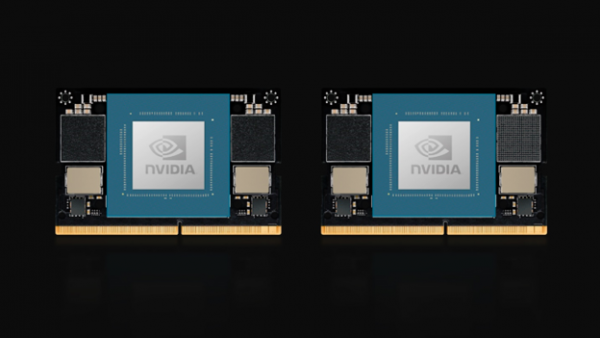

为了将Orin带到更多的市场,NVIDIA推出Jetson Orin Nano。这款微型机器人计算机比上一代备受欢迎的Jetson Nano快80倍。

NVIDIA Jetson系列首次涵盖了六个基于Orin的生产模组,可支持各种边缘AI和机器人应用。其中包括在最小的Jetson外形尺寸下提供每秒40万亿次(TOPS)AI性能的Orin Nano,以及为高级自主机器提供每秒275万亿次(TOPS)AI性能的AGX Orin。

Jetson Orin Nano可运行NVIDIA Isaac机器人堆栈并采用ROS 2 GPU加速框架。NVIDIA Isaac Sim机器人模拟平台现已在云端可用。

个人和团队可以通过多种方式在云中访问Isaac Sim的强大功能,因此能够在满足其需求的工作流中大规模开发、测试和训练支持AI的机器人。

对于使用AWS RoboMaker的机器人开发者,用于NVIDIA Isaac机器人开发平台的容器已在亚马逊云科技商店上架。

NVIDIA还推出了用于高精度边缘AI的NVIDIA IGX平台,其是一套强大的硬件和软件组合,其中就包括NVIDIA IGX Orin这一强大、紧凑、节能的AI超级计算机,用于自主工业机器和医疗设备。

IGX Orin开发者套件将于明年初推出,帮助企业快速制作原型和测试产品。每个套件均配备用于高性能AI计算的集成式GPU和CPU,以及提供拥有超低延迟、先进安全性高性能网络的NVIDIA ConnectX-7 SmartNIC。

凌华科技、研华科技、Dedicated Computing、控创科技、丽台科技、MBX、Onyx、瑞传科技、浦卓科技和源科技将成为首批打造基于IGX设计的产品来满足工业和医疗设备行业需求的嵌入式计算制造商。

自动驾驶

汽车行业的智能化趋势不可阻挡。

目前,想要实现汽车中的主动安全、停车、驾驶员监测、摄像头后视镜、集群和车载信息娱乐系统等功能通常需要不同的计算机提供支持。而未来,它们将由在中央计算机上运行的软件统一提供支持,并随着时间的推移不断改进。

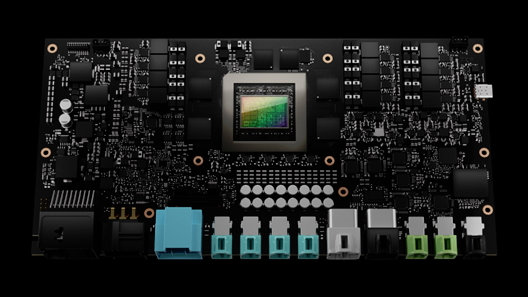

为了实现这一目标,NVIDIA推出了DRIVE Thor,该平台集Hopper的Transformer Engine、基于Ada的GPU和Grace CPU于一身。

DRIVE Thor可实现最高2000TOPS AI算力以及2000TFLOPS浮点算力,可以将包括自动驾驶和辅助驾驶、泊车、驾乘人员监控、数字仪表板、车载信息娱乐(IVI)、后座娱乐功能等智能功能,统一整合到单个架构中,从而提高效率并降低整体系统的运行能耗。

DRIVE Thor支持多域计算,可隔离用于自动驾驶和车载信息娱乐的功能。车辆中通常会分布数十个电动控制单元来为各个功能提供支持,借助DRIVE Thor,汽车制造商可以在单个系统级芯片(SoC)上高效整合多种功能,从而缓解算力供应紧张并简化车辆设计开发,从而进一步显著降低运行能耗、减轻重量并减少布线。

DRIVE Thor是首个集成推理Transformer引擎的自动驾驶汽车平台,该引擎是NVIDIA GPU中Tensor Core的新组件。借助该引擎,DRIVE Thor可将Transformer深度神经网络的推理性能提升高达9倍,这对于支持与自动驾驶相关的、庞大且复杂的AI工作负载至关重要。

软件

软件正在定义物理世界。

NVIDIA软件生态系统正在将NVIDIA系统和芯片以及加速计算的优势带给每个行业,超过350万名开发者通过使用NVIDIA的550个软件开发工具包(SDK)和AI模型创建了超过3,000个加速应用。

这个数量还在快速增长。在过去的12个月里,NVIDIA已经更新了100多个SDK并推出了25个新的SDK。

除了硬核产品,NVIDIA也公布了一系列的软件更新,包括CV-CUDA,一种被称为UCF(统一计算框架)的云运行时引擎;Omniverse Avatar Cloud Engine;被称为Tokkio的客户服务虚拟化身示例应用等。

大型语言模型“是当今最重要的AI模型”。基于Transformer架构,这些大型模型可以在没有监督和标记数据集的情况下学习理解意义或语言,解锁无与伦比的新能力。

为了帮助研究人员更轻松地将该技术应用到其工作中,NVIDIA发布了Nemo LLM服务。这项NVIDIA管理的云服务可根据具体的任务调整预先训练的大型语言模型。

为了加速药物和生物科学研究人员的工作,NVIDIA还发布了BioNeMo LLM。这项用于创建大型语言模型的服务可以理解化学物质、蛋白质、DNA和RNA序列。

NVIDIA正与全球最大的人类基因组信息公司——博德研究所合作,为博德的Terra云平台提供NVIDIA Clara库,包括NVIDIA Parabricks、基因组分析工具套件和BioNeMo。

结语

从新一代RTX GPU到H100 GPU全面投产,NVIDIA GPU正在“脱胎换骨”。同时,在边缘自主机器、自动驾驶等领域,NVIDIA也带来了激动人心的产品。

稳固已有市场的同时,NVIDIA也在拓展新领域,比如元宇宙、自动驾驶。从本次的发布看,Omniverse正在成为NVIDIA的重心。同时,随着汽车市场的智能化,NVIDIA在车载芯片方面也在加大布局。

创新是没有止境的,NVIDIA的革新之旅也在不断延展。

来源:至顶网计算频道

好文章,需要你的鼓励

Google Health 5.0 正式推出,安卓端新增数据统计小组件

Google Health 5.0作为Fitbit应用的更新版本正式推出。在安卓端,新版本引入了主屏幕快捷访问小组件,取代原有的圆形步数小组件,可显示最多六项健康指标,支持自定义缩放。点击小组件可跳转至完整统计页面,左上角心形图标可快速打开应用,右侧可直达Health Coach功能。此次更新还启用了全新Google Health图标,移除Fitbit品牌标识。安卓版已于5月19日开始推送,5月26日前全面覆盖。

当电脑学会用尺规作图:中国科学院团队让AI真正“画“出几何题

中科院团队发现顶级AI在几何作图上成功率不到6%,推出PAGER系统将精度提升4.1倍,揭示AI能力评估的关键盲点。

奥迪A2 e-tron入门级电动车将为品牌注入新活力

奥迪宣布将推出入门级纯电动车型A2 e-tron,旨在降低豪华电动车的拥有门槛。该车型基于大众最新MEB平台打造,预计提供50kWh、58kWh和79kWh三种电池选项,续航最高可达630公里。目前原型车正在瑞典北部极寒环境及巴伐利亚道路进行测试,重点验证热管理与电池性能。新车预计售价约4万美元,将于今年秋季正式亮相。

浙江大学联手京东研究院:让AI视频训练快6倍的“闪电秘诀“

浙江大学等机构提出Flash-GRPO视频AI训练新方法,通过同时段分组和梯度校正两项创新技术,实现训练速度提升6倍且质量更优。

51%专业人士称AI"工作垃圾"降低生产力——两步解决方案

微软宣布:Teams"共聚模式"将于6月底正式退出历史舞台

Selector推出多云网络可观测性平台,填补混合云可见性空白

Riverbed为Aternity平台推出全面自主AI能力升级

AI落地深水区的技术账本:软件质量治理如何破解工程化瓶颈

Google Health 5.0 正式推出,安卓端新增数据统计小组件

奥迪A2 e-tron入门级电动车将为品牌注入新活力

周中绿色优惠:Juiced Scrambler电动自行车、Lectric XPress2及多款储能产品特惠来袭

NAMUGA机器人视觉业务向"头部"延伸,加速布局高端机器人解决方案

AMD Silo AI与博洛尼亚大学携手开展空间AI合作,聚焦机器人与自动驾驶领域

Remepy混合疗法帕金森治疗方案即将进入三期临床试验

Exa Labs完成2.5亿美元融资,估值达22亿美元

NVIDIA Blackwell 现已在云端全面可用

为“代理式AI”装上“护栏” NVIDIA打造“三重防线”

黄仁勋现身北京致辞:60年后,计算机正被重新定义

CES 2025 | NVIDIA Isaac GR00T Blueprint 让人形机器人“加速进化”

未来,就在我们手中

CES 2025 | 代理式AI崛起:NVIDIA定义下一代“代理式 AI Blueprint”

深度学习最佳 GPU,知多少?

NVIDIA推出用于多语言生成式人工智能的NeMo Retriever微服务

NVIDIA 初创加速计划 | 2024 NVIDIA 创业企业展示完美收官!

老黄掏出“迷你版AI超算”,每秒67万亿次运算,仅售2070元人民币