NVIDIA与Ampere Computing携手创建用于云游戏的Arm架构云原生服务器平台

AICAN 平台将带来原生兼容性和高性能,大幅加快云端移动游戏的传输速度。

北京 - 2022 年 8 月 29 日 – NVIDIA 和 Ampere Computing 于今日宣布推出 AICAN 服务器平台。该平台能够将位于云数据中心的移动游戏流式直接传输至终端用户,使用户无需下载。

AICAN 服务器平台(Android-in-Cloud-with-Ampere-and-NVIDIA)是由 Ampere Computing 和 NVIDIA 所共同打造,它采用 Ampere® Altra® 云原生处理器和 NVIDIA® GPU,不需要修改或模拟就能原生运行兼容 Arm 的移动游戏。该平台内置双插槽 Ampere Altra Max CPU,提供行业领先的 256 个内核,并可配置多达 4 个 NVIDIA A16 或 6 个 NVIDIA T4 GPU,每台服务器最多可支持 160 个并发用户(CCUs)。

NVIDIA GeForce 高级副总裁 Jeff Fisher 表示:“移动游戏是最大且增长最快的游戏市场,已有数千部游戏针对 Arm 指令集进行了优化。AICAN 平台旨在原生运行移动游戏,实现最佳的兼容性、性能、成本和用户体验,助推云端流式传输移动游戏市场的发展。”

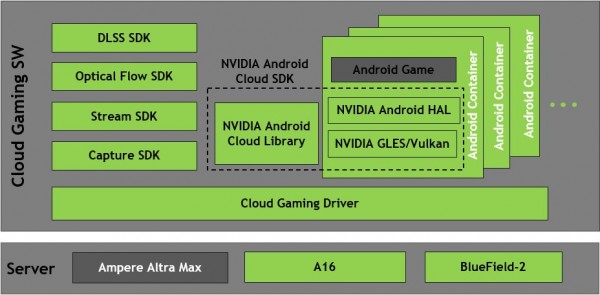

NVIDIA 的云游戏堆栈可提供最高的密度和服务质量。该堆栈专为低延迟端到端渲染、编码和流式传输进行了优化,为安卓平台带来了最新的游戏进展。公司还专门成立了专业工程和质量保证团队,使合作伙伴能够轻松、快速地进行集成并满足所有最新游戏的需求。NVIDIA ConnectX® SmartNIC 或 BlueField® DPU 网络解决方案通过流畅的流式传输与高服务质量完善了该平台。

Ampere Computing 首席产品官 Jeff Wittich 表示:“凭借 Ampere Altra Max 领先的核密度,单机架 AICAN 服务器可以同时向大约 2,500 多个移动用户传输串流。这不仅使得广大消费者更容易从云端流式传输优质移动游戏,也同时首次为服务提供商提供极具竞争力的基础设施成本。”

图1:AICAN 平台架构

Ampere Computing 和 NVIDIA 一同对 AICAN 平台进行认证和支持,使云服务提供商和游戏开发商可以轻松构建和运营大规模的游戏串流服务。浪潮和华勤等多家领先的 OEM 服务器制造商都在构建 AICAN 服务器平台。

图2:浪潮 AICAN 服务器

浪潮服务器部门总经理赵帅表示:“浪潮与 Ampere 和 NVIDIA 紧密合作,共同设计的 Aoqin AICAN 服务器内置两个 Ampere Altra Max CPU 和多达四个 NVIDIA A16 GPU 以及两块 NVIDIA SmartNIC,机箱尺寸却只有 2U 大小。我们十分高兴能够与 Ampere 和 NVIDIA 一起帮助客户推广移动游戏流式传输解决方案。”

图 3:华勤 AICAN 服务器

华勤的 AICAN 服务器在 2U 空间内兼容 Ampere Altra 和 Altra Max 两代 CPU,并联合NVIDIA 率先适配 T4 GPU ,提高客户收益,作为在中国首发 AICAN 服务器厂商之一,华勤与 NVIDIA 及多家客户一起致力于探索云游解决方案。未来,华勤会一如既往的和 NVIDIA 紧密合作,共同助力全球云游市场发展。

图 4:腾讯先锋云游戏 APP 首页截图

全球对移动游戏流式传输的关注日益增加。腾讯先锋云游戏提供的服务正在为腾讯吸引越来越多的游戏玩家。腾讯先锋云游戏负责人方亮表示:“在 Ampere Computing 和 NVIDIA 的支持下,腾讯先锋云游戏将达到新的高度。”

图 5:腾讯先锋云游戏品牌海报

腾讯先锋云游戏负责人方亮还表示:“现在通过在 Ampere Computing 和 NVIDIA 的 Arm 服务器平台上运行云游戏,我们将多款腾讯精品游戏由 3-10G,压缩储存空间到 20M 左右,用户即便使用存储空间有限的手机也能畅玩精品游戏,这让我们能够接触和覆盖到更广泛的用户,并且提升了增量收入。”

来源:业界供稿

好文章,需要你的鼓励

Google Health 5.0 正式推出,安卓端新增数据统计小组件

Google Health 5.0作为Fitbit应用的更新版本正式推出。在安卓端,新版本引入了主屏幕快捷访问小组件,取代原有的圆形步数小组件,可显示最多六项健康指标,支持自定义缩放。点击小组件可跳转至完整统计页面,左上角心形图标可快速打开应用,右侧可直达Health Coach功能。此次更新还启用了全新Google Health图标,移除Fitbit品牌标识。安卓版已于5月19日开始推送,5月26日前全面覆盖。

当电脑学会用尺规作图:中国科学院团队让AI真正“画“出几何题

中科院团队发现顶级AI在几何作图上成功率不到6%,推出PAGER系统将精度提升4.1倍,揭示AI能力评估的关键盲点。

奥迪A2 e-tron入门级电动车将为品牌注入新活力

奥迪宣布将推出入门级纯电动车型A2 e-tron,旨在降低豪华电动车的拥有门槛。该车型基于大众最新MEB平台打造,预计提供50kWh、58kWh和79kWh三种电池选项,续航最高可达630公里。目前原型车正在瑞典北部极寒环境及巴伐利亚道路进行测试,重点验证热管理与电池性能。新车预计售价约4万美元,将于今年秋季正式亮相。

浙江大学联手京东研究院:让AI视频训练快6倍的“闪电秘诀“

浙江大学等机构提出Flash-GRPO视频AI训练新方法,通过同时段分组和梯度校正两项创新技术,实现训练速度提升6倍且质量更优。

51%专业人士称AI"工作垃圾"降低生产力——两步解决方案

微软宣布:Teams"共聚模式"将于6月底正式退出历史舞台

Selector推出多云网络可观测性平台,填补混合云可见性空白

Riverbed为Aternity平台推出全面自主AI能力升级

AI落地深水区的技术账本:软件质量治理如何破解工程化瓶颈

Google Health 5.0 正式推出,安卓端新增数据统计小组件

奥迪A2 e-tron入门级电动车将为品牌注入新活力

周中绿色优惠:Juiced Scrambler电动自行车、Lectric XPress2及多款储能产品特惠来袭

NAMUGA机器人视觉业务向"头部"延伸,加速布局高端机器人解决方案

AMD Silo AI与博洛尼亚大学携手开展空间AI合作,聚焦机器人与自动驾驶领域

Remepy混合疗法帕金森治疗方案即将进入三期临床试验

Exa Labs完成2.5亿美元融资,估值达22亿美元

NVIDIA Blackwell 现已在云端全面可用

为“代理式AI”装上“护栏” NVIDIA打造“三重防线”

黄仁勋现身北京致辞:60年后,计算机正被重新定义

CES 2025 | NVIDIA Isaac GR00T Blueprint 让人形机器人“加速进化”

未来,就在我们手中

CES 2025 | 代理式AI崛起:NVIDIA定义下一代“代理式 AI Blueprint”

深度学习最佳 GPU,知多少?

NVIDIA推出用于多语言生成式人工智能的NeMo Retriever微服务

NVIDIA 初创加速计划 | 2024 NVIDIA 创业企业展示完美收官!

老黄掏出“迷你版AI超算”,每秒67万亿次运算,仅售2070元人民币