NVIDIA AI Enterprise 2.1版本全新功能

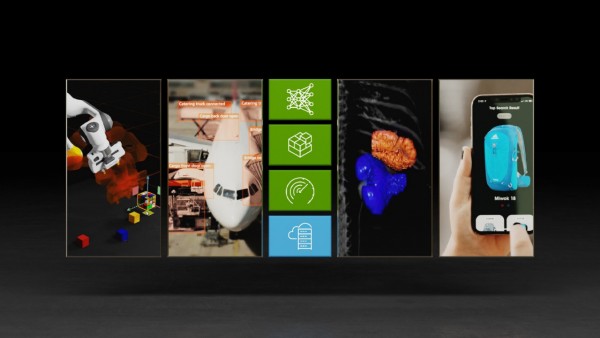

NVIDIA 于今日宣布 NVIDIA AI Enterprise 2.1 全面上市。这款最新版本的端到端 AI 和数据分析软件套件经过优化和认证,支持企业在裸机、虚拟环境、容器和云环境中部署和扩展 AI 应用。

发布亮点:新容器、公有云支持

NVIDIA AI Enterprise 2.1 版本使用最新的 NVIDIA RAPIDS 提供先进的数据科学,使用最新发布的 NVIDIA TAO 工具套件进行低代码 AI 模型开发。

为了让企业AI在混合或多云环境中更容易访问,AI Enterprise 2.1 增加了对在公有云中运行的 Red Hat OpenShift 和全新 Microsoft Azure NVads A10 v5 系列的支持。这些通过公有云提供的首批 NVIDIA虚拟 GPU 实例实现了经济的 GPU 共享。

支持最新 AI 框架

NVIDIA AI Enterprise 使用户能够实时了解用于开发与部署的 AI 工具,同时获得 NVIDIA 的企业支持和定期更新。对于依赖早期版本 NVIDIA AI 框架的用户,NVIDIA 将继续提供支持,确保管理基础设施更新的灵活性。

NVIDIA TAO Toolkit 22.05

NVIDIA TAO 工具套件是 NVIDIA TAO 的低代码解决方案。该框架使开发者能够创建自定义生产级模型,以驱动语音和视觉 AI 应用。

最新版本的 TAO 工具套件现在通过 NVIDIA AI Enterprise 获得支持,它加入了许多新的关键功能,包括 REST API 集成、预训练权重导入、TensorBoard 集成以及新的预训练模型。

NVIDIA RAPIDS 22.04

RAPIDS 22.04 版本通过在所有 NVIDIA 数据科学库中添加新的模型、技术和数据处理能力,为数据工作流程提供更多支持。

Red Hat OpenShift 现已支持公有云

集成了多项开发运维功能的业内领先企业级 Kubernetes 平台 Red Hat OpenShift 除了能够进行基于裸机和 VMware vSphere 的部署外,现在还通过了 NVIDIA AI Enterprise 认证并支持公有云。这使 Kubernetes 环境中的标准化 AI 工作流程能够在混合云环境中进行扩展。

Azure NVads A10 v5 支持

NVIDIA A10 Tensor Core GPU 驱动的 Azure NVads A10 v5 系列提供前所未有的 GPU 可扩展性、经济性以及部分 GPU 共享,可实现从六分之一的 A10 GPU 到两个完整 A10 GPU 的灵活 GPU 共享规模。

作为支持平台之一,NVads A10 v5 实例通过了 NVIDIA AI Enterprise 认证,为深度学习推理提供优化的性能,最大限度地提高了云端大规模部署的效用和成本效率。

Domino Data Lab Enterprise MLOps 平台认证

NVIDIA AI 加速合作伙伴 Domino Data Lab 的企业 MLOps 平台现已通过 NVIDIA AI Enterprise 认证。该级别认证降低了部署风险,并确保与 NVIDIA AI 平台的可靠、高性能集成。

通过这一合作,双方将工作负载编排、自助式基础设施、协作等企业 MLOps优势,与主流加速服务器上的虚拟化所带来的成本效益相结合。

尝试 NVIDIA AI Enterprise

NVIDIA LaunchPad 为世界各地的企业机构提供在私有加速计算环境中即时、短期访问 NVIDIA AI Enterprise 软件套件的机会,包括各种操作实验室。

通过新的 NVIDIA LaunchPad 实验室体验在 NVIDIA AI Enterprise 上运行的最新 NVIDIA AI 框架和工具。这些位于 NVIDIA 加速基础设施上的实验室使企业能够加快现代化数据驱动型应用的开发和部署,并在用于部署的同一完整堆栈上快速测试和制作整个 AI 工作流程的原型。

访问 NVIDIA AI Enterprise 2.1 中的新LaunchPad实验室。

- 使用 Tanzu 在 VMware vSphere 上进行多节点图像分类训练

- 使用 NVIDIA Triton 部署欺诈检测 XGBoost 模型

- 使用 NVIDIA TAO 工具套件开发自定义对象检测模型并使用 NVIDIA DeepStream 进行部署

来源:业界供稿

好文章,需要你的鼓励

派拉蒙CIO规划AI规模化路径,CTO即将卸任

Paramount正加速推进AI布局,同时面临CTO Phil Wiser五月底计划离职的人事变动。在收购华纳兄弟探索公司接近尾声之际,Paramount CIO Lakshman Nathan在路透社举办的Momentum AI大会上分享了公司AI战略:公司已在隐私、法务及代码开发等领域部署AI,两天内即可完成应用测试交付。Paramount采取开放探索与治理并行的策略,借助智能体AI推动企业级应用整合,同时稳步处理多次并购带来的遗留系统问题。

AI视频理解的“作弊“漏洞被揭穿了——来自StepFun团队的深度修复方案

StepFun团队发现主流全感官AI评测存在"视觉作弊"漏洞,发布OmniClean清洁评测集,并提出三阶段OmniBoost训练方案,让30亿参数小模型媲美300亿参数大模型。

量子计算面临安全威胁与人才短缺双重挑战

量子计算行业正面临两大迫切问题:安全威胁与人才短缺。随着"Q-Day"临近,量子计算机或将破解RSA加密体系,威胁银行、医疗、政府等关键基础设施安全。NIST要求2035年前完成向后量子密码学的迁移。与此同时,行业人才严重匮乏——目前仅有3万名量子专业人员,而2029年需求将达25万人。据麦肯锡预测,量子计算到2035年将创造3万亿美元经济机遇。

阿里巴巴与北京大学联手,让AI大模型“按需用电“:BEAM技术如何让语言模型跑得更快、耗得更少

BEAM是阿里巴巴与北京大学提出的MoE大模型动态路由方法,通过可学习的二值掩码实现每个词自适应选择激活专家数量,在保留98%性能的前提下将推理速度提升最高2.5倍。

量子计算面临安全威胁与人才短缺双重挑战

IrisGo:由吴恩达投资的AI桌面智能体,让工作流程自动化成为现实

OpenAI宣称用AI推翻了一个困扰数学界近80年的猜想

Linus Torvalds坦言对AI又爱又恨:工具有用,但挑战真实存在

Hovercraft:让视频通话演示更自然的 Mac 应用

tvOS 27将为Apple TV 4K带来全局文字放大新功能

比亚迪新款快充电动车订单突破10万辆,产能严重告急

博杰斯快餐连锁推出电动汽车快速充电服务

YouTube Shorts推出AI混剪功能,借助Gemini实现视频重塑

四大AI模型运营电台六个月,结果一团糟

Clouted:用AI智能体消除短视频爆款的不确定性

Anthropic每月向xAI支付12.5亿美元算力费用

NVIDIA Blackwell 现已在云端全面可用

为“代理式AI”装上“护栏” NVIDIA打造“三重防线”

黄仁勋现身北京致辞:60年后,计算机正被重新定义

CES 2025 | NVIDIA Isaac GR00T Blueprint 让人形机器人“加速进化”

未来,就在我们手中

CES 2025 | 代理式AI崛起:NVIDIA定义下一代“代理式 AI Blueprint”

深度学习最佳 GPU,知多少?

NVIDIA推出用于多语言生成式人工智能的NeMo Retriever微服务

NVIDIA 初创加速计划 | 2024 NVIDIA 创业企业展示完美收官!

老黄掏出“迷你版AI超算”,每秒67万亿次运算,仅售2070元人民币