GTC 2021:Nvidia发布Quantum-2网络平台加速高性能计算

Nvidia发布了下一代InfiniBand网络平台Nvidia Quantum-2,致力于推动高性能计算的发展。

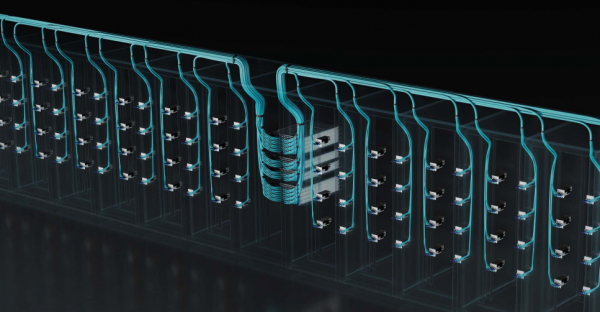

今天Nvidia在GTC 2021大会上宣布推出了Nvidia Quantum-2(如图),这是一个传输性能达到每秒400GB的InfiniBand网络平台,配置了全新的Nvidia Quantum-2交换机、ConnectX-7网络适配器,以及即将推出的BlueField-3数据处理单元。Nvidia表示,这一组合出色的网络吞吐性能和现金的多租户功能,可同时支持多个用户。

Nvidia的InfiniBand是一种计算机网络通信标准,用于对处理器和I/O设备之间的数据流进行高性能计算,以其高吞吐量和极低的延迟而闻名。

最新一代InfiniBand Quantum-2引入了新的功能,可进一步加速超算中心和提供了高性能计算服务的公有云平台中要求最为苛刻的工作负载。

Nvidia网络高级副总裁Gilad Shainer表示:“当今超级计算中心和公有云的需求正在走向融合,必须应对下一代高性能计算、人工智能和数据分析带来的挑战,提供尽可能高的性能,同时还必须安全地隔离工作负载,响应用户流量的各种需求。现在,Nvidia Quantum-2 InfiniBand实现了现代数据中心的这一愿景。”

Nvidia表示,为了提供所需的性能,Quantum-2 InfiniBand将网络速度提高了1倍,同时将上一代标准可用网络端口的数量增加了2倍,这意味着Quantum-2将性能提升高达3倍,同时将数据中心光纤交换机的需求减少6倍,此外还在大幅降低数据中心功耗的同时,将数据中心空间减少了7%。

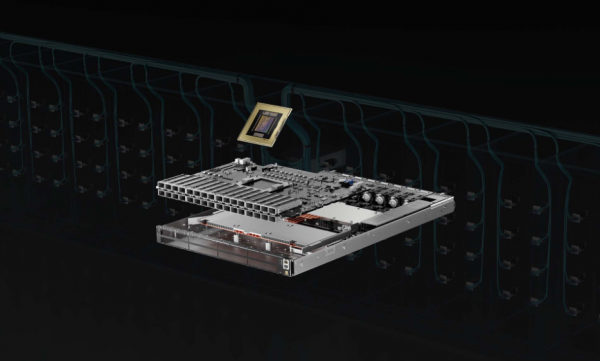

这一切都要归功于最新的Nvidia Quantum-2 InfiniBand交换机(如图),该设备的7纳米芯片上容纳了570亿个晶体管,提供多达64个400Gbps端口或128个200Gbps端口。Nvidia表示,将在各种交换机提醒中提供这款交换机,规模最大的配置中最多有2048个端口,是上一代Quantum-1系统的5倍多。

与此同时,Quantum-2还提供了多租户性能隔离方面的好处,可确保一个租户或者一个用户的活动不会受到其他租户在性能上的影响。Nvidia表示,这是通过先进的、基于遥测的拥塞控制系统实现的,可确保有足够的吞吐量可用,无论需求或用户数是否激增。

Quantum-2的另一个亮点是一种独有的SHARPv3网络计算计算,以上一代InfiniBand相比,该技术为AI应用程序提供了高达32倍的加速引擎,不仅如此,还有一个全新的纳秒级精确计时系统,可通过同步分布式应用(例如数据库处理)来减少等待和空闲时间带来的开销,从而提高性能水平。

Nvidia解释说,纳秒计时是一种新功能,可让云数据中心成为电信网络的一部分,并托管软件定义的5G无线电服务。

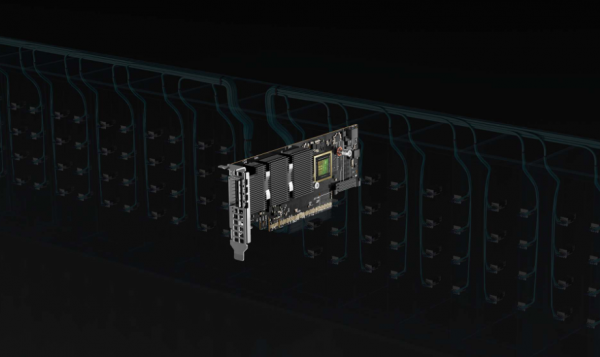

此次发布时,Quantum-2 InfiniBand设计支持2个网络端点、新的Nvidia ConnectX-7网络接口卡(下图)和即将推出的BlueField-3 DPU。ConnectX-7将于2022年1月打样,据说是由80亿个晶体管组成的,采用了7纳米设计,与上一代ConnectX-6相比,可处理的数据量增加了1倍。BlueField-3 DPU将于5月打样,采用7纳米设计,拥有220亿个晶体管,提供16个64位Arm CPU,用于卸载和隔离数据中心基础设施任务。

Nvidia表示,Quantum-2 InfiniBand交换机现在已经开始从基础设施和系统合作伙伴处供货,包括Atos Computing、DataDirect Networks、戴尔、Excelero、技嘉、HPE、IBM、浪潮、联想、Penguin Computing、超微、WekaIO和Vast Data。

来源:业界供稿

好文章,需要你的鼓励

AWS推出Graviton驱动的Redshift RG实例以降低分析成本

AWS为Amazon Redshift数据仓库服务发布了全新Graviton驱动的RG实例,旨在帮助企业降低分析成本并简化湖仓架构复杂性。新实例内置集成数据湖查询引擎,可跨Redshift仓库数据与Amazon S3数据湖执行SQL分析,同时消除了原有Spectrum独立扫描计费模式,避免账单突增问题。分析师指出,RG实例将Iceberg、Parquet等格式与仓库数据统一查询,提升性能并降低开销,但整体定位更多是防御性举措而非颠覆性创新。

阿里巴巴与厦门大学联手打造“时装变色龙“:你的虚拟试衣间终于能实时换装了

阿里巴巴与厦门大学联合研发FashionChameleon,实现视频生成过程中实时无缝换装,速度达23.8帧每秒,比现有方案快30至180倍。

AI浪潮催生新职业:前置部署工程师

随着AI落地需求激增,"前沿部署工程师"(FDE)正成为科技行业增长最快的职位之一。谷歌云CEO近日发出招聘号召,目前该公司已有逾1500个相关职位空缺,OpenAI和微软也在积极布局。据LinkedIn数据,2023至2025年间FDE职位数量增长了42倍。FDE的核心职责是帮助非技术型企业成功落地AI系统,弥补其在人才、战略和技术复杂性方面的不足,并在降低AI运行成本、提升token效率方面发挥关键作用。

AI答题答对了,但“作弊“的漏洞被北京大学和上海人工智能实验室联合研究团队当场抓住了

北京大学与上海人工智能实验室联合研究团队发现,主流AI模型普遍存在"归因幻觉"——答案正确但证据乱指,并为此推出CiteVQA评测基准。

AI浪潮催生新职业:前置部署工程师

Hull Street Energy收购FirstLight USA,扩大水电资产规模

一部95分钟AI电影杀进戛纳后,影视行业开始不淡定了

友讯达加码巴西电网数字化,智能计量业务前置本地服务

德州圣安东尼奥启动大型电池储能系统项目建设

Airbnb升级iOS和安卓应用,三大功能增强旅行体验

Android 17 QPR1 Beta 3全新功能一览

Nomad推出Olde Dublin皮革钱包新品系列

比亚迪宋Ultra EV完成2700英里长途测试

企业推理场景中的AI加速器多样化趋势

Gemini Spark让谷歌过度获取用户数据

初创公司融资4300万美元打造船舶"蜂群智能"网络

NVIDIA Blackwell 现已在云端全面可用

为“代理式AI”装上“护栏” NVIDIA打造“三重防线”

黄仁勋现身北京致辞:60年后,计算机正被重新定义

CES 2025 | NVIDIA Isaac GR00T Blueprint 让人形机器人“加速进化”

未来,就在我们手中

CES 2025 | 代理式AI崛起:NVIDIA定义下一代“代理式 AI Blueprint”

深度学习最佳 GPU,知多少?

NVIDIA推出用于多语言生成式人工智能的NeMo Retriever微服务

NVIDIA 初创加速计划 | 2024 NVIDIA 创业企业展示完美收官!

老黄掏出“迷你版AI超算”,每秒67万亿次运算,仅售2070元人民币