GPU加速CDH NVIDIA与Cloudera联手让数据价值触手可及 原创

随着数据规模的指数增长,存储数据的载体,数据的处理技术,数据的使用的方式方法都在不断演进。企业用户对数据价值的预期也不断增加,期望通过数据能快速带来商业价值。

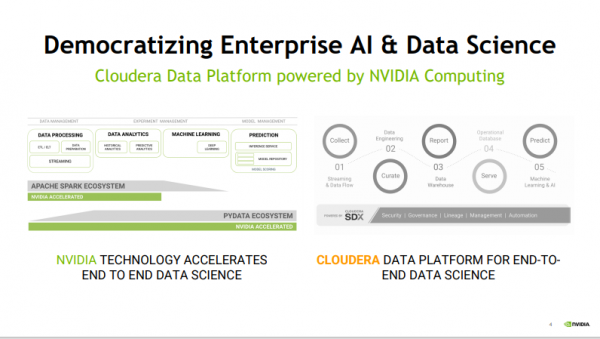

近日,Cloudera推出使用NVIDIA GPU加速Apache Spark 3.0软件的Cloudera Data Platform(CDP),帮助企业用户在完成基本的数据摄取、数据整合批处理以及数据仓库的功能的基础上,还能面向业务人员提供即时互动的分析工具,以及提供建模、数据科学、机器学习,甚至是一些深度训练的平台工具。

GPU加速数据价值实现

Cloudera Data Platform(CDP)是Cloudera推出的端到端的数据平台,通过集成整个数据生命周期及跨公有云和私有云分析功能的独特混合数据架构,CDP可以在数据生命周期的任何阶段,充分利用几乎无限数量和种类的数据支持企业做出更好的决策。

通常提取/转换/加载(ETL)常常成为数据科学家在获取AI预测和建议时的瓶颈。ETL预计会占用数据科学家70%至90%的时间,当数据科学家在等待ETL时,他们不能重新训练模型来获取更好的商业洞见。

传统的CPU基础设施无法通过有效的扩展适应这些工作任务,如果继续采用CPU,则必须牺牲速度或增加成本才能跟上由此产生的处理需求。

而GPU并行处理已成为加速海量数据分析和ETL管道,进而驱动这些工作负载的关键。数据中心通过大规模横向扩展这些功能支持复杂的数据分析项目。

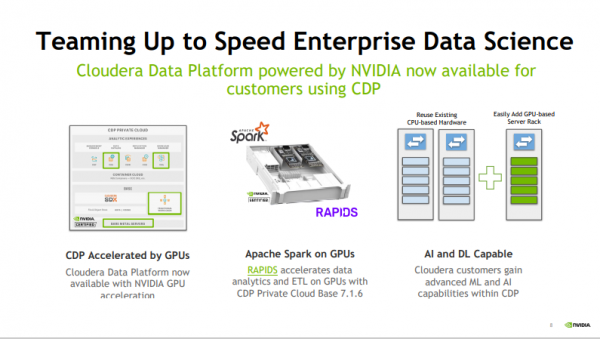

NVIDIA与Cloudera联合工作让GPU加速的Apache Spark 3能够在CDP上无缝运行,从而支持企业机构可以通过安全且可扩展的开源机器学习平台,满足从研发到生产的高性能计算(HPC)、AI和数据科学需求。

美国国家税务局的故事

我们知道Spark大数据分析软件更多是运行在CPU上面,但是随着数据类型的多样化以及数据量的激增,通过引入GPU能够加速数据分析进程。

作为一名数据科学家,Deborah Tylor的任务是整理美国国家税务局超过300TB的数据库,寻找可能有助于识别身份盗窃和其他欺诈行为的规律。但即使她让一大批CPU服务器工作了一整夜,也无法完成这项数据整理工作。

后来通过Cloudera工程师的介绍,美国国税局团队对CDP软件进行快速测试后,在没有修改任何代码的情况下,Tylor在这项工作中的许多步骤就立即加快了5倍,但有几个部分仍然滞后。

后来Cloudera工程师请来了NVIDIA数据科学家团队检查代码的核心内容。他们很快发现一些非常糟糕的数据结构任务仍在CPU上运行。于是他们编写了代码处理这些任务并将其插入Spark的RAPIDS软件接口中。

RAPIDS是一个在GPU上运行数据分析的开放资源库。NVIDIA和Cloudera通过深入合作,使数据团队能够使用RAPIDS AI无需更改任何代码即可大大加快数据工程和数据科学工作负载的计算流程。Cloudera Data Platform上的RAPIDS预先配置了所有必需的库和依赖项,以将RAPIDS的功能带到相关项目中。

结果,Tylor又进行了一次测试,发现一切都能在分布式Spark集群的GPU上顺利运行,而且速度提升非常明显。她在一个四节点的集群上运行了整个程序。

最终,Cloudera和NVIDIA的技术整合使得美国国税局的数据工程和数据科学工作流程以一半的成本获得了超过10倍的速度提升。

接下来,该团队计划把其成功经验运用在数据准备,也就是数据分析中的ETL方面的工作上面,下一步重大计划是加速各类AI推理工作。

结语

面对数据洪流,企业在数据处理方面的需求激增,而这离不开坚实的数据处理基础设施的支撑。传统的CPU架构在数据处理方面面临瓶颈,而GPU提供了解决路径。NVIDIA与Cloudera的联合创新让企业在应对数据挑战方面更加从容。

好文章,需要你的鼓励

迈向Token经济时代,F5以“AI赋能交付”筑基智能新生态

企业谈AI基础设施时,注意力往往首先集中在模型、GPU和算力集群上。但当大模型应用走向规模化推理,一个瓶颈开始浮现:算力采购完成,并不意味着Token能够被稳定、低成本、可控地交付出去。

当AI机器人“自信地“撞向墙壁:STATE16研究院揭示物理AI系统中那些无声无息的致命错误

STATE16研究院这篇综述发现,物理AI系统存在"静默失效"风险——AI以高度自信执行基于错误世界信息的动作,却不触发任何报警,并提出在AI输出与物理执行之间建立独立授权层的框架。

米拉·穆拉提重返公众视野,谨慎发声

穆拉蒂时隔18个月首次接受重大媒体采访,介绍其创立的Thinking Machines Lab正在开发的"交互模型"。该模型能以200毫秒间隔处理音频、文本和视频流,捕捉人类交流中的中断、修正和停顿。她还谈及OpenAI"政变周"经历,强调行业决策权过于集中的担忧,并回应了公司近期研究人员离职问题,表示这是初创实验室的正常波动。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。

三星Health应用迎来AI升级,Galaxy Watch 9发布前夕更新提前揭晓

Meta智能眼镜被曝含"人脸识别"追踪代码,隐私风险引发警示

Gemini企业智能体平台的智能体RAG如何实现可靠响应

麻省理工学院AI与计算研讨会:技术进步中不可或缺的人文因素

亚马逊全新数据中心路由架构降低AWS网络能耗40%

iOS 27即将发布,多款iPhone应用将迎来全新设计升级

连接性已成为与计算和存储同等重要的AI基础设施核心要素

开发者仍在等待Meta最新AI模型的API访问权限

迈向Token经济时代,F5以“AI赋能交付”筑基智能新生态

米拉·穆拉提重返公众视野,谨慎发声

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

智能体网络流量首超真人访问,"死亡互联网"理论引发新争议