加速千行百业的AI民主化 NVIDIA公布面向5G和超算的新方案 原创

如今AI无处不在,NVIDIA致力于实现AI民主化。近日,在MWC 2021和ISC 2021的举行期间,NVIDIA公布面向5G和超算的新方案——AI-on-5G和NVIDIA HGX AI超级计算平台,帮助各行各业能够加速AI落地。

扩展AI-on-5G生态系统

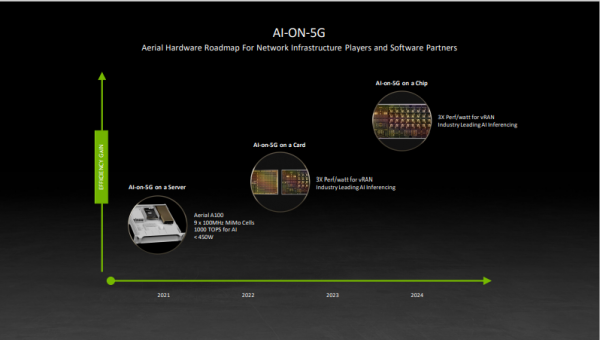

软件定义的RAN对于构建能够在通用平台上运行各种应用程序的现代5G基础设施至关重要。今年4月,NVIDIA宣布与谷歌云、Fujitsu、Mavenir、Radisys和Wind River合作开发适用于NVIDIA AI-on-5G平台的解决方案。部署该平台的企业、移动网络运营商和云服务提供商将能够在同一融合的平台中同时处理5G和边缘AI计算,可以在理想的平台上创建高性能5G RAN和AI应用。

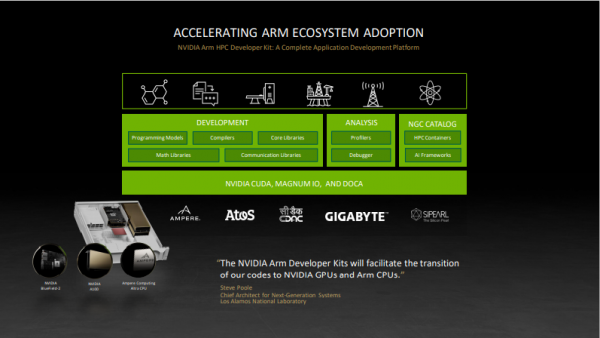

现在NVIDIA宣布将在NVIDIA Aerial A100 AI-on-5G平台上扩大对Arm架构CPU的支持,为5G生态系统带来更多选择。NVIDIA Aerial A100 AI-on-5G计算平台使用NVIDIA Aerial软件开发套件,并将与内置16个Arm Cortex-A78处理器的NVIDIA BlueField-3 A100配套工作,打造独立的融合卡,可通过云原生5G vRAN提供企业级边缘AI应用,并提升每瓦性能,加快部署速度。

这一举措将让全球各大OEM能够提供基于高效的Arm架构CPU和采用Aerial 5G的NVIDIA AI Enterprise软件的行业标准服务器,更简易地构建和部署自托管的vRAN,让私营企业、网络设备公司、软件制造商和电信服务提供商都能将AI和5G功能相融合。

除此以外,NVIDIA宣布将与谷歌云合作打造业内首个AI-on-5G创新实验室,该实验室将向企业提供谷歌云的Anthos平台和NVIDIA加速计算软硬件平台,让企业能利用数据和AI来提升业务绩效、提高运营效率并优化安全性和可靠性。

加快工业AI和HPC新时代的到来

AI与加速计算和高性能计算相结合,形成了推动超指数级进步的数字飞轮。NVIDIA首席执行官黄仁勋表示,由于加速计算和深度学习出现,高性能计算正在经历多米诺骨牌效应。

制药公司正在利用经由GPU加速的模拟和AI来加速药物发现。宝马等汽车制造商正在利用此类技术实现整个工厂的建模。欧洲的DestinE项目将打造地球的数字孪生体,这种仿真只有结合高性能计算与AI才能实现。

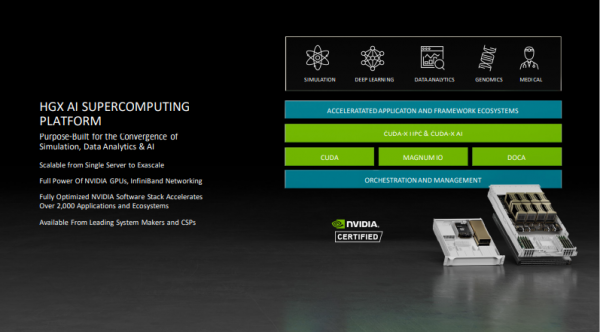

基于此,NVIDIA宣布在NVIDIA HGX AI超级计算平台中加入融合了AI与高性能计算的新技术,使越来越多的行业能够更加充分地利用超级计算的力量。

NVIDIA在HGX平台中加入了三项关键技术:NVIDIA A100 80GB PCIe GPU、NVIDIA NDR 400G InfiniBand网络和NVIDIA Magnum IO GPUDirect Storage软件。三者结合,提供了卓越的性能,以实现工业HPC的创新。

目前,NVIDIA HGX平台为爱丁堡大学的新一代超级计算机Tursa提供支持,Tursa是由爱丁堡大学托管的新型DiRAC超级计算机。

Tursa超级计算机由Atos打造,预计将于今年晚些时候投入使用,它将配备448个NVIDIA A100 Tensor Core GPU,每个节点包括4个NVIDIA HDR 200Gb/s InfiniBand网络适配器。NVIDIA Magnum IO GPUDirect RDMA 使系统能够使用Lattice Quantum ChromoDynamics为超大规模的科学应用提供高水平的节点间带宽和可扩展性。

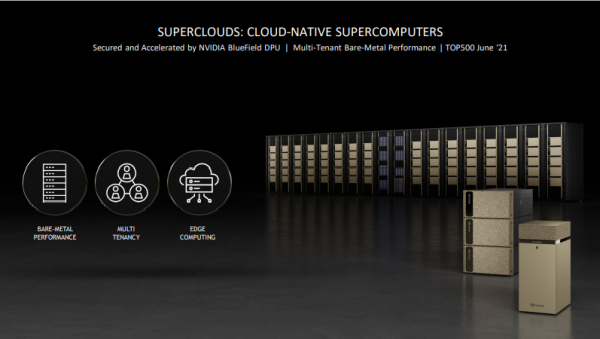

同时,在最新发布的TOP500榜单上,基于云的AI超级计算机(包括Microsoft Azure和剑桥大学的新系统Wilkes-3超级计算机)大出风头。

这种超级云——一种新兴的共享超级计算机,能够同时满足人工智能、高性能计算和云端的需求。Azure系统便是NVIDIA首席执行官黄仁勋所述“行业高性能计算革命”的一例,即AI与高性能计算和加速计算融合,正在推动科研和行业各个领域的发展。

Wilkes-3是世界上第一台云原生超级计算机,让研究人员能够在保证隐私和安全的前提下共享虚拟资源。除了与HDR 200G InfiniBand网络上连接的320个A100 GPU之外,该超级计算机还借助NVIDIA Bluefield DPU加速安全、虚拟化和其他数据处理任务。

可以预见的是高性能计算革命将席卷数据中心、公有云和混合云以及边缘网络。NVIDIA也在与ARM联手加速高性能计算生态系统的发展,将ARM模式应用到高性能计算的时机已经到来。

结语

不管是5G还是高性能计算领域,NVIDIA持续创新加速AI在行业中的落地。并推动技术之间的融合。AI-on-5G让5G和边缘AI计算融合,而HGX平台让AI与加速计算和高性能计算融合,这些带来的将是整个行业的变革。

好文章,需要你的鼓励

OpenAI加速推进IPO,或于9月上市

据《华尔街日报》报道,在马斯克针对OpenAI的诉讼失败后,OpenAI正加速推进IPO计划。CEO萨姆·奥特曼希望公司最快于今年9月上市,目前已与高盛、摩根士丹利合作,并可能在数日或数周内秘密提交上市申请。与此同时,马斯克旗下SpaceX的IPO文件也预计近期公开。两家公司的上市竞争,标志着马斯克与奥特曼的博弈从法庭转移至资本市场。

当探索撞上天花板:KAIST团队教会AI“换个思路想想“的聪明办法

KAIST团队提出策略助推方法,通过强制分配解题方向引导AI探索多样思路,仅用八份样本就超越了消耗八倍资源的传统方法。

51%专业人士称AI“工作垃圾“降低生产力——两步解决方案

调查显示,51%的专业人士认为AI生成的低质量内容(即"workslop")正在降低生产效率,45%的人因此对职场使用AI更加谨慎。这类内容表面精致却缺乏准确性和实质价值。专家建议两步应对:一是重塑AI生产力思维,推行"AI先行、人工复核"的工作模式;二是保持持续投入,深入掌握AI工具的有效用法。企业领导者强调,真正从AI中受益需要坚持与学习,而非浅尝辄止。

研究团队的核心想法用一句话概括就是:在训练这台切片机的时候

专门告诉它"文字和脸是重要的

必须切好"。 要理解这个改动有多巧妙

得先看看以前的切片机是怎么训练的。传统的训练方法会用三种"考核标准"来评价切片机的表现。第一种叫"重建损失"

当一个AI画师终于学会写字和画脸:清华大学与微软联手破解图像生成的“老大难“

要理解这项研究,先得明白现在的AI是怎么"画"图的。 可以把AI生成图片的过程想象成一个特殊的厨房。当AI要学会画图时,它不会像人类画家那样一笔一画地描绘,而是采用一种叫做"自回归"的方式——简单说就是"一个食材接一个食材地添加"。但问题在于,AI厨房处理的"食材"不是真实的图像像素,而是一种被压缩过的"标准化食材包"。 这个压缩过程,叫做"离散分词",由一个叫"分词器"(tokenizer)的设备完成。打个比方,分词器就像一台高级的食材切片机,它把一整张图片切成很多小块,然后给每一小块贴上一个"编号标签",对应到一本"标签字典"(也就是研究者口中的"码本")里的某个条目。比如,标签001可能代表"蓝天的一小块",标签002代表"绿草的一小块"。 这种做法的好处是大幅简化了AI的工作量——它不用记住几百万个像素,只需要记住一串编号就行了。这就是为什么如今像Chameleon、Emu3这些大名鼎鼎的多模态AI模型都用这种技术。 但问题也恰恰出在这里。当切片机以16倍的压缩率工作时(也就是说原本256个像素被压缩成1个标签),很多细节就被无情地丢弃了。蓝天少一些云彩、草地少几根草尖,人眼几乎看不出来。可一旦切到了文字或人脸,灾难就发生了——一个英文字母"e"和"c"的差别可能就在那么几个像素,一张脸上眉眼的位置稍微挪一挪,整个人就变了样。 研究团队发现,认知科学研究早就指出,人类的视线会不自觉地被文字和人脸吸引,对这两类内容的细节扭曲特别敏感。换句话说,AI画其他东西糊一点没关系,但文字和脸糊了,用户立马就能察觉。 之前的研究者也意识到了这个问题,他们的解决思路通常是"加大切片机的容量"——比如把标签字典从1万6千条扩展到26万条,或者让每张图用更多的标签。但这就像为了切好一根胡萝卜而把整个厨房改造成大型工厂,成本高得离谱,而且效果也不见得好。 清华和微软的团队提出了一个完全不同的思路:与其让切片机变得更大,不如教它学会"看重点"。 二、给切片机装上"火眼金睛"

Nomad推出Olde Dublin皮革钱包新品系列

比亚迪宋Ultra EV完成2700英里长途测试

企业推理场景中的AI加速器多样化趋势

Gemini Spark让谷歌过度获取用户数据

初创公司融资4300万美元打造船舶"蜂群智能"网络

OpenAI加速推进IPO,或于9月上市

51%专业人士称AI"工作垃圾"降低生产力——两步解决方案

微软宣布:Teams"共聚模式"将于6月底正式退出历史舞台

Selector推出多云网络可观测性平台,填补混合云可见性空白

Riverbed为Aternity平台推出全面自主AI能力升级

AI落地深水区的技术账本:软件质量治理如何破解工程化瓶颈

Google Health 5.0 正式推出,安卓端新增数据统计小组件