基于Omniverse的NVIDIA Isaac Sim现已发布公测版

全新Isaac模拟引擎不但能够创造更逼真的环境,而且还能简化合成数据生成和域随机化,从而建立真值数据集来训练用于物流、仓库、未来工厂等的各种机器人。

Omniverse是NVIDIA模拟器的根本基础,包括加入了多项新功能的Isaac平台。NVIDIA Isaac Sim目前已发布公测版,您可以通过该平台探索更高级的机器人模拟功能。

Isaac Sim基于NVIDIA Omniverse平台而构建,它是一个机器人模拟应用与合成数据生成工具。机器人专家可使用它更高效地训练和测试机器人,模拟机器人与指定环境的真实互动,而且这些环境可以超越现实世界。

Isaac Sim的发布还增加了经过改进的多摄像头支持功能、传感器功能以及一个PTC OnShape CAD导入器,让3D素材的导入变得更加轻松。从实体机器人的设计和开发、机器人的训练,到在“数字孪生”中的部署(数字孪生是一种精确、逼真的机器人模拟和测试虚拟环境),这些新功能将全方位地扩大可以建模和部署的机器人和环境范围。

主要新功能

- 支持多摄像头

- 带合成数据的鱼眼相机

- 支持ROS2

- PTC OnShape导入器

- 经过改进的传感器支持

- 超声波传感器

- 力传感器

- 自定义激光雷达模式

- 可从NVIDIA Omniverse Launcher中下载

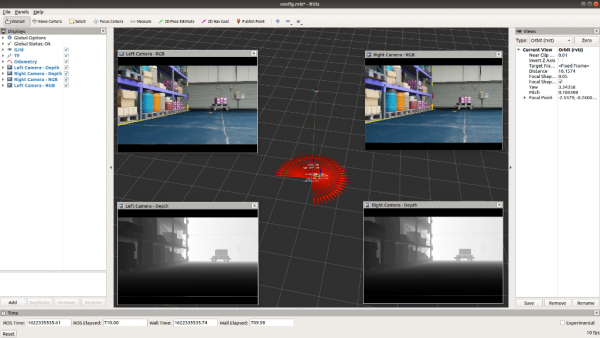

Isaac Sim可以将多摄像头传感器数据发送到Rviz(ROS可视化工具)

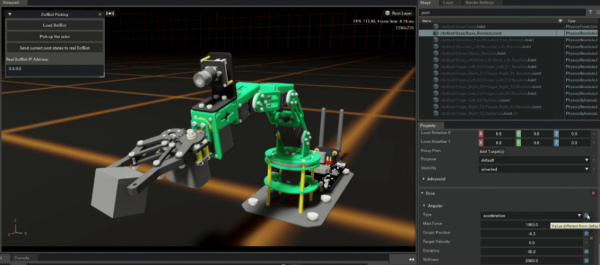

在Isaac Sim中控制Dofbot操作机器人

Isaac Sim实现了更多的机器人模拟

开发者早已明白强大的模拟环境对机器人测试和训练的益处,但此类模拟器往往存在着限制其使用的缺点。Isaac Sim通过以下优势来弥补这些缺点。

逼真的模拟

为了提供逼真的机器人模拟,Isaac Sim运用了Omniverse平台的强大技术:使用PhysX 5进行高级GPU物理模拟、借助实时光线追踪和路径追踪实现高逼真度,以及支持物理渲染的材质定义语言(Material Definition Language ,MDL)。

模块化设计与丰富的应用

Isaac Sim专为解决许多最常见的机器人用例而创建,包括操控、自主导航和用于训练数据的合成数据生成。其模块化设计能够让用户轻松自定义和扩展工具集,以适应多种应用和环境。

无缝连接和互操作性

借助NVIDIA Omniverse,Isaac Sim可以使用Omniverse Nucleus和Omniverse Connectors在通用场景描述(USD)中合作构建、分享、导入环境模型与机器人模型。通过ROS/ROS2接口或功能齐全的Python脚本,以及用于导入机器人模型和环境模型的插件,可以轻松地让机器人的大脑与虚拟世界相连。

Isaac Sim的合成数据生成助力实现机器学习

合成数据生成是一个重要的工具,它正在被越来越多地用于训练当今机器人的感知模型。获取真实世界的、正确标记的数据是一项耗时且成本高昂的工作。 但就机器人技术而言,在现实世界中收集某些所需的训练数据可能太困难或太危险。 对于必须靠近人类工作的机器人来说尤其如此。

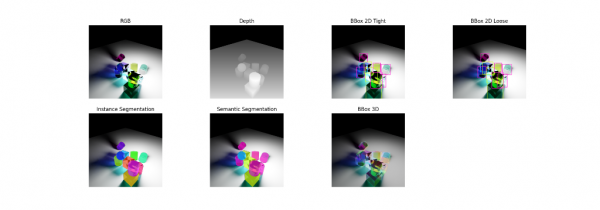

Isaac Sim 内置了对训练感知模型很重要的各种传感器类型的支持。这些传感器包括 RGB、深度、边界框和分割。

玻璃物体的真值合成数据

在公测版中,我们能够输出KITTI格式的合成数据。这些数据可以直接用于NVIDIA迁移学习工具包,以使用特定用例数据提高模型性能。

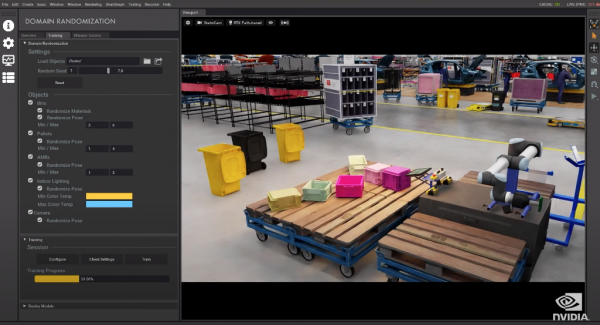

域随机化

域随机化能够对定义模拟场景的参数进行更改,如场景中的照明、颜色和材质纹理等。域随机化的主要目标之一,便是通过将神经网络暴露在所模拟的各种域参数中,来加强机器学习(machine learning ,ML)模型的训练。这有助于模型在真实世界场景中实现有效的泛化。实际上,这项技术能够教会模型忽略不重要的内容。

工厂场景的域随机化

Isaac Sim能够对定义一个特定场景的多个不同属性进行随机化。借助这些功能,机器学习工程师可以确保合成数据集包含足够的多样性来驱动稳健的模型性能。

可随机化的参数

|

颜色 |

动作 |

|

规模 |

亮度 |

|

纹理 |

材质 |

|

网格 |

可视性 |

|

旋转 |

|

在Isaac Sim公测版中,我们通过允许用户定义随机化区域来增强域随机化功能。开发人员现在可以在场景中要随机化的区域周围绘制一个框,场景的其余部分将保持静态。

更多关于Isaac Sim的信息

观看2021年GTC大会上的最新Isaac Sim 分会:从模拟到现实。https://www.nvidia.com/en-us/on-demand/session/gtcspring21-s31824/

可通过以下教程进一步了解如何导入您自己的机器人。

https://www.youtube.com/watch?v=pxPFr58gHmQ

阅读开发者博客,进一步了解如何使用Isaac Sim来训练Jetbot:

- https://developer.nvidia.com/blog/training-your-jetbot-in-isaac-sim/

- https://developer.nvidia.com/blog/training-your-nvidia-jetbot-to-avoid-collisions-using-nvidia-isaac-sim/

即刻下载

现已有成千上万的开发者采用Isaac Sim机器人进行开发,欢迎加入我们的抢先体验计划,成为这一社区中的一员。即刻下载Isaac Sim,体验更高级的机器人模拟功能。

来源:业界供稿

好文章,需要你的鼓励

OpenAI加速推进IPO,或于9月上市

据《华尔街日报》报道,在马斯克针对OpenAI的诉讼失败后,OpenAI正加速推进IPO计划。CEO萨姆·奥特曼希望公司最快于今年9月上市,目前已与高盛、摩根士丹利合作,并可能在数日或数周内秘密提交上市申请。与此同时,马斯克旗下SpaceX的IPO文件也预计近期公开。两家公司的上市竞争,标志着马斯克与奥特曼的博弈从法庭转移至资本市场。

当探索撞上天花板:KAIST团队教会AI“换个思路想想“的聪明办法

KAIST团队提出策略助推方法,通过强制分配解题方向引导AI探索多样思路,仅用八份样本就超越了消耗八倍资源的传统方法。

51%专业人士称AI“工作垃圾“降低生产力——两步解决方案

调查显示,51%的专业人士认为AI生成的低质量内容(即"workslop")正在降低生产效率,45%的人因此对职场使用AI更加谨慎。这类内容表面精致却缺乏准确性和实质价值。专家建议两步应对:一是重塑AI生产力思维,推行"AI先行、人工复核"的工作模式;二是保持持续投入,深入掌握AI工具的有效用法。企业领导者强调,真正从AI中受益需要坚持与学习,而非浅尝辄止。

研究团队的核心想法用一句话概括就是:在训练这台切片机的时候

专门告诉它"文字和脸是重要的

必须切好"。 要理解这个改动有多巧妙

得先看看以前的切片机是怎么训练的。传统的训练方法会用三种"考核标准"来评价切片机的表现。第一种叫"重建损失"

当一个AI画师终于学会写字和画脸:清华大学与微软联手破解图像生成的“老大难“

要理解这项研究,先得明白现在的AI是怎么"画"图的。 可以把AI生成图片的过程想象成一个特殊的厨房。当AI要学会画图时,它不会像人类画家那样一笔一画地描绘,而是采用一种叫做"自回归"的方式——简单说就是"一个食材接一个食材地添加"。但问题在于,AI厨房处理的"食材"不是真实的图像像素,而是一种被压缩过的"标准化食材包"。 这个压缩过程,叫做"离散分词",由一个叫"分词器"(tokenizer)的设备完成。打个比方,分词器就像一台高级的食材切片机,它把一整张图片切成很多小块,然后给每一小块贴上一个"编号标签",对应到一本"标签字典"(也就是研究者口中的"码本")里的某个条目。比如,标签001可能代表"蓝天的一小块",标签002代表"绿草的一小块"。 这种做法的好处是大幅简化了AI的工作量——它不用记住几百万个像素,只需要记住一串编号就行了。这就是为什么如今像Chameleon、Emu3这些大名鼎鼎的多模态AI模型都用这种技术。 但问题也恰恰出在这里。当切片机以16倍的压缩率工作时(也就是说原本256个像素被压缩成1个标签),很多细节就被无情地丢弃了。蓝天少一些云彩、草地少几根草尖,人眼几乎看不出来。可一旦切到了文字或人脸,灾难就发生了——一个英文字母"e"和"c"的差别可能就在那么几个像素,一张脸上眉眼的位置稍微挪一挪,整个人就变了样。 研究团队发现,认知科学研究早就指出,人类的视线会不自觉地被文字和人脸吸引,对这两类内容的细节扭曲特别敏感。换句话说,AI画其他东西糊一点没关系,但文字和脸糊了,用户立马就能察觉。 之前的研究者也意识到了这个问题,他们的解决思路通常是"加大切片机的容量"——比如把标签字典从1万6千条扩展到26万条,或者让每张图用更多的标签。但这就像为了切好一根胡萝卜而把整个厨房改造成大型工厂,成本高得离谱,而且效果也不见得好。 清华和微软的团队提出了一个完全不同的思路:与其让切片机变得更大,不如教它学会"看重点"。 二、给切片机装上"火眼金睛"

Nomad推出Olde Dublin皮革钱包新品系列

比亚迪宋Ultra EV完成2700英里长途测试

企业推理场景中的AI加速器多样化趋势

Gemini Spark让谷歌过度获取用户数据

初创公司融资4300万美元打造船舶"蜂群智能"网络

OpenAI加速推进IPO,或于9月上市

51%专业人士称AI"工作垃圾"降低生产力——两步解决方案

微软宣布:Teams"共聚模式"将于6月底正式退出历史舞台

Selector推出多云网络可观测性平台,填补混合云可见性空白

Riverbed为Aternity平台推出全面自主AI能力升级

AI落地深水区的技术账本:软件质量治理如何破解工程化瓶颈

Google Health 5.0 正式推出,安卓端新增数据统计小组件

NVIDIA Blackwell 现已在云端全面可用

为“代理式AI”装上“护栏” NVIDIA打造“三重防线”

黄仁勋现身北京致辞:60年后,计算机正被重新定义

CES 2025 | NVIDIA Isaac GR00T Blueprint 让人形机器人“加速进化”

未来,就在我们手中

CES 2025 | 代理式AI崛起:NVIDIA定义下一代“代理式 AI Blueprint”

深度学习最佳 GPU,知多少?

NVIDIA推出用于多语言生成式人工智能的NeMo Retriever微服务

NVIDIA 初创加速计划 | 2024 NVIDIA 创业企业展示完美收官!

老黄掏出“迷你版AI超算”,每秒67万亿次运算,仅售2070元人民币