NVIDIA Jetson Nano 2GB ПөБРОДХВЈЁ11Ј©ЈәДгУҰёГБЛҪвөД OpenCV

ФЪұҫПөБРЙПТ»ЖӘОДХВЦРЈ¬ОТГЗҙшБмҙујТХЖОХБЛСХЙ«ҝХјд¶ҜМ¬өчҪЪјјЗЙЎЈФЪұҫЖӘОДХВЦРЈ¬ОТГЗҪ«ҙшБмҙујТБЛҪв OpenCVЎЈ

З°ГжБ¬РшјёЖӘФЪ Jetson Nano 2GB ЙПЈ¬ЦҙРР¶аёцјтөҘЗТКөУГөД Python өД OpenCV ПоДҝЈ¬¶јКЗЗбЛЙөчУГ JetPack ФӨЧ°өД OpenCV ҫНДЬКөПЦөД№ҰДЬЈ¬І»РиТӘ¶оНв°ІЧ°ЖдЛыҝвЈ¬°ьАЁИЛБіУлСЫҫҰјмІвөД·¶АэЎЈ

JetPack ОӘ Jetson Nano 2GB °ІЧ°өД OpenCVЈ¬КЗҫӯ№э NVIDIA МШөч№эөДЈ¬ТтОӘ Jetson Nano 2GB өДДҝөДКЗТӘіЙОӘұЯФөјЖЛгЙиұёЎЈУЙУЪёчПојЖЛгЧКФҙ¶јПа¶ФҫЦПЮЈ¬ТтҙЛ JetPack ЛщМṩөД OpenCV ЦчТӘұЈБфјЖЛг»ъКУҫхЦРЧоіЈУГөД»щҙЎ№ҰДЬЎЈ

ТФПВҫНХыАнјёёц Jetson Nano 2GB ЙПЧоіЈУцөҪөД OpenCV ОКМвЈә

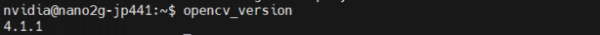

1. Хвёц OpenCV КЗКІГҙ°жұҫЈҝ

ҙрЈәХвАпјмІй OpenCV °жұҫөД·Ҫ·ЁУРәЬ¶аЦЦЈ¬ПВГжБҪЦЦКЗЧојтөҘөДЈә

(1) ЦұҪУЦҙРР opencv_version ЈЁИзПВҪШЖБЈ©Јә

(2) УЙУЪХвАпөД OpenCV К№УГ dpkg №ӨҫЯҪшРР°ІЧ°Ј¬ТтҙЛҝЙТФК№УГТФПВЦёБојмІй°жұҫЈә

өЪ¶юЦЦ·Ҫ·Ё»№ДЬҝҙөҪ°ІЧ°БЛЦ§іЦ Python өД°жұҫЈ¬ТФј° Samples ·¶АэЎЈ

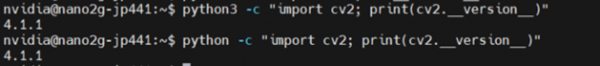

2. Хвёц OpenCV Ц§іЦДДёц Python °жұҫЈҝ

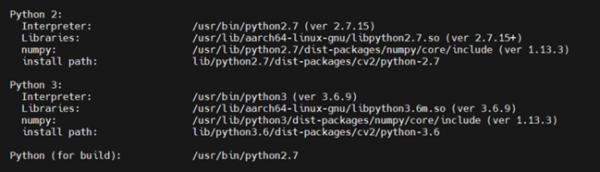

ҙрЈәJetPack ОӘ Jetson Nano 2GB °ІЧ°БЛ 2.7 Ул 3.6 БҪёц°жұҫ Python ҝӘ·ў»·ҫіЈ¬ҝЙТФ·ЦұрЦҙРРТФПВЦёБоИҘ·ЦұрИ·ИПЎЈ

ұнКҫХвёц OpenCV Ц§іЦ 2.7 Ул 3.6 ХвБҪёц°жұҫөД PythonЎЈ

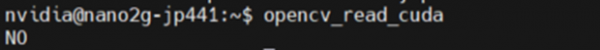

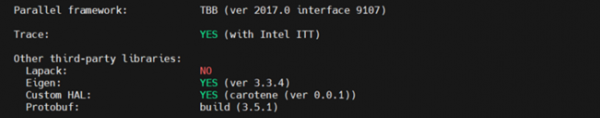

3. Хвёц OpenCV Ц§іЦ CUDA јЖЛгЈҝ

ҙрЈәХвАпУРёцЧојтөҘөДЦёБо“opencv_read_cuda”,ФЪИОәОөШ·ҪЦҙРРЈ¬ПФКҫИзПВЈә

ХвАпөГөҪөДҙр°ёЖДБоИЛТвНвЈ¬ҫУИ»КЗ“NO”,ұнКҫІ»Ц§іЦ CUDAЎЈ

ХвКЗТтОӘЗ°ГжЛщЛөЈ¬ОӘБЛҪЪКЎ Jetson Nano 2GB өДјЖЛгЧКФҙЈ¬ТтҙЛХвёц OpenCV Ц»МṩЧо»щұҫјЖЛг»ъКУҫхөД№ҰДЬЈ¬Б¬ NVIDIA ЧФјәөД CUDA Ц§іЦІҝ·ЦТІИҘіэЎЈИз№ыРиТӘК№УГЦ§іЦ CUDA №ҰДЬөД OpenCV °жұҫЈ¬РиТӘҙУ OpenCV №ЩНшПВФШФҙҙъВлҪшРР°ІЧ°Ј¬ХвАаҪМІДНшЙПУРәЬ¶аЈ¬ЗлЧФРРҙҰАнЎЈ

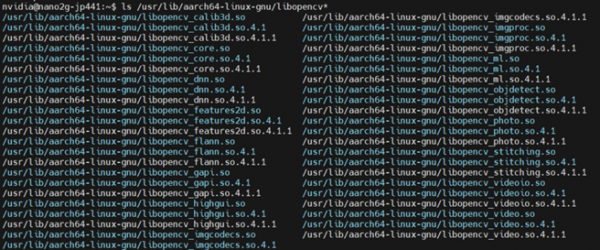

4. Хвёц OpenCV Ц§іЦДДР©ҝвЈҝ

ҙрЈәЧојтөҘөД·ҪКҪҫНКЗЦұҪУјмІйТС°ІЧ°өД lib ДЪИЭЈ¬ЗлЦҙРРТФПВЦёБоЈә

ҝЙТФёщҫЭЙПКцБРұнХТіцТС°ІЧ°өДБРұнЎЈ

5. ИзәОИЎөГ OpenCV НкХыөД°ІЧ°УлЦ§іЦРЕПўЈҝ

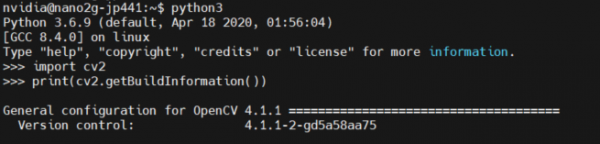

ҙрЈәҝЙТФФЪ python Ап»гИл cv2 Ц®әуЈ¬ЦҙРР cv2.getBuildInformation()Ј¬ИзПВНјЈә

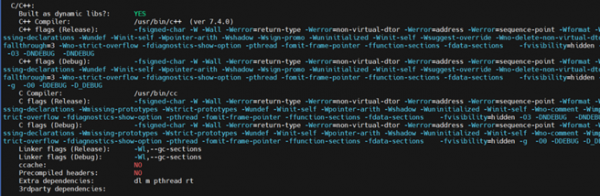

ПВГж»№УР·ЗіЈ¶аөДРЕПўЈ¬АэИзУл C/C++ УР№ШөДЈЁИзПВҪШЖБЈ©Јә

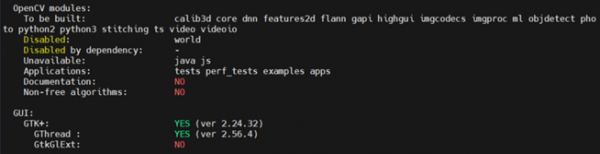

ТС°ІЧ°өДДЈЧйЈЁИзПВҪШЖБЈ©Јә

АэИзЙПНјҫНДЬҝҙөҪ¶Ф FFMPEGЎўGSTREAMER Ул v4l/v4l2 өДЦ§іЦ°жұҫЎЈ

¶Ф Python өДЦ§іЦЈЁИзПВҪШЖБЈ©Јә

РЕПўДЪИЭ·ЗіЈ¶аЈ¬ЗлЧФРРФД¶БЎЈ

6. РиТӘЙэј¶¶Ф Python өДЦ§іЦЈҝАэИзЦҙРР pip3 install opencv-python »т sudo apt install python3-opencv

ҙрЈәХвБҪЦЦ·ҪКҪ¶ј»бІъЙъОКМвЈ¬ҪЁТйІ»ТӘК№УГЎЈ

- pip install opencv-python °ІЧ°·Ҫ·ЁЦ»¶Ф Python3 УРР§Ј¬ө«ЦҙРРЦ®әуҝЙДЬ»бУ°ПмОИ¶ЁРФЎЈХвҙОіўКФөДҪб№ы»бФміЙ“code-dump”ҙнОуЎЈ

- sudo apt install python-opencv python3-opencv »бК№ OpenCV °жұҫҪөОӘ 3.2.0 ТІІ»әПККК№УГЎЈ

ТФЙПХл¶Ф NVIDIA JetPack ОӘ Jetson Nano 2GB ЛщМṩөД OpenCV ҝӘ·ў»·ҫіЈ¬ТФј°ҙуІҝ·ЦҝӘ·ўХЯЧоіЈјыөДОКМвЈ¬МṩһёцјтөҘХыАнЎЈ

АҙФҙЈәЦБ¶ҘНшјЖЛгЖөөА

әГОДХВЈ¬РиТӘДгөД№ДАш

ВхПтTokenҫӯјГКұҙъЈ¬F5ТФЎ°AIёіДЬҪ»ё¶ЎұЦю»щЦЗДЬРВЙъМ¬

ЖуТөМёAI»щҙЎЙиК©КұЈ¬ЧўТвБҰНщНщКЧПИјҜЦРФЪДЈРНЎўGPUәНЛгБҰјҜИәЙПЎЈө«өұҙуДЈРНУҰУГЧЯПт№жДЈ»ҜНЖАнЈ¬Т»ёцЖҝҫұҝӘКјёЎПЦЈәЛгБҰІЙ№әНкіЙЈ¬ІўІ»ТвО¶ЧЕTokenДЬ№»ұ»ОИ¶ЁЎўөНіЙұҫЎўҝЙҝШөШҪ»ё¶іцИҘЎЈ

өұAI»ъЖчИЛЎ°ЧФРЕөШЎ°ЧІПтЗҪұЪЈәSTATE16СРҫҝФәҪТКҫОпАнAIПөНіЦРДЗР©ОЮЙщОЮПўөДЦВГьҙнОу

STATE16СРҫҝФәХвЖӘЧЫКц·ўПЦЈ¬ОпАнAIПөНіҙжФЪ"ҫІД¬К§Р§"·зПХЎӘЎӘAIТФёЯ¶ИЧФРЕЦҙРР»щУЪҙнОуКАҪзРЕПўөД¶ҜЧчЈ¬ИҙІ»ҙҘ·ўИОәОұЁҫҜЈ¬ІўМбіцФЪAIКдіцУлОпАнЦҙРРЦ®јдҪЁБў¶АБўКЪИЁІгөДҝтјЬЎЈ

ГЧАӯЎӨДВАӯМбЦШ·ө№«ЦЪКУТ°Ј¬ҪчЙч·ўЙщ

ДВАӯөЩКұёф18ёцФВКЧҙОҪУКЬЦШҙуГҪМеІЙ·ГЈ¬ҪйЙЬЖдҙҙБўөДThinking Machines LabХэФЪҝӘ·ўөД"Ҫ»»ҘДЈРН"ЎЈёГДЈРНДЬТФ200әБГлјдёфҙҰАнТфЖөЎўОДұҫәНКУЖөБчЈ¬І¶ЧҪИЛАаҪ»БчЦРөДЦР¶ПЎўРЮХэәННЈ¶ЩЎЈЛэ»№Мёј°OpenAI"ХюұдЦЬ"ҫӯАъЈ¬ЗҝөчРРТөҫцІЯИЁ№эУЪјҜЦРөДөЈУЗЈ¬Іў»ШУҰБЛ№«ЛҫҪьЖЪСРҫҝИЛФұАлЦ°ОКМвЈ¬ұнКҫХвКЗіхҙҙКөСйКТөДХэіЈІЁ¶ҜЎЈ

өұAIС§»бЎ°ұЯёЙұЯС§Ў°ЈәUIUCУлОўИнБӘәПҙтФмөДНшТіЦЗДЬМеСөБ·РВ·¶КҪ

UIUCУлОўИнБӘәПСР·ўөДOpenWebRLҝтјЬИГ4BРЎДЈРНҪцЖҫ400МхіхКјКэҫЭЈ¬НЁ№эФЪХжКөНшХҫЙПұЯЧцұЯС§өДЗҝ»ҜС§П°·ҪКҪЈ¬ФЪНшТіЦЗДЬМе»щЧјЙПі¬ФҪБЛУГ27НтМхКэҫЭСөБ·өДҫәХщ¶ФКЦЎЈ

ГЧАӯЎӨДВАӯМбЦШ·ө№«ЦЪКУТ°Ј¬ҪчЙч·ўЙщ

МШЛ№АӯТЙЛЖЙҫіэFSDЦӨҫЭЈ¬ҝЁМШұЛАХјУЛЩөз¶Ҝ»ҜІјҫЦЈ¬ёЯС№ПөНіјјКхЕаСөҝМІ»ИЭ»ә

ЦЗДЬМеНшВзБчБҝКЧі¬ХжИЛ·ГОКЈ¬"ЛАНц»ҘБӘНш"АнВЫТэ·ўРВХщТй

Mentium Technologies Luna-R1 AIРҫЖ¬ИлСЎET-01РЗЧщИООсЈ¬НкіЙ¶аРЗІҝКрАпіМұ®

МАөАЙъЎБТҰЛіУкЈәМЪС¶AIПВ°ліЎЈ¬ЖҙөДКЗЎ°ДЈРНЎБІъЖ·ЎұПөНіДЬБҰ

AIЗэ¶ҜНшВз·ёЧпКэБҝмӯЙэЈ¬АХЛчИнјюКЬәҰХЯДкФц389%ЈәFortinet ·ўІј2026ДкИ«ЗтНюРІМ¬КЖСРҫҝұЁёж

InboltҪ«ФЪAutomateХ№»б·ўІјКУҫхЗэ¶Ҝ»ъЖчИЛұаіМРВ№ҰДЬ

ұКјЗұҫөзДФЙо¶ИЗеҪаЦёДПЈәДЪНвјжРЮ»АИ»Т»РВ

јУАыёЈДбСЗЦЭіЗКРНЁ№эИ«ГАКЧёцУЙСЎГсН¶Жұҫц¶ЁөДКэҫЭЦРРДҪыБо

ІсУНМжҙъ·Ҫ°ёЈәAIКэҫЭЦРРДИзәОАыУГИјЖшТэЗжУлХфЖыОРВЦ№©өз

AI¶ЁТеЖыіөКұҙъЈ¬іөФШТФМ«НшҝЙҝҝРФГжБЩИ«РВМфХҪ

°ІИ«Лг·ЁөДіЦРшёьРВХэұдөГУъ·ўА§ДС

NVIDIA Blackwell ПЦТСФЪФЖ¶ЛИ«ГжҝЙУГ

ОӘЎ°ҙъАнКҪAIЎұЧ°ЙПЎ°»ӨАёЎұ NVIDIAҙтФмЎ°ИэЦШ·АПЯЎұ

»ЖИКС«ПЦЙнұұҫ©ЦВҙЗЈә60ДкәуЈ¬јЖЛг»ъХэұ»ЦШРВ¶ЁТе

CES 2025 | NVIDIA Isaac GR00T Blueprint ИГИЛРО»ъЖчИЛЎ°јУЛЩҪш»ҜЎұ

ОҙАҙЈ¬ҫНФЪОТГЗКЦЦР

CES 2025 | ҙъАнКҪAIбИЖрЈәNVIDIA¶ЁТеПВТ»ҙъЎ°ҙъАнКҪ AI BlueprintЎұ

Йо¶ИС§П°ЧојС GPUЈ¬ЦӘ¶аЙЩЈҝ

NVIDIAНЖіцУГУЪ¶аУпСФЙъіЙКҪИЛ№ӨЦЗДЬөДNeMo RetrieverОў·юОс

NVIDIA іхҙҙјУЛЩјЖ»® | 2024 NVIDIA ҙҙТөЖуТөХ№КҫНкГАКХ№Щ!

АП»ЖМНіцЎ°ГФДг°жAIі¬ЛгЎұЈ¬ГҝГл67НтТЪҙОФЛЛгЈ¬ҪцКЫ2070ФӘИЛГсұТ