NVIDIA赋能的系统迎来新搭档Ice Lake

机器学习和数据分析等数据密集型工作负载已变得司空见惯。为处理这些计算密集型任务,企业需要为实现高性能进行优化的加速服务器。

英特尔于昨日发布第3代英特尔至强可扩展处理器(代号“Ice Lake”)。该处理器基于全新的架构,可大幅提升其性能和可扩展性。在NVIDIA GPU和网络功能的帮助下,新系统成为理想的企业加速计算平台。此外,新系统还具备可实现GPU加速应用的功能。

Ice Lake平台加速计算的优势

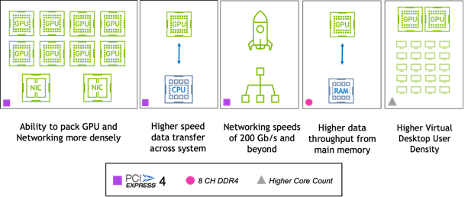

Ice Lake采用了PCIe Gen 4,其数据传输速率比前代产品增加了一倍,现在已经可以与基于NVIDIA Ampere架构的GPU(如NVIDIA A100 Tensor Core GPU)的原生速度相匹配。PCIe Gen 4的采用提高了与GPU间的吞吐量,这对于涉及大量训练数据的机器学习工作负载来说尤为重要。同时,PCIe Gen 4的采用也提高了数据密集型任务的传输速度,比如通过高性能NVIDIA A40数据中心GPU等加速的NVIDIA RTX虚拟工作站3D设计任务。

PCIe性能的提高加快了GPU直接内存访问的传输速度。GPU和采用GPUDirect视频技术的设备之间视频数据I/O通信速度的加快,可助力实现更强大的直播解决方案。

数据速率的提高还实现了200Gb/s的网络速度,例如NVIDIA ConnectX家族的HDR 200Gb/s InfiniBand网卡、200Gb/s以太网网卡,以及即将推出的NDR 400Gb/s InfiniBand网卡技术。

Ice Lake平台支持64条PCIe通道,因此可以在同一台服务器中安装更多的硬件加速器,包括GPU和网卡等,从而提高每台主机的加速密度。这也意味着由最新NVIDIA GPU和NVIDIA 虚拟PC软件加速的多媒体VDI环境可以实现更高的用户密度。

这些增强功能实现了前所未有的GPU加速扩展。企业可以通过在一台主机内使用更多的GPU并更加有效地连接多台主机的GPU,处理最大规模的工作。

英特尔还提高了Ice Lake内存子系统的性能,将DDR4内存通道数从6条增加到8条,使内存的最高数据传输速率达到3200MHz。这使得从主内存到GPU和网络的数据传输带宽变得更大,进而可提高数据密集型工作负载的吞吐量。

最后,处理器本身的改进也进一步加快了计算工作负载的速度。每个时钟周期的指令数增加10-15%,可使加速工作负载所对应的CPU部分整体性能提升多达40%。此外,核的数量也有所增加,比如8xxx系列中的核心多达40个。这将提高每台主机的虚拟桌面会话密度,进一步增加服务器GPU投资的回报。

NVIDIA十分高兴地看到合作伙伴发布由NVIDIA GPU加速的全新Ice Lake系统,用于包括戴尔科技专为GPU加速而打造的Dell EMC PowerEdge R750xa,以及基于第3代英特尔至强可扩展处理器和PCIe Gen4打造的全新联想ThinkSystem服务器(其中有多个型号搭载NVIDIA GPU)。

英特尔的全新Ice Lake平台及随附的加速器硬件非常适合准备更新数据中心的企业客户。全新架构的增强功能使企业能够运行性能更加出色的数据中心级加速应用。NVIDIA与英特尔的共同客户将能够迅速从中获益。

敬请访问NVIDIA认证服务器目录,查看采用Ice Lake CPU的GPU加速服务器型号列表。后续将会有更多系统加入,欢迎定期访问该目录。

来源:业界供稿

好文章,需要你的鼓励

Google Health 5.0 正式推出,安卓端新增数据统计小组件

Google Health 5.0作为Fitbit应用的更新版本正式推出。在安卓端,新版本引入了主屏幕快捷访问小组件,取代原有的圆形步数小组件,可显示最多六项健康指标,支持自定义缩放。点击小组件可跳转至完整统计页面,左上角心形图标可快速打开应用,右侧可直达Health Coach功能。此次更新还启用了全新Google Health图标,移除Fitbit品牌标识。安卓版已于5月19日开始推送,5月26日前全面覆盖。

当电脑学会用尺规作图:中国科学院团队让AI真正“画“出几何题

中科院团队发现顶级AI在几何作图上成功率不到6%,推出PAGER系统将精度提升4.1倍,揭示AI能力评估的关键盲点。

奥迪A2 e-tron入门级电动车将为品牌注入新活力

奥迪宣布将推出入门级纯电动车型A2 e-tron,旨在降低豪华电动车的拥有门槛。该车型基于大众最新MEB平台打造,预计提供50kWh、58kWh和79kWh三种电池选项,续航最高可达630公里。目前原型车正在瑞典北部极寒环境及巴伐利亚道路进行测试,重点验证热管理与电池性能。新车预计售价约4万美元,将于今年秋季正式亮相。

浙江大学联手京东研究院:让AI视频训练快6倍的“闪电秘诀“

浙江大学等机构提出Flash-GRPO视频AI训练新方法,通过同时段分组和梯度校正两项创新技术,实现训练速度提升6倍且质量更优。

51%专业人士称AI"工作垃圾"降低生产力——两步解决方案

微软宣布:Teams"共聚模式"将于6月底正式退出历史舞台

Selector推出多云网络可观测性平台,填补混合云可见性空白

Riverbed为Aternity平台推出全面自主AI能力升级

AI落地深水区的技术账本:软件质量治理如何破解工程化瓶颈

Google Health 5.0 正式推出,安卓端新增数据统计小组件

奥迪A2 e-tron入门级电动车将为品牌注入新活力

周中绿色优惠:Juiced Scrambler电动自行车、Lectric XPress2及多款储能产品特惠来袭

NAMUGA机器人视觉业务向"头部"延伸,加速布局高端机器人解决方案

AMD Silo AI与博洛尼亚大学携手开展空间AI合作,聚焦机器人与自动驾驶领域

Remepy混合疗法帕金森治疗方案即将进入三期临床试验

Exa Labs完成2.5亿美元融资,估值达22亿美元

NVIDIA Blackwell 现已在云端全面可用

为“代理式AI”装上“护栏” NVIDIA打造“三重防线”

黄仁勋现身北京致辞:60年后,计算机正被重新定义

CES 2025 | NVIDIA Isaac GR00T Blueprint 让人形机器人“加速进化”

未来,就在我们手中

CES 2025 | 代理式AI崛起:NVIDIA定义下一代“代理式 AI Blueprint”

深度学习最佳 GPU,知多少?

NVIDIA推出用于多语言生成式人工智能的NeMo Retriever微服务

NVIDIA 初创加速计划 | 2024 NVIDIA 创业企业展示完美收官!

老黄掏出“迷你版AI超算”,每秒67万亿次运算,仅售2070元人民币