挑战英伟达,英特尔发布了三款用于人工智能的芯片

作者:MARIA DEUTSCHER

更新时间:2019年11月12日 美国东部时间14:00

英特尔公司今天推出了三款芯片,用于训练和部署人工智能模型。此举将使其能够与英伟达展开竞争,后者的图形处理单元(GPU)已经在市场上占据了主导地位。

英特尔今天早上在旧金山举行的新闻发布会上发布了这些芯片。这些芯片源自英特尔在2016年收购的两家机器学习公司Nervana Systems和Movidius。这些芯片标志着英特尔在专用人工智能芯片领域前进了一大步,超越了该公司传统主流的Xeon和Core系列产品。

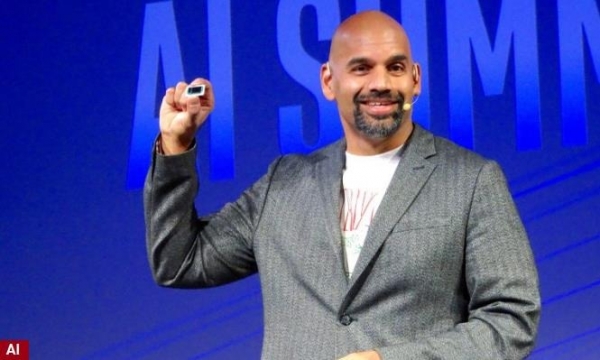

Nervana的创始人Naveen Rao(如图所示,他展示的就是一款新的Nervana芯片)现在担任英特尔的企业副总裁兼人工智能产品部门总经理。他表示,该处理器提供的性能至关重要,因为“我们正在接近一个突破点”,这是计算机软件和硬件的突破点。这已经是一个现实了,这个现实推动了新一代面向人工智能芯片创业公司的出现,其中就包括今天刚刚成立的一家名为Blaize的公司。

针对GPU制造商最直接的产品是Nervana NNP-T1000神经网络处理器。这是一种针对硬件密集型任务进行了优化的集成电路,用于使用示例数据训练人工智能模型。这一过程对于确保模型产生准确的结果是必不可少的,今天绝大多数的人工智能项目都使用了英伟达的芯片完成这一过程。

更快速的学习

在八月份的预览中,英特尔表示NNP-T1000可以管理高达每秒119万亿次操作。该公司不会单独供应处理器,而是会将其作为加速卡的一部分,企业可以将它插入自己的服务器中。这些卡的设计允许用户相对轻松地将很多卡连接在一起,英特尔表示这种做法甚至可以支持超级计算机规模的人工智能训练工作负载。

英特尔的第一款产品是NNP-T1000。该公司没有在自己的工厂进行生产,而是选择将任务委托给外部半导体制造商台积电。这家台湾的企业将采用16纳米的制造工艺生产构成NNP-T1000的270亿个晶体管,并将它们组成24个处理内核。

可扩展的推理

该公司的人工智能芯片产品线的第二款产品是Nervana NNP-I1000。它也是作为加速卡供应的,它不仅针对培训进行了优化,还针对推理进行了优化,一旦开发结束并将部署到生产环境之中,模型就可以对实时数据执行计算。

NNP-I1000基于英特尔最新的10纳米芯片架构。该公司实际上采用了一个10纳米的中央处理单元,将其简化为仅有两个处理核心,并添加了12个专门用于运行人工智能软件的“干涉引擎”。

结果是,英特尔表示该芯片每秒可以执行多达3600次推理。该性能已被ResNest50(一种通常用于评估处理器性能的人工智能模型)实现。基准测试结果分解为每瓦4.8万亿次操作,英特尔称NNP-I1000的这一成绩使其成为同类产品中最节能的芯片。

英特尔称,Facebook和百度等公司已经开始着手部署这两种Nervana芯片。Facebook的人工智能主管Misha Smelyanskiy表示,这些芯片是社交网络巨头加快人工智能工作(例如每天处理60亿次翻译)的关键。

新的边缘硬件

今天公告中最后一款硬件是英特尔的Movidius Myriad视觉处理单元,该产品的代号为Keem Bay。该芯片旨在为低功率设备中的人工智能图像和视频处理系统提供动力,例如依靠机器学习来绕过障碍物的无人机。

英特尔表示最新的Movidius VPU的理论性能是上一代的芯片10倍以上。同时,它的能效比Nvidia的TX2芯片等竞争对手的产品高出6倍。

Rao表示:“人工智能领域要想继续取得令人难以置信的进步,英特尔Nervana NNP和Movidius Myriad VPU之类的专用硬件是必不可少的……人工智能没有唯一的方法。”

英特尔物联网事业部副总裁Jonathan Ballon在谈到英伟达的GPU时,确实强调了创建“专门为”人工智能和机器学习设计的芯片的重要性。GPU最初的目的是用来加速计算机图形,而现在也仍然保持着这个用途。

Rao也强调了相关软件对使用芯片功能的重要性。例如,英伟达的CUDA——这是一个软件平台以及一组针对并行计算和神经网络的应用程序编程接口——一直是人工智能崛起的关键。他特别提到了英特尔推出的Dev Cloud for the Edge,开发人员可以在购买之前,利用它在英特尔的硬件上测试算法。

话虽如此,Rao今天早上花了很多时间谈论英特尔的传统处理器,并表示它们是大多数人工智能工作的基础,并且现在仍然如此,这些芯片占了他所说的今年35亿美元人工智能业务的大部分,与2017年的10亿美元相比有了大幅度的提高。

他表示:“这一切都始于CPU……至强(Xeon)是人工智能的支柱,也是数据中心的支柱。”

Moor Insights&Strategy的总裁兼首席分析师Patrick Moorhead指出,随着很多工作负载转向了机器学习,英特尔在训练和推理方面投入了大量的资金。他表示:“很高兴看到这些零件最近进入市场,我很期待看到它们在工作负载中的表现如何,以及工具链和现有的产品相比表现如何。”

好文章,需要你的鼓励

大众汽车推进平价电动车战略,两款新车率先下线

大众汽车旗下ID. Polo与Cupra Raval已在西班牙马托雷尔工厂正式下线投产。两款车型起售价分别为24,995欧元和26,000欧元,均基于MEB+平台打造,搭载37kWh或52kWh电池组,续航里程最高可达454公里。这是大众"电动城市车家族"系列的首批产品,预计今年夏末秋初开始交付。大众集团通过跨品牌资源整合,实现约6亿欧元的成本节约,后续还将推出ID. Cross等新成员。

当AI机器人“自信地“撞向墙壁:STATE16研究院揭示物理AI系统中那些无声无息的致命错误

STATE16研究院这篇综述发现,物理AI系统存在"静默失效"风险——AI以高度自信执行基于错误世界信息的动作,却不触发任何报警,并提出在AI输出与物理执行之间建立独立授权层的框架。

三星Health应用迎来AI升级,Galaxy Watch 9发布前夕更新提前揭晓

三星宣布将于6月8日起为Samsung Health应用推出重磅功能更新,赶在Galaxy Watch 9传闻发布之前落地。新版本将引入多项AI驱动的生物特征分析功能,包括:综合心率、血氧、皮肤温度等数据的每日活力评分(Vitals)、结合体成分数据评估长期心脏健康的心脏健康评分、优化训练强度的每日有氧负荷追踪,以及横向对比用户群体的健身指数。此外,应用界面将重新划分为睡眠、营养、活动、正念和体征五大板块,并新增抗氧化指数、年龄指数和听力保护等个性化功能。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。

三星Health应用迎来AI升级,Galaxy Watch 9发布前夕更新提前揭晓

Meta智能眼镜被曝含"人脸识别"追踪代码,隐私风险引发警示

Gemini企业智能体平台的智能体RAG如何实现可靠响应

麻省理工学院AI与计算研讨会:技术进步中不可或缺的人文因素

亚马逊全新数据中心路由架构降低AWS网络能耗40%

iOS 27即将发布,多款iPhone应用将迎来全新设计升级

连接性已成为与计算和存储同等重要的AI基础设施核心要素

开发者仍在等待Meta最新AI模型的API访问权限

迈向Token经济时代,F5以“AI赋能交付”筑基智能新生态

米拉·穆拉提重返公众视野,谨慎发声

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

智能体网络流量首超真人访问,"死亡互联网"理论引发新争议