Nvidia发布GPU上的Kubernetes以加速深度学习负载

GPU在数据中心越来越受欢迎,它可以加速机器学习和深度学习等数据密集型工作负载。现在,全球最大的GPU制造商Nvidia将推出一个与Kubernetes集群配合使用的用例,以加速深度学习模型的训练。

Nvidia本周二表示,将发布Kubernetes on Nvidia GPUs的候选版本,可供开发人员免费使用。该版本是针对那些在多云GPU集群上训练深度学习模型的企业。

Nvidia 是在Computer Vision and Pattern Recognition大会上宣布推出Kubernetes on Nvidia GPUs的,此外还推出了新版本的推理优化工具和运行时引擎TensorRT,以及名为DALI的GPU数据增强和图像加载库,旨在优化深度学习框架的数据管道。

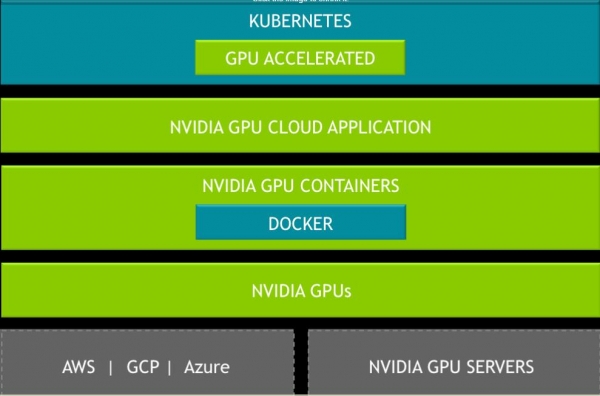

Nvidia表示,推出Kubernetes on Nvidia GPUs背后的想法是为了让软件容器编排平台更加“GPU感知”。Kubernetes on Nvidia GPUs针对的是运行人工智能应用的容器,将帮助开发人员更好地协调散步在多个云主机的GPU集群。

Moor Insights&Strategy创始人兼首席分析师Patrick Moorhead表示:“这很重要,因为Kubernetes托管的应用现在可以利用GPU的性能了。这在虚拟机上将实现比以前更高的可扩展性。”

就在Nvidia这次发布的几周之前,谷歌刚刚在其Kubernetes Engine平台上发布了一个测试版的GPU,旨在加速图像处理和机器学习工作负载。谷歌当时表示,这个云GPU可用于创建由Nvidia Tesla V100、P100和K80处理器驱动的Kubernetes节点池。

Nvidia的TensorRT推理加速器是针对推理模型的开发者。该工具集成了谷歌开源的TensorFlow机器学习框架,并增加了新的层和功能,以加强针对推荐系统、神经机器翻译、图像分类和语音识别等应用的推理。

至于DALI,这是一项为JPEG图像编码提供GPU加速库的服务,旨在解决基于视觉的深度学习应用中的性能瓶颈,目的是为了帮助扩展图像分类系统如PyTorch、TensorFlow和ResNet-50的训练。AWS的P3 8-GPU实例以及Nvidia自己的DGX-1深度学习系统上都将提供DALI。

“深度学习研究人员需要他们的管道是便携的,”Nvidia加速计算软件和AI产品总监Kari Briski说。

来源:至顶网服务器频道

好文章,需要你的鼓励

米拉·穆拉提重返公众视野,谨慎发声

穆拉蒂时隔18个月首次接受重大媒体采访,介绍其创立的Thinking Machines Lab正在开发的"交互模型"。该模型能以200毫秒间隔处理音频、文本和视频流,捕捉人类交流中的中断、修正和停顿。她还谈及OpenAI"政变周"经历,强调行业决策权过于集中的担忧,并回应了公司近期研究人员离职问题,表示这是初创实验室的正常波动。

当AI机器人“自信地“撞向墙壁:STATE16研究院揭示物理AI系统中那些无声无息的致命错误

STATE16研究院这篇综述发现,物理AI系统存在"静默失效"风险——AI以高度自信执行基于错误世界信息的动作,却不触发任何报警,并提出在AI输出与物理执行之间建立独立授权层的框架。

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

本期《Quick Charge》播客涵盖多个热点话题:特斯拉疑似试图删除FSD欺诈相关证据以规避巨额赔付;卡特彼勒持续推进建筑领域电气化布局;住宅太阳能30%税收抵免即将到期。此外,嘉宾Tom Pacheco就高压系统与电池技术培训展开探讨,强调电动车技术人才培养的紧迫性。节目同时提醒有意安装太阳能的用户尽快行动,可通过EnergySage平台比较多家安装商报价。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

智能体网络流量首超真人访问,"死亡互联网"理论引发新争议

Mentium Technologies Luna-R1 AI芯片入选ET-01星座任务,完成多星部署里程碑

汤道生×姚顺雨:腾讯AI下半场,拼的是“模型×产品”系统能力

AI驱动网络犯罪数量飙升,勒索软件受害者年增389%:Fortinet 发布2026年全球威胁态势研究报告

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

笔记本电脑深度清洁指南:内外兼修焕然一新

加利福尼亚州城市通过全美首个由选民投票决定的数据中心禁令

柴油替代方案:AI数据中心如何利用燃气引擎与蒸汽涡轮供电

AI定义汽车时代,车载以太网可靠性面临全新挑战

安全算法的持续更新正变得愈发困难

轨道数据中心本质上是功能强化的卫星