NvidiaгыNetAppКЯзїДђдьЩюЖШбЇЯАGPUЗўЮёЦїаОЦЌ

NetAppКЭNvidiaвбОЭЦГіСЫвЛИізщКЯЪНЕФAIВЮПММмЙЙЯЕЭГЃЌгыPure StorageКЭNvidia КЯзїЕФAIRIЯЕЭГЯрОКељЁЃ

етПюЯЕЭГжївЊеыЖдЩюЖШбЇЯАЃЌгыFlexPodЃЈЫМПЦКЭNetAppКЯзїЕФШкКЯЛљДЁЩшЪЉЃЉВЛЭЌЃЌетПюЯЕЭГУЛгаЦЗХЦУћГЦЁЃЖјЧвгыAIRIВЛЭЌЕФЪЧЃЌЫќвВУЛгаздМКЕФЛњЯфЗтзАЁЃ

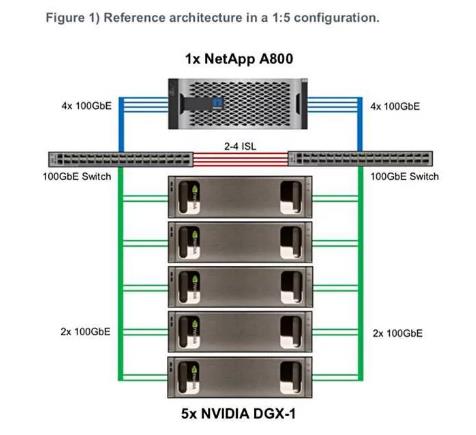

NetAppКЭNvidiaММЪѕАзЦЄЪщЁЖеыЖдЪЕМЪЩюЖШбЇЯАгУР§ЕФПЩРЉеЙAIЛљДЁЩшЪЉЩшМЦЁЗЖЈвхСЫвЛИіеыЖдNetApp A800ШЋЩСДцДцДЂеѓСаКЭNvidia DGX-1 GPUЗўЮёЦїЯЕЭГЕФВЮПММмЙЙЃЈRAЃЉЁЃДЫЭтЛЙгавЛИіЫйЖШТ§вЛаЉЕФЃЌГЩБОИќЕЭЕФЁЂЛљгкA700еѓСаЕФВЮПММмЙЙЁЃ

ИпХфЕФВЮПММмЙЙжЇГжЕЅИіA800еѓСаЃЈИпПЩгУадХфЖдХфжУЃЉЃЌ5ИіDGX-1 GPUЗўЮёЦїЃЌСЌНг2ИіЫМПЦNexus 100GbitEНЛЛЛЛњЁЃЫйЖШНЯТ§ЕФA700ШЋЩСДцеѓСаВЮПММмЙЙжЇГж4ИіDGX-1КЭ40GbitEЁЃ

A800ЯЕЭГЭЈЙ§100GbitEСДТЗСЌНгЕНDGX-1ЃЌжЇГжRDMAзїЮЊМЏШКЛЅСЌЁЃA800ПЩКсЯђРЉеЙЮЊ24НкЕуМЏШККЭ74.8PBШнСПЁЃ

ОнЫЕA800ЯЕЭГПЩЪЕЯж25GB /УыЕФЖСШЁДјПэКЭЕЭгк500ЮЂУыЕФбгГйЁЃ

NetApp Nvidia DLВЮПММмЙЙХфжУЭМ

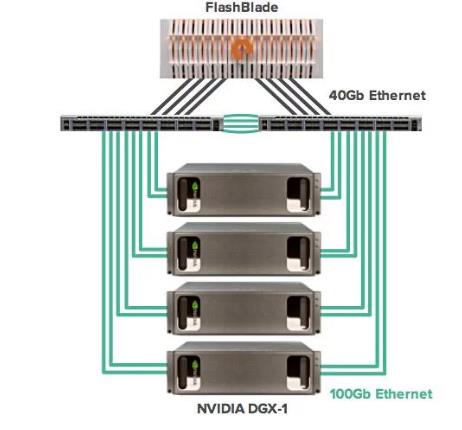

Pure StorageКЭNvidiaЕФAIRIгавЛИіFlashBladeеѓСаЃЌжЇГж4ИіDGX-1ЁЃFlashBladeеѓСаЬсЙЉ17GB /УыЕФЫйЖШЃЌЕЭгк3КСУыЕФбгГйЁЃетгыNetAppКЭNvidiaКЯзїЕФВЮПММмЙЙЯЕЭГЯрБШЫЦКѕНЯТ§ЃЌЕЋA800ЪЧNetAppзюПьЕФШЋЩСДцеѓСаЃЌЖјPureЕФFlashBladeдђИќЖрЕиЪЧвЛПюШнСПгХЛЏаЭЩСДцеѓСаЁЃ

КЭPure AIRI MiniвЛбљЃЌNetApp Nvidia DL RAПЩвдДг1ИіDGX-1Ц№ВНЃЌРЉеЙЕН5ИіЁЃ A800ЕФдЪМШнСПЭЈГЃЮЊ364.8TBЃЌPureЕФAIRIдЪМЩСДцШнСПЮЊ533TBЁЃ

AIRI RAХфжУЭМШчЯТЫљЪОЃК

Pure Nvidia AIRIХфжУЭМ

NetAppКЭPureЖМЖдЫћУЧЕФетСНИіЯЕЭГНјааСЫЛљзМВтЪдЃЌВЂЧвЖМАќКЌRes-152КЭResNet-50дЫааЪЙгУКЯГЩЪ§ОнЁЂNFSКЭ64ХњСПДѓаЁЁЃ

NetAppЬсЙЉСЫЭМБэКЭЪ§ОнЃЌЖјPureжЛЬсЙЉЭМБэЃЌЫљвдЖдБШЦ№РДгаЕуРЇФбЁЃВЛЙ§ЃЌЮвУЧПЩвдЭЈЙ§НЋетаЉЭМБэЗХдквЛЦ№зіИіДжТдЕФЙРМЦЁЃ

КЯГЩЕФзмЭМБэВЂВЛЦЏССЃЌВЛЙ§ШЗЪЕЬсЙЉСЫвЛаЉЖдБШЃК

NetAppКЭPure ResnetадФмЖдБШ

жСЩйДгетаЉЭМБэПЩвдПДГіЃЌNetApp Nvidia RAЕФадФмгХгкAIRIЃЌЕЋШУЮвУЧГдОЊЕФЪЧЃЌгЩгкNetApp/Nvidia DLЯЕЭГгыPure AIRIЯЕЭГЯрБШОпгаИќИпЕФДјПэКЭИќЕЭЕФбгГйЃЌЗжБ№ЪЧ25GB/sЕФЖСШЁДјПэКЭЕЭгк500ЮЂУывдЯТЃЌКѓепЗжБ№17GB/sКЭЕЭгк3КСУыЁЃ

МлИёЖдБШКмКУЃЌЕЋУЛгаШЫЭИТЖИјЮвУЧетЗНУцЕФЪ§ОнЁЃЮвУЧВТВтNvidiaПЩФмЛсаћВМИќЖрЩюЖШбЇЯАЗНУцЕФКЯзїЛяАщЙиЯЕЃЌОЭЯёNetAppКЭPureетбљЕФЁЃHPEКЭIBMЖМЪЧКмУїЯдЕФКђбЁЖдЯѓЃЌЛЙгаЯёApeironЁЂE8КЭExceleroЕШNVMe-oFетбљЕФаТаЫеѓСаГѕДДЙЋЫОЁЃ

КУЮФеТЃЌашвЊФуЕФЙФРј

УзРЁЄФТРЬсжиЗЕЙЋжкЪгвАЃЌНїЩїЗЂЩљ

ФТРЕйЪБИє18ИідТЪзДЮНгЪмжиДѓУНЬхВЩЗУЃЌНщЩмЦфДДСЂЕФThinking Machines Labе§дкПЊЗЂЕФ"НЛЛЅФЃаЭ"ЁЃИУФЃаЭФмвд200КСУыМфИєДІРэвєЦЕЁЂЮФБОКЭЪгЦЕСїЃЌВЖзНШЫРрНЛСїжаЕФжаЖЯЁЂаое§КЭЭЃЖйЁЃЫ§ЛЙЬИМАOpenAI"еўБфжм"ОРњЃЌЧПЕїаавЕОіВпШЈЙ§гкМЏжаЕФЕЃгЧЃЌВЂЛигІСЫЙЋЫОНќЦкбаОПШЫдБРыжАЮЪЬтЃЌБэЪОетЪЧГѕДДЪЕбщЪвЕФе§ГЃВЈЖЏЁЃ

ЕБAIЛњЦїШЫЁАздаХЕиЁАзВЯђЧНБкЃКSTATE16баОПдКНвЪОЮяРэAIЯЕЭГжаФЧаЉЮоЩљЮоЯЂЕФжТУќДэЮѓ

STATE16баОПдКетЦЊзлЪіЗЂЯжЃЌЮяРэAIЯЕЭГДцдк"ОВФЌЪЇаЇ"ЗчЯеЁЊЁЊAIвдИпЖШздаХжДааЛљгкДэЮѓЪРНчаХЯЂЕФЖЏзїЃЌШДВЛДЅЗЂШЮКЮБЈОЏЃЌВЂЬсГідкAIЪфГігыЮяРэжДаажЎМфНЈСЂЖРСЂЪкШЈВуЕФПђМмЁЃ

ЬиЫЙРвЩЫЦЩОГ§FSDжЄОнЃЌПЈЬиБЫРеМгЫйЕчЖЏЛЏВМОжЃЌИпбЙЯЕЭГММЪѕХрбЕПЬВЛШнЛК

БОЦкЁЖQuick ChargeЁЗВЅПЭКИЧЖрИіШШЕуЛАЬтЃКЬиЫЙРвЩЫЦЪдЭМЩОГ§FSDЦлеЉЯрЙижЄОнвдЙцБмОоЖюХтИЖЃЛПЈЬиБЫРеГжајЭЦНјНЈжўСьгђЕчЦјЛЏВМОжЃЛзЁеЌЬЋбєФм30%ЫАЪеЕжУтМДНЋЕНЦкЁЃДЫЭтЃЌМЮБіTom PachecoОЭИпбЙЯЕЭГгыЕчГиММЪѕХрбЕеЙПЊЬНЬжЃЌЧПЕїЕчЖЏГЕММЪѕШЫВХХрбјЕФНєЦШадЁЃНкФПЭЌЪБЬсабгавтАВзАЬЋбєФмЕФгУЛЇОЁПьааЖЏЃЌПЩЭЈЙ§EnergySageЦНЬЈБШНЯЖрМвАВзАЩЬБЈМлЁЃ

ЕБAIбЇЛсЁАБпИЩБпбЇЁАЃКUIUCгыЮЂШэСЊКЯДђдьЕФЭјвГжЧФмЬхбЕСЗаТЗЖЪН

UIUCгыЮЂШэСЊКЯбаЗЂЕФOpenWebRLПђМмШУ4BаЁФЃаЭНіЦО400ЬѕГѕЪМЪ§ОнЃЌЭЈЙ§дкецЪЕЭјеОЩЯБпзіБпбЇЕФЧПЛЏбЇЯАЗНЪНЃЌдкЭјвГжЧФмЬхЛљзМЩЯГЌдНСЫгУ27ЭђЬѕЪ§ОнбЕСЗЕФОКељЖдЪжЁЃ

ЬиЫЙРвЩЫЦЩОГ§FSDжЄОнЃЌПЈЬиБЫРеМгЫйЕчЖЏЛЏВМОжЃЌИпбЙЯЕЭГММЪѕХрбЕПЬВЛШнЛК

жЧФмЬхЭјТчСїСПЪзГЌецШЫЗУЮЪЃЌ"ЫРЭіЛЅСЊЭј"РэТлв§ЗЂаТељвщ

Mentium Technologies Luna-R1 AIаОЦЌШыбЁET-01аЧзљШЮЮёЃЌЭъГЩЖраЧВПЪ№РяГЬБЎ

ЬРЕРЩњЁСвІЫГгъЃКЬкбЖAIЯТАыГЁЃЌЦДЕФЪЧЁАФЃаЭЁСВњЦЗЁБЯЕЭГФмСІ

AIЧ§ЖЏЭјТчЗИзяЪ§СПьЩ§ЃЌРеЫїШэМўЪмКІепФъді389%ЃКFortinet ЗЂВМ2026ФъШЋЧђЭўаВЬЌЪЦбаОПБЈИц

InboltНЋдкAutomateеЙЛсЗЂВМЪгОѕЧ§ЖЏЛњЦїШЫБрГЬаТЙІФм

БЪМЧБОЕчФдЩюЖШЧхНржИФЯЃКФкЭтМцаоЛРШЛвЛаТ

МгРћИЃФсбЧжнГЧЪаЭЈЙ§ШЋУРЪзИігЩбЁУёЭЖЦБОіЖЈЕФЪ§ОнжааФНћСю

ВёгЭЬцДњЗНАИЃКAIЪ§ОнжааФШчКЮРћгУШМЦјв§ЧцгыеєЦћЮаТжЙЉЕч

AIЖЈвхЦћГЕЪБДњЃЌГЕдивдЬЋЭјПЩППадУцСйШЋаТЬєеН

АВШЋЫуЗЈЕФГжајИќаТе§БфЕУгњЗЂРЇФб

ЙьЕРЪ§ОнжааФБОжЪЩЯЪЧЙІФмЧПЛЏЕФЮРаЧ

NVIDIA Blackwell ЯжвбдкдЦЖЫШЋУцПЩгУ

ЮЊЁАДњРэЪНAIЁБзАЩЯЁАЛЄРИЁБ NVIDIAДђдьЁАШ§жиЗРЯпЁБ

ЛЦШЪбЋЯжЩэББОЉжТДЧЃК60ФъКѓЃЌМЦЫуЛње§БЛжиаТЖЈвх

ИУашвЊЖрЩй NVIDIA CUDA Cores ЃП

CES 2025 | NVIDIA Isaac GR00T Blueprint ШУШЫаЮЛњЦїШЫЁАМгЫйНјЛЏЁБ

ЮДРДЃЌОЭдкЮвУЧЪжжа

CES 2025 | ДњРэЪНAIсШЦ№ЃКNVIDIAЖЈвхЯТвЛДњЁАДњРэЪН AI BlueprintЁБ

RTX5090е№КГЗЂВМЃЌвЛЮФДјФуПДЖЎгЂЮАДяCES2025ЗЂВМЛсЁЃ

ЩюЖШбЇЯАзюМб GPUЃЌжЊЖрЩйЃП

NVIDIAЭЦГігУгкЖргябдЩњГЩЪНШЫЙЄжЧФмЕФNeMo RetrieverЮЂЗўЮё