思科首次在UCS服务器中采用AMD Epyc

思科认为,自己的UCS系列服务器需要一个新成员来面向高密度数据中心和边缘部署。

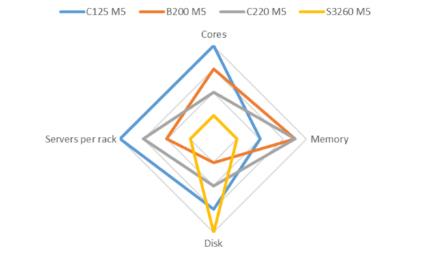

因此思科推出了UCS C4200平台,包括UCS C4200系列机架式服务器和UCS C125 M5机架服务器节点。

这款2U机箱可容纳4个服务器和24个磁盘驱动器,并提供共享电源和散热。但正如思科UCS产品管理总监James Leach所说的那样,“这不是一个刀片环境,因为你不会共享这个结构的。”

这款服务器配置一个或两个AMD Epyc 7000系列处理器,思科之所以这样选择是因为它认为思科能够提供优于竞争对手的性价比。Leach表示,如果有需求的话,思科没有理由不打造一款基于英特尔的服务器以适应机箱配置,甚至是基于ARM的服务器,但目前AMD在满足思科低运营成本和密度目标方面做得最好。

Leach说:“单路服务器的优点是高核心数和低功耗,同时也会给你带来不同的每核心性价比。此外,AMD在CPU上做了大量加密,这一点令人兴奋。”

所有这些对于AMD来说都是令人高兴的,因为这是AMD在UCS服务器上的首次亮相。

思科透露新平台会扮演两种角色,其一是部署在中小型服务提供商的数据中心,这些服务提供商的规模还不够大,无法实现适当的超大规模平台;另一个是部署在边缘,其作用例如帮助游戏公司的计算和存储更接近他们的客户。

关于后者,思科认为采购者会意识到这个平台可以通过UCS管理器或者Intersight管理工具进行管理。另外,AMD的加密技术也是一个卖点。

关于前者,思科认为这个新套件在可扩展性和广度方面与UCS产品组合中的其他产品一样高。

思科的UCS系列以及它的优点

这款服务器的其他特点包括:

最多2个AMD Epyc CPU(每个插槽最多32个内核)

16个DIMM插槽(每个CPU插槽8个)可实现2 TB容量,使用128 GB DIMM

2666 - MHz DDR4内存

2个PCIe 3.0插槽

可选的第4代思科虚拟接口卡

每个C125服务器配置6个SAS/SATA驱动器(前置于C4200机箱中)或者

每个C125 M5服务器最多2个NVMe驱动器和4个SAS/SATA

思科12G 9460-8i PCIe 12G SAS RAID控制器

灵活的OCP 2.0网络夹层插槽支持10、25、40和最高100Gbps的速度

内部SD或M.2启动选项

新套件还可以与思科Hyperflex软件实现超融合,但目前思科在这方面比较低调。

思科对UCS一直抱有很现实的态度,知道这不是一款大众市场的产品。这个策略奏效了,因为商品服务器的利润率很小,而且思科已经可以忽略这个问题了。

扩大UCS范围意味着思科有机会扮演更多的角色。选择AMD对AMD来说也是一次胜利。Epyc和更简易的管理是否足以让服务提供商摆脱他们对商品产品的喜好,这一点仍有待观察。

好文章,需要你的鼓励

公路旅行最佳摄影装备推荐指南

作者是一位热衷旅行摄影的达人,长期驾驶自制露营车出行并携带大量摄影器材。本文基于实际使用经验,为计划公路旅行的读者推荐了一系列实用摄影装备,涵盖综合性能最佳相机、360度全景相机、便携式卡片机、超长焦相机(适合国家公园等野生动物拍摄场景)、迷你相机、移动硬盘、自拍杆、相机遥控器及三脚架等配件,兼顾不同需求与预算。

NVIDIA用一张图片造出一分钟的世界:这个让单张显卡就能生成720p长视频的世界模型是怎么做到的?

NVIDIA发布SANA-WM,一个26亿参数的开源世界模型,可用单张显卡在34秒内生成一分钟720p视频,摄像机控制精度优于现有开源系统。

利亚德沙特 LED 视效工厂预计 7 月投产,Micro LED 本地交付进入中东

今天讲的出海案例是利亚德,这家 1995 年成立、从 LED 显示产品研发生产销售起步,并做到小间距和 Micro LED 的视效科技公司,沙特工厂预计 2026 年 7 月投产。

伊利诺伊大学厄巴纳-香槟分校揭秘:给AI模型建“档案“,让路由系统选对“最强大脑“

这项研究揭示了AI模型路由系统中被长期忽视的关键问题:如何科学地为AI模型建立能力档案直接决定路由质量,结构化档案优于平铺方式。

利亚德沙特 LED 视效工厂预计 7 月投产,Micro LED 本地交付进入中东

谷歌将街景数据接入Genie世界模型,可模拟真实街道场景

保险巨头揭秘现代化改造:何时推进,何时放弃

谷歌全面升级AI订阅计划,用户该如何选择?

英特尔制程双线推进:18A良率稳步爬坡,14A目标2029年量产

贝莱德与谷歌联手推出算力即服务新合资公司

2026年全球AI支出将达2.59万亿美元

大语言模型编辑文档易出错,仅Python领域表现可靠

97%企业布局AI,却只有5%的数据真正准备好了

无线安全:AI 与 AI 之间的攻防对决

谷歌将YouTube Premium Lite捆绑进最优存储套餐

谷歌全新Omni AI视频工具:用数字分身克隆自己

思科与英伟达扩大合作,助力企业加速应用AI技术

AMD 发布新一代 AMD RDNA(TM) 4 架构,推出 AMD Radeon(TM) RX 9000 系列显卡

思科在Cisco Live阿姆斯特丹大会上展示简洁、安全和AI就绪的创新技术

在AI变革的隐形战场上,安全为创新护航

三十年风雨兼程,思科与中国同行的故事

思科庆祝进入中国30周年:推出创新产品并启用上海全新现代化办公室

苏姿丰的十年历程回顾:AMD如何从英特尔廉价替代品成长为x86领域的有力竞争者

面临AMD及自身内部挑战,英伟达Green 500主导地位受到威胁

微软率先拿下HBM驱动的AMD CPU供货

基于 AMD 加速器的 El Capitan 首次登全球超算500强榜首