戴尔EMC和富士通提供对英特尔FPGA的支持

英特尔冀打造现代数据中心基础,为迅猛的数据增长提供解决方案,用的不是更强大的CPU功能,而是现场可编程门阵列(FPGA)加速器。

英特尔的基本思想是将旗下用了Arria 10 GX FPGA的Xeon服务器处理器与用了FPGA的英特尔至强CPU加速堆栈合在一起,达到提升性能和能效的目的。

据悉,戴尔EMC和富士通两家大型服务器原始设备制造商也加入了进来 ,戴尔EMC增加了R640、R740和R740xd对FPGA 的支持,富士通则为PRIMERGY RX2540 M4服务器优先客户提供早期访问权。

英特尔的重点放在财务风险分析和数据库加速两种特殊的工作负载上,这些工作负载将直接从配备了FPGA的服务器中受益。

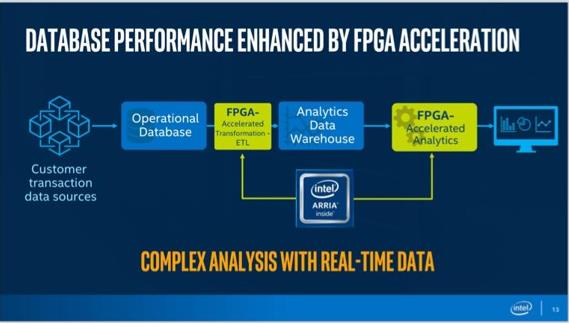

在提高数据库性能方面,英特尔认为FPGA可在系统链的两个阶段(提取、转换、加载阶段和分析阶段)提高性能,进而使实时数据的复杂分析成为现实。

对于那些喜欢测试基准的人来说,英特尔宣称FPGA的实时数据分析速度提高了20倍,存储压缩比则提高了3倍以上。

利用FPGA提高数据库性能

英特尔可编程解决方案部市场副总裁Reynette Au表示,”戴尔EMC和富士通在主流服务器产品中用上英特尔FPGA的强大功能和灵活性,数据中心计算新时代即将到来。 我们为我们的客户和合作伙伴交付硬件性能优势, 令客户能够在软件开发环境中大规模地创建一系列丰富的高性能解决方案。”

除数据分析之外,英特尔认为人工智能、网络安全、视频转码和基因组学也可以从FPGA受益。

英特尔Arria 10 FPGA基于20纳米ARM Cortex-A9 SoC,可提供1.5 TFLOPS的DSP性能,配有96个3.3 Tbps串行带宽的收发器通道,功耗比上一代FPGA低40%。

好文章,需要你的鼓励

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

机器人智能公司Inbolt将于2026年6月在芝加哥Automate展会上发布两项新能力:Inbolt机器人编程功能和扩展版机器人控制模块。新功能可让工程师直接基于CAD模型构建程序,结合视觉模型实时定位实体零件并自动调整运动路径,彻底消除传统调试中耗时数周的手动示教环节。此次更新还将原生支持安川机器人,使平台覆盖品牌扩展至六个。

香港城市大学与快手团队联手:让AI“导演“教会视频生成模型真正“思考“

这项研究提出"VLM即教师"框架,让视觉语言模型在视频生成推理时充当实时监考官,通过可微分奖励信号在线优化轻量LoRA模块,平均提升视频推理性能16.7分。

笔记本电脑深度清洁指南:内外兼修焕然一新

本文提供了一套完整的笔记本电脑深度清洁方案。硬件方面,介绍了如何用温和洗涤剂清洁机身、用微纤维布擦拭屏幕、用压缩空气清理键盘及清洁充电线的正确方法。软件方面,建议及时更新操作系统与驱动程序,删除冗余文件与临时下载内容,并通过开启Windows Storage Sense功能实现自动清理,同时将剩余文件整理归类,保持系统整洁高效运行。

新加坡科研机构最新成果:AI大模型里的“调光开关“,让每个专家按需开灯

这项来自新加坡科学技术研究局的研究提出了κ-SwiGLU,通过路由确信度动态调整专家门控灵敏度,在多种MoE模型上稳定提升性能,新增计算开销不足4%。

AI驱动网络犯罪数量飙升,勒索软件受害者年增389%:Fortinet 发布2026年全球威胁态势研究报告

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

笔记本电脑深度清洁指南:内外兼修焕然一新

加利福尼亚州城市通过全美首个由选民投票决定的数据中心禁令

柴油替代方案:AI数据中心如何利用燃气引擎与蒸汽涡轮供电

AI定义汽车时代,车载以太网可靠性面临全新挑战

安全算法的持续更新正变得愈发困难

轨道数据中心本质上是功能强化的卫星

Infineon Live Lab正式发布:全球首个实时云端实体硬件评估平台

Serve Robotics携手NoScrubs,自主配送机器人跨界拓展洗衣服务

Workr Robotics CEO:工业机器人自动化应按小时付费

专访CreateMe CEO:从缝纫到粘合,实体AI如何重塑服装制造