AMD首次推出嵌入式EPYC和Ryzen处理器

AMD的EPYC和Ryzen处理器嵌入式版本日前出台,从而将Zen架构带入了新的领域,也丰富了AMD公司的处理器产品组合,给英特尔带来更大的压力。

AMD在过去的一年左右的时间里一直都忙得很。2016年8月推出Zen后,我们还看到各种产品的发布:2016年12月的Ryzen; 2017年6月的EPYC和Radeon Vega Graphics; 2017年8月的Ryzen Threadripper; 2017年10月第一款配备Vega Graphics移动部件的Ryzen以及本月早些时候带Vega桌面部件的Ryzen。而且其发展势头在2018年里得以保持。

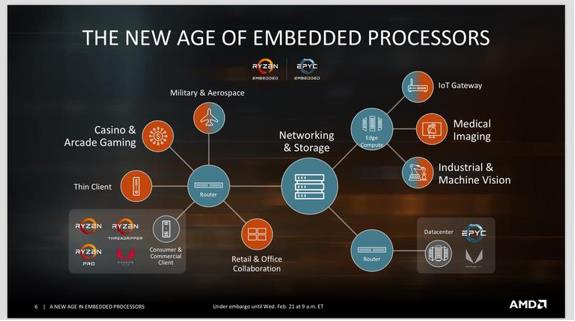

尽管AMD各种芯片很好地覆盖了桌面电脑、笔记本电脑和服务器市场,但总还是存在未被完全覆盖的空间。总部设在加州桑尼维尔芯片制造商AMD推出EPYC和Ryzen处理器嵌入式版本填补了这些空白。嵌入式版本将这些芯片扩展到娱乐场和街机游戏、瘦客户端、5G蜂窝网、医疗成像、物联网网关和路由器等不同领域。

嵌入式EPYC

让我们先来看看新的嵌入式EPYC产品:EPYC 3000系列产品。各种亮点令人印象深刻:

- BGA包(更适合需要更高可靠性的行业,如医疗、交通和军事等)

- 最多可含16个“Zen” x86内核

- 企业级可靠性、可用性和可服务性(RAS)

- 高达32兆字节的共享三级缓存

- 最高提升频率达3.1GHz

- 最多四个内存通道

- 高达1TB的内存容量

- 多达64条PCIe Gen 3通道

- 最多八个10Gb以太网端口

- 多达16个SATA或NVMe通道

- 产品可用性为10年

所有这些都集成在一个SoC包里,这意味着并无芯片组,而且还内置了安全内存加密(根据AMD的说法,只会增加1%到2%的开销)、安全加密虚拟化和硬件信任根(Root-of-Trust)。

该系列的功率范围涵括了35瓦TDP的低功耗4核/4线程及怪物级的100瓦特TDP的16核心/32线程规格,后者旨在应付一些重重量级数据。

EPYC 3000系列处理器的完整产品阵容非常强大,可以满足各种价格和性能要求:

如果将嵌入式EPYC 3451和3251与英特尔的至强D-1587和D-1540(旧款Broadwell,英特尔在过去几周内重新调整了产品阵容)放在一起比较,AMD系列的性能要高50%,而AMD系列的单位美元性能则要高2.7倍。

即便是与英特尔的新Skylake芯片相比,将嵌入式EPYC系列与英特尔硬件比,譬如嵌入式EPYC 3451对至强D-2191(800美元对2407美元)或嵌入式EPYC 3301对至强D-2152IT( 450美元对438美元),AMD系列都能以相同价格或更低价格在性能方面提供更多内容,如内核、高速缓存、内存容量、内存速度、PCIe通道以及更多10GB以太网端口。

AMD主打方向仍然是:更多规模,更多的扩展,更多的内存带宽。

嵌入式EPYC系列支持广泛的操作系统,如红帽(RedHat)的RHEL、Canonical的Ubuntu、Mentor的MEL、Wind的WindRiver及Yocto Project的Yocto。

嵌入式Ryzen

接下来再来看看嵌入式Ryzen芯片:Ryzen V1000系列APU。

亮点如下:

- 高达4核/ 8线程14纳米“Zen”内核,含Radeon Vega Graphics

- 双通道64位DDR4

- FP5插座

- 性能指数达3.6 TFLOPS

- 性能是上一代AMD R系列嵌入式SoC的2倍

- 支持四个4K显示器,支持5K

- 比相应的英特尔芯片封装小26%

- 4K/60fps H.265编解码及支持VP9解码

- 最多两个10Gb以太网端口

- 支持HDMI 2.0b、eDP1.4和DP1.4

- 功率范围在12到54瓦TDP之间

- 产品可用性为10年

这些APU还配有安全内存加密、安全加密虚拟化和安全启动的功能。

V1000系列在基准测试(Cinebench nT和3DMark 11 P)方面与同等英特尔硬件的比较,其多线程性能高多达46%(尽管高端方面的差别类似于V1807B与英特尔的i7- 7700HQ的比价),而GPU性能则高出三倍。

嵌入式Ryzen V1000系列芯片支持以下平台:微软的Windows 10、Canonical的Ubuntu、Mentor的MEL、Wind的WindRiver Linux和Yocto Project的Yocto。

笔者前几天曾碰到诊断超声系统制造商Esaote的首席技术官Andrej Dvorak,与他聊了一会儿。Esaote是AMD的合作伙伴之一,已采用嵌入式Ryzen芯片。笔者想知道新芯片在什么地方对Esaote有吸引力。Dvorak对医疗设备有着深入的了解,对于为什么Esaote在旗下新推出的MyLab 9平台上用了AMD的Ryzen Embedded V1000 APU,他毫无困难地给出了一个长长的、含有各种原因的表:

- 实时处理成像时的高性能,充分利用消费领域的快速硬件创新优势

- 很多性能,仍有空间开发新功能

- 对于较小的设备而言,提供更大功率,而对于较大的设备来说,则可以制造更凉爽的、更安静的机器

- 快速启动时间,由几分钟降到几秒钟(这对于需要快速移动及迅速投入使用的机器至关重要)

- 软件设计架构意味着更大的灵活性以及更好地响应市场需求的能力

- 对未来的保证,对于医疗客户而言,长达10年的生命周期非常重要

Dvorak表示,“Esaote是一家全球顶级的诊断超声系统供应商,Esaote必须与研发先进的信号和图像处理技术科技领导者合作,这些技术可以帮助医生和技术人员做出关键的诊断决策,新的嵌入式AMD Ryzen V1000不仅能使我们提供性能属于世界一流的、清晰的诊断图像,而且其整合程度也令我们能够开发更紧凑的超声系统,从而可以将更好的性能整合到大型机器里,可以为我们的客户和患者改善TCO及为医生和医务人员提供的更好体验。“

还有不少其他客户和合作伙伴也用上嵌入式Ryzen产品,包括希捷、华擎、华硕和Sintrones等等。

好文章,需要你的鼓励

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

本期《Quick Charge》播客涵盖多个热点话题:特斯拉疑似试图删除FSD欺诈相关证据以规避巨额赔付;卡特彼勒持续推进建筑领域电气化布局;住宅太阳能30%税收抵免即将到期。此外,嘉宾Tom Pacheco就高压系统与电池技术培训展开探讨,强调电动车技术人才培养的紧迫性。节目同时提醒有意安装太阳能的用户尽快行动,可通过EnergySage平台比较多家安装商报价。

英伟达与MIT联手:让AI视频“回头看“,长视频生成再也不怕“忘性大“

LongLive-RAG由英伟达、USC与MIT联合提出,通过让AI检索自身生成的历史视频片段作为参考,解决长视频生成中的角色漂移和画面不一致问题。

智能体网络流量首超真人访问,“死亡互联网“理论引发新争议

Cloudflare联合创始人兼CEO马修·普林斯近日表示,AI智能体产生的网络流量已首次超越人类用户,这一里程碑比多数人预期的更早到来。普林斯原本预测该转折点将出现在2027年底或2027年初,但AI智能体流量增长之迅猛远超预期。这一现象也为"死亡互联网"理论提供了新的佐证——该理论认为互联网上的大部分内容和活动已由机器人主导。

马里兰大学出了个“免培训“数学AI方案:让大模型当“考官“,小模型边写边被纠错

马里兰大学提出无需训练奖励模型的数学推理方案,用大模型实时为小模型的分块生成过程打分选优,效果媲美专用过程奖励模型。

智能体网络流量首超真人访问,"死亡互联网"理论引发新争议

Mentium Technologies Luna-R1 AI芯片入选ET-01星座任务,完成多星部署里程碑

汤道生×姚顺雨:腾讯AI下半场,拼的是“模型×产品”系统能力

AI驱动网络犯罪数量飙升,勒索软件受害者年增389%:Fortinet 发布2026年全球威胁态势研究报告

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

笔记本电脑深度清洁指南:内外兼修焕然一新

加利福尼亚州城市通过全美首个由选民投票决定的数据中心禁令

柴油替代方案:AI数据中心如何利用燃气引擎与蒸汽涡轮供电

AI定义汽车时代,车载以太网可靠性面临全新挑战

安全算法的持续更新正变得愈发困难

轨道数据中心本质上是功能强化的卫星

Infineon Live Lab正式发布:全球首个实时云端实体硬件评估平台

AMD 发布新一代 AMD RDNA(TM) 4 架构,推出 AMD Radeon(TM) RX 9000 系列显卡

联发科天玑芯片发布会定档 12 月 23 日举行,预计发布天玑 8400 芯片

苏姿丰的十年历程回顾:AMD如何从英特尔廉价替代品成长为x86领域的有力竞争者

面临AMD及自身内部挑战,英伟达Green 500主导地位受到威胁

微软率先拿下HBM驱动的AMD CPU供货

基于 AMD 加速器的 El Capitan 首次登全球超算500强榜首

突发!AMD大爆雷!

AMD Versal家族再添新成员 ——打破AI内存桎梏 支持CXL 3.1

AMD超低时延金融加速卡 帮你跑赢高频交易“竞速赛”!

要超越英伟达,AMD还须十年时间