解析浪潮AI计算产品GX4:性能强大,随需扩展 原创

至顶网服务器频道 09月29日 新闻消息: 9月25-27日,在GTC China 2017大会上,浪潮展示了基于Tesla? V100的AI计算产品GX4 Box,成为现场的"明星"产品。浪潮的GX4的吸引人之处到底何在呢?今天,我们就来详细剖析一下这款浪潮自主创新的AI计算新品。

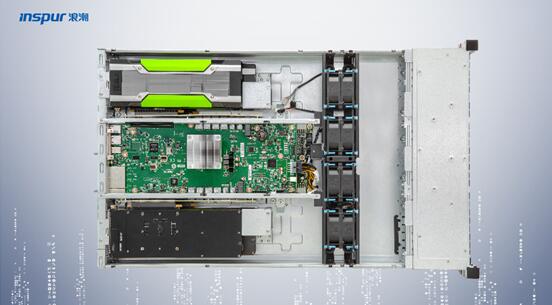

浪潮在GTC China 2017展出AI创新产品GX4

浪潮GX4并不是一台传统意义上的服务器产品,而是一台2U高度的AI box,其中没有CPU、内存,由4块GPU计算加速卡,扩展主板其他支撑部件组成。用户也可部署16块NVMe SSD硬盘替代计算加速卡,作为高密度热数据存储使用。

GX4承袭了浪潮SR-AI整机柜的设计理念,实现了CPU和GPU的物理解耦,使得计算加速单元能够以独立模块的形式进行灵活扩展。这种设计的好处显而易见,它能在保证高效的GPU跨节点通信效率的同时,以灵活的扩展形式敏捷支持不同级别的AI模型训练。有效降低IO冗余和系统购买成本,非常适合深度学习模型训练、科学计算、工程计算与研究领域的应用。

展区实拍浪潮GX4产品

随着训练样本量的指数级增长以及训练模型的复杂度不断提升,AI计算正面临的三大困扰。首先,不同应用需要不同硬件,带来采购和运维成本提升;其次,多机集群的延迟更高;第三,资源扩展不灵活、成本高。针对于此,GX4采用了一些创新的设计来解决这些困扰AI用户的难题。

灵活拓扑支持多类型AI应用需求

GPU与CPU计算资源的解耦和重构,让GX4拥有了更加多样的拓扑结构,可以通过灵活调整GPU拓扑,满足AI云、深度学习模型训练和线上推理等各种AI应用场景,使计算架构与上层应用更匹配,发挥出AI计算集群的最大性能。

目前,GX4可支持Balanced、Common、Cascaded三种不同的GPU拓扑结构。其中,云服务的用户需要做虚拟化,每个VM需要分配对应的GPU资源,为了保证VM的分配GPU的性能均衡性,需要采用Balance方式保证VM下GPU资源的性能均衡;Common模式和Cascaded模式均适合于深度学习模型训练使用,区别在于Common上行有两条X16链路,Cascade只有1条,但是Cascade P2P更优化,以上三种模式可以通过线缆来灵活调整拓补。

浪潮AI计算产品GX4

集群延迟降低50%以上

浪潮AI计算产品GX4能够实现极低的延迟。在传统的GPU集群中,比如单机4卡服务器组成的16卡集群,跨节点间的GPU通信会经过不同协议的转换,CPU、PCIe间的UPI或QPI以及网络的延迟,至少最早造成2us的数据传输延迟。而浪潮GX4能够实现16块GPU之间仅依赖PCI-E进行通信,延迟可降低50%以上,并且借助GPU Direct RDMA技术,使跨节点GPU与GPU实现直接的数据交互,而不再需要经由CPU的跳转,大幅降低跨节点GPU间的通信延迟,最终使GPU计算集群的延迟下降到ns级。

兼具高性价比和高扩展性

GX4组成的AI计算集群,由负责逻辑运算的SA5212M5机架式服务器和包含4块GPU卡的box组成,且单台SA5212M5能够挂接至少4台box。当业务需要更大的AI计算资源时,可以单独采购box来完成高性价比和高灵活性的扩展,最大可实现单物理集群16卡的资源扩展,单精度浮点运算能力最高可达192TFlops,成本可节省,000以上。

资源调配灵活

浪潮GX4组成的AI集群中,SA5212M5可以调用一台box中的1-4块GPU,也可以任意挂接1-4台box。当不同的业务部门有不同的配置需求时候,可以通过软件定义的形式灵活改变单物理集群的GPU卡数量,将资源调度最小颗粒度从服务器级升级为GPU卡级别。

支持多种数据中心环境

由于没有传统服务器架构中的CPU和硬盘等热源,浪潮GX4可以运行在不同的数据中心环境,并且冷风直接透过GPU散热,同样性能下功耗更低。此外,GX4 740mm的深度和传统的高密GPU服务器相比,外形更加小巧,为后部操作和维护提供足够的空间,而所有CPU和GPU通过箱子后部的线缆相连,也极大的方便计算空间的操作和运维。

总而言之,浪潮GX4是一款具有很强灵活性和扩展性的高性能GPU AI计算新品,能够很好的适应不同规模的深度学习模型训练和线上推理的需求以及不同类型AI应用对底层架构的要求,可谓是随需扩展神通广大的"金箍棒"产品。

好文章,需要你的鼓励

据说算力高达1000 TOPS,华硕Ascent GX10深度评测——开箱

当超级计算机被压缩进一个比书本还小的盒子里,这画面有多炸裂?想象一下,你桌面上摆着的不是什么花瓶摆件,而是一台能跑200B参数AI推理的"超算怪兽"——这就是我们今天要聊的主角:华硕Ascent GX10。

Adobe与UCLA联手突破AI模型速度瓶颈:让图像生成快一倍的“稀疏化魔法“

Adobe研究院与UCLA合作开发的Sparse-LaViDa技术通过创新的"稀疏表示"方法,成功将AI图像生成速度提升一倍。该技术巧妙地让AI只处理必要的图像区域,使用特殊"寄存器令牌"管理其余部分,在文本到图像生成、图像编辑和数学推理等任务中实现显著加速,同时完全保持了输出质量。

不用再训练AI模型,香港科技大学团队发明“智能管家“,让AI一眼就知道该抓哪里用哪里

香港科技大学团队开发出A4-Agent智能系统,无需训练即可让AI理解物品的可操作性。该系统通过"想象-思考-定位"三步法模仿人类认知过程,在多个测试中超越了需要专门训练的传统方法。这项技术为智能机器人发展提供了新思路,使其能够像人类一样举一反三地处理未见过的新物品和任务。

据说算力高达1000 TOPS,华硕Ascent GX10深度评测——开箱

苹果发现:只需一个注意力层,就能让AI图像生成既快又好

YouTube推出基于Gemini 3的创作者游戏制作工具

英伟达是唯一能负担免费提供AI模型的厂商

OpenAI发布新旗舰图像生成AI模型GPT Image 1.5

脑启发算法可大幅降低AI能耗

Mac办公桌升级必备配件指南:提升工作效率的最佳选择

PTC Windchill+ 助力 HOLON研发全球首批符合汽车行业标准的 L4 级电动汽车

航旅行业的AI“乘法效应”:迈向指数级进化

OpenAI推出GPT Image 1.5模型加速图像生成竞争

Zoom推出AI Companion 3.0智能体工作流程

ChatGPT成为互联网最受阻止的爬虫机器人