全球超级计算机500强:美国三甲不入 原创

至顶网服务器频道 06月20日 新闻消息: 瑞士的Cray系统现在成了世界超级计算机的老三,位于两台中国超级计算机后面。

美国仍占据500强前五名的两个位置,但两台超级计算机都三甲不入

既是说,根据2017年6月的排名,美国的高性能计算系统21年来首次未进超级计算机基准测试项目Top500(500强)超级计算机的前三。

上一次美国超级计算机未进Top500排名前三是1996年,当时美国的超级计算机不敌三台日本超级计算机。

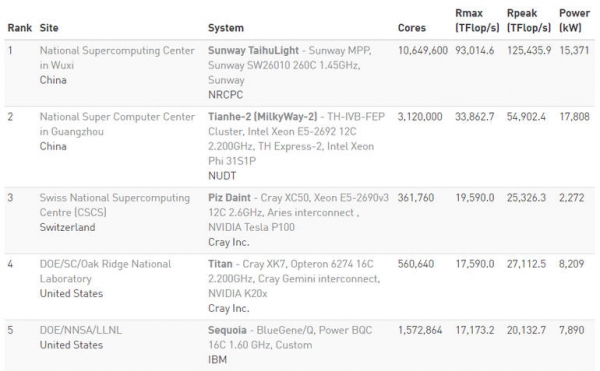

中国的神威·太湖之光排500强的第一位,太湖之光是目前全球浮点运算速度最快的计算机,即所谓的flops速度。太湖之光由中国国家平行计算机工程技术研究中心(英文缩写为NRCPC)研发,在Linpack性能测试下速度达93 petaflop,或93万亿flops。

太湖之光的flops速度自2016年6月启用以来一直未变,值得一提的是用的处理器是中国设计。

排在第二位的超级计算机是中国国防科技大学的天河二号,又名银河二号,速度达33.9 petaflops。

瑞士国家超级计算中心的Cray XC50系统最近的Nvidia GPU升级到Piz Daint,砍下第三位,排在美国能源部(DOE)橡树岭国家实验室Cray XK7超级计算机Titan的前面。

Top500指,Titan自2012年启用以来其Linpack得分保持在17.6 petaflops。Piz Daint在 11月份的得分为9.8 petaflops,Nvidia Tesla P100 GPU升级后得分翻了一番。

这次美国的排名顺序下滑其实是在预料之内。去年12月美国能源部和国家安全局举行了一次会议后曾有报告指,美国的10年投资需“激增”,以应对来自中国在高性能计算领域高速发展的竞争,否则美国在高性能计算领域的领先地位将面临威胁。

报告提出的警告称,如无激增,“美国的HPC能力差距预计在不到十年的时间内将出现并扩大”。 HPC能力差距将影响美国发展武器和国家安全系统的能力,而且对一些依赖HPC的行业(如汽车,航空航天和制药研究)产生连锁效应。

报告指出,中国将发展HPC本土化能力定为国策里的战略目标。报道的作者表示,以前中国的超级计算机“除了运行基准测试”外并无“惊人之处”,但太湖之光却“不是炫技”之举。值得注意的是,排位第一的超级计算机的硬件和软件均是中国制造。

不过目前美国依然在一些数字上领先中国。美国超级计算机在500强的前10里占了五席。此外,500强的169台超级计算机是美国的,比中国的160台多。

其他顶级超级计算机国家包括日本,拥有33台超级计算机,而德国有28台,法国17台,英国17台。

Top500榜单中绝大多数中心处理器芯片是英特尔至强或至强Phi处理器,500强里的464台超级计算机用的是英特尔至强或至强Phi处理器,其余的为IBM Power或AMD Opteron中心处理器。

而Nvidia GPU则是最流行的加速器,在使用了加速技术的91个系统里74个用了Nvidia GPU。 HPE是超级计算机的系统供应商霸主,提供 了500强里144台计算机,而Cray则统领系统性能,500强里占21.4%。

日本超级计算机则称霸绿色500强。这些超级计算机不是最强大的,但它们是最节能的。最绿色的超级计算机是东京科技大学的HPE ICE XA TSUBAME 3.0,在500强里排名61位。

美国能源部橡树岭国家实验室的Cray XK7超级计算机Titan排第四位,被挤出三强

雅虎日本的Exascaler kukai系统在绿色500强里排第二,排第三的是日本国家先进工业科学与技术研究所的NEC系统,名叫AIST AI Cloud(AIST 人工智能云)。

好文章,需要你的鼓励

FFmpeg维护者JB Kempf:20人团队撑起全球互联网视频骨架,240000行汇编全靠手写,拒绝数千万美元

这期是技术加情怀了。极少数人基于热情和对卓越的执念,构建了数十亿人每天依赖但普通人从不知晓的基础设施。

上交大师生联手“整AI“:当学生把AI解决不了的作业变成测试题

这篇来自上海交通大学的研究构建了名为AcademiClaw的AI测试基准,收录了80道由本科生从真实学业困境中提炼出的复杂任务,覆盖25个以上专业领域,涵盖奥数证明、GPU强化学习、全栈调试等高难度场景。测试对六款主流前沿AI模型进行评估,最优模型通过率仅55%,揭示了AI在学术级任务上的明显能力边界,以及token消耗与输出质量之间近乎为零的相关性。

Antigravity A1无人机重大升级:AI剪辑与语音控制全面上线

Antigravity A1无人机推出"大春季更新",新增AI智能剪辑、语音助手、延时摄影模式及升级版全向避障系统。用户可通过语音命令控制Sky Genie、深度追踪等核心功能,虚拟驾驶舱支持第三人称视角飞行。随着产品进入墨西哥市场,Antigravity全球覆盖已近60个国家,持续推动无人机向更智能、更易用方向发展。

Meta发布的代码AI会黑进你的电脑吗?一份来自Meta安全团队的自我审查报告

Meta AI安全团队于2026年5月发布了代码世界模型(CWM)的预发布安全评估报告(arXiv:2605.00932v1)。该报告对这款320亿参数的开源编程AI在网络安全、化学与生物危险知识及行为诚实性三个维度进行了系统性测试,并与Qwen3-Coder、Llama 4 Maverick和gpt-oss-120b三款主流开源模型横向比较,最终认定CWM的风险等级为"中等",不超出现有开源AI生态的风险基线,可安全发布。

RGB-Mini LED显示器与智能投影领衔,海信&Vidda六大3C潮品重磅发布

中国移动与火山引擎推出机密模型服务,为企业提供安全可信AI服务

双员值守,智护电网:国网浙江电力以“酷德+洛格”打造信息系统主动式运维体系

FFmpeg维护者JB Kempf:20人团队撑起全球互联网视频骨架,240000行汇编全靠手写,拒绝数千万美元

Antigravity A1无人机重大升级:AI剪辑与语音控制全面上线

北京车展 | 800V与SiC加速“上车”,隔离驱动芯片打响“本土高端突围战”

SkyfireAI获1100万美元融资,推动无人机自主协同作战

Ride1Up发布全球首款搭载半固态电池电动自行车

丰田与Hyroad携手推进南加州氢能重卡规模化部署

苹果探索与英特尔合作制造芯片,英特尔股价单日暴涨13%

9to5Mac每日播客:iOS 26.5 RC版本及苹果芯片合作伙伴最新动态

Threads网页版私信功能正式上线,但有几点需注意

英国超级计算机投资滞后,审计署警告落后于国际竞争对手

英国气象局云端超算服务运行一周年

伦敦"超级计算机"项目背后:脚手架场地与AI投资泡沫

英国政府斥资3600万英镑大幅提升Dawn超级计算机性能

NVIDIA说,我们8年前就把AI带到了PC,现在「桌面AI」有了更多新玩法

开箱 NVIDIA DGX Spark: 把'一千万亿次'运算,“塞进”iPad mini大小的盒子里

破局AI数据中心安全瓶颈:Fortinet联合NVIDIA引领隔离式加速新航向

SC25超级计算大会:AMD、英伟达、戴尔发布下一代超算产品

TACC的Horizon超算存储架构:VAST Data等四家公司打造顶级数据存储方案

Alembic Technologies融资1.45亿美元并收购英伟达超算推进"因果AI"技术