浪潮NF5568M4落地猿题库 让机器老师更智能 原创

至顶网服务器频道 05月18日 新闻消息(文/刘新萍): 近年来人工智能开始真正进入了人们的生活,开始与各行业应用融合,并让原有的应用更高效、更智能。比如在在线教育行业,"小猿搜题"运用浪潮NF5568M4 GPU服务器将其线下模型训练时间提升5-6倍,让老师从重复性的试题解答中解放出来。

随着计算能力的提升和数据量的积累,近年来人工智能开始真正进入了人们的生活,开始与各行业应用融合,并让原有的应用更高效、更智能。有人甚至扬言,人工智能在不远的将来将会取代一部分人的工作。其实,目前来看,人工智能在现阶段的主要目标是把人们从重复性、可量化的工作中解放出来,类似于机器代替人手,只不过这次技术变革是将人脑从简单重复工作中释放。

小猿搜题,以人工智能方式升级在线教育模式

人工智能让机器也成为"老师"

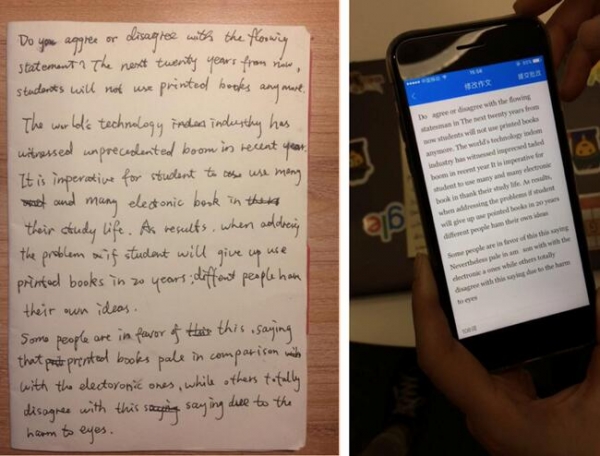

就像目前教育行业也在越来越多的运用人工智能,比如在线教育App"小猿搜题",如果你有不会的题目,通过手机拍照上传,不论是印刷体还是手写体,都能被机器识别,并与后端的题库进行快速匹配,在短短数秒钟得出详细的解答。

要知道,原来每个老师最多也就对应几十、一百多点的学生,而现在在线教育所面向的手中又何止千万,已经远远超出老师人工解答的极限,因此"小猿搜题"这种人工智能+教育的形式,极大地解放了老师对于重复性问题的解答,同时也让学生们能够最快捷地得到最准确的解题思路。

机器已经可以轻松识别手写字体

"AI老师"背后是海量数据的计算

让机器能够快速、准确的回答问题需要几步?首先,机器需要认字,不仅是汉字,还包括英文字母、英文单词、数学中常用的符号等;其次,机器在看到文字之后能够快速的识别、辨认,并将题目转化为可以被机器匹配的数据;最后将这部分数据与后台海量的数据库进行匹配,找到其中的完美匹配项,并将这个匹配项所对应的答案进行输出。从中可以看出,机器的认字和识别,正是人工智能应用中最常被用到的图像识别的一种,前者需要通过数以亿计的样本训练来创建相应的模型,而后者则是根据模型定义的特征识别出文字、符号。

由于每个人的手写习惯不同,识别手写体成为了图像预处理和切分之后首先要面临的挑战,通过大量的样本找到手写习惯的共同特征,如习惯向右倾斜着写或者中文之间没有空格等。更复杂的是数学题的识别,因为数学题目中有大量的复杂公式需要识别,比如根号、分式、上下标的各种组合。这不仅要进行正确的切分,还需要有合理的匹配识别。解决以上两个问题都需要用到深度学习,通过构建卷积神经网络或者递归神经网络,将大量的数据源通过神经网络法计算之后得到符合需求的模型,为最终的使用提供服务。

浪潮AI计算力,让小猿搜题效率提升6倍

不论是创建何种神经网络,都需要对海量样本进行分析,因此对于后端服务器的计算压力极大。因此采用GPU等协处理计算设备来加速人工智能应用成为主流,在线下模型训练中通常会采用核数更多、并行计算能力更强的GPU服务器,而在线上推理应用中可以采用FPGA这种轻量级的计算加速设备。

浪潮NF5568M4 GPU服务器

由于手写字体差异极大,需要大量的模型训练任务,因此"小猿搜题"的技术团队选择浪潮NF5568M4 GPU服务器来加速业务的快速上线。浪潮NF5568M4采用Intel最新Haswell处理器与GPU加速计算技术的协同,CPU主要承担其更擅长的逻辑选择、判断跳转和IO通信方面的职责,而GPU则专职计算密集型、高度并行的计算工作,使得计算资源合理的分配,计算力被充分释放,计算性能达到从几倍到几十倍的增长。NF5568M4在4U空间内配备双路E5-2600v4CPU和4块GPU卡,单机最高单精度浮点计算能力可达每秒40万亿次,将能极大的提升"小猿搜题"海量样本的处理效率。

而在存储方面,GPU计算每天会产生大量的数据,所以存储空间需要保证单机10TB以上。但是由于这部分数据数据属于缓慢写入,并不需要太高的IO,所以采用大容量SATA硬盘来支持就足够满足。NF5568M4支持8块3.5寸硬盘,并通过配置高速的阵列卡,使计算集群拥有500MB/s左右的IO吞吐,足以满足"小猿搜题"线下模型训练应用需求。

通过合理的计算硬件选型,"小猿搜题"在线下模型训练时可以将训练时间提升5-6倍,而线上预测速度也得到2-4倍的提升,再经过语言模型的纠错,小猿搜题最终实现题目拍照之后"秒懂你的心"的效果。

目前,浪潮人工智能相关解决方案在国内主流AI领域的占有率超过80%,为百度、阿里巴巴、腾讯、奇虎、搜狗、科大讯飞、今日头条、Face++等领先企业提供基于GPU/FPGA/KNL等协处理加速服务器和caffe-MPI等软件、算法优化服务,加速中国人工智能应用的发展。

好文章,需要你的鼓励

苹果注重隐私的年龄验证方案可解决两大难题

美国多州和部分国家要求特定应用进行年龄验证,澳大利亚已禁止16岁以下用户使用社交媒体。新提案《应用商店问责法案》建议由苹果和谷歌负责统一验证用户年龄,而非各开发者单独验证。这将提升用户体验,用户只需向苹果或谷歌验证一次身份。凭借苹果在隐私保护方面的优势,该方案可扩展至Safari浏览器,为需要年龄验证的网站提供确认信息,而无需透露用户个人数据。

Meta AI团队首次破解多模态奖励模型评估难题,让AI既能看懂图片又能准确判断好坏

Meta AI首次发布多模态奖励评估基准MMRB2,专门评价AI同时处理文字和图像的能力。该基准包含四大任务类型共4000个专家标注样本,测试23个先进模型。结果显示最佳模型Gemini 3 Pro达75-80%准确率,仍低于人类90%水平。研究揭示AI评价存在视觉偏见等问题,为多模态AI发展提供重要参考标准。

Cursor通过收购Graphite继续扩张之路

AI编程助手Cursor背后的公司Anysphere宣布收购AI代码审查工具初创公司Graphite。据报道收购价远超Graphite今年早些时候B轮融资时2.9亿美元的估值。此次收购具有战略意义,将AI代码生成与AI代码审查工具相结合,可大幅提升从编写到交付的整体效率。Anysphere估值已达290亿美元,近期频繁收购,上月收购技术招聘公司,今年7月还收购AI客户关系管理初创公司Koala的团队。

快手推出Kling-Omni:一个AI模型搞定所有视频制作需求

快手推出的Kling-Omni是首个真正统一的AI视频制作系统,能够理解文字、图像、视频等多种输入方式,不仅可以生成视频,还能进行复杂编辑和推理。该系统通过三个核心模块的协作,实现了从创意理解到最终输出的全流程自动化,让普通用户也能制作专业水准的视频内容,代表了AI视频技术的重要突破。

联想问天 WR5220 G5服务器

联想问天 WA7880a G3服务器

苹果注重隐私的年龄验证方案可解决两大难题

Cursor通过收购Graphite继续扩张之路

ChatGPT新增个性化设置功能,用户可自定义聊天体验

Kuxiu S3固态电池充电宝替代多款充电器的全能解决方案

Waymo自动驾驶出租车遭遇交通灯故障停摆事件分析

智启未来,共筑开发者生态 AMD携手DataWhale、魔搭社区,共建ROCm开发者生态

千问C端事业群成立后首推平价AI眼镜:低至1999元,搭载千问AI助手

Aqara Hub M200为HomeKit带来Matter支持和新自动化选项

LG智能电视强制安装Copilot快捷方式引发用户不满

Palo Alto Networks与谷歌云签署数十亿美元AI合作协议