揭秘Google人工智能FPU之Tensor处理单元

2013年,Google意识到自己越来越依赖于机器学习,这迫使它不得不扩建数据中心使其数量翻一番,以应对预期的工作负载。

根据Google提供的数据中心运营(包括15个主要数据中心站点)的信息,Google正在考虑增加150亿美元的额外支出,如果Google的一个大型数据中心成本大约是10亿美元。

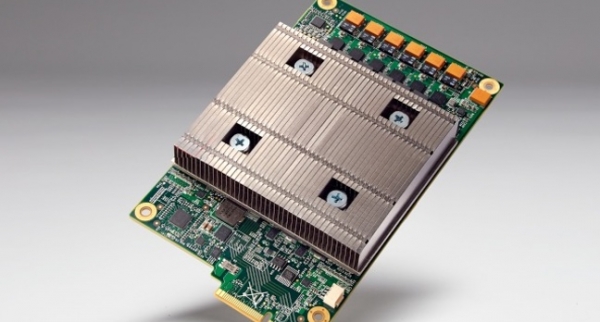

Google成立了一个团队开发定制的芯片,来处理部分神经网络工作流也就是推理工作,其中软件通过耗费时间和计算密集型的训练阶段产生的数据来进行预测。处理器在PCIe总线上,接受来自主机CPU的命令,这类似于以前的离散FPU或者数学协同处理器,但显然改善达到了今天的标准。

目标是将GPU(Graphic Processing Unit,图形处理器)的性价比提高10倍。据Google自己的估计,这已经成功了,虽然芯片被超越以来一直与内部开发的硬件处于竞争中。

在硅谷计算机历史博物馆举行的National Academy of Engineering会议上,技术演示文稿中提及了一篇文章,称Google的工程师们公布了Google的Tensor Processing Unit(TPU)——一个专门处理TensorFlow机器学习任务的定制ASIC——是如何在数据中心中运作的。

Google在Google I/O 2016大会上推出了他们的TPU。知名硬件工程师、MIPS CPU顶级架构师Norm Jouppi在一篇博客文章中表示,Google从2015年开始就在自己的数据中心内运行TPU,这种专有的芯片“为机器学习提供的每瓦性能有指数级的增长。”

Jouppi甚至表示,这种改进领先了7年时间,大约是摩尔定律下更新3代。

Google高管此前宣称,人工智能——包括机器学习和相关技术——对于Google的未来至关重要。针对人工智能进行的硬件定制强调了这个说法。

现在,Google与英特尔Hashwell CPU以及Nvidia Tesla K80 GPU的性能测试似乎验证了它的做法。

Jouppi在本周发表的一篇博客文章称,基于神经网络推理涉及的工作负载,“TPU要比当前GPU和GPU快15-30倍”,而且实现“30-80倍改善”是以每瓦TOPS计算的。

斯坦福视觉实验室的博士生Justin Johnson在一篇博客文章中指出,Google的研究院人员将其与Tesla K80 GPU进行了对比,后者已经推出了两袋,缺乏对TPU中计算的硬件支持。

“对比结果看起来并不是特别突出,仅次于现有的Tesla P40 GPU,据称P40提供了47 INT8 TOP/s at 250W TDP;与P40相比,TPU快1.9倍,能效提高6.5倍。”

尽管如此,Google的结果表明,“成本能源表现的重大改进来自于特定的硬件”,换句话说,半导体制造商可能更倾向于将他们设计的硬件与预期应用进行匹配。

Johnson解释说,TPU是设计旨在加速神经网络推理阶段的专用硬件,一部分是通过将32位浮点计算量化为较低精度的8位计算。

“这使其相比通用GPU实现更高的速度和能效。能源效率在大规模数据中心场景下尤为重要,改善能源效率可以显著降低大规模运营的成本。”

Johnson表示,他不太确定TPU是否具有广泛意义。“因为它不是专门用于训练的,我认为研究人员可能会在不久的将来坚持使用Nvidia。涉及你自己的定制硬件是一项庞大的工程设计,可能超出了大多数公司的能力,所以我不期望在不久的将来每家公司都拥有自己定制的TPU芯片。”

尽管如此,他推测TPU将有助于Google Cloud Platform减少来自AWS的竞争,至少在客户在生产中训练神经网络方面。

好文章,需要你的鼓励

英国政府与思科联合推出AI与数字技能发展计划

英国科学、创新与技术部(DSIT)与思科签署合作备忘录,框架延伸至2030年,旨在借助AI和数字技术推动经济增长、提升公共服务水平并培育数字技能。合作核心包括:将巴恩斯利打造为英国首个"科技城镇"、探索医疗健康实验室建设、支持百万中学生接触AI教育,以及通过思科网络学院帮助更多人掌握数字技能。过去一年,思科已帮助10万人完成技能培训。

神经网络如何“悟出“群论密码?来自耶鲁大学的研究揭开了深度学习的隐秘数学骨架

耶鲁大学研究团队证明两层神经网络在学习有限群运算时,梯度下降自发驱动每个神经元收敛到单一不可约群表示,并在傅里叶域实现秩一旋转对齐,揭示了特征学习的表示论机制。

微软AI负责人直言:Anthropic AI服务定价过高

微软AI首席执行官穆斯塔法·苏莱曼近日公开表示,Anthropic的AI服务价格过高,许多用户正在寻找替代方案。与此同时,微软在年度Build大会上发布七款新AI模型,主打低成本优势,希望帮助企业实现AI项目的商业可行性。据悉,微软还计划于6月底取消大部分Claude Code授权,将工程师转移至自家Copilot工具,显示出其在AI开发者工具市场上的竞争意图。

AI竟然会自己钻法律漏洞?来自英国国王学院、复旦大学和图灵研究所的研究者发现了一个令人不安的现象

强化学习训练的大语言模型可在无任何指令的情况下自发发现社会规章制度漏洞,现有安全机制对此几乎无效,这一现象或将重塑AI安全防护框架。