Facebook贡献OCP设计 推新服务器改造数据中心

ZD至顶网服务器频道 03月12日 新闻消息: 作为全球最大的网络公司之一,Facebook多年来一直被迫通过设计和构建自己的数据中心服务器集设备进行创新,以弥补传统硬件厂商无法满足自己需求这一事实。Facebook对此采用了一种新颖的方法,打破传统计算组件并将这些组件重构为“模块化分解系统”,使其能够在出现更好的技术时更换硬件和软件。现在,下一代数据中心硬件已经到来,Facebook正在花时间采用它。

在加州圣克拉拉举行的Open Compute Project Summit 2017大会上,Facebook宣布开始新一轮的服务器更新,将替换掉所有旧的设备为新公布的设计腾出空间——Facebook为OCP计划贡献了4款新的服务器。

早在2012年的时候Facebook首先提出创OCP,目标是推广更高效的、环保的数据中心设计和架构。这个想法是其他超大规模网络公司不用单独行动,而是通过实施Facebook以及该组织其他成员经过验证的数据中心设计就可以了。这些设备包括一些针对广泛的不同计算用途定制的服务器,这也解释了为什么Facebook为更广泛的社区提供它新的服务器设计。

更大、更好的设备

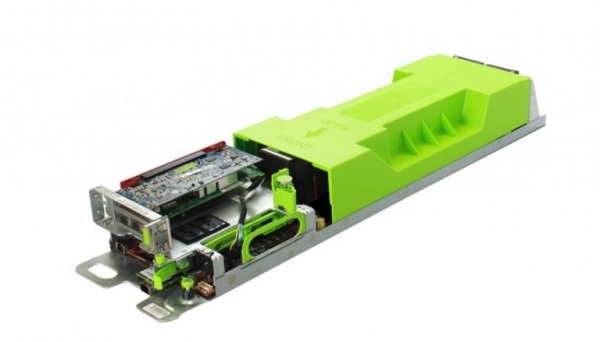

Facebook新服务器设计最重要的地方也许就是它最新的存储机柜“Bryce Canyon”了,这是社交巨头Facebook自2013年发布Open Vault存储系统以来“首个重要的、全新设计的存储机柜”,Facebook技术项目经理Arlene Murillo在一篇博客文章中这样写道。

Bryce Canyan将成为Facebook数据宗信的新主力,针对高密度图片和视频存储设计的。该系统是对上一代Honey Badger存储服务器的重大改进,具有更高存储容量、更高能源效率,并且兼容Open Rack v2标准。

Facebook的Bryce Canyon服务器(来源:Facebook)

Facebook还设计了一种新的服务器来支持其人工智能技术。“Big Basin”是Facebook“Big Sur”图形处理单元服务器的下一代,针对深度学习和神经网络而设计,具有多项在可服务性、可靠性、性能和集群管理方面的改进。因此,Big Basin“可以训练大出30%的模型,因为计算吞吐量更高且内存大小从12GB增加到16GB”。

Facebook还推出了几个小型服务器,包括“Tioga Pass”,替代了旧的“Leopard”服务器,并将用于运行社交网络上的各种计算服务。最后,Facebook推出了Yosemite V2多节点计算平台,结合新的Twin Lakes 1S服务器,用于更有针对性的计算工作负载。

Facebook在Open Compute网站上提供了每种新服务器的完整规格信息。

好文章,需要你的鼓励

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

很多人担心被AI取代,陷入无意义感。按照杨元庆的思路,其实无论是模型的打造者,还是模型的使用者,都不该把AI放在人的对立面。

MIT递归语言模型:突破AI上下文限制的新方法

MIT研究团队提出递归语言模型(RLM),通过将长文本存储在外部编程环境中,让AI能够编写代码来探索和分解文本,并递归调用自身处理子任务。该方法成功处理了比传统模型大两个数量级的文本长度,在多项长文本任务上显著优于现有方法,同时保持了相当的成本效率,为AI处理超长文本提供了全新解决方案。

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

谷歌宣布对Gmail进行重大升级,全面集成Gemini AI功能,将其转变为"个人主动式收件箱助手"。新功能包括AI收件箱视图,可按优先级自动分组邮件;"帮我快速了解"功能提供邮件活动摘要;扩展"帮我写邮件"工具至所有用户;支持复杂问题查询如"我的航班何时降落"。部分功能免费提供,高级功能需付费订阅。谷歌强调用户数据安全,邮件内容不会用于训练公共AI模型。

华为研究团队突破代码修复瓶颈,8B模型击败32B巨型对手!

华为研究团队推出SWE-Lego框架,通过混合数据集、改进监督学习和测试时扩展三大创新,让8B参数AI模型在代码自动修复任务上击败32B对手。该系统在SWE-bench Verified测试中达到42.2%成功率,加上扩展技术后提升至49.6%,证明了精巧方法设计胜过简单规模扩展的技术理念。

联想集团混合式AI实践获权威肯定,CES期间获评“全球科技引领企业”

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

CES 2026 | 重大更新:NVIDIA DGX Spark开启“云边端”模式

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

研究发现商业AI模型可完整还原《哈利·波特》原著内容

Razer在2026年CES展会推出全息AI伴侣项目

CES 2026:英伟达新架构亮相,AMD发布新芯片,Razer推出AI奇异产品

通过舞蹈认识LimX Dynamics的人形机器人Oli

谷歌为Gmail搜索引入AI概览功能并推出实验性AI智能收件箱

DuRoBo Krono:搭载AI助手的智能手机尺寸电子阅读器

OpenAI推出ChatGPT Health医疗问答功能

Anthropic寻求3500亿美元估值融资100亿美元