华为持续领跑关键业务服务器性能测试世界纪录

2017年春节刚过,朋友圈的小伙伴还停留在晒出行、晒美食的氛围中。可华为关键业务服务器,再次打破SPEC测试性能世界纪录,递交了一份满意的开年答卷。还记得去年6月,华为关键业务服务器打破9项世界性能记录,关键业务服务器发货增长率领跑全球……成绩优异,但华为服务器团队没有傲娇,继续撸起袖子,埋头苦干。

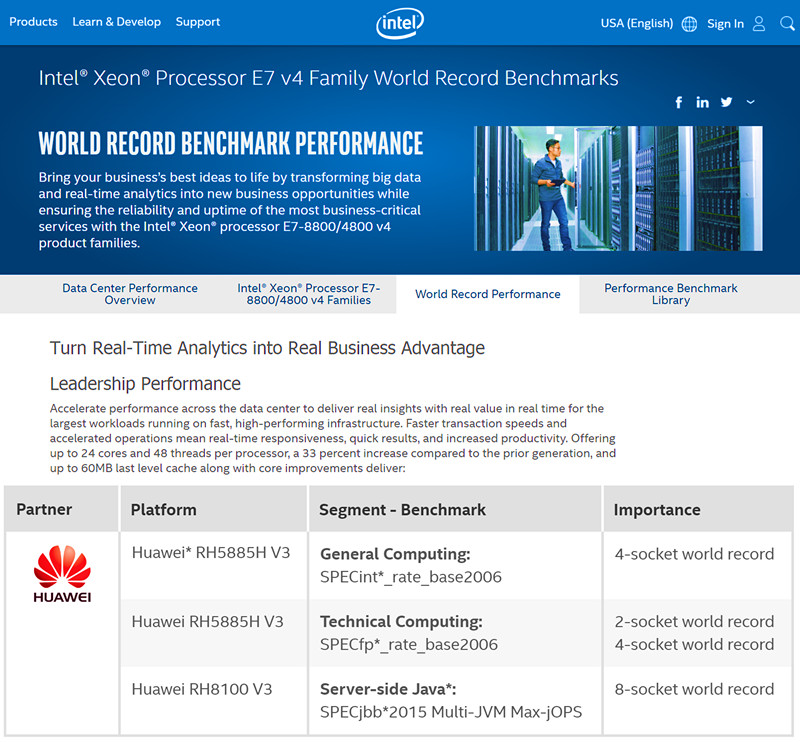

2017年2月7日英特尔在Global CES大会上,发布Intel® Xeon® E7 v4 8894处理器,同时宣布该处理器打破多项世界世界性能记录,其中2项世界记录由华为4P+关键业务服务器贡献。至2016年6月华为4P+关键业务服务器打破9项性能测试世界纪录,不到半年时间,再创两项世界记录,深刻的体现华为服务器人的工匠精神。

英特尔官网公布华为4P+服务器新的性能测试世界纪录

华为4P+关键业务务服务器搭载Intel® Xeon® E7 v4 8894处理器,基于SPECCPU 2006标准测试,所有项目测试结果值与业界同期同等服务器相比均第一。测试结果如下:

|

|

SPECCPU2006 |

|

|

服务器型号 |

Rate-int |

Rate-fp |

|

5885H V3 |

3800 |

2460 |

SPEC CPU2006 Benchmark测试值打破世界记录

SPECCPU 2006是SPEC组织推出的一套CPU子系统性能评估测试标准,SPEC CPU结果值可以更全面、准确反映服务器的强大的计算能力,尤其是ERP、CRM、数据库等各种应用下的处理效率。其中SPECint_rate_2006 基准测试的目的,主要衡量服务器在多处理器工作时整点计算能力和编译器优化能力。测试结果主要反映服务器整体的计算、吞吐量、缓存的性能及编译器的优化能力;另一个SPECfp_rate_2006 基准测试主要是衡量服务器在多处理器的浮点计算能力和编译器优化能力. 测试结果 主要反映服务器的浮点计算、缓存性能及编译器优化能力。这些值越高越能体现服务器在处理数据库事务处理、高性能计算的能力,为企业选择一款高性能的服务器提供参考。

华为4P+关键业务服务器是针对企业大型数据库、虚拟化、ERP、大数据实时分析等关键业务所设计的高性能路服务器。本次打破性能测试世界纪录的5885H V3支持英特尔至强E7 v4系列处理器。它最高支持96个计算核心,高达96个内存插槽,满足企业业务性能扩展要求。华为4P+关键业务服务器除了具备高性能外,还具备多项优势:

1、支持NVMe SSD盘,可用于高速缓存和数据块高速读写的应用,提升数据存储性能。特别是在SAP HANA应用中,可提升数据入库3倍的性能;

2、支持TCM(或者TPM)加密接口,用户可灵活配置TCM加密模块,使关键业务应用更加安全;

3、支持RAID带外管理,灵活查询和设置RAID配置信息及状态,实现对硬盘的精确管理和配置,支持在线配置RAID信息,使管理更方便;

4、提供FDM2.0故障诊断功能,支持实时的智能故障分析,精确定位硬件故障,大幅提高产品可靠性;

华为服务器以用户为中心,坚持持续创新,走开放架构、合作共赢路线,向客户提供可靠、高效、简单的计算平台和解决方案,助力企业应对数字经济时代的挑战,构建领先优势。

根据Gartner的统计数据*,截至2016年第3季度,华为服务器出货量排名全球前三(不含塔式),增长率全球第一,4路关键业务服务器发货量及发货量增长率全球第一。华为服务器已服务于全球超过5000家客户,涵盖政府及公共事业、互联网、电信、能源、金融、交通、医疗、教育、媒资、制造等行业。

更多SPEC测试值请查阅www.spec.org官网。

*数据来源:Gartner“Market Share: Servers, Worldwide, 3Q16 Update”,2016年11月28日

好文章,需要你的鼓励

谷歌Project Genie新增街景功能,带你探索真实世界

谷歌宣布为旗下互动世界构建工具Project Genie新增Google街景功能,用户可基于真实地点生成可探索的游戏世界。只需选定美国境内的地图位置,描述角色形象,并选择"沙漠"或"石器时代"等风格,系统即可生成与现实街景绑定的沉浸式虚拟场景。每次游玩时长限60秒,支持WASD操控,目前仅向AI Ultra订阅用户开放,后续将逐步扩展覆盖范围。

新加坡国立大学发布首个视频“潜台词“理解基准测试:AI究竟能不能读懂视频背后的弦外之音?

新加坡国立大学构建了首个视频隐喻理解基准ViMU,含588段视频与2352道题,测试16个主流AI模型均未超过50%,揭示AI在视频潜台词理解上的系统性短板。

手机上的“氛围编程“时代正式来临

随着AI编程工具的普及,越来越多的非开发者开始尝试自己构建应用。谷歌在I/O大会上宣布,AI Studio新增功能可让用户通过提示词快速生成原生Android应用,并直接导出到手机。此外,谷歌还推出了基于Gemini的自定义小组件功能,并提出"生成式UI"概念,让手机界面根据需求实时生成。与此同时,苹果据报道也在探索通过提示词创建快捷指令的功能,手机个性化体验或将迎来新突破。

浙江大学联合多所顶校:让AI真正“看懂“360度全景图,机器人导航和视觉搜索迎来新突破

浙江大学等机构联合提出PanoWorld,通过球面空间交叉注意力和57万张全景图训练数据,让AI能直接理解360度全景图的空间结构,在导航和视觉搜索任务中大幅超越现有方法。