高性能GPU服务器硬件拓扑与集群组网

一些 GPU 厂商(不是只有 NVIDIA 一家这么做)将将多个 DDR 芯片堆叠之后与 GPU 封装到一起 (后文讲到 H100 时有图),这样每片 GPU 和它自己的显存交互时,就不用再去 PCIe 交换芯片绕一圈,速度最高可以提升一个量级。这种“高带宽内存”(High Bandwidth Memory)缩写就是 HBM。

HBM研究框架:突破“内存墙”,封装新突破

HBM技术通过提升I/O口数量和速率,突破内存限制,成为AI芯片的强大辅助。HBM3和HBM3e将成为AI服务器主流配置,预计HBM4将于2026年发布。全球HBM市场预计在2024年超百亿美元。HBM采用TSV+Bumping和TCB键合方式,但散热效率低下,海力士引入MR-MUF工艺改善。预计HBM4将采用混合键合Hybrid Bonding技术,3D封装的核心是混合键合与TSV。

AI芯片架构众多,谁会主宰算力芯片?

智算中心的发展依托最新AI理论和计算架构,以AI大模型和算力技术为核心。GPU主导算力芯片市场,AI信创推动国产算力。AI分布式计算市场由算力芯片、内存和互联设备组成。ChatGPT推动GPU需求,SK海力士HBM3产量售罄。CoWoS封装技术集成HBM与处理器,台积电领先封装市场。AI算力需求推动高效电源技术发展,背面供电技术成为关键。

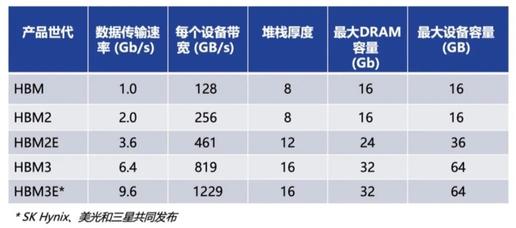

HBM、HBM2、HBM3和HBM3e技术对比

HBM(高带宽存储)是一种多层DRAM Die垂直堆叠的存储技术,通过TSV技术实现高带宽和小体积。

产业丨价格暴涨500%,高阶HBM市场来临

随着人工智能应用的增长,高带宽内存HBM需求激增,价格飙升。SK海力士和三星电子等存储大厂正在扩产以满足市场需求,同时也在开发下一代HBM技术。