德州仪器 (TI) 全新可编程逻辑产品系列助力工程师在数分钟内完成从概念到原型设计的整个过程

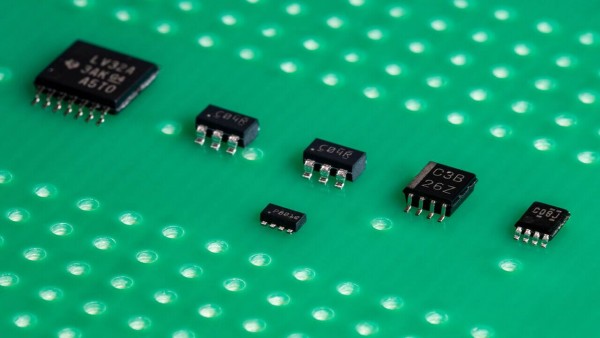

2024 年 10 月 22 日,德州仪器 推出了可编程逻辑器件 (PLD) 系列。此产品系列以德州仪器出色的逻辑产品系列为基础,旨在帮助工程师简化任何应用的逻辑设计。德州仪器的全新 PLD 产品系列能够在单个器件中集成多达 40 个组合和顺序逻辑及模拟功能,与分立式逻辑实施方案相比,可帮助将电路板尺寸缩小高达 94%,并降低系统成本。此外,与市场上的同类可编程逻辑器件相比,新产品系列还大幅节省了空间。

利用德州仪器易于使用的 InterConnect Studio 工具,工程师可在数分钟内设计、仿真和配置其器件以进行评估,而无需任何软件编码。InterConnect Studio 利用拖放式 GUI 和集成仿真功能加快了逻辑器件设计过程。设计人员还可以使用方便的点击编程和直接订购功能。这些功能可简化编程和采购,有助于加快产品上市步伐。

关键所在

“工程师们正在越来越多地考虑使用可编程逻辑器件来降低设计复杂性、减小布板空间、简化供应链管理以及缩短产品上市时间,”德州仪器接口产品部门副总裁兼总经理 Tsedeniya Abraham 表示,“但是,现有可编程逻辑器件的复杂性超出了许多应用的需求,涉及到编程专业知识,或者提供的封装选择有限。我们的全新可编程逻辑产品系列以 德州仪器 60 年逻辑产品设计经验为基础,采用业界通用封装,尺寸小至 2.56mm2,功耗低,通过 AEC Q-100 认证,温度范围为 -40°C 至 125°C,适用于汽车、工业和个人电子产品等应用。”

更多详情

德州仪器的 PLD 产品系列包括超小型引线式封装,尺寸为 2.1mm x 1.6mm,间距为 0.5mm。这种引线式封装比市场上同类器件小 92%,可满足制造商的焊接需求,但尺寸大大降低。德州仪器的汽车级 PLD 比最接近的市场上同类产品小 63%。此产品系列还提供 Quad Flat No-Lead (QFN) 封装选项,支持自动光学检测,可确保安全性和系统长期可靠性。

德州仪器全新 PLD 的静态电流小于 1µA,有功功率比市场上的同类器件低 50%,因此其低功耗特性有助于延长电动汽车、电动工具、电池包和游戏控制器等产品的电池续航时间。

德州仪器的所有新 PLD 产品均支持通用输入/输出、查找表、数字触发器、管道延迟、滤波器和电阻-电容振荡器。TPLD1201 和 TPLD1202 器件还集成了模拟比较器等模拟功能,具有内部可选电压基准选项和迟滞。TPLD1202 具有串行外设接口、I2C、看门狗计时器和状态机等附加功能。

供货情况

下表提供了德州仪器全新 PLD 产品的详细信息。此外,配套的开发工具包括:

- 评估模块,可在com 上购买。

- USB 编程器。

- InterConnect Studio,可在 com 上免费下载。

|

器件 |

封装 |

评估模块 |

|

TPLD801 |

SOT – 8 引脚 |

TPLD801-DRL-EVM |

|

TPLD801-Q1 |

SOT – 8 引脚 |

TPLD801-DRL-EVM |

|

TPLD1201 |

VSSOP – 10 引脚 |

TPLD1201-DGS-EVM |

|

QFN – 12 引脚 |

TPLD1201-RWB-EVM |

|

|

TPLD1201-Q1 |

VSSOP – 10 引脚 |

TPLD1201-DGS-EVM |

|

TPLD1202 |

SOT – 14 引脚 |

TPLD1202-DYY-EVM |

|

QFN – 12 引脚 |

TPLD1202-RWB-EVM |

|

|

TPLD1202-Q1 |

SOT – 14 引脚 |

TPLD1202-DYY-EVM |

来源:至顶网计算频道

好文章,需要你的鼓励

Queen‘s大学重磅研究:程序员的角色即将彻底改变,从码农到智能体指挥官

Queen's大学研究团队提出结构化智能体软件工程框架SASE,重新定义人机协作模式。该框架将程序员角色从代码编写者转变为AI团队指挥者,建立双向咨询机制和标准化文档系统,解决AI编程中的质量控制难题,为软件工程向智能化协作时代转型提供系统性解决方案。

苹果发布 iOS 26.0.1 系统更新,修复多项关键问题

苹果在iOS 26公开发布两周后推出首个修复更新iOS 26.0.1,建议所有用户安装。由于重大版本发布通常伴随漏洞,许多用户此前选择安装iOS 18.7。尽管iOS 26经过数月测试,但更大用户基数能发现更多问题。新版本与iPhone 17等新机型同期发布,测试范围此前受限。预计苹果将继续发布后续修复版本。

医疗AI的“显微镜革命“:西北工业大学团队发布首个超声影像专用智能助手EchoVLM

西北工业大学与中山大学合作开发了首个超声专用AI视觉语言模型EchoVLM,通过收集15家医院20万病例和147万超声图像,采用专家混合架构,实现了比通用AI模型准确率提升10分以上的突破。该系统能自动生成超声报告、进行诊断分析和回答专业问题,为医生提供智能辅助,推动医疗AI向专业化发展。

业界首款符合AEC-Q200标准额定电压高达1,000 VDC高压保险丝

数据中心的智算挑战,英特尔要如何应对?

下一代智能工厂怎么建?开放自动化给出“解题思路”

跟随西门子,在工博会感受沉浸式的工业AI体验

苹果发布 iOS 26.0.1 系统更新,修复多项关键问题

OpenAI将发布类似TikTok的社交应用,搭配Sora 2视频模型

微软推出Office智能体模式让用户"氛围办公"

AI助手现在能帮你创建高质量Word文档和Excel表格

高通新一代骁龙平台将推动智能体AI时代到来

SAPx阿里云,开启一条通往中国市场与全球化发展的全新路径

微软推出"氛围工作"模式,为Office套件加入AI智能体

OpenAI推出智能购物系统挑战谷歌亚马逊