NVIDIA CUDA-Q平台为全球量子计算研究发展注入新动力

NVIDIA 于今日宣布将通过开源的 NVIDIA CUDA-Q™ 量子计算平台,助力全球各地的国家级超算中心加快量子计算的研究发展。

全球多个超算中心采用NVIDIA CUDA-Q 平台,加速量子计算与AI的融合。德国、日本和波兰的超算中心将使用该平台来赋能他们由 NVIDIA 加速的高性能计算系统中的量子处理器(QPU)。

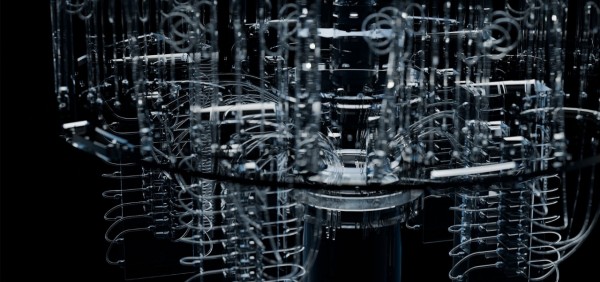

QPU 是量子计算机的大脑,通过利用电子或光子等粒子行为进行计算,计算方式与传统处理器不同,有可能使某些类型的计算速度更快。

德国于利希研究中心的于利希超算中心(JSC)正在安装一颗由 IQM Quantum Computers 公司制造的 QPU,以支持其配备 NVIDIA Grace Hopper™ 超级芯片的 JUPITER 超级计算机。

日本产业技术综合研究所(AIST)的 ABCI-Q 超级计算机采用了 NVIDIA Hopper 架构,也将增加一颗来自 QuEra 的 QPU。

波兰的波兹南超级计算与网络中心(PSNC)近期安装了两颗由 ORCA Computing 公司制造的光子 QPU,并且连接到了一个由 NVIDIA Hopper 加速的全新超级计算分区。

NVIDIA HPC 和量子计算总监 Tim Costa 表示:“量子与 GPU 超级计算的紧密集成将实现可用的量子计算。NVIDIA 的量子计算平台正在为诸如 AIST、JSC 和 PSNC 这样的先行者提供支持,助力其拓展科学发现的边界,并推进量子集成的超级计算的前沿发展。”

ABCI-Q 超级计算机集成的这颗 QPU 将使 AIST 的研究人员能够利用激光控制的铷原子作为量子比特进行计算,用以研究 AI、能源和生物学领域的量子应用。这些原子与精密原子钟中使用的原子类型相同。每个原子都是完全相同的,这为实现大规模高保真量子处理器提供了一种非常有前景的方法。

AIST 的量子与人工智能融合技术业务发展全球研究中心副主任 Masahiro Horibe 表示:“借助 ABCI-Q 量子-经典加速超级计算机,日本的研究人员将在实用量子计算应用方面取得进展。NVIDIA 正在帮助这一领域的先行者们推动量子计算研究的边界。”

PSNC 的 QPU 将使研究人员能够使用两个 PT-1 量子光子系统来探索生物学、化学和机器学习。这两个系统使用电信频率下的单个光子或光包用作量子比特。由此即可使用标准的现成电信组件实现分布式、可扩展和模块化的量子架构。

PSNC CTO 兼副主任 Krzysztof Kurowski 表示:“通过与 ORCA 和 NVIDIA 合作,使得我们能够创造一个独特的环境,构建一个全新的量子-经典混合系统。在以用户为中心服务的高效管理的多 QPU 和 GPU 系统上,开放、简便的集成和编程对于开发者和用户来说至关重要。这种密切的合作当下即为新一代量子加速超级计算机铺平了发展之路, 使其适用于很多创新的应用领域。”

JUPITER 超级计算机集成的 QPU 让 JSC 的研究人员能够开发针对化学模拟和优化问题的量子应用,并展示量子计算机如何加速经典超级计算机。该 QPU 是使用超导量子比特或电子谐振电路制造的,在低温下的行为像人造原子。

JSC 量子信息处理小组主管 Kristel Michielsen 表示:“混合量子-经典加速超级计算让量子计算更接近成为现实。通过与 NVIDIA 的持续合作,JSC 的研究人员将推进量子计算在化学和材料科学等各个领域的发展。”

通过将量子计算机与超级计算机紧密集成,CUDA-Q 还能够使 AI 与量子计算相结合,以解决有噪声的量子比特等问题,并开发高效的算法。

CUDA-Q 是一个开源的 QPU 无关的量子-经典加速超算平台。因其提供的一流性能而被大多数部署了 QPU 的公司所使用。

来源:至顶网计算频道

好文章,需要你的鼓励

Canva收购Leonardo.ai 加强生成式AI技术布局

Canva宣布收购生成式AI内容创作初创公司Leonardo.ai,交易条款未披露,但采用现金加股票的混合方式。Leonardo.ai的120名员工将全部加入Canva。Leonardo.ai成立于2022年,拥有1900万注册用户,其工具已创建超过10亿张图像。该公司将继续独立运营,专注于快速创新和研发。此次收购旨在帮助Canva扩展其Magic Studio生成式AI套件功能。

希伯来大学开发的免费AI导演:一句话变多幅电影级故事板

希伯来大学研究团队开发的Story2Board系统实现了从文字故事到专业故事板的自动转换突破。该系统采用潜在面板锚定和相互注意力数值混合两项核心技术,在保持角色一致性的同时实现丰富的视觉表现力。系统无需训练即可运行,能够生成电影级构图效果的连续画面,为内容创作、教育和娱乐产业提供了强大的AI辅助工具,代表了人机协作创作的新模式。

亚马逊Quick Suite:企业智能体AI的入门训练平台

亚马逊推出Quick Suite软件平台,旨在简化AI智能体和企业聊天机器人的创建过程。该平台支持50个企业级应用集成,包括Office 365、Slack等,提供无代码环境连接内部文档和数据源。平台包含Quick Flows自动化工具、Quick Research研究功能等组件。尽管降低了技术门槛,但AI智能体的准确性仍存疑虑,研究显示其办公任务错误率达70%。

数学难题的终极训练师:北邮团队如何让AI模型像真正的数学家一样思考

北京邮电大学联合腾讯团队开发的We-Math 2.0系统,通过构建491个知识点的数学知识体系、创新的三维难度建模和渐进式强化学习框架,让AI模型获得了真正的数学推理能力。该系统仅用9800个高质量样本就达到了与大规模数据训练相当的性能,在多个基准测试中表现优异,为AI数学教育应用开辟了新道路。

AI革新制造业:产品力、品牌力与精益运营的三维进化论

AMD 锐龙嵌入式 9000 系列为工业计算与自动化带来下一代性能和效率

Canva收购Leonardo.ai 加强生成式AI技术布局

亚马逊Quick Suite:企业智能体AI的入门训练平台

忘记训练,在AI推理阶段寻找杀手级应用

Infor推出行业专用AI智能体应对企业挑战

OpenAI战略转型:AMD与英伟达合作释放重要信号

Meta将把React移交给Linux基金会以消除单一厂商主导担忧

分布式数据存储初创公司欲挑战云计算巨头

NetApp为阿斯顿马丁F1车队提供全面数据存储解决方案

Solidigm揭示SSD发展路线图:将推出245TB固态硬盘

英特尔发布Panther Lake笔记本处理器,预览288核服务器芯片