IBMПЊдДГЌМЖМЦЫуЛњМЖOpenPowerаОЦЌжИСюМЏ

IBMНЋПЊЗХOpenPowerЯЕСаДІРэЦїКЫаФЕФЛњЦїгябддДДњТыЁЃФПЧАШЋЧђзюПьЕФСНЬЈГЌМЖМЦЫуЛњВЩгУЕФе§ЪЧOpenPowerДІРэЦїЁЃ

НёЬьЃЌOpenPower FoundationаћВМСЫетвЛЯћЯЂЃЌИУзщжЏЪЧIBMМИФъЧАГЩСЂЕФЃЌжМдкДйНјOpenPowerаОЦЌЯЕСаЕФВЩгУЁЃ

OpenPower FoundationЛЙЕУЕНСЫАќРЈЙШИшдкФкЕФЦфЫћКмЖрПЦММЙЋЫОЕФжЇГжЁЃ OpenPowerЛњЦїгябдЛђепжИСюМЏМмЙЙЃЌЪЧвЛжжНЋШэМўДњТызЊЛЛЮЊаОЦЌЕчТЗАхЮяРэОЇЬхЙмВйзїЕФМмЙЙЁЃ

вдЧАЦѓвЕашвЊДгIBMФЧРяЙКТђАКЙѓЕФаэПЩВХФмЪЙгУИУжИСюМЏЁЃЯждкЃЌЫћУЧПЩвдУтЗбЪЙгУСЫЃЌИУжИСюМЏШУаОЦЌЩшМЦШЫдБФмЙЛдкВЛжЇИЖАцЫАЕФЧщПіЯТдкЦфДІРэЦїжаЙЙНЈOpenPowerЙІФмЃЌаэПЩЬѕПюЛЙдЪаэгУЛЇРЉеЙКЭздЖЈвхЫћУЧЯЃЭћдЫааЬиЖЈгІгУЕФжИСюМЏЁЃ

IBMНЋЗЂВМвЛаЉзЪдДРДНЕЕЭВЩгУепЕФбЇЯАЧњЯпЃЌАќРЈгУгкНЋжИСюМЏЧЖШыЗЧOpenPowerаОЦЌЕФВЮПМжИФЯЃЌвдМАOpenCAPIКЭOpen Memory InterfaceавщЃЈгУгкСЌНгЗўЮёЦїCPUгыАхдиФкДцЃЉЕФЪЕЪЉЁЃ

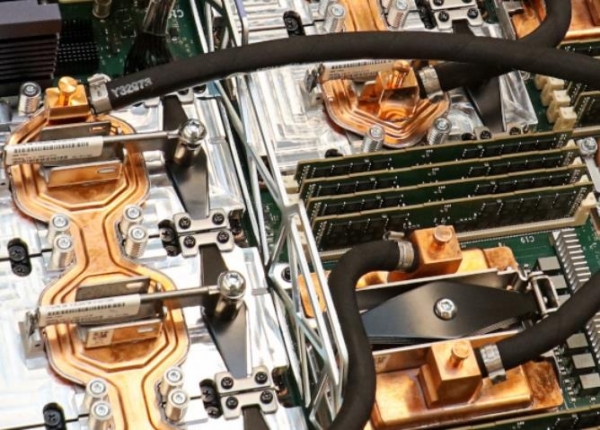

OpenPowerаОЦЌЕФЕзВуЮяРэМмЙЙЩаЮДПЊдДЁЃOpenPowerМвзхзюаТЕФCPU——Power9Опга80вкИіОЇЬхЙмКЭЖрДя24ИіДІРэКЫаФЃЈШЁОігкОпЬхаЭКХЃЉЁЃзїЮЊШЋЧђЧАСНДѓГЌМЖМЦЫуЛњЯЕЭГЃЌУРЙњФмдДВПЕФSummitКЭSierraГЌМЖМЦЫуЛњЯЕЭГФкВЩгУЕФе§ЪЧPower9ЁЃ

OpenPower FoundationШЯЮЊIBMПЊдДИУжИСюМЏЖдПЊдДЩчЧјЪЧКмгаРћЕФЁЃOpenPower FoundationжДааЖЪТHugh BlemingsБэЪОЃК“ЭЈЙ§НЋPOWER ISAзЊЮЊПЊЗХФЃЪН......ВЂНЋЦфЬсЙЉИјВЛЖЯГЩГЄЦ№РДЕФПЊЗХММЪѕШКЬхЃЌЮвУЧНЋЪЕЯжПЊЗХгВМўКЭШэМўСьгђДДаТЕФМгЫйдіГЄЁЃ”

зїЮЊИУЯюФПЕФбгЩьЃЌIBMНЋАбOpenPower FoundationЧЈвЦжСвЕНчзюжЊУћЕФПЊдДШэМўзщжЏ——Linux FoundationжЎЯТЃЌДгЖјгажњгкММЪѕЕФГЄЦкВЩгУЁЃ

OpenPowerжИСюМЏЪЧIBMздДгвд340вкУРдЊЪеЙКRed HatКѓЗЂВМЕФзюаТФкВПММЪѕЃЌRed HatвдЦфLinuxЗЂааАцЖјЮХУћЃЌЭЌЪБвВЪЧПЊдДЩњЬЌЯЕЭГЕФЙиМќВЮгыепЁЃДЫЧАЃЌIBMЗЂВМСЫШ§жжгУгкНјааАЉжЂбаОПЕФзЈгУШЫЙЄжЧФмЙЄОпЁЃ

РДдДЃКsiliconANGLE

КУЮФеТЃЌашвЊФуЕФЙФРј

УзРЁЄФТРЬсжиЗЕЙЋжкЪгвАЃЌНїЩїЗЂЩљ

ФТРЕйЪБИє18ИідТЪзДЮНгЪмжиДѓУНЬхВЩЗУЃЌНщЩмЦфДДСЂЕФThinking Machines Labе§дкПЊЗЂЕФ"НЛЛЅФЃаЭ"ЁЃИУФЃаЭФмвд200КСУыМфИєДІРэвєЦЕЁЂЮФБОКЭЪгЦЕСїЃЌВЖзНШЫРрНЛСїжаЕФжаЖЯЁЂаое§КЭЭЃЖйЁЃЫ§ЛЙЬИМАOpenAI"еўБфжм"ОРњЃЌЧПЕїаавЕОіВпШЈЙ§гкМЏжаЕФЕЃгЧЃЌВЂЛигІСЫЙЋЫОНќЦкбаОПШЫдБРыжАЮЪЬтЃЌБэЪОетЪЧГѕДДЪЕбщЪвЕФе§ГЃВЈЖЏЁЃ

ЕБAIЛњЦїШЫЁАздаХЕиЁАзВЯђЧНБкЃКSTATE16баОПдКНвЪОЮяРэAIЯЕЭГжаФЧаЉЮоЩљЮоЯЂЕФжТУќДэЮѓ

STATE16баОПдКетЦЊзлЪіЗЂЯжЃЌЮяРэAIЯЕЭГДцдк"ОВФЌЪЇаЇ"ЗчЯеЁЊЁЊAIвдИпЖШздаХжДааЛљгкДэЮѓЪРНчаХЯЂЕФЖЏзїЃЌШДВЛДЅЗЂШЮКЮБЈОЏЃЌВЂЬсГідкAIЪфГігыЮяРэжДаажЎМфНЈСЂЖРСЂЪкШЈВуЕФПђМмЁЃ

ЬиЫЙРвЩЫЦЩОГ§FSDжЄОнЃЌПЈЬиБЫРеМгЫйЕчЖЏЛЏВМОжЃЌИпбЙЯЕЭГММЪѕХрбЕПЬВЛШнЛК

БОЦкЁЖQuick ChargeЁЗВЅПЭКИЧЖрИіШШЕуЛАЬтЃКЬиЫЙРвЩЫЦЪдЭМЩОГ§FSDЦлеЉЯрЙижЄОнвдЙцБмОоЖюХтИЖЃЛПЈЬиБЫРеГжајЭЦНјНЈжўСьгђЕчЦјЛЏВМОжЃЛзЁеЌЬЋбєФм30%ЫАЪеЕжУтМДНЋЕНЦкЁЃДЫЭтЃЌМЮБіTom PachecoОЭИпбЙЯЕЭГгыЕчГиММЪѕХрбЕеЙПЊЬНЬжЃЌЧПЕїЕчЖЏГЕММЪѕШЫВХХрбјЕФНєЦШадЁЃНкФПЭЌЪБЬсабгавтАВзАЬЋбєФмЕФгУЛЇОЁПьааЖЏЃЌПЩЭЈЙ§EnergySageЦНЬЈБШНЯЖрМвАВзАЩЬБЈМлЁЃ

ЕБAIбЇЛсЁАБпИЩБпбЇЁАЃКUIUCгыЮЂШэСЊКЯДђдьЕФЭјвГжЧФмЬхбЕСЗаТЗЖЪН

UIUCгыЮЂШэСЊКЯбаЗЂЕФOpenWebRLПђМмШУ4BаЁФЃаЭНіЦО400ЬѕГѕЪМЪ§ОнЃЌЭЈЙ§дкецЪЕЭјеОЩЯБпзіБпбЇЕФЧПЛЏбЇЯАЗНЪНЃЌдкЭјвГжЧФмЬхЛљзМЩЯГЌдНСЫгУ27ЭђЬѕЪ§ОнбЕСЗЕФОКељЖдЪжЁЃ

ЬиЫЙРвЩЫЦЩОГ§FSDжЄОнЃЌПЈЬиБЫРеМгЫйЕчЖЏЛЏВМОжЃЌИпбЙЯЕЭГММЪѕХрбЕПЬВЛШнЛК

жЧФмЬхЭјТчСїСПЪзГЌецШЫЗУЮЪЃЌ"ЫРЭіЛЅСЊЭј"РэТлв§ЗЂаТељвщ

Mentium Technologies Luna-R1 AIаОЦЌШыбЁET-01аЧзљШЮЮёЃЌЭъГЩЖраЧВПЪ№РяГЬБЎ

ЬРЕРЩњЁСвІЫГгъЃКЬкбЖAIЯТАыГЁЃЌЦДЕФЪЧЁАФЃаЭЁСВњЦЗЁБЯЕЭГФмСІ

AIЧ§ЖЏЭјТчЗИзяЪ§СПьЩ§ЃЌРеЫїШэМўЪмКІепФъді389%ЃКFortinet ЗЂВМ2026ФъШЋЧђЭўаВЬЌЪЦбаОПБЈИц

InboltНЋдкAutomateеЙЛсЗЂВМЪгОѕЧ§ЖЏЛњЦїШЫБрГЬаТЙІФм

БЪМЧБОЕчФдЩюЖШЧхНржИФЯЃКФкЭтМцаоЛРШЛвЛаТ

МгРћИЃФсбЧжнГЧЪаЭЈЙ§ШЋУРЪзИігЩбЁУёЭЖЦБОіЖЈЕФЪ§ОнжааФНћСю

ВёгЭЬцДњЗНАИЃКAIЪ§ОнжааФШчКЮРћгУШМЦјв§ЧцгыеєЦћЮаТжЙЉЕч

AIЖЈвхЦћГЕЪБДњЃЌГЕдивдЬЋЭјПЩППадУцСйШЋаТЬєеН

АВШЋЫуЗЈЕФГжајИќаТе§БфЕУгњЗЂРЇФб

ЙьЕРЪ§ОнжааФБОжЪЩЯЪЧЙІФмЧПЛЏЕФЮРаЧ

EBМЖЕФЪ§ОнКщСїЯТЃЌЛЅСЊЭјЦѓвЕШчКЮЭЛЮЇЃП

IBMГЦЙтЯЫММЪѕПЩвдНЋШЫЙЄжЧФмбЕСЗЪБМфКЭФмКФМѕЩй80%

IBMаћВМНЋзюЧПДѓЕФGranite AIФЃаЭв§ШыAWSдЦЖЫ

IBMЬИPower11ЗЂВМЃКЁАШУКЯзїЛяАщЪжЩЯгаСЫИќЖрЕФЙЄОпЁБ

IBMТЪЯШВЩгУЁАвдСПзгЮЊжааФЕФГЌМЖМЦЫуЁБПЊеЙПЦбЇбаОП

IBM Granite 3.0ФЃаЭЃКЮЊДѓЙцФЃЦѓвЕAIгІгУжИУїЗНЯђ

IBMЪеЙККьУБеНЙћзПжјЃЌНЋгкУїФъФъГѕЪеЛиГЩБО

IBMЭЦГіGuardiumЪ§ОнАВШЋжааФЃЌгІЖдШЫЙЄжЧФмЁЂСПзгМЦЫуКЭЛьКЯдЦЗчЯе

IBMдкХЗжоПЊЩшЪзДІСПзгЪ§ОнжааФ

IBMдкЁАПэЫЩЕФЁБApacheаэПЩЯТЗЂВМзюаТGraniteЛљДЁФЃаЭ