Dell PowerScale新增pNFS支持,为现代化工作负载带来革命性并行性能

Dell PowerScale存储系统即将全面支持并行网络文件系统(pNFS)技术。这一突破性创新旨在解决企业现代化工作负载运行中的数据瓶颈问题,支持客户端并行访问多台服务器的数据,从而显著提升吞吐量并实现真正意义上的线性扩展。该升级无需客户端安装额外驱动程序,便可轻松实现强大的性能提升。

数据瓶颈的终结者:现代化存储的全新篇章

在现代化技术加速落地普及的进程中,数据瓶颈一直是制约企业创新的一大障碍。随着数据集规模的不断扩大和模型复杂度的显著提升,传统存储系统往往难以满足企业当前的业务需求,导致数据摄取和洞察生成的效率大幅下降。企业要想实现现代化转型蓝图,其存储系统必须支持对性能和容量的无缝扩展。

为此,戴尔科技对Dell PowerScale存储系统进行升级,新增支持pNFS及灵活文件布局(Flexible File Layout)。此举将重新定义企业级存储性能标杆,充分释放基础架构的并行处理潜能,为数据分析等要求严苛的现代化工作负载提供强有力的支持。

在传统NFS技术架构下,客户端通信需要通过单一网络端点完成,极易引发性能瓶颈。尽管这种串行化访问模式适用于许多场景,但面对需要高速处理的大规模现代化工作负载时,其吞吐量限制显而易见。

pNFS技术通过将元数据路径(文件信息)与数据路径(文件内容)分离,彻底打破了这一性能桎梏。该技术凭借更高效的并行数据访问架构,大幅提升数据吞吐量,进而全面加速智能Pipeline的运行流程。通过引入这一技术,PowerScale在延续其一贯简洁易用的网络附加存储(NAS)体验基础上,实现了并行性能的进阶突破,不仅提供统一的文件和对象数据访问能力,还兼具企业级弹性与运维简便性。

pNFS如何实现性能飞跃

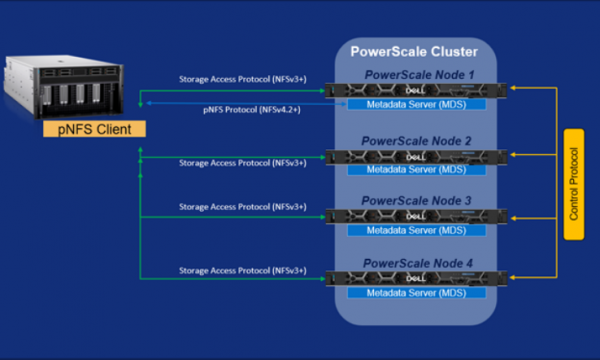

pNFS的设计以简洁性和高性能为核心,通过允许客户端同时与多个PowerScale节点通信,充分释放整个集群的分布式能力。其工作原理如下:

- 客户端集群直连通信:客户端首先与PowerScale集群中的元数据服务器通信,获取文件位置相关信息。

- 直接数据访问:元数据服务器向客户端提供一张“布局图”,详细标明文件数据存储在哪些节点。

- 并行数据流:客户端利用“布局图”,与多个数据服务器同时建立直接连接,实现并行数据读写。

这一从单一串行流到多并行流的转变,有效消除了传统架构中的性能瓶颈,使客户端能够充分利用PowerScale集群的聚合性能,从而加速数据摄取流程,并提升高吞吐量现代化工作负载的处理效率。

无缝部署,释放创新潜力

新技术的引入理当简化操作,而非增加复杂性。在进行pNFS集成设计时,戴尔科技充分考虑了这一点。由于当前大多数Linux发行版本已原生支持pNFS的Flexible File Layout布局,用户在本次升级中无需在客户端设备上安装额外的软件或驱动程序,即可无缝接入pNFS存储架构。

这一设计使得部署过程更加高效简便,企业IT团队可以直接利用并行I/O的优势,无需承担专用客户端软件的管理成本与运维负担,从而将更多精力投入到业务创新中。

客户端级线性扩展,现代化性能攀至全新高度

长期以来,Dell PowerScale集群始终以卓越的线性扩展能力著称——每新增一个节点,系统性能和存储容量便同步提升。这种横向扩展架构能够满足多种客户端和工作流的需求,确保在不同用例中始终保持一致的性能。

如今GPU计算客户端场景屡见不鲜,现代化工作负载对性能的要求愈发严苛。pNFS技术允许单一客户端与多个集群节点建立并行连接,一举打破传统NFS“客户端通信均需通过单一网络端点”所造成的性能瓶颈,在客户端级别实现真正的线性扩展。这意味着,随着PowerScale集群节点的增加,每个客户端都可以充分利用基础架构扩展后的全部性能。

对于需要高速处理和高吞吐量的现代化工作负载而言,这一功能无疑是革命性的。无论是实时处理海量数据集,还是支撑其他高需求的现代化应用场景,pNFS都能确保基础架构无缝扩展,以应对严苛的性能要求。借助焕新升级的PowerScale,企业不仅能在多样化工作流中实现高效的横向扩展存储,也能在运行复杂负载时获得单客户端并行访问所带来的卓越性能。

技术的真正价值在于帮助人们达成目标。Dell PowerScale的此次升级,正是对这一理念的践行——在保留NAS简洁易用特性的基础上,实现并行性能的进阶跃升,为各类现代化工作负载及数据分析策略构筑强大、可扩展且高效的架构底座。

来源:业界供稿

好文章,需要你的鼓励

谷歌推出AI购物智能体,帮你“一站式“购物体验升级

谷歌在I/O开发者大会上发布"通用购物车"功能,基于通用商务协议(UCP)整合YouTube、Gmail、Gemini等平台的购物数据,支持Target、Shopify、Wayfair等主流零售商。AI代理可自动检测商品兼容性、推荐优惠信用卡、比价提醒,并在用户授权下自动完成日常采购。该功能旨在打通"加入购物车"到"完成结账"的全流程,实现个性化、无摩擦的购物体验。

浙大、港科大等联合机构告诉你:AI学“看“3D场景,到底该怎样聪明地“选角度“?

这项联合研究提出了COVER方法和CM-EVS数据集,用贪心算法从3D场景中智能筛选全景视角,每场景仅需25帧即可完整覆盖室内场景,并附完整溯源日志。

伦敦大学学院等多机构联合揭示:AI“调音旋钮“让大模型推理训练不再崩溃

HolderPO通过引入可调参数p的霍尔德均值替代固定的算术平均,解决了大模型推理训练中信号放大与稳定性之间的根本矛盾,配合动态退火策略在数学推理和代理任务上均创造了新的最优记录。

Apple Music发布公开信:致力于在AI时代维护音乐公平生态

NHS十年计划的成功关键:数字健康必须达到临床标准

xAI与Anthropic计算资源合作协议,揭示AI算力独立商业化新趋势

利用Ubicept Photon Fusion提升CMOS夜间成像性能

Humanoid与制造业巨头博世达成战略合作,推进人形机器人量产

企业网络基础设施是否已为AI工作负载做好准备?

AI遭Z世代抵制:CIO面临的人才培养危机

Flytrex在达拉斯开设无人机制造工厂,加速扩张外卖配送网络

Brain Corp与加州大学圣地亚哥分校合作推进物理AI基础智能层研究

哈丁视角:工厂竞争的现实法则——执行力才是制胜关键

Doozy Robotics宣布全球扩张,以AI人形机器人构建工厂自动化劳动力

华为AI DC全栈方案发布:以数据觉醒,驱动产业智能跃迁