SIGGRAPH|NVIDIA物理AI“全景”更新! 原创

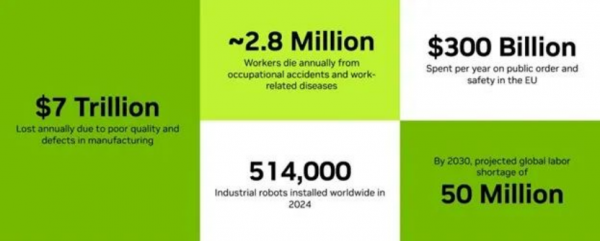

在工业生产与劳动力市场的复杂交织中,一组触目惊心的数据揭示了行业深层的痛点。制造业因质量缺陷每年损失高达7万亿美元,280万名劳动者因工伤和职业病失去生命,欧盟在公共安全领域投入了3000亿美元。

尽管2024年预计将有51.4万台工业机器人投入使用,但到2030年,工业领域仍面临5000万劳动力短缺的严峻挑战。这些数据反映出工业效率、安全与人力资源之间错综复杂的矛盾,也预示着传统生产方式亟需转型升级。

截取自NVIDIA官方信息

正是在这样的背景下,技术创新成为推动变革的关键力量。

在SIGGRAPH 2025大会上,NVIDIA系统性地发布了一系列技术和产品,旨在构建一个完整的物理AI全栈式解决方案,其战略布局可概括为两大核心支柱:面向机器人研发的Omniverse/Cosmos生态系统,以及服务于城市与工业基础设施的Metropolis平台。

Omniverse更新“库+模型”:构建具身智能的“虚拟训练场”

截取自NVIDIA官方信息

本次的关键更新之一,是全新的Omniverse NuRec 3D Gaussian Splatting (3DGS) 库。其利用NVIDIA RTX光线追踪能力,能将来自LiDAR、RGB-D相机等传感装置的原始点或图像数据,在极短时间内重建为高精度、可交互的3D高斯模型。

相比传统基于网格(mesh)或体素(voxel)的建模方式,3DGS能在保持几何精度和渲染效率的同时,实现从数据到数字孪生的极速转换。

可以理解,其是为智能体提供的逼真且具备物理属性的虚拟沙盘,或者是“从数字到物理世界”的双向翻译。利用3DGS,可极大加速了数字孪生的构建,且为后续的合成数据生成(Synthetic Data Generation)和迁移学习(Transfer Learning)奠定基础。

截取自NVIDIA官网

为了让这个“虚拟训练场”更具开放性,NVIDIA创新了在机器人控制和强化学习中常用的MuJoCo(MJCF)与OpenUSD之间的互操作性。通过OpenUSD这一“通用场景描述”语言,可让超过25万名MJCF开发者无缝地将其机器人模型和控制策略集成至Omniverse中。

紧随其后的Isaac Sim 5.0和Isaac Lab 2.2等开源框架,便可以利用Omniverse的强大渲染和物理引擎,进行大规模并行强化学习训练。这些框架集成了新的机器人与传感器模型,并通过领域随机化(domain randomization)等技术,显著减小了“仿真-现实”(sim-to-real)间的迁移鸿沟。

对于行业而言,通过在虚拟环境中进行大规模并行测试,企业能够在物理机器人制造之前,大幅缩减昂贵的研发周期与成本。

而对开发者来说,他们可以安全地模拟和训练极端或危险的场景(corner cases),从而提高最终部署在现实世界中的智能系统的鲁棒性和安全性。

这些技术利好已经在行业领先企业的应用中得到验证。Amazon Robotics、Boston Dynamics、Figure AI和Hexagon等巨头,正利用Omniverse平台在虚拟环境中加速其机器人的训练与验证。

“双轮”驱动物理AI:Cosmos Reason“理解决策” Transfer-2“高效合成”

Cosmos世界基础模型(WFM),可以理解为是NVIDIA物理AI技术栈中的“认知引擎”。其能为自动化系统赋予理解、生成和决策的能力,实现了AI从单纯的模式识别,向具备物理世界常识和复杂推理能力的跨越。

其中,此次更新的Cosmos Reason可理解为物理AI的“理解者”和“决策者”,而Cosmos Transfer-2则是物理AI的“数据工厂”和“训练数据提供者”。

Cosmos Transfer-2模型专注于合成数据生成,其通过简化提示词,支持多模态输入,能高效地创建高质量、物理精准的训练数据。

在模型性能优化方面,其精简版本通过创新的“单步蒸馏(single-step distillation)”技术,可将原本繁琐的70个步骤计算过程压缩为一步。

这一优化可降低模型推理的计算量和延迟,因此,模型能够在NVIDIA RTX PRO Blackwell平台、边缘、甚至本地设备上以极高效率运行,极大提升数据生成的吞吐量,减少了对大规模云端资源的依赖。

另一边,NVIDIA Cosmos Reason作为一款开源、可定制70亿参数推理视觉语言模型(VLM),其设计目标是赋予机器人和视觉智能体高级的推理能力。核心突破在于,超越了传统VLM仅限于语义标签的理解,能够进行多步骤任务分解、常识推理以及对物理世界的深度理解。

在机器人规划中,其能作为视觉语言行为(VLA)模型的大脑,将高层指令(如“拿起杯子并放到桌子上”)转化为可执行的低层任务序列。

在视频分析中,Cosmos Reason可用于上下文理解和时间事件推理,实现智能化的视频搜索与总结,以及自动化监控。

目前,Magna的自动配送平台,通过集成Cosmos Reason,显著增强了其对复杂城市环境的理解能力。

从行业角度看,Cosmos Reason使得智能体能够从被动执行者转变为主动决策者,扩展了机器人在复杂、动态环境中的应用范围,实现了决策与执行的一体化。另一方面作为开源模型,其允许开发者针对特定行业(如工业制造、医疗)进行微调,为其创造出高度专业化的具身智能应用,提供了可定制的“认知引擎”。

此外,该模型还能为传统工业视觉和自动化系统带来了“认知升级”,使得传统自动化系统能够更好地理解工作流程和环境,提高生产效率和安全性。

Metropolis:统一的边缘到云部署架构

Metropolis是NVIDIA推出的包含多应用框架的开发者平台,可以理解为是一个大型的、综合性的“智能视频开发基地”。在这个“基地”里,NVIDIA提供了各种专业工具(如TAO Toolkit)和预制的工作流程/结构(如DeepStream SDK),这些专业工具和工作流可帮助开发者更高效、更规范地完成特定的开发任务。

Metropolis平台的核心体现在其技术集成层面。

具体而言,Metropolis将Cosmos Reason VLM与VSS Blueprint 2.4深度融合,使智能摄像头等边缘设备能够进行上下文视频理解和时间事件推理,从而提升交通监控、公共安全等场景的智能化水平。

这些技术不仅减少了对大规模标注数据的依赖,也提高了模型的泛化能力。

硬件层面上,Metropolis的所有组件均可在NVIDIA全线硬件平台上运行,包括高性能的RTX PRO Blackwell GPU、桌面的DGX Spark以及低功耗边缘设备Jetson Thor。

这种全线覆盖的硬件兼容性,为开发者提供了从高算力云端到低功耗边缘设备的统一开发和部署架构,可实现AI应用在不同计算环境中的无缝迁移。

对行业从业者而言,Metropolis提供的是一个工业化、标准化的开发生产线,告别了以往的碎片化集成,显著提升了研发效率和项目可复制性。TAO Toolkit 6中的基础模型、自监督学习和知识蒸馏,大幅降低了数据标注依赖和模型训练成本,同时优化了边缘部署模型的泛化与性能。

更重要的是,其实现了从云到边全线硬件的统一开发部署,真正做到“一处开发,处处运行”,极大简化了AI应用的规模化落地和维护。Cosmos Reason VLM等技术则将智能摄像头从“识别”提升到“理解”和“推理”,带来更深层次的场景洞察。

技术支持“闭环”:从基础设施到生态体系

当然,AI的创新离不开强大的计算基础设施和开放的开发者生态,这正是技术能够快速迭代并实现大规模应用的根本保障。

在SIGGRAPH大会上,NVIDIA发布了全新的NVIDIA RTX PRO Blackwell服务器和DGX Cloud服务,为物理自动化系统的开发与部署提供了高性能的计算支持。RTX PRO Blackwell服务器以其强大的并行计算能力,统一支持仿真和训练等多样化工作负载,是实现大规模仿真与模型训练的关键基础。与此同时,DGX Cloud作为托管云服务,有效简化了大规模应用的部署与管理,使开发者能够专注于技术创新,而无需为基础设施的维护耗费过多精力。

软硬件协同和云边一体的架构,为物理AI的快速发展筑牢了坚实后盾。NVIDIA此举带来了双重利好:一方面,通过OpenUSD等开放标准,NVIDIA正积极成为工业元宇宙和数字孪生领域的“技术中枢”,这大幅降低了行业开发门槛,提升了系统间的互联互通,实现了生态整合和行业标准化;另一方面,从GPU硬件到软件库,再到云服务,NVIDIA提供了完整的全栈技术支持,极大降低了开发者在物理AI研究与商业化应用过程中的复杂度。

整体来看,这一系列举措不仅提升了技术能力,也推动了物理AI产业的生态繁荣与创新加速。

具体而言一方面,NVIDIA通过OpenUSD等开放标准,正积极成为工业元宇宙和数字孪生领域的“技术中枢”,这对于整个行业来说,意味着更低的开发门槛和更强的互联互通性,实现了生态整合与行业标准化。

另一方面,从GPU硬件到软件库、再到云服务,NVIDIA提供了一整套完整的工具,大大降低了开发者进行物理AI研究和商业化应用的复杂性,提供了全面的全栈式技术支持。

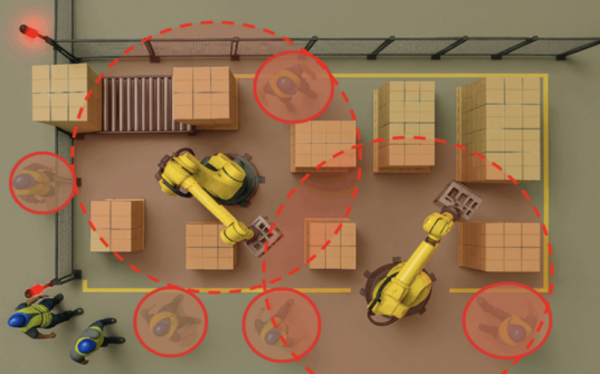

值得注意的是,目前多家企业加快推动物理 AI发展,并采用NVIDIA的技术产品。Accenture与 Belden 协作开发智能虚拟围栏,利用 NVIDIA Omniverse 平台和 Metropolis 构建模拟;Avathon使用 NVIDIA Metropolis 的 VSS 蓝图,为制造业和能源设施提供实时见解,其视频智能产品被 Reliance British Petroleum Mobility Limited 用于加油站建设;DeepHow开发 “Smart Know-How Companion”,利用 Metropolis VSS 蓝图转换关键工作流,Anheuser-Busch InBev 借助其平台优化培训。麦视通(Milestone Systems)通过 “哈夫尼亚计划” 创建计算机视觉数据库,为物理 AI 开发者提供定制化 VLM 访问,利用相关 NVIDIA 模型助力开发。Telit Cinterion将 NVIDIA TAO Toolkit 6 集成到基于 AI 的视觉检测平台,支持多模态 AI 和高性能推理。

图片由 Accenture 和 Belden 提供

写在最后

如果说过去的大语言模型和视觉模型主要通过海量文本和图像数据学习抽象的模式,那么物理AI所追求的,则是在一个可交互、环境精准的虚拟世界中,让智能体习得具身化的认知。

对NVIDIA来说,可以理解其Omniverse提供了“世界”,Cosmos提供了“认知”,Metropolis提供了“具身”,共同构成了一个完整的演进路径。

这种全栈式方法论的必然性在于,物理AI的真正实现,需要一个高度逼真且可控的物理仿真环境,和能够进行复杂推理并理解物理世界的认知引擎,以及一套能够将智能无缝部署到现实世界的工程体系。

NVIDIA正将这些关键要素整合在统一的生态中。然而,其深层意义或许在于,NVIDIA正试图弥合数字世界与物理世界之间的鸿沟。

或许,我们正站在下一个“奇点”之上,见证一个由物理AI驱动的智能自主时代。

来源:至顶网计算频道

好文章,需要你的鼓励

非洲电信基础设施巨头数字化转型实战访谈

Helios Towers供应链总监Dawn McCarroll在采访中分享了公司的数字化转型经验。作为一家在非洲和中东地区运营近15000个移动通信塔站的公司,Helios正通过SAP S/4Hana系统升级、AI技术应用和精益六西格玛方法论来优化供应链管理。McCarroll特别强调了公司Impact 2030战略中的数字包容性目标,计划在未来五年内培训60%的合作伙伴员工掌握精益六西格玛原则,并利用大数据和AI技术实现端到端的供应链集成。

德国机构首创免训练人脸质量评估技术:Vision Transformer也能当“质检员“

德国弗劳恩霍夫研究院提出ViTNT-FIQA人脸质量评估新方法,无需训练即可评估图像质量。该方法基于Vision Transformer层间特征稳定性原理,通过测量图像块在相邻层级间的变化幅度判断质量。在八个国际数据集上的实验显示其性能可媲美现有最先进方法,且计算效率更高,为人脸识别系统提供了即插即用的质量控制解决方案,有望广泛应用于安防监控和身份认证等领域。

n8n 供应链攻击利用社区节点窃取 OAuth 令牌

威胁行为者在npm注册表上传8个恶意包,伪装成n8n工作流自动化平台的集成组件来窃取开发者OAuth凭据。其中一个名为"n8n-nodes-hfgjf-irtuinvcm-lasdqewriit"的包模仿Google Ads集成,诱导用户在看似合法的表单中关联广告账户,然后将凭据传输到攻击者控制的服务器。这种攻击利用了工作流自动化平台作为集中凭据库的特点,能够获取多个服务的OAuth令牌和API密钥。

临床AI大模型的人格面具:布朗大学揭示医疗角色扮演的双刃剑效应

布朗大学联合图宾根大学的研究团队通过系统实验发现,AI医疗助手的角色设定会产生显著的情境依赖效应:医疗专业角色在急诊场景下表现卓越,准确率提升20%,但在普通医疗咨询中反而表现更差。研究揭示了AI角色扮演的"双刃剑"特性,强调需要根据具体应用场景精心设计AI身份,而非简单假设"更专业等于更安全",为AI医疗系统的安全部署提供了重要指导。