AI“时尚大秀”空降上海,联想要打造超级智能体“生态雨林”?

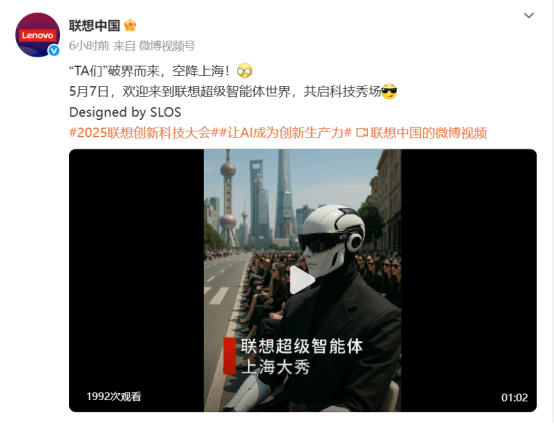

4月28日,一支极具未来感的科幻大片再次刷爆社交媒体:一支由联想超级智能体组成的时尚“部队”空降上海,气场十足且身怀绝技的联想超级智能体们从“AI之门”鱼贯而出,为观众献上了一场前所未见的“智能体时装秀”。最后视频尾版定格在了5月7日联想创新科技大会(Tech World)。

这意味着联想将首次正式公开其“超级智能体军团”?还是将官宣人形机器人“硅基战队”?甚至是对未来智能体世界的疯狂暗示? 至少通过这支视频,可以确定公众在大会期间见到的绝对不止一款超级智能体。

其实在不久前召开的新财年誓师大会上,联想曾官宣过一款乐享企业超级智能体。据内部人士透露,其将在超级咨询、电商购物、智慧门店、会员权益、方案讲解、智能服务等经典场景中为联想会员、客户、合作伙伴等带来超越想象的AI体验。

未来,联想会员权益可能不再是固定福利,乐享或通过分析用户全渠道行为,在生日当天自动组合PC延保、咖啡券等跨业态福利,让“联想会员”成为可生长的权益生态。

而对于消费者来说,当用户在联想商城输入“能剪4K视频的轻薄本”,或许乐享将根据历史订单计算并推送最佳优惠,甚至以最快速度安排送货上门。

对合作伙伴来说,或许乐享将为他们带来“生态级库存呼吸系统”——不仅可以随时通过乐享获取合作伙伴优惠政策,甚至可以通过乐享调配库存。

AI加速来袭,智能“生态雨林”也在茁壮成长。联想到底将在创新科技大会上为大家呈现一场怎样的超级智能体“盛宴”,让我们拭目以待。

来源:业界供稿

好文章,需要你的鼓励

Allen AI团队推出SAGE:首个能像人类一样“想看多长就看多长“的智能视频分析系统

Allen AI研究所联合多家顶尖机构推出SAGE智能视频分析系统,首次实现类人化的"任意时长推理"能力。该系统能根据问题复杂程度灵活调整分析策略,配备六种智能工具进行协同分析,在处理10分钟以上视频时准确率提升8.2%。研究团队创建了包含1744个真实娱乐视频问题的SAGE-Bench评估平台,并采用创新的AI生成训练数据方法,为视频AI技术的实际应用开辟了新路径。

联想推出DE6600系列:更智能的存储解决方案

联想推出新一代NVMe存储解决方案DE6600系列,包含全闪存DE6600F和混合存储DE6600H两款型号。该系列产品延迟低于100微秒,支持多种连接协议,2U机架可容纳24块NVMe驱动器。容量可从367TB扩展至1.798PiB全闪存或7.741PiB混合配置,适用于AI、高性能计算、实时分析等场景,并配备双活控制器和XClarity统一管理平台。

AI视觉模型真的能看懂长篇文档吗?中科院团队首次揭开视觉文本压缩的真相

中科院团队首次系统评估了AI视觉模型在文本压缩环境下的理解能力,发现虽然AI能准确识别压缩图像中的文字,但在理解深层含义、建立关联推理方面表现不佳。研究通过VTCBench测试系统揭示了AI存在"位置偏差"等问题,为视觉文本压缩技术的改进指明方向。

数智时代,openGauss Summit 2025即将发布哪些技术创新破局

“算力+储能”深度融合:超智算发布分布式算力超级节点储能解决方案

联想推出DE6600系列:更智能的存储解决方案

创业公司如何在严格监管行业中实现生死攸关的创新

OpenAI发布GPT-5.2-Codex模型,软件工程自动化能力大幅提升

Waterfox浏览器宣布拒绝AI功能,瞄准Firefox忠实用户

TikTok美国业务出售交易将于下月完成

破局AI数据中心安全瓶颈:Fortinet联合NVIDIA引领隔离式加速新航向

智算中心进化论,科华数据如何做到“更懂”

更高负载、更快建设:2026年数据中心六大趋势

Snowflake数据库更新引发全球大规模服务中断

AI编程初创公司Lovable融资3.3亿美元,英伟达等科技巨头支持